基于深度学习的大数据时序预测模型构建指南

基于深度学习的大数据时序预测模型构建指南

关键词:时序数据、深度学习、LSTM、Transformer、时序预测、滑动窗口、多步预测

摘要:本文从生活中的“天气预报”入手,逐步拆解大数据时序预测的核心逻辑,用“给小学生讲故事”的语言解释时序数据特点、深度学习模型原理(如LSTM、Transformer),并通过股票价格预测的实战案例,手把手教你从数据清洗到模型部署的全流程。无论你是刚接触机器学习的新手,还是想优化现有预测系统的工程师,都能从中找到构建高性能时序预测模型的关键方法。

背景介绍

目的和范围

你是否遇到过这些场景?

- 奶茶店老板需要预测明天的销量,避免原料浪费;

- 电厂需要预测未来3天的用电负荷,调整发电计划;

- 股民想根据历史股价预测下周走势……

这些都属于时序预测(Time Series Forecasting)问题。传统方法(如ARIMA、指数平滑)在小数据量下表现不错,但面对“大数据”(比如每秒产生的传感器数据、高频交易数据)时,无法捕捉复杂的时间依赖关系。

本文将聚焦基于深度学习的时序预测模型,覆盖从数据理解、模型选择到实战落地的全流程,帮助你用深度学习解决真实场景中的时序预测难题。

预期读者

- 对机器学习有基础了解,但未深入接触时序预测的新手;

- 想用深度学习优化现有预测系统的工程师;

- 对LSTM、Transformer等模型感兴趣的技术爱好者。

文档结构概述

本文将按照“概念→原理→实战”的逻辑展开:

- 用“天气预报”故事引出时序数据的特点;

- 解释LSTM、Transformer等核心模型的工作原理(用“记忆盒子”“重点标记”等比喻);

- 通过股票价格预测案例,演示从数据清洗到模型部署的全流程;

- 总结不同场景下的模型选择策略,展望未来趋势。

术语表

- 时序数据(Time Series Data):按时间顺序记录的序列数据(如每天的温度、每分钟的股价)。

- 单步预测(Single-step Forecasting):用过去数据预测下一个时间点的值(如用前7天温度预测第8天)。

- 多步预测(Multi-step Forecasting):用过去数据预测未来多个时间点的值(如用前7天温度预测第8-10天)。

- 滑动窗口(Sliding Window):将长时序数据切分成多个“历史-未来”窗口(如每7天作为输入,第8天作为输出)。

- LSTM(长短期记忆网络):一种能捕捉长期依赖的循环神经网络(RNN)改进模型。

- Transformer:基于“注意力机制”的模型,擅长捕捉序列中的长距离依赖关系。

核心概念与联系

故事引入:小明的“天气预测器”

小明想做一个“天气预测器”,用过去7天的温度数据预测第8天的温度。他发现:

- 温度有“惯性”:今天热,明天可能也热(短期依赖);

- 温度有“周期性”:夏天整体比冬天热(长期依赖);

- 偶尔有“意外”:突然下雨降温(噪声)。

传统方法(如用前3天的平均温度预测)总在“意外”时出错。后来他学了深度学习,发现模型能同时记住“短期惯性”和“长期规律”,甚至能“忽略”部分噪声——这就是深度学习时序预测的魅力!

核心概念解释(像给小学生讲故事一样)

核心概念一:时序数据的三大特点

时序数据就像一列按时间排好队的“数字士兵”,每个士兵的位置(时间点)和值(观测值)都很重要。它有三个关键特点:

- 时间依赖性:后面的“士兵”和前面的“士兵”有关系(比如今天的温度受昨天影响)。

- 周期性:“士兵”会按一定规律重复(比如每周的温度波动、每年的季节变化)。

- 噪声:有些“士兵”是“调皮鬼”,值会突然变化(比如突然下雨导致温度骤降)。

核心概念二:LSTM——会“记忆”的魔法盒子

传统的循环神经网络(RNN)像一个“健忘的小朋友”,只能记住最近几个“士兵”的信息,时间一长就忘了(长距离依赖问题)。

LSTM(长短期记忆网络)给RNN加了三个“门”(输入门、遗忘门、输出门),就像一个“带锁的记忆盒子”:

- 遗忘门:决定“盒子”里哪些旧信息要扔掉(比如忘记一个月前的温度,只保留最近一周的);

- 输入门:决定哪些新信息要放进“盒子”(比如今天的温度是否重要,需要记录);

- 输出门:决定“盒子”里的信息如何影响当前预测(比如综合最近一周的温度,输出明天的预测值)。

核心概念三:Transformer——会“划重点”的阅读高手

LSTM虽然能记长期信息,但处理超长序列(比如1000天的温度数据)时,还是会“慢”下来(因为要按顺序处理每个时间点)。

Transformer像一个“快速阅读高手”,它用**自注意力机制(Self-Attention)**同时看所有时间点的“士兵”,并给每个“士兵”标上“重要度”(注意力分数)。比如预测明天温度时,它可能发现“3天前的温度”和“7天前的温度”特别重要,就给它们更高的分数,然后综合这些重点信息做预测。

核心概念之间的关系(用小学生能理解的比喻)

- 时序数据特点 vs 模型选择:如果数据有强短期依赖(比如股票分钟级数据),LSTM的“记忆盒子”更擅长;如果数据有复杂长期依赖(比如年度气候数据),Transformer的“划重点”能力更强。

- LSTM vs Transformer:LSTM像“按顺序读课本”,逐个时间点处理;Transformer像“跳读课本”,一眼看到所有重点。两者都能处理时序数据,但适用场景不同。

- 滑动窗口 vs 模型输入:滑动窗口是“切分课本”,把长序列切成小片段(比如每7天为一个片段);模型输入就是这些小片段,模型需要从片段中学习规律。

核心概念原理和架构的文本示意图

时序数据 → 滑动窗口切分 → 输入模型(LSTM/Transformer) → 输出预测值

(例:前7天温度 → LSTM → 第8天温度)

Mermaid 流程图

原始时序数据

数据清洗(去噪声/补缺失)

滑动窗口切分(输入窗口+输出窗口)

选择模型(LSTM/Transformer)

模型训练(学习时间依赖规律)

模型评估(用MAE/MSE等指标验证效果)

实际预测(输入新窗口,输出未来值)

核心算法原理 & 具体操作步骤

LSTM的核心原理(用“记忆盒子”解释)

LSTM的每个“记忆单元”有三个门和一个“记忆细胞”(Cell State),公式如下(用LaTeX表示):

-

遗忘门:决定丢弃多少旧记忆

ft=σ(Wf⋅[ht−1,xt]+bf) f_t = \sigma(W_f \cdot [h_{t-1}, x_t] + b_f) ft=σ(Wf⋅[ht−1,xt]+bf)

(σ\sigmaσ是sigmoid函数,输出0-1,0表示完全丢弃,1表示完全保留) -

输入门:决定添加多少新记忆

it=σ(Wi⋅[ht−1,xt]+bi) i_t = \sigma(W_i \cdot [h_{t-1}, x_t] + b_i) it=σ(Wi⋅[ht−1,xt]+bi)

C~t=tanh(WC⋅[ht−1,xt]+bC) \tilde{C}_t = \tanh(W_C \cdot [h_{t-1}, x_t] + b_C) C~t=tanh(WC⋅[ht−1,xt]+bC)

(C~t\tilde{C}_tC~t是候选记忆,tanh\tanhtanh输出-1到1,表示新记忆的强度) -

记忆更新:结合旧记忆和新记忆

Ct=ft⊙Ct−1+it⊙C~t C_t = f_t \odot C_{t-1} + i_t \odot \tilde{C}_t Ct=ft⊙Ct−1+it⊙C~t

(⊙\odot⊙是按元素相乘,CtC_tCt是更新后的记忆细胞) -

输出门:决定输出多少记忆

ot=σ(Wo⋅[ht−1,xt]+bo) o_t = \sigma(W_o \cdot [h_{t-1}, x_t] + b_o) ot=σ(Wo⋅[ht−1,xt]+bo)

ht=ot⊙tanh(Ct) h_t = o_t \odot \tanh(C_t) ht=ot⊙tanh(Ct)

(hth_tht是当前时间步的输出,用于预测)

Transformer的核心原理(用“划重点”解释)

Transformer的核心是自注意力层,它为每个时间点计算与其他所有时间点的“相关度”(注意力分数),公式如下:

-

查询(Query)、键(Key)、值(Value):将输入向量转换为三个矩阵(Q、K、V)

Q=XWQ,K=XWK,V=XWV Q = XW^Q, K = XW^K, V = XW^V Q=XWQ,K=XWK,V=XWV -

注意力分数:计算每个Q与所有K的相似度(用点积)

Attention(Q,K,V)=softmax(QKTdk)V \text{Attention}(Q,K,V) = \text{softmax}\left( \frac{QK^T}{\sqrt{d_k}} \right) V Attention(Q,K,V)=softmax(dkQKT)V

(dk\sqrt{d_k}dk是缩放因子,防止点积过大导致softmax梯度消失)

具体操作步骤(以LSTM为例)

- 数据预处理:将原始时序数据归一化(缩放到0-1),便于模型学习。

- 滑动窗口切分:假设用前7天预测第8天,窗口大小为7,步长为1,得到输入X(7天数据)和输出y(第8天数据)。

- 模型构建:用Keras搭建LSTM模型,包含1层LSTM(64个神经元)和1层全连接层(输出1个预测值)。

- 模型训练:用Adam优化器,均方误差(MSE)作为损失函数,训练20轮。

- 模型评估:用测试集计算MAE(平均绝对误差),评估预测精度。

数学模型和公式 & 详细讲解 & 举例说明

时序预测的数学定义

给定时间序列 X={x1,x2,…,xT}X = \{x_1, x_2, …, x_T\}X={x1,x2,…,xT},其中 xtx_txt 是时间 ttt 的观测值,目标是预测未来 hhh 个时间点的值 y^={x^T+1,x^T+2,…,x^T+h}\hat{y} = \{\hat{x}_{T+1}, \hat{x}_{T+2}, …, \hat{x}_{T+h}\}y={xT+1,xT+2,…,xT+h}。

常用评估指标

-

MAE(平均绝对误差):预测值与真实值绝对差的平均

MAE=1h∑t=1h∣x^T+t−xT+t∣ MAE = \frac{1}{h} \sum_{t=1}^h |\hat{x}_{T+t} – x_{T+t}| MAE=h1t=1∑h∣xT+t−xT+t∣ -

MSE(均方误差):预测值与真实值差的平方的平均(对异常值更敏感)

MSE=1h∑t=1h(x^T+t−xT+t)2 MSE = \frac{1}{h} \sum_{t=1}^h (\hat{x}_{T+t} – x_{T+t})^2 MSE=h1t=1∑h(xT+t−xT+t)2 -

MAPE(平均绝对百分比误差):绝对误差占真实值的百分比(适合不同量级数据的比较)

MAPE=100%h∑t=1h∣x^T+t−xT+txT+t∣ MAPE = \frac{100\%}{h} \sum_{t=1}^h \left| \frac{\hat{x}_{T+t} – x_{T+t}}{x_{T+t}} \right| MAPE=h100%t=1∑hxT+txT+t−xT+t

举例:假设真实温度是25℃,模型预测24℃,则MAE=1℃,MSE=1℃²,MAPE=4%((1/25)*100%)。

项目实战:股票价格预测(用LSTM实现)

开发环境搭建

- 操作系统:Windows/macOS/Linux

- 工具:Anaconda(管理Python环境)、Jupyter Notebook(编写代码)

- 库:Pandas(数据处理)、NumPy(数值计算)、TensorFlow/Keras(模型构建)、Matplotlib(可视化)

源代码详细实现和代码解读

# 导入库

import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

from sklearn.preprocessing import MinMaxScaler

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import LSTM, Dense

# -------------------- 步骤1:加载和查看数据 --------------------

# 假设数据是某股票的历史收盘价(时间列+收盘价列)

df = pd.read_csv('stock_prices.csv')

df['Date'] = pd.to_datetime(df['Date']) # 转换时间格式

df.set_index('Date', inplace=True) # 用时间作为索引

print("数据前5行:")

print(df.head())

# 可视化历史价格

plt.figure(figsize=(12, 6))

plt.plot(df['Close'])

plt.title('Historical Stock Prices')

plt.xlabel('Date')

plt.ylabel('Price (USD)')

plt.show()

# -------------------- 步骤2:数据预处理 --------------------

# 提取收盘价并归一化(0-1)

data = df.filter(['Close']).values

scaler = MinMaxScaler(feature_range=(0, 1))

scaled_data = scaler.fit_transform(data)

# 创建滑动窗口(前60天预测第61天)

window_size = 60 # 输入窗口大小(60天)

X, y = [], []

for i in range(window_size, len(scaled_data)):

X.append(scaled_data[i-window_size:i, 0]) # 前60天数据

y.append(scaled_data[i, 0]) # 第61天数据

# 转换为NumPy数组并划分训练集(80%)和测试集(20%)

X = np.array(X)

y = np.array(y)

train_size = int(0.8 * len(X))

X_train, X_test = X[:train_size], X[train_size:]

y_train, y_test = y[:train_size], y[train_size:]

# 调整输入形状为LSTM要求的(样本数,时间步,特征数)

X_train = np.reshape(X_train, (X_train.shape[0], X_train.shape[1], 1))

X_test = np.reshape(X_test, (X_test.shape[0], X_test.shape[1], 1))

# -------------------- 步骤3:构建和训练LSTM模型 --------------------

model = Sequential()

# LSTM层:64个神经元,返回序列为False(只需要最后一个时间步的输出)

model.add(LSTM(64, return_sequences=False, input_shape=(X_train.shape[1], 1)))

model.add(Dense(1)) # 输出层:1个预测值

model.compile(optimizer='adam', loss='mean_squared_error') # 用MSE作为损失函数

history = model.fit(X_train, y_train, batch_size=32, epochs=20, validation_data=(X_test, y_test))

# 可视化训练损失

plt.figure(figsize=(12, 6))

plt.plot(history.history['loss'], label='Training Loss')

plt.plot(history.history['val_loss'], label='Validation Loss')

plt.title('Model Loss')

plt.xlabel('Epochs')

plt.ylabel('Loss (MSE)')

plt.legend()

plt.show()

# -------------------- 步骤4:模型预测和评估 --------------------

# 预测测试集

predictions = model.predict(X_test)

# 反归一化(恢复原始价格)

predictions = scaler.inverse_transform(predictions)

y_test_actual = scaler.inverse_transform(y_test.reshape(-1, 1))

# 计算MAE和MSE

mae = np.mean(np.abs(predictions - y_test_actual))

mse = np.mean((predictions - y_test_actual) ** 2)

print(f"测试集MAE: {mae:.2f} USD")

print(f"测试集MSE: {mse:.2f} USD²")

# 可视化预测结果

plt.figure(figsize=(12, 6))

plt.plot(y_test_actual, label='Actual Price')

plt.plot(predictions, label='Predicted Price')

plt.title('Stock Price Prediction vs Actual')

plt.xlabel('Time Steps (Test Set)')

plt.ylabel('Price (USD)')

plt.legend()

plt.show()

代码解读与分析

-

数据预处理:用

MinMaxScaler将价格缩放到0-1,避免模型受大数值影响;滑动窗口将长序列切分成“历史-未来”对,LSTM需要输入形状为(样本数, 时间步, 特征数)(本例中时间步=60,特征数=1,因为只用了收盘价)。 - 模型构建:LSTM层有64个神经元,足够学习复杂的时间依赖;输出层是全连接层,输出1个预测值。

- 训练与评估:用Adam优化器(自动调整学习率),MSE作为损失函数(适合连续值预测);训练20轮后,验证损失趋于稳定,说明模型收敛;预测结果反归一化后与真实值对比,MAE越小说明预测越准。

实际应用场景

1. 金融领域:股票/加密货币价格预测

- 挑战:金融数据噪声大(受新闻、政策影响),需结合多变量(成交量、市场情绪)。

- 解决方案:用多变量LSTM(输入包括价格、成交量等)或Transformer(捕捉全局市场趋势)。

2. 能源领域:电力负载预测

- 挑战:负载有强周期性(白天高、晚上低;工作日高、周末低),需处理长序列(如全年小时级数据)。

- 解决方案:用Temporal Fusion Transformer(TFT),同时处理静态特征(电厂类型)和动态特征(历史负载)。

3. 工业领域:设备故障预测

- 挑战:设备传感器数据维度高(温度、振动、电流等),需提前数天预测故障。

- 解决方案:用CNN-LSTM混合模型(CNN提取传感器特征,LSTM学习时间依赖)。

工具和资源推荐

工具库

- TensorFlow/PyTorch:通用深度学习框架,支持LSTM、Transformer等模型的灵活搭建。

- PyCaret:低代码时序预测库,内置ARIMA、LSTM、Prophet等模型,适合快速验证。

- Darts:Uber开源的时序预测库,支持多模型对比(如TFT、N-BEATS),兼容PyTorch。

经典论文

- 《Long Short-Term Memory》(LSTM原论文)

- 《Attention Is All You Need》(Transformer原论文)

- 《Temporal Fusion Transformers for Interpretable Multi-horizon Time Series Forecasting》(TFT模型)

学习资源

- 课程:Coursera《Sequence Models》(吴恩达深度学习专项课)

- 书籍:《Deep Learning for Time Series Forecasting》(Jason Brownlee著)

未来发展趋势与挑战

趋势1:多模态融合

未来模型可能结合文本(如新闻)、图像(如卫星云图)和时序数据(如温度),提升预测精度。例如,预测农产品价格时,同时考虑历史价格、天气图像和新闻事件。

趋势2:轻量级模型

随着边缘计算(如物联网设备)的普及,需要更小、更快的模型(如LSTM的轻量化版本、Transformer的稀疏注意力优化),在保持精度的同时降低计算成本。

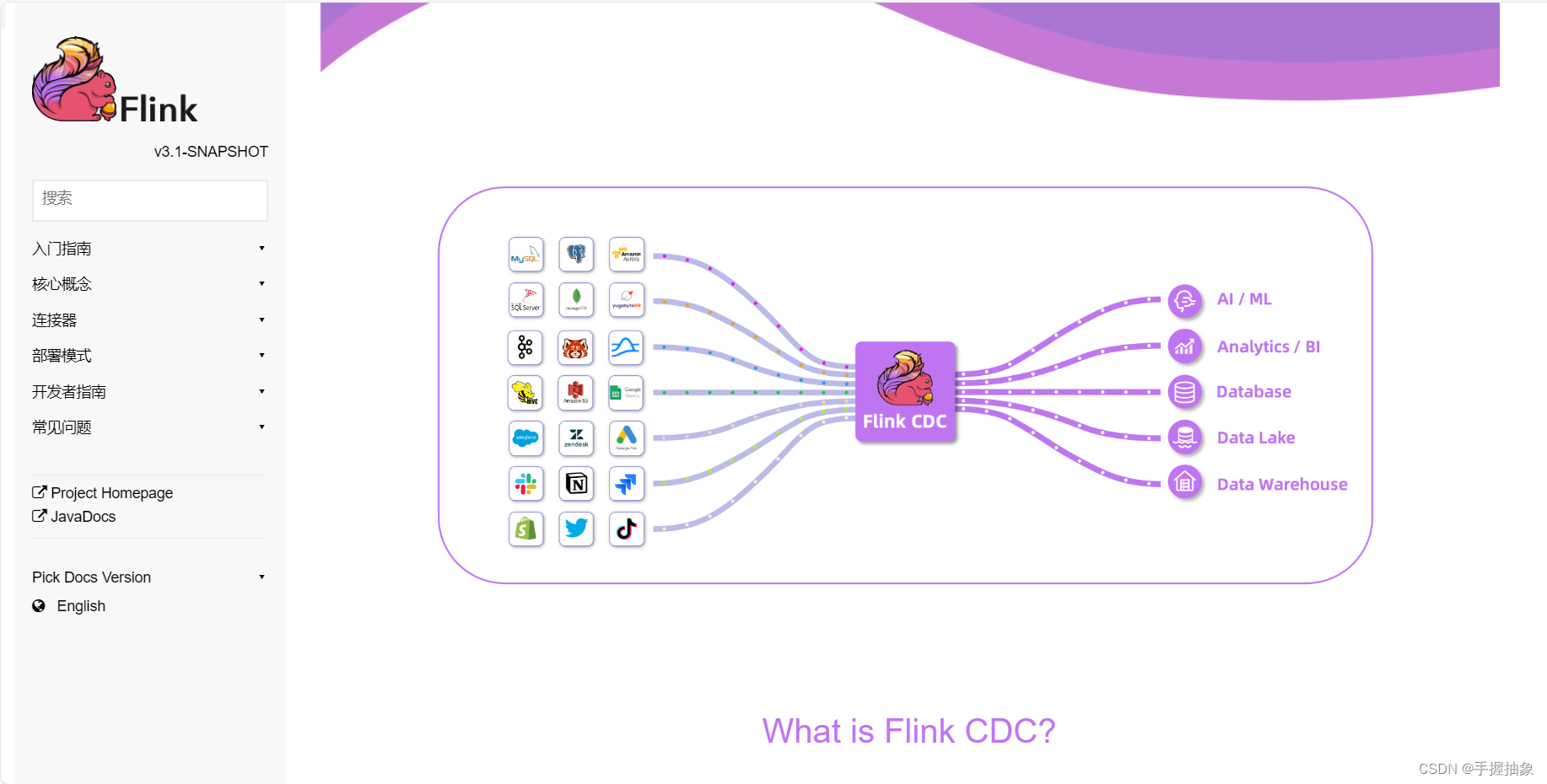

趋势3:实时预测

工业和金融场景需要毫秒级响应,未来模型可能结合流处理框架(如Flink),实现“数据实时流入-模型实时更新-结果实时输出”的闭环。

挑战1:数据噪声与缺失

真实数据常包含缺失值(如传感器故障)和噪声(如异常波动),如何高效清洗数据仍是关键问题。

挑战2:长序列依赖

尽管Transformer能处理长序列,但计算复杂度随序列长度呈平方增长(O(n2)O(n^2)O(n2)),如何优化注意力机制(如稀疏注意力、局部窗口注意力)是研究热点。

挑战3:可解释性

金融、医疗等场景需要“模型为什么这样预测”的解释(如“预测明天下跌是因为过去3天成交量骤降”),提升模型的可解释性是重要方向。

总结:学到了什么?

核心概念回顾

- 时序数据:按时间排列的序列,有时间依赖性、周期性、噪声三大特点。

- LSTM:带“记忆盒子”的循环神经网络,擅长捕捉短期和长期依赖。

- Transformer:用“注意力机制”划重点的模型,适合处理复杂长序列。

- 滑动窗口:将长序列切分成“历史-未来”对,作为模型输入。

概念关系回顾

- 时序数据的特点(如长期依赖)决定了模型选择(LSTM/Transformer);

- 滑动窗口是连接原始数据和模型输入的桥梁;

- 评估指标(MAE/MSE)用于衡量模型预测效果。

思考题:动动小脑筋

- 如果你要预测“未来7天的用电量”(多步预测),应该如何调整滑动窗口的输出部分?

- 假设你有一个包含“温度、湿度、风速”的多变量时序数据,如何修改LSTM模型的输入层?

- Transformer的自注意力机制为什么能处理长序列?它和LSTM的“顺序处理”有什么本质区别?

附录:常见问题与解答

Q:时序数据需要做平稳性检验吗?

A:传统方法(如ARIMA)要求数据平稳(均值和方差不随时间变化),但深度学习模型(如LSTM)对非平稳数据的容忍度更高,通常不需要严格平稳化。不过,归一化(缩放到0-1)仍是必要的,可提升模型收敛速度。

Q:如何选择窗口大小(如用30天还是60天作为输入)?

A:窗口大小需根据数据的周期性选择。例如,日数据的周期可能是7天(周)或30天(月),可尝试不同窗口大小(如30、60、90),选择验证集上效果最好的。

Q:模型过拟合了怎么办?

A:过拟合表现为训练损失低但验证损失高,可尝试:

- 增加正则化(如L2正则化、Dropout层);

- 减少模型复杂度(如减少LSTM神经元数量);

- 增加训练数据(如数据增强,对原始数据添加小噪声)。

扩展阅读 & 参考资料

- 《Deep Learning for Time Series Forecasting: Predict the Future with MLPs, CNNs, RNNs and Transformers》, Jason Brownlee

- 时序预测竞赛(Kaggle):https://www.kaggle.com/competitions

- TensorFlow时序预测教程:https://www.tensorflow.org/tutorials/structured_data/time_series