大数据介绍、列式存储、clickhouse hbase Hive 区别、flink、hdfs、Hadoop等介绍

资料推荐

b站收藏的视频

b站小白debug讲区别那个视频 这个很好!! 还没同步过来

https://www.cnblogs.com/ahu-lichang/p/7068406.html

HBASE教程 https://blog.csdn.net/qq_40374604/article/details/146604071

https://blog.csdn.net/qq_36643449/article/details/125469746

基础概念

为什么需要数据仓库

mysql等关系型只能几百g的数据 更大就难以维系了

什么是列式存储

表名: user_table

┌──────────┬───────────────────────────┬────────────────────┐

│ Row Key │ Column Family: info │ Column Family: add │

├──────────┼───────┬───────┬──────────┼─────────┬──────────┤

│ │ name │ age │ gender │ city │ country │

├──────────┼───────┼───────┼──────────┼─────────┼──────────┤

│ user1 │ Tom │ 25 │ male │ Beijing │ China │

│ user2 │ Jerry │ 30 │ female │ Shanghai│ China │

└──────────┴───────┴───────┴──────────┴─────────┴──────────┘

比如 对上面的表 列式样存储可能是这样存的

Key Value

user1:info:name Tom

user1:info:age 25

user1:info:gender male

user1:address:city Beijing

user1:address:country China

user2:info:name Jerry

user2:info:age 30

user2:info:gender female

user2:address:city Shanghai

user2:address:country China

和行不一样 为了读列中的数据 行型存储必须先把整行读出来 ,所以列式存储适合大数据

这种结构的优势:

可以轻松添加新的列,不影响现有数据

不同行可以有不同的列

按列族物理存储,适合针对特定列族的查询

支持数据多版本(每个Cell可以有多个时间戳的值)

对于缺失的列 不需要存储 省空间 比如互联网金融公司在开展业务时,风险评估至关重要。为准确评估用户风险,需整合多源数据,如用户的消费行为、还款记录、社交关系等。这些数据规模庞大且具有稀疏性,部分用户可能在某些维度上数据缺失。 HBase 的稀疏表设计能高效存储此类数据,仅存储实际产生的数据值,减少存储空间占用。在构建风险评估模型时,利用 HBase 的分布式计算能力,结合 Hadoop MapReduce 可对海量风险数据进行并行处理。例如,快速计算用户的信用评分、分析不同用户群体的风险特征等。通过高效处理这些数据,互联网金融公司能够更精准地评估风险,制定合理的信贷政策,降低违约风险,保障业务的稳健发展。

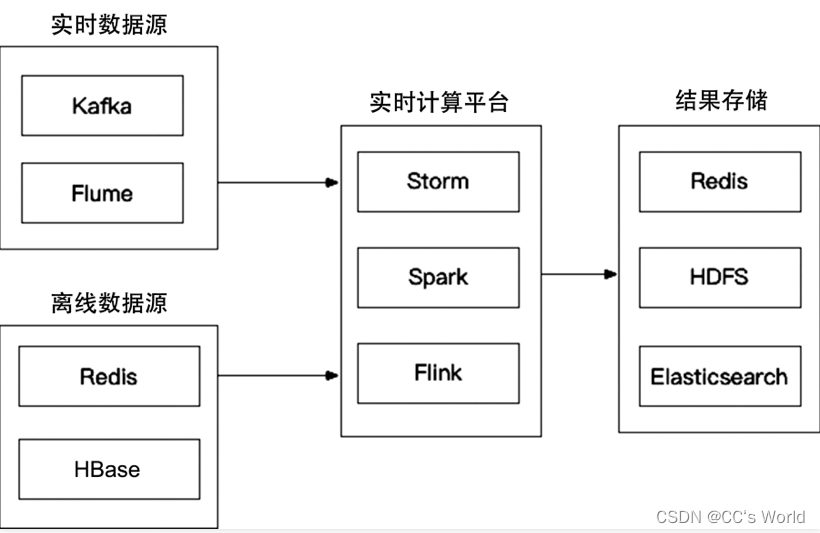

大数据架构

这个看小白debug那篇文章更好

- 数据来源 包括传感器数据、社交媒体数据、日志数据等各种结构化、半结构化和非结构化数据。例如,电商平台的用户购买行为记录(结构化数据)、用户在社交媒体上发布的文本和图片(半结构化和非结构化数据)。

- 数据存储:有分布式文件系统(如 Hadoop Distributed File System – HDFS)、NoSQL 数据库(如 MongoDB、Cassandra)等用于存储海量数据。

- 数据处理与分析:因为数据是分片存储的 你怎么分析呢 所以需要处理分析层 去聚合出来。

。涉及批处理框架(如 Hadoop MapReduce、Spark)、流处理框架(如 Flink)、机器学习库(如 Scikit – learn、Spark MLlib)等,用于从数据中提取有价值的信息。

数据展示与应用:包括数据可视化工具(如 Tableau、PowerBI),以及将数据分析结果应用于业务决策、智能推荐等领域。

软件介绍

Hadoop与hdfs 简介

Hadoop 是一个开源的分布式计算平台,主要由 HDFS 和 MapReduce 两部分组成。

- HDFS(Hadoop Distributed File System)

- 架构与原理:HDFS 采用主从(Master – Slave)架构,包括一个 NameNode(主节点)和多个 DataNode(从节点)。NameNode 管理文件系统的命名空间和文件块的映射信息,DataNode 负责存储实际的数据块。例如,当存储一个大文件时,文件会被分割成多个固定大小(如 128MB)的数据块,然后分散存储在不同的 DataNode 上。

- 数据冗余与容错:为了保证数据的可靠性,HDFS 采用数据冗余策略,每个数据块会在多个 DataNode 上进行备份(通常备份系数为 3)。当某个 DataNode 出现故障时,可以从其他备份节点获取数据,保证数据的可用性。

- MapReduce

- 编程模型:MapReduce 是一种用于大规模数据集并行处理的编程模型。它将数据处理任务分为两个阶段:Map 阶段和 Reduce 阶段。在 Map 阶段,对输入数据进行并行处理,将数据转换为键值对形式;在 Reduce 阶段,对具有相同键的值进行聚合操作。例如,在统计文档中单词出现次数的任务中,Map 阶段可以将文档中的每个单词映射为(单词,1)的键值对,Reduce 阶段则将相同单词的计数相加。

- 性能优化:MapReduce 的性能可以通过调整参数(如任务的并行度、数据块大小等)、使用数据压缩技术等来优化。例如,选择合适的压缩算法(如 Snappy、LZO)可以减少数据传输量,提高处理效率。

hdfs不适合实时性的数据分许查询

hadoop感觉被替换了 Doris或者clickhouse 或者spark+hdfs

Spark 内存流计算框架

(一)Spark 简介

Spark 是一个快速的通用分布式计算系统,它在性能和易用性方面对 Hadoop MapReduce 进行了改进,比mapreduce更快

核心组件

-

RDD(Resilient Distributed Dataset):RDD 是 Spark 的基本数据结构,它是一个只读的、分区的分布式数据集。RDD 具有容错性,可以通过血缘关系(Lineage)进行数据恢复。例如,通过对一个存储在 HDFS 上的文件创建 RDD,然后对 RDD 进行一系列的转换操作(如过滤、映射、聚合等),即使在某个节点出现故障时,Spark 也可以根据 RDD 的血缘关系重新计算丢失的数据。

-

Spark SQL:用于处理结构化数据,它支持 SQL 查询和 DataFrame API。DataFrame 是一种类似于关系型数据库表的数据结构,具有优化的查询执行计划。例如,通过 Spark SQL 可以将存储在 HDFS 或其他数据源中的结构化数据加载为 DataFrame,然后使用 SQL 语句进行查询和分析。

-

Spark Streaming:用于处理实时数据流,它将连续的数据流分割为小的时间片(Batch Interval),在每个时间片内采用类似批处理的方式进行处理。例如,对实时的网站访问日志进行分析,Spark Streaming 可以在每个时间片内统计访问量、用户行为等信息。

性能优势

- 内存计算:Spark 的一个重要特点是支持内存计算,相比 Hadoop MapReduce 的磁盘 I/O 密集型计算,Spark 在内存中进行数据处理可以大大提高计算速度。例如,在多次迭代的机器学习算法(如 K – Means 聚类)中,Spark 可以将中间结果存储在内存中,减少了数据的重复加载和计算时间。

Flink

如果需要实时流处理,可以学习 Flink,它在流计算和低延迟方面非常强大

Flink 是新一代的实时数据处理框架,具有以下特点

- 批流一体:支持批处理和流处理,统一了数据处理的 API 和运行时环境。

- 低延迟:支持真正意义上的实时数据处理,具有低延迟和高吞吐量的特点。

- 状态管理:提供高效的状态管理机制,支持事件时间处理和状态持久化。

- 容错机制:通过 Checkpoint 和 Savepoint 机制,保证数据处理的可靠性和一致性。

- Flink SQL:提供 SQL 接口,支持实时数据流的查询和分析,简化了开发复杂度。

hbase

hive的主要问题是很慢……可能查一个 好几分钟过去了,不适合实时推荐,比如用户买完东西马上给他推可能喜欢的

列存储数据库,适合大规模的随机读写操作

1)海量用户账户信息管理

互联网金融公司往往拥有庞大的用户群体,每个用户的账户信息涵盖基本资料、资产状况、信用评级等多维度数据。以一家拥有千万级用户的互联网金融平台为例,传统关系型数据库在存储如此海量且不断增长的用户信息时,可能面临性能瓶颈与存储成本剧增的问题。HBase 的分布式架构与列式存储模式则能有效应对。 在用户账户信息存储中,可将用户 ID 设为 RowKey,利用其唯一性确保数据快速定位。不同类型的账户信息,如个人身份信息设为一个列族,资产相关信息设为另一个列族。这种设计下,当需要查询用户的资产数据时,HBase 仅需读取资产列族的数据,避免读取整行数据带来的资源浪费,极大提升查询效率。同时,随着用户数量的持续增长,通过简单添加 RegionServer 即可轻松扩展存储容量,保障系统的稳定运行。

2) 高频交易记录存储与实时查询

互联网金融交易频繁,像股票交易、在线支付等业务场景,每秒可能产生数千甚至上万笔交易记录。这些交易数据不仅要准确、及时地存储,还需满足后续实时查询与分析的需求。HBase 的实时读写特性使其成为理想选择。 交易数据写入时,先快速存入 MemStore,实现毫秒级写入响应,确保交易数据的及时记录,不影响交易流程的顺畅进行。例如在股票高频交易场景中,交易数据能迅速落库,为投资者提供及时的交易反馈。当需要实时查询某笔交易详情时,依据交易 ID(作为 RowKey),HBase 能快速定位到对应 Region,从 MemStore 或 HFile 中读取数据并返回,满足投资者对交易信息的即时查询需求。并且,在面对海量交易数据时,HBase 的分布式存储可轻松应对,保证数据存储与查询性能不受影响。

3)风险管理系统数据

互联网金融公司在开展业务时,风险评估至关重要。为准确评估用户风险,需整合多源数据,如用户的消费行为、还款记录、社交关系等。这些数据规模庞大且具有稀疏性,部分用户可能在某些维度上数据缺失。 HBase 的稀疏表设计能高效存储此类数据,仅存储实际产生的数据值,减少存储空间占用。在构建风险评估模型时,利用 HBase 的分布式计算能力,结合 Hadoop MapReduce 可对海量风险数据进行并行处理。例如,快速计算用户的信用评分、分析不同用户群体的风险特征等。通过高效处理这些数据,互联网金融公司能够更精准地评估风险,制定合理的信贷政策,降低违约风险,保障业务的稳健发展。

4)反欺诈数据存储与分析

防范欺诈是互联网金融的重要任务。欺诈行为往往具有隐蔽性,需要对大量历史交易数据、用户行为数据进行深度分析,挖掘潜在的欺诈模式。 HBase 可将历史交易数据按时间序列存储,以交易时间结合交易 ID 作为 RowKey,方便按时间维度查询与分析。在反欺诈数据挖掘过程中,通过扫描 HBase 表,结合复杂算法识别异常交易行为,如短期内大量资金异常转移、异地登录频繁交易等。其分布式架构能支持大规模数据的并行分析,大大缩短分析时间,快速发现欺诈线索,及时采取措施防范欺诈行为,保护用户资金安全与公司利益。

Hive

Hive是基于 Hadoop 的数据仓库工具,支持使用 SQL语法去 查询,适合批处理数据分析任务。因为分布式场景下 需要去对每个节点分查聚合的

hive的主要问题是很慢……可能查一个 好几分钟过去了,不适合实时推荐,比如用户买完东西马上给他推可能喜欢的

对推荐系统而言,Hive 仅适合 “离线归档”(如存储半年前的历史行为日志)或 “离线预处理”(如用 Spark 批量处理行为数据生成训练样本),绝对不能用于实时推荐、用户近期行为查询等需要低延迟的场景。

Hive本质上是一个元数据管理平台,通过对存储于HDFS上的数据文件附加元数据,赋予HDFS上的文件以数据库表的语义。并对外提供统一的Hive SQL接口,将用户提交的SQL翻译为对应的MapReduce程序或Hive程序,交给相应的计算引擎执行。

Hive是一个构建在Hadoop上的数据仓库工具(框架),它可以将结构化的数据文件映射成一张数据表,并允许用户使用类似SQL的查询语言(HiveQL)来对这些数据文件进行读、写和管理。Hive的主要目标是为那些熟悉SQL但不熟悉Java编程的数据分析师和科学家提供一个简单的数据访问和处理工具。Hive特别适用于大规模数据处理和分析的场景,如数据仓库、数据挖掘、商业智能等。

原理:

Hive的执行引擎可以是MapReduce、Spark或Tez等。当用户提交一个HiveQL查询时,Hive会首先将该查询编译成一个或多个MapReduce任务(或其他类型的任务),然后将这些任务提交给Hadoop集群进行执行。Hive将查询结果存储在HDFS中,用户可以通过Hive或Hadoop的其他工具来访问这些数据。

Hive的数据存储在HDFS中,但Hive本身并不直接存储数据,而是将数据的元数据(如表名、表结构、分区信息等)存储在关系型数据库中(如MySQL、Derby等)。Hive通过元数据来管理数据表和数据分区,使得用户能够方便地对数据进行查询和分析。

由于MapReduce计算模型本身的缺陷,因此目前一般情况下会将Hive结合Spark使用,hive on spark

clickhouse

似乎和es更像 主要用于日志查询 分析?

微信目前使用Clickhouse来存储日志数据,因为日志通常包含大量重复项。使用Clickhouse可以实现高压缩比,减少日志占用的存储空间。

哈咯单车、携程 从clickhouse改用starrocks

在携程庞大的数据体系中,UBT(User Behavior Tracking,用户行为追踪系统)承担着核心的用户行为采集与分析任务,日新增数据量高达 30 TB。为应对不断增长的业务与性能需求,携程技术团队将 UBT 从 ClickHouse 迁移至 StarRocks 存算分离架构。迁移后,系统实现了查询性能从秒级到毫秒级的跨越——平均查询耗时由 1.4 秒降至 203 毫秒,P95 延迟仅 800 毫秒;同时,存储量减少一半,节点数由 50 个降至 40 个。

clickhouse缺点好像是存和计算不分离 ?

1)海量数据分析场景,如互联网公司用户行为分析案例

在互联网公司中,每天都会产生海量的用户行为数据,如用户的点击、浏览、购买等行为记录。以某大型电商平台为例,每天的用户行为数据量可达数十亿条。ClickHouse 凭借其高性能和分布式处理能力,能够高效地对这些数据进行分析。通过对用户行为数据的分析,互联网公司可以了解用户的兴趣偏好、购买习惯等,从而为用户精准推荐商品、优化网站页面布局。 在实际应用中,该电商平台利用 ClickHouse 构建用户行为分析系统,将用户行为数据实时写入 ClickHouse 集群。当需要分析用户在过去一周内浏览但未购买的商品信息时,ClickHouse 能够在秒级内完成对数十亿条数据的查询和分析,为市场运营团队提供及时、准确的数据支持,助力其制定营销策略,提升业务转化率。

2)复杂查询与高并发查询场景,如电商平台报表生成案例

电商平台需要生成各种复杂的报表,如不同地区、不同时间段、不同商品类别的销售报表,这些报表涉及多表关联、聚合计算等复杂查询操作。同时,在业务高峰期,可能会有大量用户同时请求报表数据,对查询并发性能要求极高。 ClickHouse 能够很好地应对这种复杂查询与高并发查询场景。例如,在生成月度销售报表时,报表需要关联用户表、订单表、商品表等多张表,并进行按地区、按商品类别等多层次的聚合计算。ClickHouse 的分布式架构和向量化执行引擎能够并行处理这些复杂查询任务,快速生成报表数据。在高并发场景下,ClickHouse 通过合理的资源调度和优化的查询缓存机制,能够同时处理大量用户的查询请求,保证响应时间在可接受范围内,为电商平台的运营决策提供及时的数据支持,保障业务的稳定运行。

用户行为分析,精细化运营分析:日活、留存率分析、路径分析、有序漏斗转化率分析、Session分析等。实时日志分析,监控分析,实时数仓。

oris 介绍

在大数据分析的工具阵营中,Doris 正逐渐崭露头角,成为不可忽视的一款数据库产品。它为处理海量数据、满足多样化数据分析需求,提供了一套高效且易用的解决方案。

4.1 开源项目背景

Doris 源自百度,于 2017 年开源。当时,随着大数据时代的全面来临,企业面临着海量数据的存储与分析难题。传统数据库在应对大规模数据的实时查询、复杂分析等场景时,显得力不从心。百度凭借在搜索引擎、信息流等业务中积累的深厚技术实力和大规模数据处理经验,开发出 Doris 这一高性能分析型数据库,并将其开源,希望能为大数据领域贡献一份力量,推动行业的整体发展。 开源之后,Doris 迅速吸引了众多开发者的关注。来自不同行业的技术人员纷纷参与到项目中来,他们积极贡献代码、分享使用经验,不断完善 Doris 的功能,优化其性能。如今,Doris 已经形成了一个活跃的开源社区,社区成员们共同努力,让 Doris 在功能丰富度、性能稳定性等方面都得到了极大提升,应用范围也从最初的百度内部业务,扩展到互联网、金融、电信等多个行业,帮助企业高效地处理和分析海量数据。

hbase和clickhouse和hive区别

一句话 未完成

HBase 和clickhouse两者在一条数据管道里常常互补:HBase 负责实时写/点查,ClickHouse 负责后续批量分析。

纯存储:HBase(存海量数据,支持随机读写);

纯分析(需依赖外部存储):Hive(离线批处理分析);

推荐系统中如何使用

推荐系统选型实操建议

优先用 ClickHouse 的场景(覆盖 80% 推荐系统行为数据需求):

存储高频行为日志(点击、曝光、浏览、停留时长),支持按用户 ID、时间分区,毫秒级查询用户近期行为;

实时计算用户行为指标(如近 1 小时点击量、偏好标签),支撑实时推荐引擎;

优点:无需复杂架构,单引擎搞定存储 + 分析,运维成本低;缺点:不支持事务,随机写性能一般(需批量写入优化)。

补充 HBase 的场景:

需随机读写的核心行为数据(如用户收藏列表、历史订单、实时召回的候选集缓存);

要求数据高可用、低延迟查询(如推荐结果页快速查询用户是否已点击过该商品);

优点:分布式架构,支持海量数据随机读写,容错性强;缺点:不适合复杂聚合分析,需配合 Phoenix 实现 SQL 查询。

慎用 Hive 的场景:

仅用于离线行为数据归档(如超过 3 个月的历史日志)、离线推荐模型训练的数据预处理(如用 Spark 处理 Hive 中的行为数据,生成训练样本);

缺点:实时性差,无法支撑在线推荐场景,需依赖 Hadoop 生态,运维成本高。

三、推荐系统架构示例(组合使用方案)

数据流入:用户行为日志(点击 / 曝光)通过 Kafka 采集,批量写入 ClickHouse(用于实时分析),同时同步至 HBase(用于随机查询);

在线推荐:实时推荐引擎从 ClickHouse 读取用户近期行为,计算实时偏好;从 HBase 读取用户长期行为(如收藏),结合召回模型生成推荐结果;

离线训练:定期将 ClickHouse 中的行为数据同步至 Hive 归档,用 Spark 处理 Hive 数据,生成离线推荐模型的训练样本。

hive是实时性很差么?

是的,Hive 实时性极差,完全不适合在线实时场景—— 核心原因是它本质是 “离线数据仓库”,依赖 MapReduce/Spark 批处理引擎,查询需经过任务调度、资源分配、数据分片计算等流程,单次查询延迟通常在 分钟级(简单查询可能秒级,但不稳定),无法支撑推荐系统的实时行为数据读写需求。

具体来说,Hive 的 “慢” 源于两点:

架构设计:Hive 本身不存储数据(数据存在 HDFS),也不执行计算,仅负责解析 SQL 并生成批处理任务,调度和执行耗时久;

数据存储:HDFS 适合批量读写大文件,不支持随机读写,小批量实时数据写入时,会产生大量小文件,导致后续查询性能更差。

对推荐系统而言,Hive 仅适合 “离线归档”(如存储半年前的历史行为日志)或 “离线预处理”(如用 Spark 批量处理行为数据生成训练样本),绝对不能用于实时推荐、用户近期行为查询等需要低延迟的场景。

乱七八糟

clickhouse hbase Hive 区别

核心区别(精准对比)

特性 ClickHouse HBase Hive

核心定位 列式存储 OLAP 分析引擎 列族式 NoSQL 数据库(OLTP + 轻 OLAP) 数据仓库工具(基于 Hadoop 的 SQL 接口)

存储模型 列式存储,优化聚合查询 列族存储,支持稀疏数据 依赖 HDFS 存储,支持结构化 / 半结构化数据

查询场景 高并发、低延迟的复杂统计分析(如报表、实时查询) 随机读写、海量数据实时存取(如日志、时序数据) 离线批处理分析(如 ETL、大数据报表)

查询语言 类 SQL(支持大部分 SQL 语法) 原生 Java API,支持 Phoenix SQL Hive SQL(类 SQL,兼容 HQL)

性能特点 聚合查询速度极快(亿级数据秒级返回) 随机读写性能优,批量分析弱 批处理性能强,实时查询差

适用数据量 TB-PB 级 PB 级以上 PB 级以上

关键亮点提炼

ClickHouse:专为 OLAP 设计,列式存储 + 向量计算,适合实时统计分析(如用户行为报表、监控数据查询),不支持高并发写。

HBase:面向列族的分布式数据库,支持行级随机读写,适合存储海量非结构化 / 半结构化数据(如物联网传感器数据、日志明细),查询需依赖 RowKey 优化。

Hive:不是数据库,是 Hadoop 的数据仓库解决方案,通过 SQL 解析成 MapReduce/Tez 任务,适合离线批处理(如数据清洗、月度数据汇总),延迟高。

追问

需要我结合 Golang 场景,提供ClickHouse/HBase/Hive 的 Go 语言客户端选型和连接示例代码吗?

我现在要做个推荐系统,需要先存储用户数据,应该用什么呢

推荐系统的用户数据存储,核心看 数据特性(结构化 / 非结构化)、访问模式(读写频率、查询维度)、扩展性需求,结合推荐系统常见场景(用户画像、行为记录、实时推荐),优先推荐以下方案,附选型逻辑和落地建议:

一、优先选型:MySQL + Redis (最通用、低成本落地)

适用场景:

用户数据以 结构化信息 为主(如用户 ID、年龄、性别、偏好标签、注册信息),需要支持多维度查询(如按年龄段筛选用户)、高可靠存储,且有实时访问需求(如推荐时快速获取用户偏好)。

方案拆解:

MySQL(主存储):

存储核心结构化数据:用户基础信息(id, name, age, gender)、长期偏好(如喜欢的品类 ID 列表、评分记录)、用户状态(是否活跃)。

优势:支持 SQL 多维度查询(如 where age between 20 and 30 and gender = ‘male’),事务支持(避免数据不一致),生态成熟(Go 语言适配性好,GORM/xFramwork 直接对接)。

优化点:用 分库分表 应对海量用户(按用户 ID 哈希分片),对高频查询字段(如用户 ID、偏好标签)建索引。

Redis(缓存层):

缓存高频访问数据:用户实时行为(最近点击 / 浏览的商品 ID)、短期偏好(如会话内兴趣)、推荐结果缓存(避免重复计算)。

优势:毫秒级响应,支持多种数据结构(Hash 存储用户属性、List 存储行为序列、Sorted Set 存储偏好权重),适合实时推荐场景。

示例(Go + Redis 存储用户行为):

go

运行

import (

“github.com/redis/go-redis/v9”

“context”

“time”

)

func saveUserBehavior(ctx context.Context, rdb *redis.Client, userID string, itemID string) error {

// 存储用户最近100条浏览记录(List结构,左进右出)

return rdb.LPush(ctx, “user:behavior:”+userID, itemID).Err()

}

func getUserRecentBehavior(ctx context.Context, rdb redis.Client, userID string) ([]string, error) {

// 获取最近10条浏览记录

return rdb.LRange(ctx, “user:behavior:”+userID, 0, 9).Result()

}

适配推荐系统:

适合 协同过滤、基于内容的推荐:MySQL 可查询用户偏好相似的群体,Redis 快速获取用户实时行为用于实时推荐。

二、进阶选型:HBase + ClickHouse (海量数据 + 复杂分析)

适用场景:

用户数据包含 海量非结构化 / 半结构化信息(如用户行为日志、埋点数据、长文本偏好描述),需要支持 PB 级存储、高并发写入(如每秒万级用户行为上报),且需复杂统计分析(如用户行为序列挖掘、偏好趋势分析)。

方案拆解:

HBase(主存储):

存储海量用户行为明细:用户 ID(RowKey)、行为类型(列族 1:click/view/buy)、行为时间戳(列族 2:timestamp)、商品属性(列族 3:item_info)。

优势:列族存储适合稀疏数据(不同用户行为维度不同),支持高并发写入(每秒 10 万 +),PB 级扩展能力,通过 RowKey(用户 ID + 时间戳)快速查询用户行为序列。

Go 客户端:用 github.com/apache/hbase-client-go,适合写入海量行为数据。

ClickHouse(分析层):

同步 HBase 数据,用于用户画像分析:如计算用户近 7 天偏好品类、行为频次统计、用户活跃度分层。

优势:列式存储 + 向量计算,亿级数据统计秒级返回,支持类 SQL 查询(如 select item_category, count() from user_behavior where user_id = ‘xxx’ group by item_category)。

Go 客户端:用 github.com/ClickHouse/clickhouse-go/v2,适合推荐系统的离线画像计算。

适配推荐系统:

适合 深度学习推荐、大规模个性化推荐:HBase 存储完整行为序列,ClickHouse 快速生成特征,供模型训练和推理。

三、特殊场景选型:MongoDB (非结构化用户数据)

适用场景:

用户数据以 非结构化 / 半结构化 为主(如用户个人简介、兴趣标签集合、社交关系链),需要灵活的 schema(无需固定字段),支持复杂的嵌套查询(如查询 “喜欢登山且关注户外装备” 的用户)。

优势:

文档型存储,支持 JSON 格式数据,字段可动态扩展(如用户新增兴趣标签无需修改表结构)。

支持嵌套查询和数组操作(如 db.users.find({“interests”: “hiking”, “followees”: “outdoor_brand”}))。

Go 客户端:用 go.mongodb.org/mongo-driver/mongo,适合存储用户个性化的非结构化信息。

选型决策树(快速判断)

数据是否结构化?→ 是 → 选 MySQL + Redis;

数据量是否超 10 亿条(行为数据)?→ 是 → 选 HBase + ClickHouse;

数据是否非结构化(如长文本、动态标签)?→ 是 → 选 MongoDB;

是否需要实时推荐(毫秒级响应)?→ 是 → 必须加 Redis 缓存;

是否需要离线用户画像分析?→ 是 → 加 ClickHouse 或 Hive(批量处理)。

追问

需要我针对你的推荐系统场景,提供 具体存储方案的表结构设计(如 MySQL 用户表、Redis 缓存 key 设计)和 Go 语言完整操作代码 吗?

hbase 和hive是数据存储工具,而clickhouse是分析工具对么

这个理解不完全准确,核心纠正:Hive 并非 “数据存储工具”,而是基于 Hadoop 的数据仓库分析工具,三者的本质定位差异如下:

精准定位拆解

HBase:纯 分布式存储工具(NoSQL 数据库)

核心功能是 “存储”:直接存储海量结构化 / 半结构化数据(如用户行为明细、传感器数据),支持高并发写入和随机读写,不负责数据计算分析(需依赖 Phoenix 或外部引擎做查询)。

Hive:数据仓库分析工具(非存储)

核心功能是 “分析”:本身不存储数据,依赖 HDFS 或 HBase 存储数据,提供 SQL 接口将查询转换为 MapReduce/Tez 任务,实现离线批处理分析(如用户画像汇总、行为统计)。

ClickHouse:存储 + 分析一体化工具(OLAP 引擎)

既包含列式存储引擎(负责数据持久化),又内置分析计算能力(向量计算、聚合优化),无需依赖外部存储,直接完成 “数据存储 + 复杂统计分析”(如亿级用户行为秒级聚合)。

一句话总结

纯存储:HBase(存海量数据,支持随机读写);

纯分析(需依赖外部存储):Hive(离线批处理分析);

存储 + 分析:ClickHouse(OLAP 一体化,实时分析优先)。

追问

需要我结合推荐系统的 用户行为数据存储 + 分析场景,提供 HBase/ClickHouse 的 数据模型设计(如 RowKey / 表结构) 和 Go 语言操作示例吗?

你说clickhouse包含了存储,为什么你之前给我的案例又包含了hbase存储呢

核心原因:场景适配性选择——ClickHouse 虽自带存储,但在「海量用户行为明细存储 + 实时高并发写入」场景下,HBase 的存储特性更优,二者是「存储 + 分析」的互补组合,而非替代关系。

具体逻辑拆解(结合推荐系统场景)

ClickHouse 的存储局限:

它的存储是为「OLAP 分析」设计的(列式存储、分区表),适合存储「需高频统计的数据」(如用户行为聚合结果、用户画像标签),但不擅长高并发写入和随机读写:

推荐系统中,用户行为(点击、浏览、下单)是「秒级万级 +」的高并发写入场景,ClickHouse 的写入性能(单表每秒万级)无法满足,且频繁写入会导致分区合并压力,影响查询性能;

若直接用 ClickHouse 存储原始行为明细,查询单用户的行为序列(如 “用户 A 最近 10 次浏览”)需要扫描整个分区,效率远低于 HBase 的 RowKey 精准定位。

HBase 的存储优势:

专为「海量原始数据存储 + 高并发写入 + 随机读写」设计:

支持每秒 10 万 + 的行为数据写入(无性能压力),RowKey(用户 ID + 时间戳)可快速定位单用户的行为序列,适合存储「原始行为明细」(如用户 ID、商品 ID、行为类型、时间戳);

列族存储支持稀疏数据(不同用户的行为维度不同,无需固定字段),扩展性极强(PB 级数据无缝扩容)。

组合逻辑(推荐系统常用架构):

「HBase 存储原始行为明细」→ 「同步到 ClickHouse 做分析」:

HBase:承接高并发行为写入,存储全量原始数据(供追溯、行为序列查询);

通过 Flink/Spark 将 HBase 的行为数据同步到 ClickHouse(按用户 ID + 日期分区);

ClickHouse:快速计算用户画像(如近 7 天偏好品类、行为频次)、商品热度统计,为推荐模型提供特征数据。

一句话总结

单独用 ClickHouse:适合「分析数据量不大、写入并发低」的轻量推荐场景(如小型 APP、内部推荐系统);

组合 HBase+ClickHouse:适合「海量用户 + 高并发行为写入 + 复杂分析」的规模化推荐场景(如电商、短视频平台),兼顾存储性能和分析效率。

hive和hbase区别

下面把“推荐系统里存用户行为日志”这个具体场景拆开,告诉你 Hive 和 HBase 在每一步到底差在哪、怎么选、怎么配合。

一、数据长什么样

用户行为 = {user_id, item_id, action(click/buy…), ts, 可选埋点字段}

业务要求:

实时侧:线上服务要“刚发生的行为”立刻能被召回、去重、统计。

离线侧:算法同学每天/每小时要把全量行为拼成样本,做特征工程、模型训练。

二、HBase 视角(实时行存)

写入

– 客户端直接把一条行为 put 进来,行键设计:

user_id#reverse_ts 或 item_id#reverse_ts,保证最新行为在 RowKey 前端,扫描最快。

– 支持单行级去重、幂等、TTL(自动过期老行为)。

– 并发 1w~10w+ TPS 级别,毫秒级可见。

线上读取

– 推荐 API 节点随时按 user_id 拉最近 50 条行为做“实时兴趣标签”。

– 也能按 item_id 拉最近 1000 次点击,做“实时热度”二次排序。

– 延迟 P99 < 50 ms。

限制

– 只擅长“键-值”或“键-范围”点查;想跑“昨天全站点击次数”这种聚合,要全表扫,慢且占资源。

– 不支持复杂 SQL,多维度分析要写代码或接 Phoenix/Spark on HBase。

三、Hive 视角(离线列存)

写入

– 行为先写 Kafka → Flume/Flink → 落到 HDFS 成原始日志文件(通常按小时分区)。

– 然后定时 LOAD DATA 或 Flink Hive Sink 把文件登记到 Hive 表(外表)。

– 不是“实时可见”,一般到分区就绪要 5~15 分钟延迟(可调成近实时,但本质仍是“文件级”)。

离线计算

– 一条 SQL 就能 group by user_id, item_id 统计过去 30 天曝光、点击、下单,生成训练样本。

– 可以与维度表(用户画像、商品属性)做大规模 Join,跑在 Spark/Hive on Tez,几百亿行也能横向扩展。

– 结果写回 HDFS、MySQL、Redis、Kafka,供线上服务使用。

限制

– 不支持单行更新;如果日志里发现一条脏数据,只能重写整个分区。

– 毫秒级点查不可行,延迟是分钟到小时级。

四、在推荐系统里的标准打法

实时层(HBase)

– 线上服务直接读写,提供“用户最近行为”、“实时统计”接口。

– 保留最近 7~30 天,TTL 自动清掉老数据,控制容量。

离线层(Hive)

– 全量行为长期归档(可存几年),用来做特征回溯、模型训练、A/B 指标对账。

– 通过 Flink/Spark 流式任务,把 Kafka 里的行为同时写 HBase(实时)和 Hive(离线),一份数据两条链路。

冷热接口

– 线上推荐服务优先读 HBase(热数据);如果行数不够,再回退到 Hive 预计算好的“用户长期兴趣”特征(已导进 Redis/MySQL)。

五、一句话总结

HBase 让你“刚点完就能读到”,Hive 让你“今晚跑模型能用到”;推荐系统两条链路都要,先双写,再各取所长。

推荐系统中如何……

线上召回

上召回”就是推荐系统里“实时找出候选商品”这一步。

用户刷新 / 打开 App → 服务端在几十毫秒内必须给出一批商品 ID(几十到几百个)。

这一步叫“召回”(Recall),只追求快 + 别漏掉用户可能喜欢的东西,不精细排序。

所以叫“线上”——请求当场、同步完成;与离线批任务、小时级模型训练无关。

举例:

用 HBase 把“用户最近点的 50 个商品”瞬间捞出来 → 查出相似商品 → 作为候选返回。

或者查“实时热度表”把最近 5 分钟点击最多的商品拉出来 → 也作为候选。

这些“当场捞数据”的动作就是线上召回。

这些东西还可以用去做推荐把?用推荐算法

hdfs适合存那些 历史数据 用于训练的 但是它缺点是慢……所以不能实时去推荐

实践

大厂推荐系统的数据存储核心是 分层存储 + 场景化选型,Hive、ClickHouse、HBase 各司其职,配合其他组件形成完整链路,以下是具体落地方案(含原理 + 大厂实践细节):

一、三大组件核心定位与大厂用法

- Hive:离线数据仓库(“数据底座”)

核心场景:离线特征计算、用户行为归档、推荐模型训练数据存储。

大厂实践:

存储用户全量行为数据(点击、曝光、收藏等)、物品元数据(商品信息、内容标签)、离线特征结果(如用户偏好向量、物品相似度矩阵)。

配合 Spark/Flink 做批量计算,比如 T+1 生成用户长期兴趣特征(如近 30 天品类偏好),数据按天 / 小时分区(partition),支持 SQL 化查询。

优化点:采用 ORC/Parquet 列式存储压缩(压缩比达 10:1),大表分桶(Bucket)提升 Join 效率,部分大厂会用 Hive Metastore 统一管理元数据,对接 Doris/Impala 做快速查询。 - ClickHouse:实时分析 + 近线特征存储(“实时计算引擎”)

核心场景:实时特征计算、推荐效果监控、近线用户行为查询(如近 1 小时点击)。

大厂实践:

存储实时行为数据流(通过 Kafka 导入),支持毫秒级聚合查询,比如实时计算用户近 5 分钟点击热度、物品实时曝光量。

作为推荐系统的 “实时特征库”,供在线推荐服务查询用户短期兴趣特征(如最近浏览的 3 个商品),采用 MergeTree 引擎,按用户 ID 分区,主键排序加速查询。

典型架构:Kafka → Flink CDC → ClickHouse,配合 Redis 做热点特征缓存,兼顾实时性和高并发。 - HBase:在线高并发数据存储(“在线查询引擎”)

核心场景:在线推荐服务的高并发特征查询、用户 / 物品画像存储、推荐结果缓存。

大厂实践:

存储用户实时画像(如当前兴趣标签、实时行为序列)、物品核心特征(如价格、库存、实时评分),支持百万级 QPS 随机读写。

表设计优化:行键(RowKey)用 “用户 ID + 物品 ID” 或 “用户 ID” 拼接,列族(Column Family)按特征类型拆分(如行为列族、属性列族),TTL 过期自动清理老数据。

配合预分区(Pre-Splitting)和布隆过滤器(Bloom Filter)提升查询效率,部分大厂会用 HBase + Phoenix 支持 SQL 查询,降低开发成本。

二、大厂推荐系统存储架构全景图

plaintext

数据来源(用户行为、物品元数据、第三方数据)

├─ 离线链路:Kafka → Flume → HDFS → Hive(离线特征计算/模型训练)

├─ 实时链路:Kafka → Flink → ClickHouse(实时特征/监控)+ HBase(在线查询)

└─ 在线服务:推荐引擎 → Redis(热点缓存)→ HBase/ClickHouse(特征查询)→ 推荐结果返回

三、关键选型对比(大厂决策依据)

组件 核心优势 短板 大厂典型应用场景

Hive 大容量、低成本、支持批量计算 实时性差(T+1) 离线特征存储、模型训练数据

ClickHouse 实时性强、聚合查询快 高并发写性能一般 实时特征、效果监控

HBase 高并发读写、低延迟 复杂查询能力弱 在线特征查询、用户画像存储

结尾追问

需要我针对 GoFrame 框架集成 ClickHouse/HBase 的具体代码示例(如实时特征查询接口、数据写入逻辑),或者 MySQL 与这三大组件的同步方案 做详细拆解吗?

也就是hive主要用于历史大数据的存储,用于训练模型

而clickhouse+hbase用于快速构建用户画像,然后应用推荐算法,给用户推荐么

你的理解方向完全正确,核心逻辑可以精准概括为:Hive 支撑 “模型训练”,ClickHouse+HBase 支撑 “在线推荐”,但有两个关键细节可以进一步明确,让落地逻辑更清晰:

Hive 的核心作用:不只是 “历史数据存储”,更核心是作为 离线特征工程和模型训练的 “数据底座” —— 大厂会基于 Hive 中的全量历史数据(比如用户 1 年的行为、物品全量元数据),通过 Spark 计算出离线特征(如用户长期兴趣向量、物品相似度矩阵),再用这些数据训练推荐模型(如协同过滤、深度学习模型),最终将训练好的模型参数部署到在线推荐引擎。

ClickHouse+HBase 的分工:二者是 “互补配合” 而非简单协同:

ClickHouse 侧重 实时特征计算 + 近线查询(比如用户近 1 小时点击、物品实时热度),给在线推荐提供 “短期兴趣” 数据;

HBase 侧重 高并发在线查询(比如用户长期画像、物品核心属性),支撑推荐服务百万级 QPS 访问,二者共同为推荐算法提供 “实时 + 长期” 的特征输入,再由推荐引擎(如基于协同过滤、深度学习的排序模型)生成最终推荐结果。

简单说:Hive 负责 “练模型”,ClickHouse+HBase 负责 “用模型实时推”,再配合 Redis 缓存热点特征,就是大厂推荐系统的核心存储链路。

需要我给你梳理 Go 语言对接这三大组件的推荐库选型,或者 一个简化版推荐系统的存储分层代码框架 吗?

clickhouse和hbase本身也支持大量数据存储,为什么还要用hive

核心原因:三者的设计目标、优化方向完全不同,ClickHouse/HBase 无法替代 Hive 的 “离线批量计算 + 低成本海量归档” 核心能力,具体拆解如下(结合大厂实践逻辑):

- 核心定位差异:“计算引擎” vs“存储 + 计算底座”

ClickHouse:本质是 “实时分析型数据库”,优化方向是 快速聚合查询、实时计算,而非 “低成本海量存储”—— 它的存储成本比 Hive(基于 HDFS)高 3-5 倍,且不适合存储 PB 级冷数据(如用户 1 年以上的历史行为),长期存储会导致查询性能下降、运维成本飙升。

HBase:是 “在线高并发 KV 数据库”,优化方向是 低延迟随机读写,但完全不支持复杂批量计算(如 JOIN、GROUP BY、窗口函数)—— 你无法用 HBase 直接计算 “用户近 30 天的品类偏好”“物品相似度矩阵” 这类核心离线特征。

Hive:基于 HDFS 构建,核心是 “低成本海量存储 + SQL 化批量计算” —— 支持 PB 级数据归档(存储成本仅为 ClickHouse 的 1/5),且能无缝对接 Spark/Flink 等分布式计算引擎,完成复杂的离线特征工程(如多表 JOIN、特征归一化、标签生成),这是 ClickHouse/HBase 天生不具备的。 - 推荐系统的 “离线核心需求” 只能靠 Hive 满足

大厂推荐系统的模型训练、特征更新,依赖两大核心离线场景,这两点 ClickHouse/HBase 无法高效支撑:

场景 1:全量历史数据的特征计算:训练深度学习模型(如 DeepFM、Transformer)需要用户 1-3 年的全量行为数据(点击、曝光、收藏),这类数据量通常是 PB 级,且需要做复杂的 JOIN(如用户行为表 + 物品元数据表 + 用户画像表)、GROUP BY(如按用户 ID 分组统计偏好)—— Hive 配合 Spark 能分布式并行处理,而 ClickHouse 处理这类场景会因 “单表设计 + 高存储成本” 崩溃,HBase 则完全不支持这类计算。

场景 2:冷数据归档与回溯分析:推荐系统需要留存全量历史数据用于 “模型迭代回溯”(如分析 3 个月前的推荐效果问题)、“合规审计”(如用户行为追溯)—— Hive 基于 HDFS 支持数据压缩(ORC/Parquet 压缩比 10:1)、分层存储(热数据存 SSD,冷数据存机械盘),成本极低;而 ClickHouse/HBase 存储冷数据会占用大量资源,且查询冷数据时性能极差。 - 大厂实践的 “分工逻辑”:各司其职,而非替代

用一个通俗的类比理解:

Hive = 大厂的 “中央仓库”:存放所有原材料(全量历史数据),并支持批量加工(离线特征计算),供 “工厂(模型训练)” 生产核心产品(推荐模型);

ClickHouse = “实时加工车间”:处理最新原材料(近 1 小时 / 1 天的实时数据),快速产出半成品(实时特征);

HBase = “成品货架”:存放随时要取用的成品(在线特征、用户画像),支持快速拿取(低延迟查询)。

三者是 “上游底座→中游实时处理→下游在线服务” 的链路关系,而非竞争关系 —— 没有 Hive 提供的全量离线数据和批量计算能力,ClickHouse/HBase 只能处理 “实时短期数据”,推荐模型会因缺乏长期兴趣特征而导致推荐效果极差(比如只推荐用户最近 1 小时浏览的内容,无法挖掘长期偏好)。

需要我给你整理 Hive 与 ClickHouse/HBase 的数据同步方案(如 Flink 批量同步离线特征到 HBase),或者 Go 语言实现 Hive 离线特征计算的简化代码示例 吗?

我看还有spark,starrocks等技术,业界最新最好的事怎么用的呢

在当下大厂推荐系统里,Spark 是离线与近实时数据处理的核心引擎,StarRocks 则常用来替代部分 ClickHouse 场景,主打高效实时分析与特征计算,二者和之前的 Hive、HBase 配合形成更完善的存储计算链路,最新应用实践如下:

Spark:目前它仍是离线层核心,还拓展了近实时能力,同时在解决线上线下特征一致性问题上有新搭配。离线侧,大厂会用 Spark 配合 Hive 处理 PB 级全量历史数据,借助 Spark MLlib 训练 ALS 等推荐模型,还通过 Spark SQL 完成用户长期兴趣、物品相似度等离线特征的抽取计算;近实时侧,靠 Spark Streaming 对接 Kafka 消费用户点击、加购等实时数据流,2 秒左右一个批次做数据清洗和特征提取,补全用户短期行为特征;另外,为解决其不适合线上服务导致的特征一致性问题,大厂会搭配 FESQL 这类引擎,用统一 SQL 服务实现线上线下特征抽取,避免人工转译代码出现偏差。

StarRocks:作为新兴的极速 MPP 数据库,正成为推荐系统实时分析的优选,还在逐步替代部分 ClickHouse 场景。一方面,它能高效做实时特征工程,凭借向量化执行引擎和 CBO 优化器,毫秒级完成用户近 24 小时点击量、商品实时热度等聚合计算,给推荐模型提供新鲜特征;另一方面,白山云等企业已用它替换 ClickHouse 承载万亿量级数据,其物化视图能让数据写入时自动完成聚合,搭配三副本机制和扩缩容能力,既降低数据入库时延,又保障集群稳定;此外它还能支撑推荐效果实时看板,像用户点击率、推荐转化率等指标,即便 5B 规模数据集也能 1 秒左右完成查询,助力运营快速调整推荐策略。

整体来看,大厂最新常用架构是:Hive 存全量历史数据,Spark 负责离线特征计算与模型训练,StarRocks 处理实时特征和分析需求,HBase 承接高并发的线上画像查询,共同保障推荐系统的效果与性能。

7 篇资料

线上画像查询和实时特征与分析有什么区别

核心区别:线上画像查询服务 “在线推荐场景”(低延迟、高并发、简单查询),实时特征与分析服务 “决策 / 监控场景”(实时聚合、复杂查询、中低并发),具体从 4 个关键维度拆解(结合推荐系统实际场景):

对比维度 线上画像查询 实时特征与分析

核心目标 支撑推荐引擎毫秒级响应,给用户返回精准推荐结果 实时监控推荐效果、生成新鲜特征,辅助策略调整

查询特点 单用户 / 单物品的 “点查询”(如 “查用户 A 的实时画像”“查物品 B 的核心属性”),SQL 简单(仅筛选、取列) 多维度 “聚合查询”(如 “统计近 5 分钟美妆品类曝光量”“计算用户近 1 小时点击 TOP3 品类”),支持 GROUP BY / 窗口函数

性能要求 延迟≤10ms,QPS 百万级(匹配推荐服务高并发) 延迟 10ms-1s,QPS 千 – 万级(供监控面板 / 策略系统调用)

数据来源 用户长期画像(HBase 存储)+ 实时行为增量(如最近 3 次点击,HBase/Redis 缓存) 近 1 小时 – 24 小时的实时数据流(Kafka 导入 ClickHouse/StarRocks)

通俗类比(推荐系统场景):

线上画像查询 = 超市收银员扫码:用户(顾客)发起推荐请求(结账),系统快速查询用户画像(顾客偏好)和物品属性(商品价格 / 库存),10ms 内拿到结果(扫码完成),支撑高并发(高峰时段排队结账);

实时特征与分析 = 超市运营实时看报表:运营要知道 “最近 1 小时哪个货架卖得好”(实时特征)、“今天美妆区转化率多少”(实时分析),需要汇总数据做计算,虽然慢一点(1 秒内),但能指导调整推荐策略(比如把热销商品放到推荐首页)。

大厂落地示例:

线上画像查询:用户打开 APP,推荐引擎通过 “用户 ID” 查询 HBase,10ms 内获取用户长期兴趣标签(如 “偏好户外运动”)+ Redis 缓存的实时行为(如 “刚浏览过登山鞋”),快速生成推荐列表;

实时特征与分析:运营在监控面板看 “近 10 分钟推荐点击率是否下滑”,StarRocks 从 Kafka 实时拉取曝光 / 点击数据,1 秒内完成聚合计算并返回结果,若点击率低,可立即调整推荐算法的权重参数。

学习路线建议

学习路径建议

编程基础

Java:Hadoop 和许多大数据工具的核心代码都是用 Java 编写的,熟悉 Java 对理解这些工具的底层原理很有帮助。

Python:Python 有丰富的数据处理库(如 Pandas、NumPy)和机器学习库(如 scikit-learn),很多数据科学和 ETL 工作流会用到 Python。

Scala:Scala 是 Apache Spark 的原生语言,掌握 Scala 可以更方便地使用 Spark 编写高效的数据处理程序。

Linux 和 Shell 编程

Linux 操作基础:大数据集群一般部署在 Linux 环境下,因此掌握 Linux 文件操作、系统管理命令和基本的系统性能调优知识是必要的。

Shell 编程:Shell 脚本可以帮助自动化数据处理任务,例如批量操作文件、调度任务等。

SQL 和 数据库

SQL:SQL 是数据操作的基础语言,熟练掌握 SQL 是大数据开发的基本要求,尤其在数据清洗和 ETL 任务中用到很多。

关系型数据库(如 MySQL、PostgreSQL):了解基本的关系型数据库知识,为后期学习 NoSQL 和分布式数据库打下基础。

大数据分布式计算框架

Hadoop:学习 Hadoop 的 HDFS 和 MapReduce,理解大数据分布式存储和计算的基本原理。还可以学习 YARN 资源管理框架,了解集群资源的分配机制。

Apache Spark:Spark 是目前主流的内存计算框架,比 MapReduce 速度更快,更适合实时计算和迭代计算。重点掌握 Spark Core、Spark SQL 和 Spark Streaming。

Apache Flink:如果需要实时流处理,可以学习 Flink,它在流计算和低延迟方面非常强大。

数据存储与 NoSQL 数据库

HBase:一个基于 HDFS 的列存储数据库,适合大规模的随机读写操作。

Cassandra:高可用的分布式数据库,适用于需要高扩展性和低延迟的大数据应用。

MongoDB:广泛应用的文档型 NoSQL 数据库,可以处理半结构化数据。

数据仓库和数据湖

Hive:基于 Hadoop 的数据仓库工具,支持 SQL 查询,适合批处理数据分析任务。

Presto 或 Impala:分布式查询引擎,支持快速查询大量存储在 HDFS 或对象存储(如 Amazon S3)中的数据,适合交互式数据分析。

Delta Lake 或 Apache Hudi:如果需要数据湖管理,可以了解这些工具,它们可以为数据湖中的数据提供 ACID 操作支持。

数据采集与调度

Kafka:流处理领域的消息队列工具,适用于大规模实时数据采集和传输。

Flume / Sqoop:Flume 是专为日志数据设计的数据采集工具,Sqoop 则可以用于将关系型数据库中的数据导入 HDFS。

Airflow:工作流调度工具,可以编排和调度数据管道。

数据可视化

Tableau / Power BI:商业数据可视化工具,方便生成交互式仪表板。

Superset:一个开源的 BI 平台,适合与大数据平台集成。

Python 数据可视化库:如 Matplotlib、Seaborn、Plotly 等,用于生成定制化的数据可视化图表。

数据处理与机器学习

机器学习基础:可以学习一些机器学习算法和模型,如线性回归、聚类、分类等。大数据平台上的机器学习常用 Spark MLlib、TensorFlow on Spark 等工具。

数据清洗与特征工程:数据处理和特征工程在大数据开发中非常重要,尤其是在机器学习和数据分析任务中。

最新标准

用Parquet格式存储到s3 之后怎么用是算法的事情

存 S3 时务必按日期(date=2024-05-20)分目录。这是未来查询性能提升100倍的关键。

对于线上的数据 我们会有流式和批式两种存储格式 可以理解为流式是近两个小时的事实数据,线上的数据产生后会直接写入这条流 两个小时以上的数据才会存储到离线存储中 流式数据是存储在kafka消息系统中的

这个领域确实概念非常多(Hadoop生态、流批一体、湖仓一体等),很容易让人晕头转向。

针对你的需求(推荐算法打点、初期阶段、存下来、业内最新趋势),我可以直接告诉你结论:

现在的业内标准(特别是中大厂和新创公司)是:存算分离的“湖仓一体”架构。

简单说就是:数据存放在 S3(对象存储)上,文件格式用 Parquet/ORC,表格式用 Iceberg/Hudi/Delta。

别被名词吓到,我把它拆解成最简单的“MVP(最小可行性产品)”方案给你。

一、 核心架构:为什么这么存?

以前(旧方案):

用 HDFS(太重,维护麻烦)。

用 MySQL(存不下海量日志)。

直接存 ClickHouse(成本高,扩容麻烦,ClickHouse适合做分析,不适合做全量原始数据归档)。

现在(新方案 – 存算分离):

存储介质 (硬盘): 使用 S3 (公有云用 AWS S3/阿里云 OSS,自建用 MinIO)。

优点:无限容量、极其便宜、不需要维护硬盘坏了这种破事。

文件格式 (怎么写): Parquet。

优点:列式存储,压缩率极高(100G日志能压到10G),大数据引擎读起来飞快。

传输工具 (搬运工): Vector (或者 Fluent-bit)。

优点:Rust写的,性能极高,配置极其简单,且原生支持“把日志转成Parquet扔到S3”。

二、 最简实施方案 (MVP)

你现在不需要搞 Spark、Flink、Iceberg 那些复杂的计算引擎。你只需要把数据规整地落入 S3,以后要算推荐的时候,起一个 Spark 任务去读 S3 即可。

- 数据模型设计 (Schema)

推荐算法最核心的数据是 User-Item-Interaction。你需要定义一个通用的打点结构。

JSON 示例 (一条日志):

{

“event_time”: 1715666000, // 发生时间 (最重要)

“event_type”: “video_play”, // 事件类型:exposure(曝光), click(点击), like(点赞)

“user_id”: “u_123456”, // 谁

“item_id”: “v_987654”, // 看了什么 (视频ID/用户ID)

“device_id”: “ios_uuid_xxxx”, // 设备指纹 (解决未登录用户推荐)

“properties”: { // 扩展字段

“duration”: 15, // 看了多久

“recommend_id”: “rec_trace_001”, // 追踪ID (用于归因,是谁推荐的)

“position”: 3 // 在列表第几个位置

}

}

2. 数据采集链路 (最简版)

架构图:

Client (App/Web) –> 后端API (Nginx/Go/Java) –> 写入本地日志文件 (tracking.log) –> Vector (采集代理) –> S3 (对象存储)

为什么这么做?

后端只管快速写文件,不阻塞业务。

Vector 负责把 JSON 转成 Parquet 并上传 S3,如果 S3 挂了它会自动重试。

3. 配置文件示例 (Vector)

这是一个真实的、可用的配置逻辑。你只需要下载 Vector 这个小工具。

vector.toml 配置:

# 1. 输入源:监听本地日志文件

[sources.app_logs]

type = "file"

include = ["/var/log/myapp/tracking.log"] # 你的后端打点日志路径

# 2. 处理:解析 JSON (如果你的日志是JSON格式)

[transforms.parse_json]

type = "remap"

inputs = ["app_logs"]

source = '''

. = parse_json!(.message)

# 这里可以做一些数据清洗,比如把时间戳转标准格式

'''

# 3. 输出:存到 S3 (重点!)

[sinks.s3_archive]

type = "aws_s3"

inputs = ["parse_json"]

bucket = "my-data-lake" # 你的桶名

key_prefix = "tracking/date=%Y-%m-%d/" # 按天自动分文件夹,这叫“分区”

region = "ap-northeast-1"

encoding.codec = "parquet" # 关键:直接存成 Parquet 格式

batch.timeout_secs = 300 # 每5分钟打包上传一次,或者凑够一定大小上传

buffer.max_events = 10000

# 如果没有AWS,用MinIO也是一样的协议,加个 endpoint 参数即可

三、 之后怎么做推荐算法?

等你存了半个月的数据,S3里会有这样的目录结构:

s3://my-data-lake/tracking/date=2024-05-01/part-001.parquet

s3://my-data-lake/tracking/date=2024-05-02/part-001.parquet

这个时候,你需要做推荐模型训练:

离线训练 (Spark/Python):

直接用 Python (Pandas/PyArrow) 或者 Spark 读取 S3 上的 Parquet 文件。

因为已经是 Parquet,读取速度极快。

训练出模型 (User Embedding, Item Embedding)。

实时/近线分析 (ClickHouse):

如果你想看报表(昨天多少点击),ClickHouse 有一个功能叫 S3 Engine,甚至不需要导数据,直接建个表指向 S3 就能查询分析!

四、 总结 & 避坑建议

别一上来就搞 Hadoop/HDFS: 那是上个时代的眼泪,运维成本会拖垮你。

别直接存数据库: 不要把打点数据往 MySQL 或 Mongo 里塞,数据量一大立马死锁或磁盘爆炸。

一定要存 Parquet: 不要只存 JSON 或 CSV 在 S3,Parquet 是大数据界的通用货币,之后不管你用 Spark, Flink, ClickHouse 还是 StarRocks,都能完美对接。

一定要做分区: 存 S3 时务必按日期(date=2024-05-20)分目录。这是未来查询性能提升100倍的关键。

现在的最新、最简路径:

后端写日志 -> Vector 抓取 -> 转 Parquet -> 存 S3。

这就是最标准的“现代数据湖”雏形。

目前(2026 年)业内给「高并发打点 → 推荐/匹配」这类场景选存储,已经很少再单独用 HDFS 或传统 ClickHouse 本地盘架构,而是直接落到「湖仓一体(Lakehouse)+ 对象存储」的存算分离模式。核心变化可以概括为三句话:

统一存储层:S3/OSS/MinIO 等对象存储成为“唯一可信数据源”,原始日志、特征、模型结果都放这里,按 Iceberg/Paimon/Delta 等开放表格式组织,支持 ACID、update/upsert、time-travel 。

冷热分级:热数据(最近 24h~7d)自动缓存在本地 NVMe 或 Alluxio/StarRocks 内表,延迟 10~50 ms;冷数据在对象存储做生命周期沉降,成本只有本地盘 1/5~1/10 。

计算层完全解耦:

实时流:Kafka → Flink(或 Paimon Streaming Merge)→ 把增量特征写回 Iceberg/Paimon 表;

离线批:Spark/Trino 直接读对象存储上的同一张表,做 GB~PB 级回溯;

在线 Serving:StarRocks/Doris/ClickHouse Cloud 模式通过「外表物化视图」或「湖仓加速」把热点特征载入内存,给推荐引擎做 5~10 ms 级点查 。

这样打下来的埋点数据只需写一次(Kafka → 对象存储),就能同时支持

实时标签(<2 s)

离线模型训练(小时/天级)

在线特征召回(<10 ms)

避免过去“HDFS → Hive → ClickHouse → Redis” 多份存储、多次 ETL 的 pipeline 复杂度和一致性难题 。

落地时最简组合(云原生版)

对象存储 + Paimon/Iceberg + Flink + StarRocks/Doris;

私有化场景用 MinIO + HDFS 混部,同样走上述表格式即可 。

一句话总结:2026 年主流就是把“类 S3”对象存储当底座,上面套开放湖仓表格式,再让各类计算引擎按需挂载,实现“一份数据、三种时效、任意分析”。

另外 hive有点老了

总结

| 问题 | 答案 |

|---|---|

| Parquet 能导入 Hive 吗? | ✅ 完全可以 |

| 推荐 Hive 查询 Parquet 吗? | ❌ 太慢了 不过离线数据本身就慢,不如用 StarRocks/Trino |

| Parquet + Iceberg 比 Hive 好吗? | ✅ 好很多(ACID + 时间旅行) |

| 新项目需要 Hive 吗? | ❌ 不需要,直接用 Lakehouse |

为什么推荐这个架构?

- 存算分离的优势

存储层:S3/OSS

- 成本极低(¥0.12/GB/月 vs ClickHouse ¥1-2/GB/月)

- 无限容量,无需扩容

- 高可用(对象存储自带多副本)

计算层:按需启动

- 训练时:启动 Spark 集群读 S3

- 分析时:StarRocks 查询 S3

- 不需要时:关闭计算资源,节省成本

- 湖仓一体的好处

– Iceberg/Hudi/Delta Lake 提供:

✓ ACID 事务(不会读到脏数据)

✓ 时间旅行(查询昨天、上周的数据)

✓ Schema 演进(字段变更不影响历史)

✓ 增量更新(不用全表重写)

✓ 删除/更新支持(Hive 做不到)

- ML 友好

训练时直接读 S3

import pandas as pd

df = pd.read_parquet(‘s3://bucket/user_events/2025-01-06/’)

或用 Spark

from pyspark.sql import SparkSession

spark.read.parquet(‘s3a://bucket/user_events/*’)

不需要先导入到数据库,节省时间

针对 Corner 的具体建议

推荐方案(2025 标准)

┌────────────────────────────────────────┐

│ Go 打点 SDK │

│ • 埋点:浏览/点赞/聊天等 │

│ • 批量发送或实时写 Kafka │

└─────────────┬──────────────────────────┘

↓

┌──────────────┐

│ Kafka │ ← 可选,小量可直接写 S3

└──────┬───────┘

↓

┌──────────────────┐

│ Spark Streaming │ ← 每 5-10 分钟一个批次

│ 或 Flink │

└──────┬───────────┘

↓

┌────────────────────────────────┐

│ 阿里云 OSS │

│ /data/user_events/ │

│ /dt=2025-01-06/ │ ← 分区

│ /dt=2025-01-06/part-00001.parquet

└────────────────────────────────┘

↓

┌─────────────────────────────────┐

│ StarRocks (外部目录表) │ ← 直接查询 OSS

│ CREATE TABLE iceberg_table │

│ ENGINE=ICEBERG │

│ LOCATION=‘oss://…’ │

└─────────────────────────────────┘

↓

┌─────────────────────────────────┐

│ ML 训练 │

│ • Spark MLlib 读 OSS │

│ • PyTorch 直接读 Parquet │

└─────────────────────────────────┘

技术选型

| 组件 | 推荐方案 | 理由 |

|---|---|---|

| 对象存储 | 阿里云 OSS | 你们已经在用 |

| 文件格式 | Parquet | 列式存储,压缩好,ML 友好 |

| 表格式 | Apache Iceberg | Netflix 在用,对大表支持好,社区活跃 |

| 计算引擎 | StarRocks | 极快(比 Trino 快 5-10 倍),兼容 MySQL 协议 |

| 批处理 | Spark | 成熟,ML 生态好 |

| 实时写入 | Flink 或 Spark Streaming | 支持 Iceberg |

️ 何时用 ClickHouse?

// 只在以下场景用 ClickHouse:

✓ 实时监控大盘(最近 1 小时)

✓ 运营 Ad-hoc 查询(最近 7 天)

✓ 高并发在线分析

// ❌ 不要用 ClickHouse 存:

✗ 全量历史数据(成本太高)

✗ 归档数据(S3 更便宜)

✗ 非结构化日志

推荐架构:

实时链路(ClickHouse):

用户行为 → Kafka → ClickHouse (热数据 7 天)

归档链路(Lakehouse):

Kafka → Spark → OSS + Iceberg (全量 3 年+)

总结

你的理解完全正确:

✅ S3/OSS + Parquet + Iceberg = 2025 年标准

❌ HDFS + Hive = 已经过时

⚠️ ClickHouse = 只适合热数据,不适合全量归档

对于 Corner:

打点 → Kafka → Spark Streaming → OSS (Parquet + Iceberg)

↓

StarRocks 查询

↓

ML 训练

这套方案:

- 成本低(OSS 便宜)

- 扩展简单(无需维护存储集群)

- ML 友好(直接读 Parquet)

- 查询快(StarRocks)