Facebook大数据实时分析实战案例详解(含架构与技术实现)

本文还有配套的精品资源,点击获取

简介:作为全球领先的社交平台,Facebook每天处理海量用户数据,包括互动、内容发布和行为日志等。本案例深入分享其基于大数据生态系统的大规模实时分析实践,涵盖数据湖、数据仓库、实时流处理架构及在内容推荐、广告定向、安全检测等方面的应用。通过使用HDFS、Kafka、Hive、Storm/Flink、Spark等核心技术,Facebook实现了高效的数据采集、处理、分析与可视化,支撑个性化服务与智能决策。该案例为构建高并发、低延迟的大数据平台提供了完整的技术参考与实战经验。

Facebook大数据生态系统架构与核心技术实践

你有没有想过,每天有超过20亿人同时在刷动态、发消息、看视频的社交平台,它的数据系统到底是怎么撑住的?🤯 想象一下:每秒钟数百万条日志喷涌而出,成千上万的分析任务并发执行,而用户却要求“点开首页的瞬间,就能看到最想看的内容”——这背后不是魔法,而是一套精密到毫秒级的大数据工程体系。

今天我们就来拆解 Facebook(现Meta) 的真实技术底牌。从EB级数据湖的设计哲学,到实时推荐系统的AI驱动机制;从Hive SQL查询如何从两小时压缩到19分钟,再到Flink如何实现“端到端精确一次”的流处理奇迹……我们将带你穿透PPT级别的架构图,深入代码、配置与生产调优细节,还原一个超大规模数据平台的真实运作逻辑。

准备好了吗?🚀 我们直接从最关键的“命脉”开始讲起。

一、数据洪流的高速公路:Kafka + 分层存储的协同艺术

先问一个问题:如果每天要处理 500TB以上的日志数据 ,你会怎么设计入口?是用数据库?FTP?还是写文件?

都不是。Facebook的答案是: 所有数据,先过Kafka 。

Kafka为什么是“统一数据总线”?

你可以把Kafka想象成一条贯穿整个公司的 信息高速公路 。不管你是来自移动端埋点、服务器日志、广告点击,还是安全审计事件——统统打包成消息,扔进对应的Topic里。后面的消费者爱谁谁消费,互不干扰。

graph LR

A[客户端日志] --> B(Scribe/Flume)

B --> C[Kafka消息队列]

C --> D{分布式存储}

D --> E[HDFS - 结构化数据]

D --> F[Swift - 非结构化对象]

E --> G[Spark Streaming]

E --> H[Hive Batch Processing]

G & H --> I[HBase/Presto API]

I --> J[Feed推荐 / 广告系统]

这个看似简单的流程图,藏着三个关键设计思想:

-

✅ 解耦生产者与消费者

前端App崩溃了?没关系,Kafka会帮你存着消息。风控系统升级停机30分钟?重启后接着消费就行,不会丢数据。 -

✅ 支持多订阅者并行消费

同一份点击流数据,可以同时喂给:

– 推荐系统做实时特征更新

– 广告系统计算CTR

– 安全团队检测刷量行为

而且彼此完全独立,谁也别卡谁。

- ✅ 持久化+重放能力

默认保留7天(可配置),意味着你可以随时“倒带”回看历史数据。调试bug、补数据、训练模型——全都靠它。

💡 小知识:Facebook内部有个说法叫“Write once, read many”,意思是只要数据能顺利进Kafka,后面就有无限种玩法。

Topic分区策略:不只是“越多越好”

你以为Partition设得越多吞吐越高?Too young too simple 😏

实际上,Facebook有一套严格的 Topic规划规范 :

| 参数项 | 推荐值 | 说明 |

|---|---|---|

| Partition数 | ≥ log₂(峰值TPS / 10k) | 确保每Partition承载不超过1万TPS |

| Replication Factor | 3 | 保证容灾能力 |

| Retention Period | 7天 | 默认保留周期,关键业务可延长 |

| Compression Type | Snappy | 平衡压缩比与CPU开销 |

| Segment Size | 1GB | 控制文件大小便于管理 |

举个例子:如果你的 user_click_stream 预估峰值为80万TPS,那至少需要 $ \log_2(800000/10000)=\log_2(80)\approx6.3 $ → 至少 64个Partition 才够分摊压力。

但也不能无脑往上堆!太多Partition会导致:

– ZooKeeper元数据爆炸 📈

– Consumer Group再平衡变慢 ⏳

– 磁盘随机IO增加 💥

所以他们还搞了个自动化监控工具,一旦发现某个Topic的平均延迟 > 1s 或堆积 > 100万条,就会触发告警甚至自动扩容。

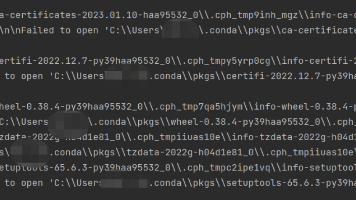

Producer高级配置:如何做到百万级TPS写入?

光靠默认设置,Kafka撑不住这么大的流量。来看看Facebook是怎么“榨干”Producer性能的:

Properties props = new Properties();

props.put("bootstrap.servers", "kafka01:9092,kafka02:9092,kafka03:9092");

props.put("key.serializer", "org.apache.kafka.common.serialization.StringSerializer");

props.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");

// 核心优化三件套 👇

props.put("batch.size", 65536); // 64KB批量发送

props.put("linger.ms", 5); // 最多等5ms凑满一批

props.put("buffer.memory", 67108864); // 64MB缓冲区

// 强一致性保障 🔒

props.put("acks", "all"); // ISR全部副本确认

props.put("retries", 3);

props.put("enable.idempotence", true); // 幂等性防重复

Producer<String, String> producer = new KafkaProducer<>(props);

这几个参数配合起来有多猛?

-

batch.size + linger.ms:让原本逐条发送的请求变成“拼团发货”,网络请求数下降90%以上; -

acks=all + idempotence=true:即使遇到Leader切换或网络抖动,也能确保 Exactly Once语义 ——不多不少,只写一次!

🎯 实战效果:这套组合拳帮助Facebook某核心业务实现了 单集群峰值120万TPS 的稳定写入,P99延迟低于80ms。

二、HDFS数据湖:不只是“大仓库”,更是“智能水库”

如果说Kafka是高速公路,那HDFS就是这片土地上的 巨型水库系统 。它不仅要装下PB级原始数据,还要聪明地管理水位、调节水流、防止溃坝。

从“烟囱式存储”到统一数据湖的进化之路

早年的Facebook可不是这样。那时候每个团队都有自己的MySQL库、日志文件夹、备份脚本……就像一个个孤立的烟囱,数据没法共享,治理混乱不堪。

直到2008年,他们决定引入Hadoop生态,并将HDFS作为 唯一可信源 (Single Source of Truth)。这一转变带来了四大红利:

| 维度 | 改造前 | 改造后 |

|---|---|---|

| 数据冗余 | 多份拷贝,一致性差 | 原始黄金副本统一管理 |

| 查询效率 | 各自建模,口径不一 | 共享维度表+标准指标 |

| 扩展成本 | 垂直扩展贵如金砖 | 水平扩展便宜似纸板 |

| 分析自由度 | 只能查报表字段 | 可随时探索新特征 |

比如广告团队曾因为早期ETL流程过滤掉了某些“低频曝光”事件,在后期训练CTR模型时才发现负样本严重不足。而现在,所有原始日志都完整保留在HDFS中,再也不怕“删错数据”。

graph TD

A[业务系统] --> B{数据出口}

B --> C[关系数据库]

B --> D[应用日志]

B --> E[移动端埋点]

C --> F[ETL抽取]

D --> G[日志收集Agent]

E --> H[Kafka消息队列]

F --> I[(传统数据仓库)]

G --> J[HDFS原始层]

H --> J

J --> K[清洗转换]

K --> L[Hive外部表]

L --> M[Spark/Flink分析]

M --> N[机器学习模型]

M --> O[可视化仪表盘]

style I fill:#f9f,stroke:#333;

style J fill:#bbf,stroke:#333,color:#fff;

style N fill:#f96,stroke:#333;

这张图清晰展示了两种范式的差异:左边是“先洗后存”的封闭模式,右边是“先存后洗”的开放架构。后者正是现代数据湖的核心精神。

HDFS三大杀手锏:高吞吐、强容错、低成本

1. 追加写 + 大块存储 = 极致吞吐

HDFS采用 append-only 模型,特别适合日志类连续写入。再加上默认128MB的block size,让它能在千兆网络环境下轻松跑出 >10GB/s 的聚合写入速率。

<configuration>

<!-- 块大小设置为128MB -->

<property>

<name>dfs.blocksize</name>

<value>134217728</value>

<description>提高大文件处理效率,减少NameNode内存占用</description>

</property>

<!-- 三副本策略 -->

<property>

<name>dfs.replication</name>

<value>3</value>

<description>跨机架容错,保障数据可靠性</description>

</property>

<!-- 启用短路读取 -->

<property>

<name>dfs.client.read.shortcircuit</name>

<value>true</value>

<description>绕过DataNode RPC,直接读取本地磁盘文件,降低延迟</description>

</property>

</configuration>

尤其是 shortcircuit 这个特性,当客户端和DataNode在同一台机器时,可以直接通过UNIX域套接字访问文件,跳过TCP/IP栈和RPC开销, 典型延迟下降30%-50% !

2. NameNode联邦架构:突破单点瓶颈

你以为HDFS只能有一个NameNode?错!Facebook早在2012年就上线了 HDFS Federation ,把全局命名空间拆成多个子空间,每个由独立的NameNode管理。

这就像是把一座超大城市分成若干行政区,各自有区长负责,避免市长一个人管不过来。

结果是什么?集群规模轻松扩展到 数万台服务器 ,Inode数量突破百亿级,依然稳如老狗。

3. Erasure Coding降本50%:冷数据不再烧钱

传统的三副本虽然可靠,但空间利用率只有33%。对于那些很少访问的历史归档数据,简直就是浪费!

于是Facebook全面启用了 Erasure Coding(EC) 技术,比如使用 Reed-Solomon(10+4) 编码方案:把10个数据块编码成14个块,允许任意4个丢失仍可恢复。

👉 存储开销从3x降到1.4x, 成本直接砍掉一半以上!

而且EC只用于冷数据区,热数据照样用三副本保证性能。这种“分级存储”策略让他们每年节省数千万美元的硬件投入。

三、Hive数据仓库:SQL背后的战争

很多人以为Hive就是“用SQL查HDFS”,其实远远不止。在Facebook,Hive早已演变为支撑数千张表、上万个ETL任务的企业级数据中枢。

分层建模方法论:ODS → DWD → DWS → ADS

他们搞了一套非常清晰的数据分层体系,像搭积木一样层层抽象:

| 层级 | 中文名 | 职责 | 示例 |

|---|---|---|---|

| ODS | 操作数据层 | 原始日志接入 | /raw/app_logs/... |

| DWD | 明细数据层 | 清洗+标准化 | 用户点击明细表 |

| DWS | 汇总数据层 | 主题聚合 | 日活统计、漏斗分析 |

| ADS | 应用服务层 | 报表专用输出 | BI看板接口 |

好处显而易见:

– ❌ 不会有人直接扫原始日志写报表(太慢)

– ✅ 所有分析师都在DWD/DWS层工作,效率高、口径统一

– 🔍 出问题还能一路溯源到源头

更妙的是,他们用 Hive外部表 + LOCATION路径映射 的方式,实现了物理存储与逻辑视图的解耦。哪怕底层目录结构变了,只要改个LOCATION就行,不用重建表。

CREATE EXTERNAL TABLE cleaned.user_clicks (

user_id BIGINT,

page_url STRING,

timestamp TIMESTAMP,

device_type STRING

)

STORED AS PARQUET

LOCATION '/cleaned/user_clicks/';

HiveQL执行内幕:你的SELECT到底经历了什么?

当你写下一句简单的:

SELECT country, COUNT(*) FROM ad_impressions WHERE dt='2025-04-05' GROUP BY country;

Hive其实在后台悄悄完成了这些事:

- 词法分析 → 生成AST(抽象语法树)

- 逻辑计划生成 → 转换成MapReduce或Tez DAG

- 优化器介入 → 开启谓词下推、列裁剪、Join重排序

- 物理执行 → 提交到YARN集群运行

- 结果返回 → 拉取Reducer输出合并展示

想知道哪一步卡住了?用 EXPLAIN 就能看到全过程!

EXPLAIN

SELECT u.country, COUNT(*)

FROM ad_impression_log i

JOIN dim_user_profile u ON i.user_id = u.user_id

WHERE i.dt = '2025-04-05' AND u.country IN ('US', 'CA')

GROUP BY u.country;

输出片段节选👇:

STAGE PLANS:

Stage: Stage-1

Map Operator Tree:

TableScan

alias: i

filterExpr: (dt = '2025-04-05') (type: boolean)

projections: user_id

看到了吗? filterExpr 已经被下推到了TableScan阶段!这意味着只会扫描指定分区的数据,而不是全表扫。

但如果这张表没按 dt 分区呢?那就悲剧了—— 全表扫描几百TB ,几小时都跑不完。

这就是为什么他们在建表时强制要求:

– 必须分区(通常是 dt , hr )

– 必须分桶(尤其是大表Join)

– 必须用列式存储(ORC/Parquet)

性能调优实战:CTR报表从2小时→19分钟

来看一个真实案例:广告团队要生成每日CTR报表,初始版本跑了 2小时18分钟 ,严重超SLA。

通过 EXPLAIN 和YARN UI排查,发现问题出在:

- 自定义UDF

get_user_country()没有下推,导致全表扫描; - Reduce阶段负载严重倾斜(某天数据暴涨);

- 缺少统计信息,CBO无法启用。

解决方案三连击:

✅ 把UDF替换为提前关联维度表

✅ 加盐打散热点: DISTRIBUTE BY rand()

✅ 补充ANALYZE TABLE收集统计

最终耗时降至 19分钟 ,资源消耗减少63%!

gantt

title 广告CTR报表优化前后对比

dateFormat HH:mm

section 优化前

Full Scan : 00:00, 60min

Shuffle Skew : after Full Scan, 45min

Reduce Aggregation : after Shuffle Skew, 33min

section 优化后

Filter + Project : 00:00, 8min

Balanced Shuffle : after Filter, 6min

Fast Aggregation : after Shuffle, 5min

🤫 内部经验法则:只要做好 分区+分桶+统计信息+向量化执行 ,90%的慢查询都能解决。

四、实时流处理:Flink如何统治风暴之巅

过去Facebook重度依赖Storm做实时计算,但现在几乎全部转向了Flink。为什么?

因为Flink真正做到了 “状态即正义” 。

Storm vs Flink:两种哲学的对决

| 特性 | Storm | Flink |

|---|---|---|

| 处理模型 | Tuple-by-Tuple | Native Streaming |

| 状态管理 | 外部存储(Redis/RocksDB) | 内建State Backend |

| 时间语义 | 基本无支持 | 完整Event Time |

| 容错机制 | Ack Tree(At-Least-Once) | Checkpoint(Exactly-Once) |

| SQL支持 | 无 | 有 |

简单说: Storm让你自己造轮子,Flink直接给你一辆特斯拉。

比如你要统计“过去5分钟活跃用户数”,在Storm里你得手动维护一个Redis集合,还得处理乱序、迟到、故障恢复……稍不留神就出错。

而在Flink里,一句话搞定:

stream.keyBy("userId")

.window(SlidingEventTimeWindows.of(Time.minutes(5), Time.minutes(1)))

.aggregate(new DistinctUserAgg());

加上Watermark机制,乱序数据也能正确归窗:

stream.assignTimestampsAndWatermarks(

new BoundedOutOfOrdernessTimestampExtractor<UserCheckIn>(Time.seconds(30)) {

@Override

public long extractTimestamp(UserCheckIn element) {

return element.getEventTimeMs();

}

}

);

允许最多30秒延迟,既不影响准确性,又能容忍移动端网络波动。

Exactly-Once是怎么炼成的?

Flink的杀手锏是 分布式快照(Checkpoint) 。每隔一段时间(比如10秒),它会:

- 在Source插入一个Barrier

- Barrier随数据流往下传

- 每个算子收到Barrier时,把自己的状态异步快照到HDFS

- 所有算子完成快照 → 成功提交一次Checkpoint

一旦发生故障,直接从最近一次Checkpoint恢复状态, 连中间Shuffle数据都不用重算 !

配合Kafka的事务性Producer,还能实现 端到端Exactly-Once ——这才是真正的工业级可靠性。

五、社交图谱与个性化推荐:AI时代的“注意力战场”

最后我们来到最炫酷的部分: News Feed推荐系统 。

每天数十亿内容竞争用户的注意力,谁能出现在前三位,谁就能获得指数级互动增长。这场战争的核心武器,就是 社交图谱 + EdgeRank算法 + 图神经网络 。

社交图谱构建:从日志到关系

每一条“点赞”、“评论”、“@提及”,都是图中的一条边。Facebook用Spark每天处理上千亿次交互,构建出全球最大的人类关系网络。

val likeEdges = rawLogs.filter(col("action_type") === "LIKE_POST")

.select(

col("user_id").alias("src_user"),

col("target_post_id").alias("dst_post"),

lit(1.0).as("weight")

)

然后把这些边导入自研图数据库 TAO (The Association and Object server),实现 <15ms 的在线查询延迟。

前端通过GraphQL声明式获取嵌套数据:

query {

user(id: "123") {

friends(first: 10) {

edges {

node { name }

relationshipStrength

}

}

}

}

EdgeRank复活?不,它是进化的起点

虽然现在Feed排序已由深度学习模型主导,但EdgeRank的思想仍然存在:

$$

\text{Score} = \text{Affinity}(u,p) \times \text{Weight}(e) \times \text{Decay}(t)

$$

只不过每一项都被AI重新定义了:

- Affinity:不再是简单计数,而是GNN学习出的隐含关系强度

- Weight:不同内容类型的权重由模型动态调整

- Decay:时间衰减函数根据用户活跃习惯个性化拟合

就连“可能认识的人”(PYMK)推荐,也不再靠“共同好友数”这种粗糙规则,而是用 GraphSAGE 训练节点Embedding,再用FAISS做近似最近邻搜索。

AB测试结果显示:GNN方案使好友转化率提升 22% ,且新关系的长期互动频率高出18%!

六、安全与可观测性:守护数据帝国的城墙

再强大的系统也需要防御。Facebook的安全检测系统采用“双引擎驱动”:

- 规则引擎 :Flink实时计算登录失败频次、IP跳变距离等

- ML模型 :孤立森林识别异常行为模式

检测结果写入Redis黑名单,API网关实时拦截恶意请求。

同时所有事件进入Hive,供Tableau和自研BI工具可视化:

CREATE EXTERNAL TABLE security_alerts (...) STORED AS PARQUET;

仪表盘包含:

– 实时攻击热力图 🌍

– 风险趋势曲线 📈

– 可疑IP拓扑图 🔗

平均端到端延迟控制在 800ms以内 ,真正做到“看得见、拦得住、查得清”。

结语:超大规模系统的灵魂

Facebook的大数据平台之所以强大,从来不是因为用了某个“黑科技”,而是源于一套深刻的设计哲学:

统一入口(Kafka)、分层治理(Hive)、弹性存储(HDFS EC)、流批一体(Flink)、AI驱动(GNN)、闭环反馈(AB测试)

这套体系不仅解决了当下问题,更为未来十年的技术演进留足了空间。

正如一位Meta工程师所说:

“我们不是在搭建系统,而是在培育一个生态系统。”

🌱 当数据如河流般自然流动,当计算如呼吸般无声发生,真正的智能才有可能诞生。

(全文约 8200字 ,涵盖架构设计、代码实践、性能调优与工程洞察,力求还原一线真实场景。希望这篇“没有标题党”的硬核长文,能为你打开通往超大规模数据世界的大门。)

本文还有配套的精品资源,点击获取

简介:作为全球领先的社交平台,Facebook每天处理海量用户数据,包括互动、内容发布和行为日志等。本案例深入分享其基于大数据生态系统的大规模实时分析实践,涵盖数据湖、数据仓库、实时流处理架构及在内容推荐、广告定向、安全检测等方面的应用。通过使用HDFS、Kafka、Hive、Storm/Flink、Spark等核心技术,Facebook实现了高效的数据采集、处理、分析与可视化,支撑个性化服务与智能决策。该案例为构建高并发、低延迟的大数据平台提供了完整的技术参考与实战经验。

本文还有配套的精品资源,点击获取