解读大数据领域结构化数据的管理模式

解读大数据领域结构化数据的管理模式

关键词:结构化数据、数据管理模式、数据建模、ETL流程、数据仓库、OLAP分析、数据治理

摘要:本文系统解析大数据时代结构化数据的管理模式,从技术架构、流程方法、治理体系三个维度展开深度分析。通过数据建模理论、ETL工程实践、数据仓库架构设计、OLAP分析原理等核心技术的拆解,结合具体代码实现和数学模型推导,揭示结构化数据从采集、存储到分析应用的全生命周期管理逻辑。同时探讨云原生环境下管理模式的演进方向,为数据工程师、架构师提供完整的技术框架和实践指南。

1. 背景介绍

1.1 目的和范围

随着企业数字化转型的深入,结构化数据作为最具业务价值的信息载体,其管理效率直接影响数据分析的准确性和决策支持的有效性。本文聚焦大数据领域结构化数据的管理模式,覆盖从数据采集、清洗、建模、存储到分析应用的全流程,解析核心技术原理、典型架构设计及工程实践方法,帮助读者建立系统化的管理思维。

1.2 预期读者

- 数据工程师:掌握结构化数据处理的工程化实现方法

- 数据架构师:理解不同管理模式的技术选型和架构设计原则

- 业务分析师:明确数据管理对分析应用的支撑逻辑

- 技术管理者:把握数据管理体系建设的关键要素

1.3 文档结构概述

本文采用"理论解析-技术拆解-实战验证-趋势展望"的结构:

- 核心概念:定义结构化数据特征及管理模式构成要素

- 技术体系:解析数据建模、ETL、存储架构、分析引擎的核心原理

- 工程实践:通过完整案例演示管理模式的落地实现

- 应用扩展:探讨云原生环境下的技术演进和治理体系建设

1.4 术语表

1.4.1 核心术语定义

- 结构化数据:具有固定数据模式(Schema)的表格型数据,可通过二维表形式逻辑表达,如关系型数据库中的表数据

- 数据建模:对现实世界数据特征的抽象,建立数据结构及关系的过程,包括概念模型、逻辑模型、物理模型

- ETL:Extract-Transform-Load(提取-转换-加载),实现数据从源系统到目标存储的迁移和处理流程

- 数据仓库:面向主题的、集成的、稳定的、随时间变化的数据集合,用于支持管理决策

- OLAP:在线分析处理(Online Analytical Processing),支持复杂多维查询和分析的技术体系

1.4.2 相关概念解释

- 数据湖 vs 数据仓库:数据湖存储原始结构化/非结构化数据,数据仓库存储经过清洗建模的结构化数据

- 星型模型 vs 雪花模型:维度建模中的两种模式,星型模型简化维度表设计,雪花模型实现维度规范化

- 实时处理 vs 批处理:根据数据处理时效性要求选择的两种技术路线,前者支持毫秒级响应,后者处理大规模历史数据

1.4.3 缩略词列表

| 缩写 | 全称 |

|---|---|

| RDBMS | 关系型数据库管理系统(Relational Database Management System) |

| NoSQL | 非关系型数据库(Not Only SQL) |

| ETL | 提取-转换-加载(Extract-Transform-Load) |

| ELT | 提取-加载-转换(Extract-Load-Transform) |

| OLTP | 在线事务处理(Online Transaction Processing) |

| OLAP | 在线分析处理(Online Analytical Processing) |

2. 核心概念与联系

2.1 结构化数据的本质特征

结构化数据的核心特征是数据模式的确定性,其存储和访问遵循预定义的Schema结构。典型表现形式包括:

- 关系型数据库表(如MySQL的users表包含id、name、email等字段)

- 固定格式文件(如CSV、Excel、Parquet)

- 接口返回的结构化数据(如JSON中符合固定Schema的对象数组)

与半结构化数据(如日志JSON)和非结构化数据(如图像、文本)相比,结构化数据的优势在于:

- 高效的查询性能(支持SQL语法和索引优化)

- 明确的数据一致性约束(通过外键、唯一索引实现)

- 成熟的事务处理能力(支持ACID特性)

2.2 管理模式的核心要素架构

结构化数据管理模式由技术架构层、流程方法层、治理体系层三大维度构成,形成立体化管理框架:

管理模式

技术架构层

流程方法层

治理体系层

数据建模

存储引擎

计算引擎

ETL/ELT流程

数据质量管控

元数据管理

组织架构

管理制度

技术标准

2.2.1 技术架构层

- 数据建模:定义数据结构及关系,是管理模式的核心设计要素

- 存储引擎:根据数据规模和访问模式选择存储方案(如RDBMS、分布式数据库、数据仓库)

- 计算引擎:支持数据处理(ETL)和分析(OLAP)的计算框架(如Spark、Flink、Presto)

2.2.2 流程方法层

- ETL/ELT流程:实现数据在不同系统间的流动和转换,是数据集成的核心环节

- 数据质量管控:通过完整性、准确性、一致性等指标保障数据可用度

- 元数据管理:对数据定义、结构、血缘关系等元信息的系统化管理

2.2.3 治理体系层

- 组织架构:设立数据治理委员会、数据owner等角色明确权责

- 管理制度:制定数据标准、安全规范、生命周期管理办法

- 技术标准:统一数据编码、命名规范、接口协议等技术规范

3. 核心算法原理 & 具体操作步骤

3.1 数据建模核心方法

3.1.1 实体-关系(ER)模型设计

ER模型通过实体、属性、关系三个要素描述数据结构,是概念建模的基础方法。

核心步骤:

- 识别业务实体(如订单、客户、产品)

- 定义实体属性(如订单包含order_id、create_time、amount)

- 建立实体关系(1:1、1:N、M:N,如客户与订单是1:N关系)

数学表达:

实体集合表示为 ( E = {e_1, e_2, …, e_n} ),属性集合 ( A = {a_1, a_2, …, a_m} ),关系集合 ( R = {r_1, r_2, …, r_k} ),其中关系 ( r_i ) 定义为实体集合的笛卡尔积子集:

[ r_i \subseteq E_1 \times E_2 \times … \times E_n ]

3.1.2 维度建模(星型模型实现)

维度建模是数据仓库领域的主流建模方法,核心包括事实表和维度表:

- 事实表:存储业务过程的度量数据(如订单事实表包含订单金额、数量)

- 维度表:存储分析角度的描述性数据(如时间维度、地域维度)

Python代码示例:生成星型模型数据

import pandas as pd

# 创建事实表

fact_data = {

'order_id': [1001, 1002, 1003],

'product_id': [101, 102, 101],

'time_key': ['2023-01-01', '2023-01-02', '2023-01-03'],

'amount': [100.5, 200.3, 150.8]

}

fact_table = pd.DataFrame(fact_data)

# 创建维度表-产品

dim_product = {

'product_id': [101, 102],

'product_name': ['Laptop', 'Phone'],

'category': ['Electronics', 'Electronics']

}

dim_product_table = pd.DataFrame(dim_product)

# 星型模型关联

star_schema = pd.merge(fact_table, dim_product_table, on='product_id', how='left')

print(star_schema.head())

3.2 ETL流程工程实现

3.2.1 ETL三阶段核心操作

- 提取(Extract):从源系统获取数据,支持多种数据源(数据库、文件、API)

- 转换(Transform):数据清洗(去重、纠错)、格式转换、业务规则处理

- 加载(Load):将处理后的数据写入目标存储,支持增量/全量加载

3.2.2 增量加载实现算法

通过时间戳或版本号实现增量数据识别,伪代码逻辑:

def incremental_load(source_conn, target_conn, last_run_time):

# 提取增量数据:where update_time > last_run_time

sql = f"SELECT * FROM source_table WHERE update_time > '{last_run_time}'"

incremental_data = pd.read_sql(sql, source_conn)

# 数据转换:示例去重

cleaned_data = incremental_data.drop_duplicates(subset='id')

# 加载到目标表:追加模式

cleaned_data.to_sql('target_table', target_conn, if_exists='append', index=False)

# 更新最后运行时间

update_last_run_time()

return len(cleaned_data)

3.2.3 ELT vs ETL的选择策略

| 特性 | ETL | ELT |

|---|---|---|

| 处理位置 | 数据加载前在ETL工具中处理 | 数据加载后在目标数据库处理 |

| 灵活性 | 低(预处理固定) | 高(利用数据库计算能力) |

| 适用场景 | 数据源复杂、计算逻辑简单 | 目标库为数据仓库/数据湖 |

| 技术栈 | 传统ETL工具(Informatica) | 云数据管道(AWS Glue、DataFlow) |

4. 数学模型和公式 & 详细讲解

4.1 数据质量评估模型

数据质量通过多维指标量化评估,核心指标包括:

4.1.1 完整性(Completeness)

[ C = \frac{\text{非空值字段数}}{\text{总字段数}} \times 100% ]

示例:用户表100条记录,email字段有20条空值,则完整性为80%。

4.1.2 准确性(Accuracy)

[ A = \frac{\text{符合业务规则的记录数}}{\text{总记录数}} \times 100% ]

业务规则:订单金额必须大于0,年龄字段需在1-150之间。

4.1.3 一致性(Consistency)

[ K = \frac{\text{多数据源一致的记录数}}{\text{总对比记录数}} \times 100% ]

场景:对比CRM系统和订单系统的客户手机号一致性。

4.2 数据仓库容量规划模型

根据数据增长趋势预测存储容量,公式:

[ S_n = S_0 \times (1 + r)^n + \sum_{i=1}^n \frac{D_i}{c} ]

其中:

- ( S_n ):第n年存储容量

- ( S_0 ):初始容量

- ( r ):年数据自然增长率

- ( D_i ):第i年新增数据量

- ( c ):压缩比(默认1表示未压缩)

案例:初始容量10TB,年增长率20%,每年新增5TB,压缩比3,则第3年容量:

[ S_3 = 10 \times 1.2^3 + \frac{5}{3} \times 3 = 17.28 + 5 = 22.28 \text{TB} ]

4.3 OLAP立方体计算复杂度

假设维度数为n,每个维度的成员数为 ( m_i (i=1,2,…,n) ),则立方体单元数为:

[ C = \prod_{i=1}^n (m_i + 1) ]

优化实践:通过维度聚合(如时间维度按年/季/月聚合)减少计算量,采用ROLAP(关系型OLAP)替代MOLAP(多维数组存储)降低存储成本。

5. 项目实战:电商平台结构化数据管理系统

5.1 开发环境搭建

5.1.1 技术栈选型

| 模块 | 工具/框架 | 版本 | 功能描述 |

|---|---|---|---|

| 数据源 | MySQL | 8.0 | 订单、用户、产品原始数据存储 |

| 数据集成 | Apache NiFi | 1.20.0 | 可视化ETL流程编排 |

| 数据存储 | Apache Hive | 3.1.2 | 数据仓库存储 |

| 计算引擎 | Apache Spark | 3.3.2 | 批量数据处理 |

| 分析引擎 | Apache Impala | 3.4.1 | 交互式OLAP查询 |

| 元数据管理 | Apache Atlas | 2.2.0 | 数据血缘和元信息管理 |

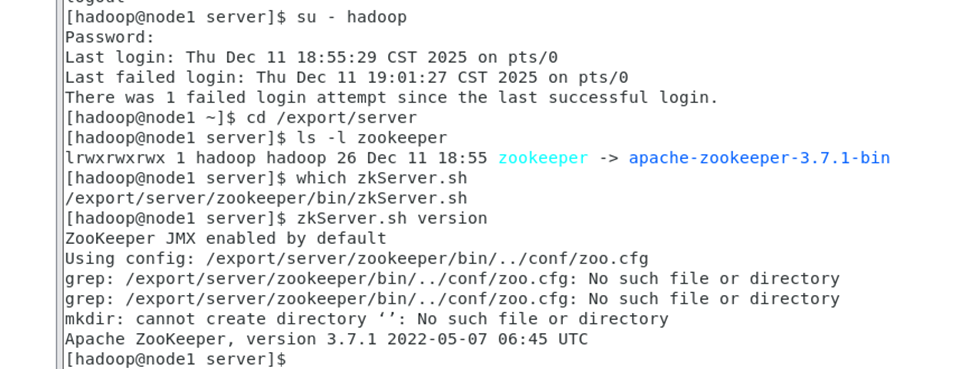

5.1.2 环境部署步骤

- 安装Hadoop集群(HDFS作为分布式存储基础)

- 部署Hive数据仓库,配置MySQL存储元数据

- 安装Spark并配置YARN资源调度

- 启动NiFi服务,配置数据源连接(JDBC连接MySQL)

5.2 源代码详细实现和代码解读

5.2.1 数据清洗模块(Spark Python实现)

from pyspark.sql import SparkSession

from pyspark.sql.functions import col, when, isnull, trim

# 初始化Spark Session

spark = SparkSession.builder \

.appName("EcommerceDataCleaning") \

.config("spark.sql.shuffle.partitions", 10) \

.getOrCreate()

# 读取原始订单数据

raw_orders = spark.read \

.format("jdbc") \

.option("url", "jdbc:mysql://localhost:3306/ecommerce") \

.option("dbtable", "raw_orders") \

.option("user", "root") \

.option("password", "password") \

.load()

# 数据清洗步骤

cleaned_orders = raw_orders \

.filter(col("order_amount") > 0) \ # 过滤无效金额

.withColumn("customer_name", trim(col("customer_name"))) \ # 去除空格

.na.fill("unknown", subset=["customer_email"]) \ # 填充缺失邮箱

.dropDuplicates(["order_id"]) # 去重处理

# 写入Hive数据仓库

cleaned_orders.write \

.mode("overwrite") \

.saveAsTable("dws.dws_order_info")

5.2.2 维度建模实现

1. 时间维度表构建

-- 创建时间维度表

CREATE TABLE dim_time (

time_key STRING PRIMARY KEY,

year INT,

month INT,

day INT,

week_of_year INT,

quarter INT

);

-- 生成时间数据(Python脚本)

start_date = pd.to_datetime('2020-01-01')

end_date = pd.to_datetime('2023-12-31')

date_range = pd.date_range(start=start_date, end=end_date, freq='D')

time_data = date_range.to_series().reset_index(drop=True)

time_df = pd.DataFrame({

'time_key': time_data.dt.strftime('%Y-%m-%d'),

'year': time_data.dt.year,

'month': time_data.dt.month,

'day': time_data.dt.day,

'week_of_year': time_data.dt.isocalendar().week,

'quarter': time_data.dt.quarter

})

time_df.to_sql('dim_time', spark.sql("use dim"), if_exists='append', index=False)

2. 事实表关联

-- 构建订单事实表(关联维度表)

CREATE TABLE fact_order (

order_id STRING,

time_key STRING,

customer_id STRING,

product_id STRING,

order_amount DECIMAL(10,2),

FOREIGN KEY (time_key) REFERENCES dim_time(time_key)

);

-- 插入数据(通过Spark SQL)

spark.sql("""

INSERT INTO fact_order

SELECT

o.order_id,

t.time_key,

o.customer_id,

o.product_id,

o.order_amount

FROM dws.dws_order_info o

JOIN dim_time t ON o.order_date = t.time_key

""")

5.3 代码解读与分析

- 数据清洗逻辑:通过Spark DataFrame的过滤、转换、填充操作,确保数据的完整性和准确性

- 维度表设计:时间维度采用代理键(time_key)作为主键,支持高效的事实表关联

- 性能优化:利用Spark的分布式计算能力处理大规模数据,通过分区和缓存提升处理效率

6. 实际应用场景

6.1 金融风控领域

- 场景:信用卡申请数据管理

-

管理模式应用:

- 数据建模:建立客户基本信息、信用记录、交易流水等实体关系模型

- ETL流程:整合银行核心系统、征信平台、第三方数据源数据

- 分析应用:通过OLAP分析客户信用评分趋势,支持实时风控决策

6.2 电商分析领域

- 场景:用户行为分析与商品推荐

-

管理模式应用:

- 维度建模:构建用户、商品、时间、地域等多维模型

- 实时处理:通过Flink实现点击流数据的实时ETL,更新实时数据仓库

- 数据应用:利用Spark MLlib构建推荐算法模型,基于清洗后的结构化数据训练

6.3 智慧城市领域

- 场景:交通数据管理与拥堵预测

-

管理模式应用:

- 存储架构:采用分布式数据库(如PostgreSQL + TimescaleDB)存储实时交通流数据

- 数据治理:建立统一的数据标准(如道路编码、车辆类型分类)

- 分析引擎:使用Presto进行多源数据关联分析,支持实时路况查询

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

- 《数据仓库工具箱》- Ralph Kimball:维度建模的权威指南

- 《大数据之路:阿里巴巴大数据实践》- 付登坡等:企业级数据管理实战经验

- 《数据治理:如何让数据产生价值》- 王汉生等:治理体系建设的理论与案例

7.1.2 在线课程

- Coursera《Data Warehousing and Business Intelligence Specialization》(University of Michigan)

- 网易云课堂《大数据开发实战之数据仓库篇》

- 阿里云大学《数据治理核心能力培养计划》

7.1.3 技术博客和网站

- 博客园-数据架构专栏:深度技术文章分享

- Medium-Data Engineering:国际前沿技术动态

- 数据仓库社区(The Data Warehouse Institute):行业标准和最佳实践

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

- PyCharm:Python开发首选,支持Spark调试

- DataGrip:专业数据库开发工具,支持多数据源管理

- VS Code:轻量级编辑器,通过插件支持SQL、Python开发

7.2.2 调试和性能分析工具

- Spark UI:实时监控作业执行状态和资源使用情况

- SQL Profiler:分析数据库查询性能瓶颈

- JMeter:压力测试工具,评估数据加载性能

7.2.3 相关框架和库

- 数据集成:Apache NiFi(可视化流程编排)、Sqoop(关系型数据迁移)

- 数据存储:Hive(数据仓库)、ClickHouse(高性能分析数据库)

- 数据治理:Apache Atlas(元数据管理)、DataHub(数据目录)

7.3 相关论文著作推荐

7.3.1 经典论文

- 《A Relational Model of Data for Large Shared Data Banks》- E.F. Codd(关系模型奠基之作)

- 《The Data Warehouse Toolkit: The Definitive Guide to Dimensional Modeling》- Ralph Kimball(维度建模经典)

- 《Lambda Architecture for Real-Time Big Data Processing》- Marz & Warren(实时数据处理架构)

7.3.2 最新研究成果

- 《Cloud-Native Data Warehouse: Architecture and Design》- ACM 2023(云原生数据仓库技术演进)

- 《Automated Data Quality Management in Big Data Systems》- IEEE Transactions(数据质量自动化管理)

7.3.3 应用案例分析

- 亚马逊AWS数据湖架构实践(白皮书)

- 美团外卖数据仓库建设案例(技术博客)

8. 总结:未来发展趋势与挑战

8.1 技术演进趋势

- 云原生架构普及:基于Snowflake、Redshift等云数据仓库的Serverless模式成为主流

- 实时化与湖仓一体:Flink+Iceberg架构实现实时数据处理,数据湖与数据仓库深度融合

- 自动化管理:AI驱动的数据建模(如AutoML生成ER图)、智能ETL流程优化

8.2 核心挑战

- 数据孤岛破除:跨部门、跨系统的数据集成面临标准不统一问题

- 隐私计算需求:GDPR等合规要求下,如何在数据共享中保护用户隐私

- 成本效益平衡:大规模结构化数据存储和计算的成本优化策略

8.3 未来研究方向

- 基于联邦学习的数据协同分析技术

- 自优化的数据建模算法

- 智能数据治理框架的工程化实现

9. 附录:常见问题与解答

Q1:如何选择合适的数据建模方法?

A:根据应用场景选择:

- 业务系统(OLTP):采用ER模型实现规范化设计

- 分析系统(OLAP):采用维度建模(星型/雪花模型)提升查询效率

- 复杂场景:结合两种方法,先构建ER模型再转换为维度模型

Q2:ETL流程中如何处理数据一致性问题?

A:

- 采用事务性加载确保目标表数据一致性

- 通过ETL日志记录处理过程,支持错误回滚

- 使用数据校验工具(如Great Expectations)定义一致性规则

Q3:数据仓库和数据库的核心区别是什么?

A:

- 数据库面向事务处理,支持高频次增删改

- 数据仓库面向分析处理,数据以读为主,支持历史数据存储

- 数据库注重ACID特性,数据仓库注重数据集成和分析性能

10. 扩展阅读 & 参考资料

- 《Dimensional Modeling Master Class》- Ralph Kimball(官方培训材料)

- Apache Hive官方文档(https://hive.apache.org/)

- 数据治理国家标准(GB/T 36073-2018《数据治理 数据管理成熟度评估模型》)

通过系统化的管理模式设计,结构化数据能够释放更大的业务价值。从技术架构的底层设计到治理体系的顶层规划,每个环节都需要结合企业实际需求进行定制化建设。随着技术的不断演进,结构化数据管理将与新兴技术深度融合,形成更智能、更高效的解决方案。