Hadoop网络通信性能调优深度指南:从原理到实战

Hadoop网络通信性能调优深度指南:从原理到实战

-

- 引言:网络——Hadoop集群的"高速公路"

- 一、Hadoop网络通信全景

-

- 1.1 Hadoop中的通信类型

- 1.2 网络性能的度量指标

- 二、网络优化的"道":架构级策略

-

- 2.1 网络拓扑规划

- 2.2 机架感知的配置

- 2.3 数据本地性最大化

- 三、网络优化的"术":关键参数调优

-

- 3.1 RPC通信优化

- 3.2 Shuffle网络优化

- 3.3 网络缓冲区优化

- 3.4 操作系统级优化

- 四、网络优化的"器":关键技术与工具

-

- 4.1 数据压缩

- 4.2 使用外部Shuffle服务

- 4.3 启用数据平衡带宽限制

- 4.4 公平调用队列(Fair Call Queue)

- 五、监控与诊断

-

- 5.1 网络性能监控指标

- 5.2 关键监控指标解读

- 5.3 诊断工具

- 六、案例分析:大型集群网络优化实战

-

- 6.1 案例一:金融风控系统网络优化

- 6.2 案例二:电商日志系统网络瓶颈

- 七、总结:网络优化最佳实践

-

- 7.1 网络优化路线图

- 7.2 优化检查清单

- 7.3 最终建议

|

🌺The Begin🌺点点关注,收藏不迷路🌺

|

引言:网络——Hadoop集群的"高速公路"

在大数据领域,网络通信往往是集群性能的"隐形瓶颈"。随着集群规模扩大,Shuffle阶段的数据传输、RPC请求的频繁交互、数据块的复制等都会对网络带宽产生巨大压力。网络性能调优成为保障Hadoop集群高效运行的关键一环。

本文将深入剖析Hadoop网络通信的原理,系统性地介绍从架构设计到参数配置的优化手段,帮助你在实际场景中提升网络传输效率。

Hadoop网络优化

通信类型

Shuffle数据传输

RPC控制请求

数据块复制

优化维度

硬件规划

网络拓扑

协议优化

参数调优

关键技术

压缩技术

数据本地性

公平调度

零拷贝传输

一、Hadoop网络通信全景

1.1 Hadoop中的通信类型

在Hadoop集群中,网络通信主要发生在以下几个场景:

数据流

Shuffle

中间结果

Map

Reduce

控制流

RPC请求

心跳/指令

心跳/指令

资源请求

读写

数据复制

客户端

NameNode

DataNode

ResourceManager

NodeManager

ApplicationMaster

| 通信类型 | 方向 | 数据特征 | 重要性 |

|---|---|---|---|

| RPC控制请求 | 客户端↔主节点 | 小数据量、高频 | 控制面核心 |

| 心跳 | 从节点→主节点 | 小数据量、周期性 | 故障检测基础 |

| 数据块复制 | DataNode↔DataNode | 大数据量、低频 | 数据可靠性保障 |

| Shuffle传输 | Map→Reduce | 大数据量、高频 | 作业性能关键 |

1.2 网络性能的度量指标

| 指标 | 含义 | 对Hadoop的影响 |

|---|---|---|

| 带宽 | 单位时间传输数据量 | 决定Shuffle和数据复制速度 |

| 延迟 | 请求响应时间 | 影响RPC和任务调度效率 |

| 丢包率 | 数据包丢失比例 | 触发TCP重传,性能骤降 |

| 网络抖动 | 延迟的变化程度 | 影响超时判断,导致任务失败 |

二、网络优化的"道":架构级策略

2.1 网络拓扑规划

合理的网络拓扑是优化的基础:

节点层

接入层

汇聚层

核心层

核心交换机

高带宽、低延迟

汇聚交换机1

汇聚交换机2

机架1交换机

机架2交换机

机架3交换机

N1

N2

N3

N4

N5

N6

网络规划最佳实践:

| 集群规模 | 网络架构 | 带宽要求 | 说明 |

|---|---|---|---|

| 小型(<50节点) | 单核心交换机 | 10Gbps | 所有节点接入同一交换机 |

| 中型(50-200节点) | 核心+汇聚 | 40Gbps | 分层架构,核心冗余 |

| 大型(200-1000节点) | Spine-Leaf | 100Gbps | 无阻塞架构,避免收敛 |

| 超大规模(>1000节点) | 多数据中心 | 100Gbps+ | 跨数据中心优化 |

2.2 机架感知的配置

机架感知让Hadoop了解网络拓扑,是实现数据本地性和网络优化的基础:

# 配置机架感知脚本

cat > /etc/hadoop/conf/topology.sh << 'EOF'

#!/bin/bash

# 根据IP返回机架路径

if [ -f /etc/hadoop/conf/topology.data ]; then

grep $1 /etc/hadoop/conf/topology.data | awk '{print $2}'

else

echo "/default-rack"

fi

EOF

chmod +x /etc/hadoop/conf/topology.sh

<!-- core-site.xml -->

<property>

<name>net.topology.script.file.name</name>

<value>/etc/hadoop/conf/topology.sh</value>

</property>

2.3 数据本地性最大化

数据本地性是减少网络流量的最有效手段:

<!-- yarn-site.xml 延迟调度配置 -->

<property>

<name>yarn.scheduler.capacity.node-locality-delay</name>

<value>40</value>

<description>等待本地节点的调度次数</description>

</property>

<property>

<name>yarn.scheduler.capacity.rack-locality-additional-delay</name>

<value>20</value>

<description>机架本地额外等待次数</description>

</property>

调优建议:

- 大型集群可将延迟调度阈值调高至60-80

- 监控数据本地性比例,目标是节点本地>90%

三、网络优化的"术":关键参数调优

3.1 RPC通信优化

RPC是Hadoop各组件之间的通信基础,优化RPC能显著降低控制面延迟:

<!-- core-site.xml -->

<property>

<name>ipc.server.listen.queue.size</name>

<value>128</value>

<description>RPC服务器监听队列大小</description>

</property>

<property>

<name>ipc.server.tcpnodelay</name>

<value>true</value>

<description>禁用Nagle算法,降低延迟</description>

</property>

<property>

<name>ipc.client.tcpnodelay</name>

<value>true</value>

<description>客户端同样禁用Nagle</description>

</property>

<property>

<name>ipc.client.connect.timeout</name>

<value>20000</value>

<description>连接超时(毫秒)</description>

</property>

<property>

<name>ipc.client.connect.max.retries</name>

<value>10</value>

<description>连接重试次数</description>

</property>

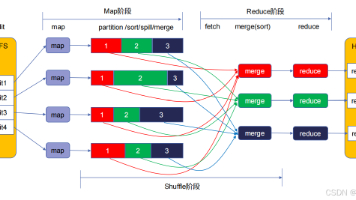

3.2 Shuffle网络优化

Shuffle阶段是网络通信最密集的场景:

<!-- mapred-site.xml -->

<property>

<name>mapreduce.reduce.shuffle.parallelcopies</name>

<value>20</value>

<description>Reduce并行拷贝线程数,默认5</description>

</property>

<property>

<name>mapreduce.reduce.shuffle.maxfetchfailures</name>

<value>10</value>

<description>最大拉取失败次数</description>

</property>

<property>

<name>mapreduce.reduce.shuffle.connect.timeout</name>

<value>180000</value>

<description>连接超时(毫秒)</description>

</property>

<property>

<name>mapreduce.reduce.shuffle.read.timeout</name>

<value>180000</value>

<description>读取超时(毫秒)</description>

</property>

<property>

<name>mapreduce.shuffle.max.connections</name>

<value>0</value>

<description>最大连接数,0表示不限制</description>

</property>

<property>

<name>mapreduce.shuffle.max.threads</name>

<value>50</value>

<description>Shuffle处理线程数</description>

</property>

调优公式:

并行拷贝数 = min(节点CPU核心数 × 2, 50)

3.3 网络缓冲区优化

调整TCP缓冲区大小可以提升大流量传输性能:

<!-- core-site.xml -->

<property>

<name>dfs.datanode.socket.write.timeout</name>

<value>480000</value>

<description>写入超时(毫秒)</description>

</property>

<property>

<name>dfs.datanode.socket.read.timeout</name>

<value>480000</value>

<description>读取超时(毫秒)</description>

</property>

<property>

<name>dfs.datanode.transfer.socket.send.buffer.size</name>

<value>131072</value>

<description>发送缓冲区大小(128KB)</description>

</property>

<property>

<name>dfs.datanode.transfer.socket.recv.buffer.size</name>

<value>131072</value>

<description>接收缓冲区大小(128KB)</description>

</property>

3.4 操作系统级优化

# 调整TCP缓冲区大小

sysctl -w net.core.rmem_max=16777216

sysctl -w net.core.wmem_max=16777216

sysctl -w net.ipv4.tcp_rmem="4096 87380 16777216"

sysctl -w net.ipv4.tcp_wmem="4096 65536 16777216"

# 启用TCP窗口缩放

sysctl -w net.ipv4.tcp_window_scaling=1

# 增加连接队列长度

sysctl -w net.core.somaxconn=1024

# 启用时间戳和选择确认

sysctl -w net.ipv4.tcp_timestamps=1

sysctl -w net.ipv4.tcp_sack=1

# 将配置写入sysctl.conf

cat >> /etc/sysctl.conf << EOF

net.core.rmem_max=16777216

net.core.wmem_max=16777216

net.ipv4.tcp_rmem=4096 87380 16777216

net.ipv4.tcp_wmem=4096 65536 16777216

net.ipv4.tcp_window_scaling=1

net.core.somaxconn=1024

net.ipv4.tcp_timestamps=1

net.ipv4.tcp_sack=1

EOF

四、网络优化的"器":关键技术与工具

4.1 数据压缩

压缩是减少网络传输量的最有效手段:

<!-- mapred-site.xml -->

<property>

<name>mapreduce.map.output.compress</name>

<value>true</value>

</property>

<property>

<name>mapreduce.map.output.compress.codec</name>

<value>org.apache.hadoop.io.compress.SnappyCodec</value>

</property>

<property>

<name>mapreduce.output.fileoutputformat.compress</name>

<value>true</value>

</property>

<property>

<name>mapreduce.output.fileoutputformat.compress.codec</name>

<value>org.apache.hadoop.io.compress.ZStandardCodec</value>

</property>

压缩算法对比:

| 算法 | 压缩比 | 速度 | CPU消耗 | 适用场景 |

|---|---|---|---|---|

| Snappy | 2-3x | 极快 | 低 | Map输出、Shuffle |

| LZ4 | 2-3x | 最快 | 最低 | CPU敏感场景 |

| ZSTD | 3-5x | 快 | 中 | 最终输出、归档 |

| GZIP | 4-6x | 慢 | 高 | 高压缩比需求 |

4.2 使用外部Shuffle服务

启用外部Shuffle服务可以优化Map输出的管理和传输:

<!-- yarn-site.xml -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce_shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

<!-- 调整Shuffle服务内存 -->

<property>

<name>yarn.nodemanager.aux-services.mapreduce_shuffle.classpath</name>

<value>$HADOOP_HOME/share/hadoop/mapreduce/*</value>

</property>

4.3 启用数据平衡带宽限制

避免Balancer占用过多网络资源:

# 设置Balancer带宽(单位:字节/秒)

hdfs dfsadmin -setBalancerBandwidth 104857600 # 100MB/s

# 在配置中设置默认值

<!-- hdfs-site.xml -->

<property>

<name>dfs.datanode.balance.bandwidthPerSec</name>

<value>104857600</value>

<description>平衡带宽限制,默认1MB/s</description>

</property>

4.4 公平调用队列(Fair Call Queue)

Hadoop 3.x引入的Fair Call Queue可以防止单个用户RPC请求淹没NameNode:

<!-- hdfs-site.xml -->

<property>

<name>dfs.namenode.faircallqueue.enable</name>

<value>true</value>

</property>

<property>

<name>dfs.namenode.faircallqueue.priority-thresholds</name>

<value>0.13,0.25,0.50</value>

<description>优先级阈值,超过50%的用户进入最低优先级队列</description>

</property>

<property>

<name>dfs.namenode.faircallqueue.weights</name>

<value>8,4,2,1</value>

<description>四个优先级队列的权重</description>

</property>

五、监控与诊断

5.1 网络性能监控指标

# 查看网络接口统计

sar -n DEV 1 10

# 查看TCP连接状态

netstat -s | grep -E "retrans|drop"

# 查看节点间带宽使用

iftop -i eth0

# Hadoop自带网络指标

hdfs dfsadmin -report | grep "Network"

5.2 关键监控指标解读

| 指标 | 正常范围 | 问题阈值 | 含义 |

|---|---|---|---|

| TCP重传率 | <0.5% | >2% | 网络丢包或拥塞 |

| 网络利用率 | <70% | >90% | 接近带宽上限 |

| RPC平均延迟 | <10ms | >50ms | NameNode过载 |

| Shuffle失败率 | <1% | >5% | 网络不稳定 |

| 节点本地比例 | >90% | <80% | 数据本地性差 |

5.3 诊断工具

# 网络性能诊断脚本

import subprocess

import re

def check_network_health():

# 检查重传率

netstat = subprocess.check_output(["netstat", "-s"]).decode()

retrans = re.search(r"(\d+) segments retransmitted", netstat)

total = re.search(r"(\d+) segments sent", netstat)

if retrans and total:

retrans_rate = int(retrans.group(1)) / int(total.group(1)) * 100

print(f"TCP重传率: {retrans_rate:.2f}%")

if retrans_rate > 2:

print("⚠️ 警告: 重传率过高,可能存在网络问题")

# 检查Hadoop RPC延迟

rpc_stats = subprocess.check_output([

"hdfs", "dfsadmin", "-report"

]).decode()

# 检查数据本地性

print("\n建议进一步检查:")

print("1. 查看NameNode RPC延迟: curl http://namenode:9870/jmx")

print("2. 检查Shuffle统计: yarn application -list")

print("3. 监控节点带宽: iftop -i eth0")

六、案例分析:大型集群网络优化实战

6.1 案例一:金融风控系统网络优化

背景:某银行风控系统,200节点集群,每天处理TB级交易数据。

问题:

- Shuffle阶段网络拥堵,作业执行时间波动大

- 峰值时段TCP重传率高达5%

- 部分节点网络利用率接近100%

优化方案:

- 网络架构升级:从1Gbps升级到10Gbps

- 启用Snappy压缩:Shuffle数据量减少60%

- 调整并行拷贝:从5提升到30

- 优化机架感知:重新规划机架拓扑

- 带宽限制:设置Balancer带宽为50MB/s

优化结果:

| 指标 | 优化前 | 优化后 | 提升 |

|---|---|---|---|

| 作业执行时间 | 3-5小时 | 1.5小时 | 60% |

| TCP重传率 | 5% | 0.3% | 94% |

| 峰值网络利用率 | 98% | 65% | 34% |

6.2 案例二:电商日志系统网络瓶颈

背景:某电商平台日志系统,每日处理100TB日志数据。

问题:

- Map输出压缩未启用,Shuffle数据量巨大

- Reduce任务并行拷贝数过低

- 网络成为明确瓶颈

优化方案:

- 启用Snappy压缩:Shuffle数据量从100TB降至35TB

- 并行拷贝从5提升到50

- 启用外部Shuffle服务

- 调整TCP缓冲区大小

优化结果:

| 指标 | 优化前 | 优化后 | 提升 |

|---|---|---|---|

| Shuffle数据量 | 100TB | 35TB | 65% |

| Shuffle时间 | 2.5小时 | 45分钟 | 70% |

| 总作业时间 | 4小时 | 1.5小时 | 62.5% |

七、总结:网络优化最佳实践

7.1 网络优化路线图

诊断网络瓶颈

架构优化

参数调优

技术选型

持续监控

网络拓扑规划

机架感知配置

RPC参数

Shuffle参数

TCP参数

启用压缩

外部Shuffle

公平调用队列

7.2 优化检查清单

# 网络优化检查清单

checks = [

"✓ 机架感知是否已配置?",

"✓ 数据本地性比例是否 > 90%?",

"✓ Map输出压缩是否已启用?",

"✓ Reduce并行拷贝数是否合理?(CPU核心×2)",

"✓ TCP缓冲区是否已优化?",

"✓ Balancer带宽是否已限制?",

"✓ 网络重传率是否 < 1%?",

"✓ 网络利用率是否 < 70%?"

]

7.3 最终建议

“网络优化是系统工程,需要从架构设计到参数调优层层推进。最好的网络优化,是让数据不需要传输。”

对于生产环境,建议采取分层优化策略:

- 基础层:确保网络硬件满足需求,配置机架感知

- 策略层:最大化数据本地性,减少跨节点传输

- 技术层:启用压缩,优化Shuffle参数

- 运维层:建立监控体系,及时发现网络瓶颈

互动问题:你在实际工作中遇到过哪些网络相关的性能问题?是Shuffle拥塞、RPC延迟过高,还是跨数据中心传输问题?欢迎在评论区分享你的经验和解决方案!

|

🌺The End🌺点点关注,收藏不迷路🌺

|