从指令到执行:OpenClaw 底层原理深度拆解 —— 一台真正会 “动手” 的本地 AI 引擎

前言

当我们对 OpenClaw 发出一句自然语言指令:“把桌面所有超过一周的截图归档到 D 盘,再把今天的工作记录整理成 Markdown 并推送到 GitHub。”

传统 AI 会给出步骤,而 OpenClaw 会直接做完。

绝大多数文章只告诉你 OpenClaw “能做什么”,却极少解释它到底是如何做到的:

- 一段文字,是怎么变成可执行的系统操作?

- 它凭什么能跨 IM、跨平台、跨模型统一工作?

- 高权限执行,底层是如何保证安全与可控?

- 本地运行、隐私闭环,在架构上究竟如何实现?

本文不讲功能、不讲教程,只讲原理。从意图解析、任务编排、执行引擎、权限沙箱到多模态交互,带你从 0 到 1 理解 OpenClaw 的技术本质:它不是一个聊天机器人,而是一套本地优先、可解释、可审计、可落地的任务执行系统。

全文约 8000 字,硬核但不晦涩,适合开发者、架构师与对 AI 智能体真正好奇的读者。

一、先破题:OpenClaw 到底在解决什么底层问题?

在讲原理之前,我们必须先定义一个核心命题:

传统 LLM 与 OpenClaw 的本质区别是什么?

- LLM = 语言理解与生成机器(大脑)

- OpenClaw = 语言理解 + 任务规划 + 环境感知 + 动作执行 + 结果反馈 + 记忆闭环(完整智能体)

传统 AI 只能输出符号(文本),OpenClaw 输出的是动作(Action)。

它要解决的,是 AI 领域三个长期悬而未决的底层难题:

- 意图落地问题:自然语言 → 结构化任务 → 可执行流程

- 环境交互问题:AI 如何安全、稳定地读写文件、调用系统、操控浏览器、访问网络

- 信任与隐私问题:所有逻辑不黑盒、不上云、可审计、可中断、可回滚

OpenClaw 的整套架构、数据流、权限模型、插件系统,全部围绕这三点展开。

我们可以用一句话概括它的原理内核:OpenClaw = 本地网关 + 意图引擎 + 执行器抽象层 + 能力插件系统 + 安全沙箱 + 持久记忆

下面逐层拆开。

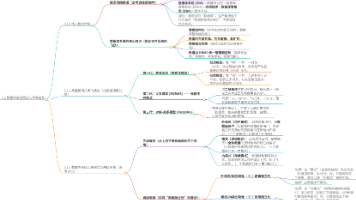

二、整体架构原理:单网关,全链路,本地优先

OpenClaw 最精妙的地方,是它极其简洁、又极其稳定的宏观架构。它没有复杂的微服务、分布式、消息队列,而是一套单机中心化架构。

2.1 四层架构(原理版)

-

接入层(Input Adaptor)负责把所有外部消息统一转换成内部标准格式。无论来自 Telegram、WhatsApp、飞书、WebUI,最终都变成同一种 Intent 结构。

-

意图与规划层(Intent Engine & Planner)这是 OpenClaw 的 “大脑”。负责:理解你要干什么 → 拆分子任务 → 决定调用哪些能力 → 编排执行顺序。

-

执行抽象层(Execution Abstraction Layer)这是 OpenClaw 最核心的创新。它不直接调用系统 API,而是封装一层统一的 Action 接口:

read_file、write_file、run_shell、browser_navigate、api_request……上层只发 Action,下层负责具体实现。这让它跨平台、跨环境、可测试、可拦截。 -

能力与沙箱层(Capability & Sandbox)真正和操作系统、硬件、第三方服务打交道的地方。所有高危操作都在这里被权限检查、日志记录、风险拦截。

2.2 数据流一句话原理

外部消息 → 标准化 → 意图识别 → 任务规划 → 生成 Action → 权限校验 → 执行 → 结果收集 → 自然语言回复 → 记忆入库

整个流程完全本地流转,除非你主动配置外部模型或 API,否则不离开你的设备。

这就是 “本地优先” 的架构原理,不是宣传语。

三、意图引擎原理:自然语言是如何变成 “任务” 的?

这是 OpenClaw 最关键的一步:把人类模糊、口语化、跳跃式的指令,变成机器能执行的结构化任务。

3.1 三步意图解析原理

(1)输入归一化(Input Normalization)

不管你从哪里发消息:

- 纯文本

- 图片 + 文字

- 语音转文字

- 艾特 AI、群聊、私聊

OpenClaw 先做一件事:清洗与结构化。它会提取:

- 消息内容

- 发送者、渠道、上下文 ID

- 附件、路径、链接

- 历史对话片段

最终输出一个标准结构:

plaintext

{

"user_id": "xxx",

"session_id": "xxx",

"content": "整理桌面截图",

"attachments": [...],

"context": [...]

}

原理:统一输入,才能统一处理。

(2)意图分类与槽位填充(Intent Classification + Slot Filling)

这是 NLU(自然语言理解)的经典范式,OpenClaw 把它轻量化落地到本地。

它会判断:

- 你是想查信息?

- 还是操作文件?

- 还是控制浏览器?

- 还是写代码、部署、发消息?

同时提取关键参数(槽位):

- 动作:归档 / 删除 / 移动 / 生成 / 发送

- 对象:桌面 / 截图 / 7 天前 / Markdown 文件

- 目标路径:D 盘 / Backup/2026

- 约束:不要删除源文件 / 只处理截图

例如:“把桌面最近一周的截图归档到 D 盘截图文件夹”

会被解析为:

plaintext

intent: archive_files

slots:

source: ~/Desktop

type: screenshot

time_range: 7d

target: D:/截图

strategy: move

原理:自然语言不可执行,结构化指令才可执行。

(3)任务规划(Task Planning)

当指令复杂时,OpenClaw 会自动拆成 DAG(有向无环图)任务链。

比如:“整理截图 → 生成日志 → 推送到 GitHub”

Planner 会生成:

- 扫描桌面文件

- 过滤截图 & 时间

- 创建目标目录(不存在则新建)

- 移动 / 复制文件

- 生成操作记录

- 写入 README.md

- 执行 git add/commit/push

- 把结果返回给用户

每一步都有:

- 前置条件

- 依赖任务

- 失败策略(重试 / 跳过 / 终止 / 回滚)

原理:复杂任务 = 原子动作 + 顺序 + 依赖 + 异常处理。

到这里,OpenClaw 还没有碰过任何系统文件。它只是在内存里,把你的话,翻译成了一套可执行任务清单。

四、执行抽象层原理:为什么 OpenClaw 能 “跨平台安全动手”?

这是 OpenClaw 区别于 99% AI 玩具项目的核心技术点:执行抽象层(Execution Abstraction Layer,EAL)

4.1 为什么要抽象?

如果让 AI 直接写系统命令:

- Windows /macOS/ Linux 命令完全不同

- 直接拼接命令极易出现命令注入

- 无法统一权限控制

- 无法日志审计

- 无法安全拦截

所以 OpenClaw 做了一件极聪明的事:上层只调用 “动作”,不关心底层怎么实现。

4.2 动作系统原理(Action System)

OpenClaw 内部定义了一套平台无关的动作标准:

file_readfile_writefile_listfile_moveshell_runbrowser_gotobrowser_extractapi_requestschedule_task

Planner 输出的不是命令,而是Action + 参数。

例如:

plaintext

action: file_move

params:

from: ~/Desktop/xxx.png

to: D:/screenshot/2026/xxx.png

然后 EAL 根据当前系统:

- Windows → 调用 Kernel32 /.NET 封装

- macOS / Linux → 调用 POSIX API 或 Node.js fs

原理:抽象 = 跨平台 + 安全 + 可审计。

4.3 执行器(Executor)工作流程

每一个 Action 都会经过固定流程:

- 权限检查:是否允许访问该路径 / 该能力

- 参数校验:是否越界、是否非法路径、是否高危

- 执行:调用系统或浏览器

- 结果标准化:成功 / 失败、输出、错误信息

- 日志记录:谁、何时、执行了什么、结果如何

- 返回给 Planner:决定下一步做什么

这就是 OpenClaw 能安全操作电脑的底层原理。不是靠信任,是靠架构约束。

五、系统操作与文件能力原理:AI 是如何安全读写你的电脑?

很多人好奇:OpenClaw 读写文件、执行命令,到底是怎么实现的?会不会乱删东西?

我们拆开最敏感的两个模块:文件系统与Shell 执行。

5.1 文件系统能力原理

OpenClaw 不直接暴露底层 fs,而是提供受限文件访问。

核心机制:

-

路径白名单 / 黑名单可配置:只允许操作 桌面、文档、指定目录禁止访问系统盘关键路径、其他用户目录

-

路径规范化自动解析

../穿透,防止路径穿越攻击所有路径转为绝对路径,统一判断 -

操作类型权限可单独开关:

- 只读

- 新建

- 修改

- 删除

- 重命名

-

原子化与可恢复重要操作支持先复制到临时目录,再替换部分操作支持 “回收站” 而不是直接删除

原理:最小权限 + 路径沙箱 + 操作审计 = 可控的文件能力。

5.2 Shell / 命令执行原理

这是最高风险能力,OpenClaw 的设计非常保守。

原理:

- 默认关闭,必须用户显式开启

- 命令不允许动态拼接,由 AI 生成结构化命令

- 支持命令白名单:只允许 git、ls、dir、ping 等安全命令

- 禁止交互式终端,只允许一次性命令

- 超时控制,防止卡死

- 全量日志 + 危险关键词拦截(rm -rf / 等)

它不是让 AI 随便敲命令,而是:AI 提出命令请求 → 检查风险 → 允许 / 拒绝 → 执行 → 捕获输出 → 返回结果

这就是它能在个人电脑上安全运行的原因。

六、浏览器自动化原理:AI 如何 “上网干活”?

OpenClaw 另一个杀手级功能:操控浏览器。登录、填表、爬数据、点按钮、导出报表,全部能自动完成。

6.1 底层技术栈原理

本质是:Playwright / CDP(Chrome DevTools Protocol)但 OpenClaw 再次做了抽象,不让 AI 直接写 JS。

6.2 浏览器 Action 原理

Planner 生成标准化浏览器动作:

browser_navigate(url)browser_fill(selector, value)browser_click(selector)browser_extract_text(selector)browser_screenshot()browser_download_wait()

执行器:

- 启动浏览器(或接管已有实例)

- 加载页面

- 等待元素可交互

- 执行操作

- 提取内容

- 返回结构化数据给 Planner

AI 不需要懂 CSS 选择器、不需要懂异步加载。OpenClaw 在底层自动处理等待、重试、异常。

6.3 网页任务闭环原理

比如:“登录后台,导出今天订单”

- 导航到登录页

- 填写用户名密码(从安全配置中读取,不暴露给 LLM)

- 点击登录

- 导航到订单页

- 提取表格

- 转换成 JSON/Excel

- 保存到本地

- 回复用户:已完成,路径 xxx

原理:浏览器 = 另一种可标准化的执行环境。

七、多模型调度原理:不绑定厂商,本地 / 云端自由切换

OpenClaw 官方从不强迫你用某一家模型,这是架构决定的,不是功能。

7.1 模型抽象层原理

它在 LLM 外面包了一层 LLM Provider:

- OpenAI

- Anthropic

- 通义千问 / 文心一言 / 讯飞星火

- 本地 LLaMA、Qwen、Llama 3、Mistral

上层 Planner 只调用统一接口:

plaintext

completion(messages, tools, temperature)

下层负责把请求转换成对应厂商的 API 格式。

7.2 本地模型原理

如果你选择完全本地:

- 模型文件在本地

- 推理在本地

- 数据不上传

- OpenClaw 只做任务编排

这就是真正隐私部署的原理:模型与执行,都在你设备内闭环。

7.3 Tool Calling(函数调用)原理

OpenClaw 能 “动手”,关键依赖 LLM 的 Tool Calling 能力。原理流程:

- 系统向 LLM 提供工具列表(file、shell、browser、git…)

- LLM 判断:需要调用哪些工具

- LLM 返回:工具名 + 参数

- OpenClaw 执行

- 把结果返回 LLM

- LLM 继续规划,直到任务完成

这就是ReAct 范式的工程化落地:Reason → Act → Observe → Repeat

八、插件系统原理:为什么 OpenClaw 可以无限扩展?

你看到的 “几百个能力”,本质来自一套稳定、低耦合、类型安全的插件系统。

8.1 插件架构原理

每个插件都是一个独立包,只做三件事:

- 声明提供什么 Action

- 声明需要什么权限

- 实现执行逻辑

插件结构极简:

plaintext

- plugin.json

- name

- description

- actions: [read_file, write_file...]

- permissions: [...]

- index.ts

export default {

async run(action, params, context) { ... }

}

8.2 热插拔原理

- 插件可以独立安装、卸载、更新

- 不影响核心网关

- 不破坏系统稳定性

- 权限独立控制

原理:能力插件化 = 无限扩展 + 安全隔离 + 生态可生长。

九、权限与安全沙箱原理:高权限 AI 的生命线

OpenClaw 敢给 AI 操作电脑的能力,不是大胆,是安全架构成熟。

9.1 权限模型核心原理

-

最小权限原则默认只给最基础能力,文件只读,禁止 Shell。

-

按渠道分权私聊 / 群聊 / 不同 IM → 不同权限组群里任何人都不能让 AI 删你文件。

-

按动作分权你可以精确到:

- 允许读取桌面

- 禁止写入桌面

- 允许浏览器访问指定域名

- 禁止执行任何命令

-

二次确认机制(原理)高危动作:删除文件、格式化、命令执行、批量操作流程:AI 提议 → 系统拦截 → 发送确认卡片 → 用户确认 → 执行

-

全链路审计日志谁、何时、什么意图、执行什么动作、结果如何全部本地记录,可查、可追溯、可问责。

9.2 为什么 OpenClaw 不容易 “发疯乱操作”?

因为:

- AI 不直接控制系统

- AI 只生成动作请求

- 真正执行的是权限引擎 + 执行器

- 任何一步不满足,都会被拦截

安全不靠模型对齐,靠架构硬隔离。

十、记忆系统原理:为什么 OpenClaw 越用越懂你?

OpenClaw 不是用完即忘的聊天机器人,它有短期 + 长期记忆系统。

10.1 短期记忆(上下文)原理

- 按 Session 管理

- 自动截断、压缩、摘要

- 保证 LLM 输入不超限

- 支持多轮复杂任务(比如先查资料、再写文档、再推送)

10.2 长期记忆(用户偏好)原理

本地存储结构化信息:

- 常用路径

- 邮箱、用户名(安全存储,不暴露给 LLM 明文)

- 习惯格式(Markdown/Excel/Word)

- 常用仓库、服务器地址

- 禁止操作列表

下一次指令来时,记忆系统自动注入相关偏好,无需重复设置。

原理:记忆 = 更少指令 + 更高准确率 + 更像真人助理。

十一、多 IM 接入原理:一个网关,统一所有入口

OpenClaw 可以同时跑在 Telegram、WhatsApp、飞书、WebUI 等平台。

原理非常简单:每一个平台只是一个适配器(Adaptor)。

适配器只做两件事:

- 把外部消息 → 转为内部标准消息

- 把内部回复 → 转为对应平台的格式(文本 / 图片 / 文件 / 卡片)

核心网关完全不用关心消息来自哪里。这就是高扩展性、低维护成本的架构原理。

十二、总结:OpenClaw 的本质,是一套 “本地执行操作系统”

回到最开始的问题:OpenClaw 到底是什么?

从原理角度,它不是 “增强版 ChatGPT”。它是:

一套面向个人设备的、标准化的、安全的、可扩展的 AI 执行系统。

它的真正价值:

-

把自然语言变成了新的 “操作系统交互方式”未来你不再点鼠标、找文件夹、输命令,你只需要说:帮我做。

-

把 AI 从 “输出文本” 变成 “输出结果”文本是中间态,结果才是目的。

-

把隐私与能力同时带回本地不依赖云、不依赖厂商、不把敏感数据交给任何人。

-

把智能体从论文变成可落地的工程系统ReAct、Tool Use、Planning、Sandbox、Memory……OpenClaw 把学术界最前沿的范式,全部做成了普通人可用的产品。

结语:下一个时代,是 AI 真正 “动手” 的时代

过去十年,AI 学会了看、听、说、写。未来十年,AI 会真正学会做事。

OpenClaw 代表的不是一个工具,而是一个方向:AI 不再漂浮在云端,而是落地在你的设备里,成为你可信任、可控制、可依靠的执行伙伴。

当你理解了它的原理,你就不会再惊讶于它能整理文件、操控浏览器、写代码、部署项目、生成报表、管理日程。因为你知道:它不是魔法,它是架构、抽象、安全、执行、记忆共同构建的必然结果。

如果你是开发者,你可以顺着这套原理,实现自己的智能体、自己的插件、自己的权限系统、自己的私有 AI 引擎。如果你是普通用户,你至少可以明白:你用的不是一个玩具,而是一台真正严谨、现代、安全的本地 AI 执行引擎。