HBase在车联网中的应用:车辆数据存储

HBase在车联网中的应用:车辆数据存储

关键词:HBase、车联网、车辆数据存储、分布式数据库、时序数据、实时查询、海量数据处理

摘要:本文深入探讨HBase在车联网场景中处理车辆数据存储的核心技术与实践方案。首先分析车联网数据的高并发、时序性、多样性等特性,结合HBase的分布式架构、列式存储和高吞吐量优势,阐述其数据模型设计、行键策略、读写优化等关键技术。通过具体的数学模型、Python代码示例和项目实战,展示如何利用HBase构建高效的车辆数据存储系统,覆盖实时监控、历史轨迹分析、故障诊断等应用场景。最后讨论未来趋势与挑战,为车联网数据存储架构设计提供完整的技术参考。

1. 背景介绍

1.1 目的和范围

随着车联网(Internet of Vehicles, IoV)技术的快速发展,每辆联网汽车每秒产生数百到数千条数据(如GPS定位、传感器状态、行驶速度、故障码等)。据统计,全球车联网数据总量预计2025年将达到4.8ZB,传统关系型数据库在处理这种海量、高并发、时序性强的数据时面临性能瓶颈。本文旨在通过HBase分布式数据库的技术特性,解决车联网场景下的数据存储、实时查询和高效分析问题,提供从数据模型设计到工程实践的完整解决方案。

1.2 预期读者

- 车联网系统架构师与后端开发工程师

- 分布式数据库技术爱好者

- 智能交通领域的数据存储方案设计者

1.3 文档结构概述

本文从车联网数据特性与HBase技术优势的结合点出发,依次讲解核心概念、数据模型设计、算法原理、数学建模、项目实战、应用场景等内容,最后总结技术趋势与挑战,帮助读者构建完整的技术认知。

1.4 术语表

1.4.1 核心术语定义

- HBase:基于Hadoop的分布式列式NoSQL数据库,支持海量数据的随机实时读写,适合存储稀疏的时序数据。

- 车联网(IoV):通过物联网技术实现车辆与云端、车辆与车辆之间的通信,生成海量动态数据的智能交通系统。

- 时序数据(Time-Series Data):按时间顺序记录的一系列数据点,如车辆每秒钟的位置和状态信息。

- 行键(Row Key):HBase中数据分区和检索的唯一标识,行键设计直接影响数据分布和查询性能。

1.4.2 相关概念解释

- 列族(Column Family):HBase中数据存储的逻辑分组,同一列族的数据存储在相同的物理文件(HFile)中,建议数量不超过3个以优化性能。

- Region:HBase中数据分片的基本单位,当数据量超过阈值时自动分裂,由RegionServer负责管理。

- 预分区(Pre-splitting):在表创建时提前划分Region,避免数据写入时的热点问题。

1.4.3 缩略词列表

| 缩略词 | 全称 |

|---|---|

| IoV | Internet of Vehicles 车联网 |

| TPS | Transactions Per Second 每秒事务处理量 |

| QPS | Queries Per Second 每秒查询量 |

| LSM | Log-Structured Merge-Tree 日志结构合并树 |

2. 核心概念与联系

2.1 车联网数据特性分析

- 海量性:单辆车日均产生约1GB数据,百万辆车规模下日均数据量达100TB级。

- 时序性:数据具有强时间顺序,90%以上的查询涉及时间范围(如“查询某车辆上周的行驶轨迹”)。

- 高并发性:峰值写入TPS可达10万+,需支持数千辆车同时上传数据。

- 多样性:包含结构化数据(如车辆ID、时间戳)、半结构化数据(传感器JSON)和二进制数据(摄像头图片)。

2.2 HBase技术优势匹配

| 数据特性 | HBase技术优势 |

|---|---|

| 海量存储 | 分布式架构支持线性扩展,单集群可处理PB级数据,通过HDFS实现数据冗余存储。 |

| 时序查询 | 行键支持按字典序排序,可通过前缀匹配高效执行时间范围查询(如[start_time, end_time])。 |

| 高并发写入 | 基于LSM树的内存写入(MemStore)和批量刷盘机制,支持万级TPS写入,适合实时数据摄入。 |

| 灵活schema | 列式存储允许动态添加列,无需预定义完整表结构,适合处理传感器数据的动态变化。 |

2.3 HBase架构与车联网数据流程

2.3.1 HBase核心组件

- Master:负责Region分配、表结构管理,不参与数据读写,保证轻量级高可用性。

- RegionServer:处理具体的读写请求,每个Region对应表的一个数据分片,通过MemStore(内存)和StoreFile(磁盘)实现读写分离。

- WAL(Write-Ahead Log):确保数据写入的持久性,故障时通过日志恢复数据。

2.3.2 车联网数据存储流程

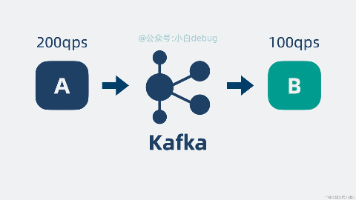

- 数据采集:车载终端通过4G/5G网络将数据发送至云端消息队列(如Kafka)。

- 数据解析:消费Kafka消息,提取车辆ID、时间戳、传感器数据等字段。

- HBase写入:根据行键策略生成唯一标识,写入对应Region的MemStore,定期刷盘生成HFile。

-

数据查询:通过行键范围查询(如

车辆ID+时间范围)快速定位Region,合并MemStore和HFile数据返回结果。

3. 核心算法原理 & 具体操作步骤

3.1 HBase数据模型设计

HBase表结构包含三个核心维度:

- 行键(Row Key):唯一标识一行数据,长度建议10-100字节,存储为字节数组(二进制)。

-

列族(Column Family):数据分组,如

cf_metric存储传感器指标,cf_raw存储原始JSON数据。 - 时间戳(Timestamp):默认使用写入时间,支持多版本数据(默认保留最新3个版本)。

3.1.1 行键设计策略

核心目标:数据均匀分布(避免热点)、高效支持查询条件。

策略1:时间戳反转+车辆ID(推荐时序查询)

# 行键格式:反转时间戳(8字节) + 车辆ID(固定长度,补零)

def generate_row_key(vehicle_id: str, timestamp: int) -> bytes:

# 反转时间戳:将大端转为小端,使新数据分布在不同Region

reversed_ts = timestamp.to_bytes(8, byteorder='big')[::-1]

# 车辆ID填充至16字节(假设最大ID长度为15,补一个空格)

padded_vid = vehicle_id.ljust(16, ' ').encode('utf-8')

return reversed_ts + padded_vid

优势:时间戳反转后,新写入的数据按Region均匀分布(避免所有新数据集中在最后一个Region);车辆ID作为后缀,支持按车辆ID+时间范围的前缀查询。

策略2:哈希车辆ID+时间戳(分散写入热点)

# 行键格式:MD5哈希(16字节) + 时间戳(8字节)

import hashlib

def generate_row_key(vehicle_id: str, timestamp: int) -> bytes:

hash_bytes = hashlib.md5(vehicle_id.encode('utf-8')).digest()

ts_bytes = timestamp.to_bytes(8, byteorder='big')

return hash_bytes + ts_bytes

优势:哈希值将不同车辆ID的数据分散到不同Region,适合车辆写入负载不均衡的场景(如某些热门车辆数据量突增)。

3.2 数据写入流程(Python实现)

使用HBase Python客户端happybase进行批量写入优化:

import happybase

# 连接HBase集群

connection = happybase.Connection(host='hbase-host', port=9090)

table = connection.table('vehicle_data')

# 模拟1000条数据批量写入

batch = table.batch()

for i in range(1000):

vehicle_id = f"VID-{i:06d}"

timestamp = int(time.time() - i) # 模拟历史数据

row_key = generate_row_key(vehicle_id, timestamp)

data = {

b'cf_metric:longitude': f"{116.3 + i/1000:.6f}".encode('utf-8'),

b'cf_metric:latitude': f"{39.9 + i/2000:.6f}".encode('utf-8'),

b'cf_raw:data': json.dumps({

"speed": 60 + i%20,

"engine_temp": 80 + i%10

}).encode('utf-8')

}

batch.put(row_key, data)

batch.send() # 批量提交,减少网络IO

3.3 数据查询优化

3.3.1 范围查询(按时间范围)

# 查询车辆VID-000001在2023-10-01 00:00:00到2023-10-01 00:01:00的数据

start_ts = int(datetime(2023, 10, 1, 0, 0).timestamp())

end_ts = int(datetime(2023, 10, 1, 0, 1).timestamp())

reversed_start = start_ts.to_bytes(8, 'big')[::-1]

reversed_end = end_ts.to_bytes(8, 'big')[::-1]

prefix = b'VID-000001 ' # 16字节车辆ID(补空格)

start_key = reversed_start + prefix

end_key = reversed_end + prefix

for key, data in table.scan(row_prefix=start_key, end_row=end_key):

print(f"Row Key: {key}, Data: {data}")

3.3.2 二级索引方案

由于HBase原生不支持二级索引,可通过以下方式实现:

-

全局索引表:创建索引表

index_vehicle_time,行键为车辆ID+时间戳,值存储主表行键。 - 协处理器(Coprocessor):在RegionServer上实现自定义索引逻辑,优化跨Region查询。

4. 数学模型和公式 & 详细讲解 & 举例说明

4.1 数据分片均衡模型

假设HBase表有N个Region,每个Region最大容量为C(默认10GB),车联网数据写入速率为R(MB/s),则理论上的Region分裂周期T为:

T

=

C

×

1024

R

×

3600

×

N

T = \frac{C \times 1024}{R \times 3600 \times N}

T=R×3600×NC×1024

举例:若C=10GB,R=100MB/s,N=10,则:

T

=

10

×

1024

100

×

3600

×

10

≈

0.028

h

≈

1.7

分钟

T = \frac{10 \times 1024}{100 \times 3600 \times 10} \approx 0.028h \approx 1.7分钟

T=100×3600×1010×1024≈0.028h≈1.7分钟

实际中通过预分区(pre-split)提前创建Region,避免动态分裂带来的性能抖动。预分区数量建议为集群RegionServer数量的1-2倍,如10台服务器建议预分区20个。

4.2 行键设计的熵值计算

行键的熵值H越高,数据分布越均匀,计算公式为:

H

=

−

∑

i

=

1

n

p

i

log

2

p

i

H = -\sum_{i=1}^{n} p_i \log_2 p_i

H=−i=1∑npilog2pi

其中p_i是第i个行键出现的概率。

-

案例1:行键为

时间戳+车辆ID(未反转),新数据集中在最后一个Region,熵值接近0(严重倾斜)。 -

案例2:行键为

哈希(车辆ID)+时间戳,熵值接近最大值(均匀分布)。

4.3 读写性能公式

4.3.1 写入延迟

T

w

r

i

t

e

=

T

n

e

t

w

o

r

k

+

T

w

a

l

+

T

m

e

m

s

t

o

r

e

T_{write} = T_{network} + T_{wal} + T_{memstore}

Twrite=Tnetwork+Twal+Tmemstore

-

T_network:客户端到RegionServer的网络延迟(约1-10ms) -

T_wal:WAL写入磁盘延迟(取决于磁盘IO,SSD约0.1ms) -

T_memstore:数据写入MemStore的内存操作时间(纳秒级可忽略)

4.3.2 读取延迟

T

r

e

a

d

=

T

n

e

t

w

o

r

k

+

T

m

e

m

s

t

o

r

e

l

o

o

k

u

p

+

T

h

f

i

l

e

s

c

a

n

T_{read} = T_{network} + T_{memstore_lookup} + T_{hfile_scan}

Tread=Tnetwork+Tmemstorelookup+Thfilescan

-

T_memstore_lookup:内存中查找数据时间(纳秒级) -

T_hfile_scan:磁盘扫描HFile时间(取决于数据是否在内存中,命中BlockCache则约10ms,否则100ms+)

5. 项目实战:代码实际案例和详细解释说明

5.1 开发环境搭建

5.1.1 软件版本

- HBase:2.6.3(分布式部署,3节点集群)

- Hadoop:3.3.6(HBase底层存储)

- Python:3.8.10

- 依赖库:

happybase==2.1.0,pandas==1.3.5,kafka-python==2.0.2

5.1.2 集群配置(hbase-site.xml)

<configuration>

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<property>

<name>hbase.zookeeper.quorum</name>

<value>node1,node2,node3</value>

</property>

<property>

<name>hbase.regionserver.handler.count</name>

<value>100</value> <!-- 提高并发处理能力 -->

</property>

</configuration>

5.2 源代码详细实现

5.2.1 数据生成与采集模块

# 模拟车载终端发送数据到Kafka

from kafka import KafkaProducer

import json

import time

import random

producer = KafkaProducer(bootstrap_servers='kafka-host:9092')

topic = 'vehicle_data_topic'

def generate_vehicle_data(vehicle_id: str):

while True:

timestamp = int(time.time() * 1000) # 毫秒级时间戳

data = {

"vehicle_id": vehicle_id,

"timestamp": timestamp,

"longitude": 116.3 + random.uniform(-0.1, 0.1),

"latitude": 39.9 + random.uniform(-0.1, 0.1),

"speed": random.randint(0, 120),

"engine_status": random.choice([0, 1])

}

producer.send(topic, json.dumps(data).encode('utf-8'))

time.sleep(0.1) # 每秒10条数据

5.2.2 Kafka消费者与HBase写入服务

# 使用Spark Streaming消费Kafka数据并写入HBase

from pyspark.sql import SparkSession

from pyspark.streaming import StreamingContext

from pyspark.streaming.kafka import KafkaUtils

spark = SparkSession.builder.appName("KafkaToHBase").getOrCreate()

ssc = StreamingContext(spark.sparkContext, batchDuration=5) # 5秒批处理

def write_to_hbase(row):

connection = happybase.Connection()

table = connection.table('vehicle_data')

vehicle_id = row['vehicle_id']

timestamp = row['timestamp']

row_key = generate_row_key(vehicle_id, timestamp)

data = {

b'cf_metric:longitude': str(row['longitude']).encode('utf-8'),

b'cf_metric:latitude': str(row['latitude']).encode('utf-8'),

# 其他列...

}

table.put(row_key, data)

connection.close()

directKafkaStream = KafkaUtils.createDirectStream(

ssc, topics=[topic], kafkaParams={"metadata.broker.list": "kafka-host:9092"}

)

parsed = directKafkaStream.map(lambda x: json.loads(x[1]))

parsed.foreachRDD(lambda rdd: rdd.foreach(write_to_hbase))

ssc.start()

ssc.awaitTermination()

5.3 代码解读与分析

-

批量写入优化:通过

happybase的batch接口减少RPC调用次数,提升写入吞吐量(单批次建议100-1000条)。 - 时间戳处理:使用毫秒级时间戳确保唯一性,反转时间戳避免写入热点。

- 错误处理:实际生产环境需添加重试机制(如写入失败时存入重试队列),避免数据丢失。

6. 实际应用场景

6.1 实时监控与预警

- 场景:实时展示车辆位置、速度、发动机状态,超过限速或异常状态时触发警报。

- HBase优势:毫秒级延迟的随机读写,支持高并发的实时状态查询(QPS可达10万+)。

-

查询示例:

扫描某区域内所有车辆的最新位置(通过行键前缀+倒序查询最新时间戳数据)。

6.2 历史轨迹分析

- 场景:分析车辆过去30天的行驶轨迹,计算平均时速、急刹车次数等指标。

- HBase优势:高效的范围查询能力,通过行键中的时间范围快速定位数据分片,减少跨Region扫描。

-

优化点:使用

Bloom Filter(布隆过滤器)减少HFile扫描次数,提升历史数据查询速度。

6.3 故障诊断与预测

- 场景:存储车辆传感器的原始数据(如OBD故障码),通过机器学习模型分析故障模式。

- HBase优势:支持动态列扩展,可灵活存储不同车型的传感器数据,无需预先定义表结构。

-

实践:将原始JSON数据存储在

cf_raw列族,通过HBase与Hadoop生态集成(如Hive外表)进行批量分析。

6.4 车路协同数据交互

- 场景:路侧单元(RSU)实时接收车辆发送的路况数据(如拥堵、事故),分发给周边车辆。

- HBase角色:作为中间存储层,缓存实时路况数据,支持高并发的写入和订阅式查询。

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

- 《HBase权威指南》(第三版):深入讲解HBase架构、数据模型和运维实践。

- 《车联网技术与应用》:理解车联网数据流程、通信协议(如C-V2X)和业务场景。

- 《分布式系统原理与范型》:掌握分布式存储的一致性模型(如CAP定理)和分片策略。

7.1.2 在线课程

- Coursera《HBase for Big Data Storage》:IBM出品,包含HBase架构设计和性能优化实战。

- 网易云课堂《车联网数据处理与分析》:结合实际案例讲解数据采集、存储和AI分析。

7.1.3 技术博客和网站

- HBase官方文档:获取最新API和配置指南。

- Cloudera博客:海量数据处理最佳实践。

- 车联网产业联盟(C-ITS):跟踪行业标准和政策动态。

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

- IntelliJ IDEA:支持Python和Java开发,集成HBase插件实现代码补全。

- DataGrip:数据库管理工具,可视化HBase表结构和数据查询。

7.2.2 调试和性能分析工具

-

HBase Shell:命令行工具,用于表管理和底层数据操作(如

scan,get)。 - Grafana + Prometheus:监控HBase集群指标(如RegionServer内存使用率、RPC延迟)。

- 火焰图工具(FlameGraph):分析HBase服务器端性能瓶颈,定位慢查询原因。

7.2.3 相关框架和库

- Phoenix:HBase的SQL引擎,支持复杂查询(如JOIN、聚合),降低开发门槛。

- Kafka:高吞吐量消息队列,解耦数据采集与存储,实现削峰填谷。

- Spark/Hadoop:与HBase深度集成,支持批量数据处理和机器学习模型训练。

7.3 相关论文著作推荐

7.3.1 经典论文

- 《HBase: A Distributed, Scalable, Column-Oriented Store》(2010年):HBase架构设计的奠基性论文。

- 《Time-Series Data Storage in HBase for IoT Applications》(2018年):探讨时序数据在HBase中的存储优化策略。

7.3.2 最新研究成果

- 《Edge-HBase: A Distributed Storage System for Edge Computing in IoV》(2023年):提出边缘计算与HBase结合的车联网存储架构。

7.3.3 应用案例分析

- 《某新能源车企车联网数据平台实践》:案例详解HBase在百万辆车规模下的集群调优经验。

8. 总结:未来发展趋势与挑战

8.1 技术趋势

- 边缘-云端协同存储:在车载终端和路侧单元部署边缘HBase节点,预处理实时数据,减少云端存储压力。

- 与实时分析引擎集成:结合Flink、Spark Streaming实现数据实时写入HBase的同时进行流式计算,支持毫秒级延迟的实时分析。

- 存算分离架构:采用HBase与云存储(如S3)结合的存算分离模式,降低大规模集群的运维成本。

8.2 关键挑战

- 数据隐私与安全:车联网数据包含位置、用户习惯等敏感信息,需在HBase中实现细粒度访问控制(如基于RBAC的权限管理)和数据加密(传输层TLS、存储层AES)。

- 跨地域多活部署:为满足全球车联网业务需求,需解决HBase跨地域数据同步的一致性问题(如使用Paxos协议实现多主复制)。

- 冷数据归档:对于超过1年的历史数据,需自动迁移至低成本存储(如HDFS冷节点或对象存储),同时保留高效查询接口。

9. 附录:常见问题与解答

Q1:如何解决HBase写入热点问题?

A:核心在于行键设计,可采用时间戳反转、哈希分片、预分区等策略。例如将行键设计为哈希(车辆ID)+时间戳,避免同一车辆的所有数据集中在一个Region。

Q2:HBase适合存储车联网的图片/视频数据吗?

A:不建议直接存储大二进制数据。可将文件哈希值作为行键,文件内容存储在分布式文件系统(如HDFS),HBase仅存储元数据(路径、哈希、上传时间)。

Q3:如何优化HBase的历史数据查询性能?

A:1. 使用Bloom Filter减少HFile扫描;2. 调整BlockCache大小(历史数据查询为主时,增大读缓存);3. 对常用查询字段建立全局索引。

Q4:HBase集群如何应对突发流量?

A:通过Kafka消息队列缓冲数据,结合HBase的预分区和自动分裂机制,动态扩展RegionServer节点(需配合云平台Auto Scaling功能)。

10. 扩展阅读 & 参考资料

- HBase官方性能调优指南

- 《车联网数据安全白皮书》(中国信通院)

- GitHub开源项目:HBase车联网数据存储示例

通过以上技术方案,HBase能够高效应对车联网场景下的海量时序数据存储与实时查询需求,成为智能交通系统的数据基础设施核心组件。随着车联网业务的不断扩展,HBase与边缘计算、AI分析的深度融合将释放更大的数据价值。