大数据领域的分布式文件系统

大数据领域的分布式文件系统

关键词:大数据、分布式文件系统、HDFS、Ceph、GlusterFS、架构原理、应用场景

摘要:本文围绕大数据领域的分布式文件系统展开,首先介绍了分布式文件系统的背景,包括其目的、适用读者、文档结构和相关术语。接着阐述了核心概念与联系,通过示意图和流程图展示其架构。详细讲解了核心算法原理及具体操作步骤,并给出Python代码示例。深入分析了数学模型和公式,辅以举例说明。通过项目实战,从开发环境搭建到源代码实现及解读,让读者了解分布式文件系统的实际应用。探讨了其在不同场景下的应用,推荐了学习资源、开发工具框架和相关论文著作。最后总结了未来发展趋势与挑战,并提供常见问题解答和扩展阅读参考资料。

1. 背景介绍

1.1 目的和范围

在大数据时代,数据量呈现爆炸式增长,传统的文件系统难以满足大规模数据存储和高效访问的需求。分布式文件系统应运而生,它将数据分散存储在多个节点上,通过网络进行统一管理和访问,提高了数据的可靠性、可扩展性和读写性能。本文的目的是全面介绍大数据领域的分布式文件系统,包括其核心概念、算法原理、实际应用等方面,范围涵盖常见的分布式文件系统如HDFS、Ceph、GlusterFS等。

1.2 预期读者

本文预期读者包括大数据领域的开发人员、数据分析师、系统管理员以及对分布式文件系统感兴趣的技术爱好者。对于有一定编程基础和操作系统知识的读者,能够更好地理解本文的内容。

1.3 文档结构概述

本文将按照以下结构进行组织:首先介绍分布式文件系统的核心概念与联系,包括其架构和工作原理;接着详细讲解核心算法原理和具体操作步骤,并给出Python代码示例;然后分析数学模型和公式,通过举例加深理解;进行项目实战,展示如何搭建开发环境、实现源代码并进行解读;探讨分布式文件系统的实际应用场景;推荐相关的学习资源、开发工具框架和论文著作;最后总结未来发展趋势与挑战,提供常见问题解答和扩展阅读参考资料。

1.4 术语表

1.4.1 核心术语定义

- 分布式文件系统(Distributed File System,DFS):一种将数据分散存储在多个节点上,并通过网络进行统一管理和访问的文件系统。

- 数据块(Data Block):分布式文件系统中数据存储的基本单位,通常为固定大小。

- 元数据(Metadata):描述文件和目录属性、位置等信息的数据。

- NameNode:在HDFS中,负责管理元数据的节点。

- DataNode:在HDFS中,负责存储数据块的节点。

- Ceph对象存储(Ceph Object Storage):Ceph分布式文件系统的一种存储方式,以对象为基本存储单元。

- GlusterFS卷(GlusterFS Volume):GlusterFS中逻辑上的存储单元,由多个存储节点组成。

1.4.2 相关概念解释

- 分布式存储:将数据分散存储在多个物理节点上,以提高数据的可靠性和可扩展性。

- 数据冗余:为了提高数据的可靠性,将数据复制多份存储在不同的节点上。

- 数据一致性:确保多个副本的数据在任何时候都是一致的。

- 负载均衡:将数据访问请求均匀地分配到各个节点上,以提高系统的性能。

1.4.3 缩略词列表

- HDFS:Hadoop Distributed File System

- RAID:Redundant Array of Independent Disks

- POSIX:Portable Operating System Interface

2. 核心概念与联系

2.1 分布式文件系统的架构

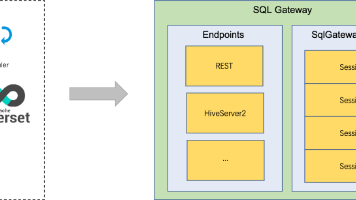

分布式文件系统通常由多个组件组成,包括客户端、元数据服务器和数据存储节点。客户端负责向文件系统发起读写请求,元数据服务器管理文件和目录的元数据信息,数据存储节点负责实际存储数据。以下是一个典型的分布式文件系统架构示意图:

客户端

元数据服务器

数据存储节点1

数据存储节点2

数据存储节点3

2.2 工作原理

当客户端发起一个文件读写请求时,首先会向元数据服务器查询文件的元数据信息,包括文件的数据块位置。元数据服务器返回数据块的位置信息后,客户端直接与相应的数据存储节点进行数据交互。在写入数据时,客户端将数据分割成多个数据块,并将数据块发送到指定的数据存储节点。数据存储节点将数据块存储在本地磁盘上,并向客户端返回确认信息。在读取数据时,客户端根据元数据服务器提供的位置信息,从相应的数据存储节点读取数据块,并将其合并成完整的文件。

2.3 常见的分布式文件系统

2.3.1 HDFS

HDFS是Apache Hadoop项目的核心组件之一,是一个高度容错的分布式文件系统,适合存储大规模数据集。HDFS采用主从架构,由一个NameNode和多个DataNode组成。NameNode负责管理元数据,DataNode负责存储数据块。HDFS的数据块默认大小为128MB,通过数据冗余提高数据的可靠性。

2.3.2 Ceph

Ceph是一个开源的分布式文件系统,提供了对象存储、块存储和文件系统存储三种接口。Ceph采用分布式架构,没有单点故障,具有高可扩展性和高性能。Ceph通过CRUSH算法实现数据的自动分布和负载均衡。

2.3.3 GlusterFS

GlusterFS是一个开源的分布式文件系统,采用无中心架构,易于扩展和管理。GlusterFS通过将多个存储节点组成卷,实现数据的分布式存储。GlusterFS支持多种存储模式,如分布式、复制式和条带式。

3. 核心算法原理 & 具体操作步骤

3.1 HDFS的数据块存储算法

HDFS的数据块存储算法主要涉及数据块的分配和复制。当客户端写入一个文件时,HDFS会将文件分割成多个数据块,并将数据块分配到不同的DataNode上。为了提高数据的可靠性,每个数据块会复制多份存储在不同的DataNode上。以下是一个简单的Python代码示例,模拟HDFS的数据块分配和复制过程:

import random

# 模拟DataNode列表

datanodes = ["datanode1", "datanode2", "datanode3", "datanode4", "datanode5"]

# 数据块大小

block_size = 128 * 1024 * 1024 # 128MB

# 模拟文件大小

file_size = 512 * 1024 * 1024 # 512MB

# 计算数据块数量

num_blocks = file_size // block_size

# 数据块分配和复制

for i in range(num_blocks):

# 选择3个不同的DataNode来存储数据块副本

replicas = random.sample(datanodes, 3)

print(f"数据块 {i} 存储在 {replicas}")

3.2 Ceph的CRUSH算法

CRUSH(Controlled Replication Under Scalable Hashing)算法是Ceph用于数据分布和负载均衡的核心算法。CRUSH算法根据存储集群的拓扑结构和数据副本策略,将数据对象映射到存储节点上。以下是一个简化的CRUSH算法实现思路:

import hashlib

# 模拟存储节点列表

storage_nodes = ["node1", "node2", "node3", "node4", "node5"]

# 数据对象

object_id = "object123"

# 哈希函数

def hash_function(key):

hash_object = hashlib.sha256(key.encode())

return int(hash_object.hexdigest(), 16)

# CRUSH算法实现

def crush_algorithm(object_id, storage_nodes, replicas):

hash_value = hash_function(object_id)

selected_nodes = []

for i in range(replicas):

node_index = (hash_value + i) % len(storage_nodes)

selected_nodes.append(storage_nodes[node_index])

return selected_nodes

# 选择3个副本存储节点

replicas = 3

selected_nodes = crush_algorithm(object_id, storage_nodes, replicas)

print(f"数据对象 {object_id} 存储在 {selected_nodes}")

3.3 GlusterFS的卷管理算法

GlusterFS的卷管理算法主要涉及卷的创建、扩展和删除等操作。当创建一个卷时,GlusterFS会根据用户指定的存储节点和存储模式,将这些节点组合成一个逻辑上的卷。以下是一个简单的Python代码示例,模拟GlusterFS的卷创建过程:

# 模拟存储节点列表

storage_nodes = ["node1", "node2", "node3", "node4", "node5"]

# 选择部分节点创建卷

volume_nodes = storage_nodes[:3]

# 卷名称

volume_name = "my_volume"

# 模拟卷创建操作

print(f"创建卷 {volume_name},使用节点 {volume_nodes}")

4. 数学模型和公式 & 详细讲解 & 举例说明

4.1 HDFS的数据冗余模型

HDFS通过数据冗余提高数据的可靠性,每个数据块默认复制3份。假设数据块的损坏概率为 ppp,则一个数据块的所有副本都损坏的概率为 p3p^3p3。例如,假设数据块的损坏概率为 0.010.010.01,则一个数据块的所有副本都损坏的概率为 0.013=1×10−60.01^3 = 1\times10^{-6}0.013=1×10−6,大大降低了数据丢失的风险。

4.2 Ceph的CRUSH算法数学模型

CRUSH算法的核心是将数据对象的哈希值映射到存储节点上。假设数据对象的哈希值为 hhh,存储节点的数量为 nnn,副本数量为 rrr,则第 iii 个副本存储的节点索引为:

indexi=(h+i) mod n

index_i = (h + i) \bmod n

indexi=(h+i)modn

例如,假设数据对象的哈希值为 123123123,存储节点的数量为 555,副本数量为 333,则第一个副本存储的节点索引为 (123+0) mod 5=3(123 + 0) \bmod 5 = 3(123+0)mod5=3,第二个副本存储的节点索引为 (123+1) mod 5=4(123 + 1) \bmod 5 = 4(123+1)mod5=4,第三个副本存储的节点索引为 (123+2) mod 5=0(123 + 2) \bmod 5 = 0(123+2)mod5=0。

4.3 GlusterFS的负载均衡模型

GlusterFS通过负载均衡算法将数据访问请求均匀地分配到各个存储节点上。假设存储节点的数量为 nnn,每个节点的负载能力为 cic_ici(i=1,2,⋯ ,ni = 1, 2, \cdots, ni=1,2,⋯,n),数据访问请求的数量为 mmm,则每个节点分配到的请求数量 xix_ixi 可以通过以下线性规划模型求解:

max∑i=1nxis.t.∑i=1nxi=m0≤xi≤ci,i=1,2,⋯ ,n

\begin{aligned}

\max &\sum_{i = 1}^{n} x_i \\

\text{s.t.} &\sum_{i = 1}^{n} x_i = m \\

&0 \leq x_i \leq c_i, \quad i = 1, 2, \cdots, n

\end{aligned}

maxs.t.i=1∑nxii=1∑nxi=m0≤xi≤ci,i=1,2,⋯,n

例如,假设存储节点的数量为 333,每个节点的负载能力分别为 101010、202020、303030,数据访问请求的数量为 404040,则可以通过求解上述线性规划模型,得到每个节点分配到的请求数量。

5. 项目实战:代码实际案例和详细解释说明

5.1 开发环境搭建

5.1.1 HDFS开发环境搭建

- 安装Hadoop:从Apache官网下载Hadoop安装包,解压到指定目录。

-

配置Hadoop:修改

core-site.xml、hdfs-site.xml等配置文件,指定NameNode和DataNode的地址和端口。 -

启动HDFS:执行

start-dfs.sh脚本启动HDFS服务。

5.1.2 Ceph开发环境搭建

- 安装Ceph:使用包管理工具安装Ceph软件包。

- 配置Ceph:创建Ceph配置文件,指定存储节点和集群信息。

-

启动Ceph:使用

ceph-deploy工具部署和启动Ceph集群。

5.1.3 GlusterFS开发环境搭建

- 安装GlusterFS:使用包管理工具安装GlusterFS软件包。

- 配置GlusterFS:创建GlusterFS卷,将存储节点添加到卷中。

- 启动GlusterFS:启动GlusterFS服务并挂载卷。

5.2 源代码详细实现和代码解读

5.2.1 HDFS文件读写示例

from hdfs import InsecureClient

# 连接到HDFS

client = InsecureClient('http://localhost:50070', user='hadoop')

# 写入文件

with client.write('/user/hadoop/test.txt', encoding='utf-8') as writer:

writer.write('Hello, HDFS!')

# 读取文件

with client.read('/user/hadoop/test.txt', encoding='utf-8') as reader:

content = reader.read()

print(content)

代码解读:

- 首先使用

InsecureClient类连接到HDFS。 - 然后使用

write方法写入文件,将字符串Hello, HDFS!写入到/user/hadoop/test.txt文件中。 - 最后使用

read方法读取文件内容并打印。

5.2.2 Ceph对象存储示例

import boto3

# 连接到Ceph对象存储

s3 = boto3.client('s3',

endpoint_url='http://ceph-endpoint',

aws_access_key_id='access-key',

aws_secret_access_key='secret-key')

# 创建桶

s3.create_bucket(Bucket='my-bucket')

# 上传文件

s3.upload_file('local-file.txt', 'my-bucket', 'remote-file.txt')

# 下载文件

s3.download_file('my-bucket', 'remote-file.txt', 'downloaded-file.txt')

代码解读:

- 使用

boto3库连接到Ceph对象存储。 - 使用

create_bucket方法创建一个名为my-bucket的桶。 - 使用

upload_file方法将本地文件local-file.txt上传到桶中。 - 使用

download_file方法从桶中下载文件到本地。

5.2.3 GlusterFS文件操作示例

import os

# 挂载GlusterFS卷

os.system('mount -t glusterfs server:/volume /mnt/glusterfs')

# 写入文件

with open('/mnt/glusterfs/test.txt', 'w') as f:

f.write('Hello, GlusterFS!')

# 读取文件

with open('/mnt/glusterfs/test.txt', 'r') as f:

content = f.read()

print(content)

# 卸载GlusterFS卷

os.system('umount /mnt/glusterfs')

代码解读:

- 使用

os.system函数执行mount命令挂载GlusterFS卷。 - 使用Python的文件操作函数写入和读取文件。

- 最后使用

os.system函数执行umount命令卸载GlusterFS卷。

5.3 代码解读与分析

5.3.1 HDFS代码分析

- 优点:使用HDFS的Python客户端库可以方便地进行文件读写操作,代码简洁易懂。

- 缺点:需要确保HDFS服务正常运行,并且客户端能够访问NameNode和DataNode。

5.3.2 Ceph代码分析

-

优点:使用

boto3库可以与Ceph对象存储进行交互,代码具有较好的通用性。 - 缺点:需要配置正确的访问密钥和端点地址,否则会导致连接失败。

5.3.3 GlusterFS代码分析

- 优点:通过执行系统命令可以方便地进行GlusterFS卷的挂载和卸载操作。

- 缺点:代码依赖于系统命令,可能在不同的操作系统上存在兼容性问题。

6. 实际应用场景

6.1 大数据分析

分布式文件系统在大数据分析领域有着广泛的应用。例如,Hadoop生态系统中的HDFS可以存储大规模的数据集,如日志文件、传感器数据等。数据分析工具如Hive、Spark等可以直接从HDFS中读取数据进行分析,提高了数据分析的效率。

6.2 云计算

在云计算环境中,分布式文件系统可以为多个虚拟机和容器提供共享存储服务。例如,Ceph可以作为OpenStack云平台的块存储和对象存储后端,为虚拟机提供持久化存储。

6.3 内容分发网络(CDN)

分布式文件系统可以用于CDN的内容存储和分发。例如,GlusterFS可以将静态文件如图片、视频等存储在多个节点上,通过负载均衡算法将用户的访问请求分配到最近的节点上,提高了内容的访问速度。

6.4 科学研究

在科学研究领域,分布式文件系统可以存储和管理大规模的实验数据。例如,天文学、生物学等领域的研究人员可以使用分布式文件系统存储观测数据和实验结果,方便后续的数据分析和处理。

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

- 《Hadoop实战》:详细介绍了Hadoop生态系统的各个组件,包括HDFS的原理和使用方法。

- 《Ceph实战》:深入讲解了Ceph分布式文件系统的架构、原理和实践应用。

- 《GlusterFS实战指南》:全面介绍了GlusterFS的安装、配置和管理。

7.1.2 在线课程

- Coursera上的“大数据处理与分析”课程:涵盖了分布式文件系统的基本概念和应用。

- edX上的“分布式系统原理”课程:深入讲解了分布式文件系统的原理和算法。

7.1.3 技术博客和网站

- Apache Hadoop官方网站:提供了HDFS的详细文档和最新信息。

- Ceph官方网站:包含了Ceph的技术文档、社区论坛等资源。

- GlusterFS官方网站:提供了GlusterFS的安装指南、使用教程等内容。

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

- PyCharm:一款功能强大的Python集成开发环境,适合开发HDFS、Ceph和GlusterFS的Python代码。

- Visual Studio Code:轻量级的代码编辑器,支持多种编程语言,可用于开发分布式文件系统相关的代码。

7.2.2 调试和性能分析工具

- Hadoop的Web界面:可以查看HDFS的状态信息、数据块分布等,方便调试和性能分析。

- Ceph的命令行工具:如

ceph -s、ceph df等,可以查看Ceph集群的状态和性能指标。 - GlusterFS的监控工具:如

gluster volume status、gluster volume info等,可以查看GlusterFS卷的状态和信息。

7.2.3 相关框架和库

- Hadoop的Python客户端库:如

hdfs、pyarrow等,可以方便地与HDFS进行交互。 - Ceph的Python客户端库:如

rados、rbd等,可以与Ceph的对象存储和块存储进行交互。 - GlusterFS的Python绑定:可以使用Python代码操作GlusterFS卷。

7.3 相关论文著作推荐

7.3.1 经典论文

- “The Google File System”:介绍了Google分布式文件系统的设计和实现。

- “Ceph: A Scalable, High-Performance Distributed File System”:详细阐述了Ceph分布式文件系统的架构和原理。

- “GlusterFS: A Scalable Network Filesystem”:介绍了GlusterFS的设计理念和实现方法。

7.3.2 最新研究成果

- 关注ACM SIGOPS、USENIX ATC等顶级学术会议,了解分布式文件系统的最新研究进展。

- 查阅IEEE Transactions on Parallel and Distributed Systems等学术期刊,获取相关的研究论文。

7.3.3 应用案例分析

- 分析各大互联网公司如阿里巴巴、腾讯等在分布式文件系统方面的应用案例,了解其在实际场景中的应用和优化经验。

8. 总结:未来发展趋势与挑战

8.1 未来发展趋势

- 智能化:分布式文件系统将与人工智能技术相结合,实现智能的数据管理和调度。例如,通过机器学习算法预测数据访问模式,优化数据存储和缓存策略。

- 云原生:随着云计算的发展,分布式文件系统将更加注重云原生特性,如容器化、微服务架构等,以适应云环境的快速部署和弹性伸缩。

- 融合性:不同类型的分布式文件系统将相互融合,提供更加统一的存储服务。例如,将对象存储、块存储和文件系统存储进行融合,满足不同应用场景的需求。

8.2 挑战

- 数据安全:分布式文件系统存储了大量的敏感数据,数据安全问题成为了一个重要的挑战。需要加强数据加密、访问控制等安全机制,保障数据的安全性。

- 性能优化:随着数据量的不断增长,分布式文件系统的性能优化变得越来越重要。需要采用新的算法和技术,如并行读写、缓存优化等,提高系统的读写性能。

- 兼容性和互操作性:不同的分布式文件系统之间存在兼容性和互操作性问题。需要制定统一的标准和接口,实现不同系统之间的数据共享和互操作。

9. 附录:常见问题与解答

9.1 HDFS相关问题

-

问题:HDFS启动失败怎么办?

解答:首先检查NameNode和DataNode的日志文件,查看具体的错误信息。常见的原因包括配置文件错误、端口冲突等。根据错误信息进行相应的修改和调整。 -

问题:如何增加HDFS的数据冗余度?

解答:可以通过修改dfs.replication参数来增加数据冗余度。在hdfs-site.xml配置文件中添加或修改该参数的值,然后重启HDFS服务。

9.2 Ceph相关问题

-

问题:Ceph集群出现故障如何排查?

解答:使用ceph -s命令查看集群的状态信息,根据提示的错误信息进行排查。常见的故障原因包括存储节点故障、网络问题等。 -

问题:如何调整Ceph的缓存策略?

解答:可以通过修改Ceph的配置文件,调整osd_cache_size、osd_cache_target_dirty_ratio等参数来调整缓存策略。

9.3 GlusterFS相关问题

-

问题:GlusterFS卷无法挂载怎么办?

解答:检查GlusterFS服务是否正常运行,存储节点之间的网络是否连通。可以使用gluster volume status命令查看卷的状态信息,根据提示进行相应的处理。 -

问题:如何扩展GlusterFS卷的存储空间?

解答:可以通过添加新的存储节点到卷中来扩展存储空间。使用gluster volume add-brick命令将新的存储节点添加到卷中。

10. 扩展阅读 & 参考资料

10.1 扩展阅读

- 深入研究分布式系统的理论和算法,如分布式一致性算法、分布式锁等。

- 学习云计算和大数据领域的其他相关技术,如容器编排、数据挖掘等。

10.2 参考资料

- Apache Hadoop官方文档:https://hadoop.apache.org/docs/

- Ceph官方文档:https://docs.ceph.com/en/latest/

- GlusterFS官方文档:https://docs.gluster.org/en/latest/

- 《分布式系统原理与范型》:全面介绍了分布式系统的基本原理和技术。

- 《大数据技术原理与应用》:涵盖了大数据领域的各种技术和应用。