【OpenClaw:应用与协同】21、OpenClaw + MCP——对接143种工具,打造全场景AI自动化流水线

MCP协议:OpenClaw的“万能驱动”——对接143种工具,打造全场景AI自动化流水线

从“能聊天”到“能干活”,MCP让AI真正拥有了双手

想象一下:你的AI助手不仅能聊天,还能自动上网搜索资料、调用Photoshop设计海报、操作Excel处理数据、甚至登录你的博客后台发布文章——所有这些,只需要一套统一的接口。

这不再是科幻。MCP(Model Context Protocol,模型上下文协议) 正在将这一愿景变为现实。作为Anthropic开源的新一代AI工具调用标准,MCP被誉为AI世界的“Type-C接口”,它让任何AI模型都能像即插即用的USB设备一样,无缝调用海量外部工具。

本文将深入剖析OpenClahow如何通过MCP协议,将143种(且持续增长)工具纳入麾下,并带你亲手构建一条全自动的CSDN博客撰写流水线——从选题调研、内容生成、代码格式化、配图制作到最终发布,全程无人干预。

1. 引言:MCP——AI的“通用USB接口”

在MCP出现之前,AI调用外部工具是一场噩梦:

- 碎片化:每个模型需要单独适配工具(OpenAI Function Calling vs Claude Tool Use 各有各的写法)

- 高耦合:工具逻辑与模型代码深度绑定,换个框架就得重写

- 上下文丢失:多轮调用中状态管理复杂,模型经常“失忆”

MCP的出现,彻底改变了这一局面。它定义了一套与模型无关的标准化协议,让任意AI模型通过统一接口调用任意工具。正如USB-C统一了电子设备的充电和数据传输,MCP正在统一AI与外部世界的连接方式。

MCP时代

模型A

MCP客户端

模型B

MCP协议

统一接口

MCP服务器1

工具1

MCP服务器2

工具2

MCP出现之前

模型A

工具1的专用接口

工具2的专用接口

模型B

MCP的核心价值在于:

- 标准化接口:一次适配MCP,所有兼容模型都能用

- 动态发现:客户端启动时可拉取服务器支持的工具清单

- 上下文传递:在多轮交互中保持状态连续性

- 安全可控:支持OAuth2集成,精细控制权限

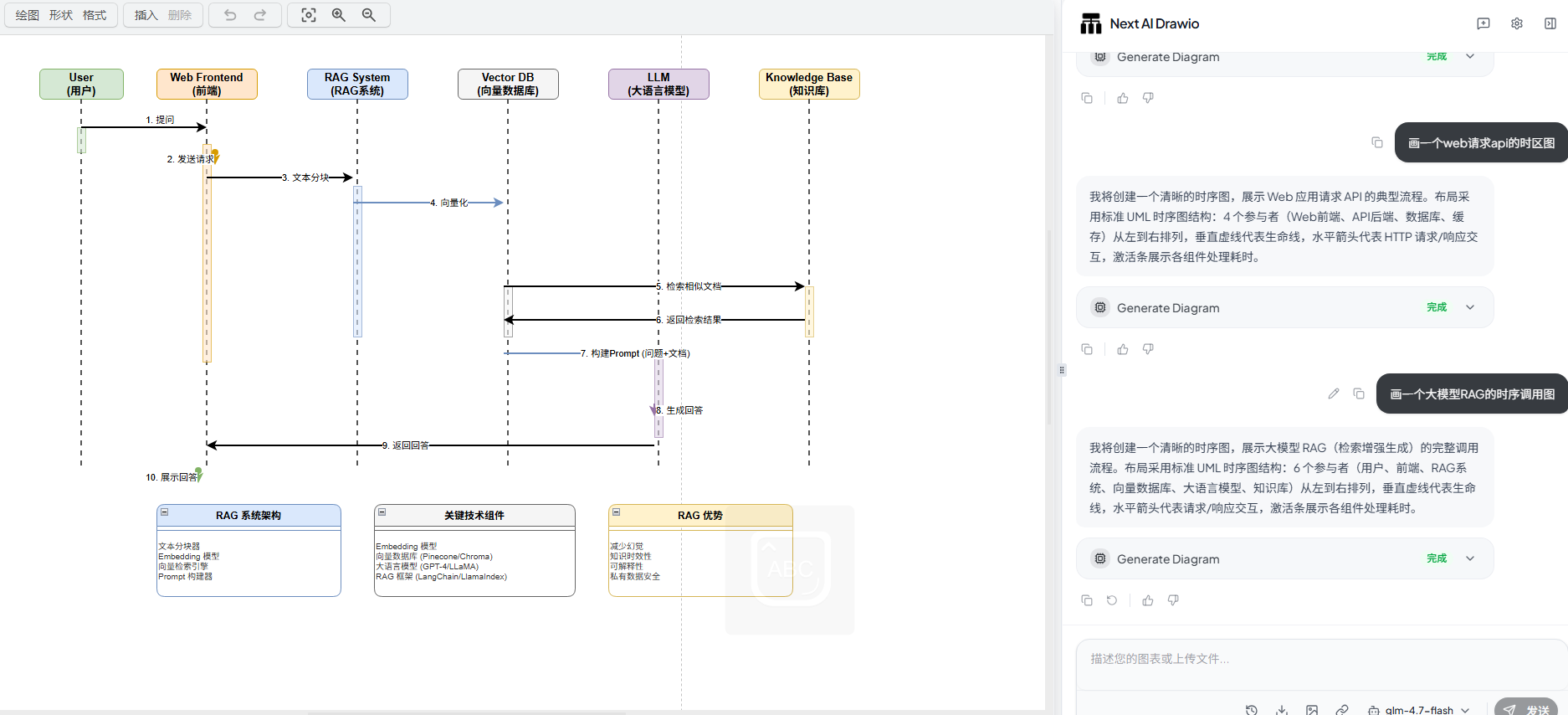

2. OpenClaw中MCP的实现

OpenClaw对MCP的支持并非简单的“能用”,而是深度集成,将MCP服务器暴露的工具注册为Agent可调用的原生工具。

2.1 核心模块:src/mcp/目录解析

OpenClaw的MCP相关代码主要集中在src/mcp/目录,通过openclaw-mcp-adapter插件实现与MCP生态的无缝对接。

MCP生态

OpenClaw Gateway

stdio/HTTP

stdio/HTTP

stdio/HTTP

stdio/HTTP

Agent执行引擎

MCP适配器插件

工具注册表

连接管理器

MCP服务器1

文件系统

MCP服务器2

GitHub

MCP服务器3

浏览器自动化

更多MCP服务器…

工作流程:

- 启动连接:Gateway启动时,MCP适配器插件根据配置连接每个MCP服务器

-

工具发现:调用MCP服务器的

listTools()方法,获取支持的工具清单(名称、描述、参数Schema) - 注册工具:将每个MCP工具注册为OpenClaw的原生工具,Agent可直接调用

- 代理调用:当Agent调用工具时,插件将请求转发给对应的MCP服务器

- 自动重连:连接断开时,下次调用自动重连

2.2 兼容范围:Anthropic官方143种工具

截至2025年3月,MCP生态已拥有超过1000个社区服务器和数千个集成应用。OpenClaw兼容Anthropic官方发布的全部143种工具,覆盖广泛场景:

| 类别 | 代表工具 | 应用场景 |

|---|---|---|

| 搜索 | Bing搜索、Google搜索、Brave搜索 | 信息调研、资料收集 |

| 内容管理 | WordPress、CSDN、Notion | 博客发布、知识库管理 |

| 开发工具 | GitHub、GitLab、代码格式化工具 | 代码管理、自动化构建 |

| 设计工具 | Canva、Figma、Midjourney MCP | 配图生成、设计自动化 |

| 数据分析 | 数据库查询、Excel处理、日志分析 | 数据处理、报表生成 |

| 浏览器自动化 | browser-use、Puppeteer MCP | 网页操作、数据抓取 |

| 通信工具 | Slack、飞书、邮件 | 消息推送、协作通知 |

2.3 配置示例:接入多个MCP服务器

在OpenClaw的配置文件~/.openclaw/openclaw.json中,通过mcp-adapter插件配置MCP服务器:

{

"plugins": {

"entries": {

"mcp-adapter": {

"enabled": true,

"config": {

"servers": [

{

"name": "fetch",

"transport": "stdio",

"command": "uvx",

"args": ["mcp-server-fetch"],

"env": {}

},

{

"name": "github",

"transport": "stdio",

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-github"],

"env": {

"GITHUB_PERSONAL_ACCESS_TOKEN": "${GITHUB_TOKEN}"

}

},

{

"name": "filesystem",

"transport": "stdio",

"command": "npx",

"args": ["-y", "@anthropic/mcp-filesystem", "/home/user/documents"]

}

]

}

}

}

}

}

配置完成后重启Gateway,即可在Agent中直接调用这些MCP工具。

3. 实战案例:全自动CSDN博客撰写流水线

理论讲完了,让我们动手构建一个真实可用的自动化流水线:从零到一自动撰写并发布一篇CSDN博客。

3.1 流水线整体设计

失败

成功

定时触发

每日8点

MCP调用Bing搜索

调研热门技术话题

MCP调用LLM

生成博客大纲

人工确认

可选

MCP调用LLM

生成正文

MCP调用代码格式化工具

优化代码片段

MCP调用文生图API

生成配图

MCP调用CSDN API

发布博客

发布后验证

curl检查状态码

死信队列

自动重试

飞书推送

发布成功通知

3.2 步骤1:MCP调用搜索引擎调研主题

首先,我们需要一个话题。通过MCP的fetch服务器,我们可以让AI自动搜索热门技术趋势。

// skill/blog_generator.ts - 调研主题

import { mcpClient } from '../mcp/client';

async function researchTopic(): Promise<string> {

// 调用MCP的fetch服务器搜索技术热点

const searchResult = await mcpClient.callTool('fetch', 'fetch', {

url: 'https://www.baidu.com/s?wd=AI+技术趋势+2026',

max_length: 5000

});

// 提取关键信息

const summary = await mcpClient.callTool('llm', 'generate', {

prompt: `根据以下搜索结果,总结3个最热门的AI技术话题,每个话题一句话:n${searchResult}`,

max_tokens: 200

});

return summary;

}

3.3 步骤2:MCP调用LLM生成大纲

有了主题,让AI生成博客大纲。这里我们调用MCP封装的LLM工具。

async function generateOutline(topic: string): Promise<string> {

const outline = await mcpClient.callTool('llm', 'generate', {

prompt: `为主题"${topic}"生成一篇CSDN博客的大纲,要求:

- 包含引言、3-4个核心章节、实战案例、总结

- 每个章节包含2-3个小点

- 输出格式为Markdown`,

temperature: 0.7

});

return outline;

}

3.4 步骤3:生成正文与代码格式化

大纲确定后,生成正文。特别地,对于代码片段,调用专门的代码格式化工具优化。

async function generateContent(outline: string): Promise<string> {

// 先生成完整内容

const draft = await mcpClient.callTool('llm', 'generate', {

prompt: `根据以下大纲,写一篇完整的CSDN博客,要求专业、易懂,包含必要的代码示例:n${outline}`,

max_tokens: 3000

});

// 提取代码块并格式化

const codeBlocks = extractCodeBlocks(draft);

for (const block of codeBlocks) {

const formatted = await mcpClient.callTool('code-formatter', 'format', {

code: block.code,

language: block.language

});

draft.replace(block.original, formatted);

}

return draft;

}

3.5 步骤4:MCP调用文生图API生成配图

一篇好博客少不了配图。通过MCP调用Midjourney或DALL-E生成特色配图。

async function generateImages(content: string): Promise<string[]> {

// 提取关键词生成图片提示词

const keywords = await mcpClient.callTool('llm', 'extract_keywords', {

text: content,

count: 3

});

// 为每个关键词生成配图

const imageUrls = [];

for (const kw of keywords) {

const imageUrl = await mcpClient.callTool('midjourney', 'generate', {

prompt: `技术博客配图:${kw},简约风格,蓝色调`,

aspect_ratio: '16:9'

});

imageUrls.push(imageUrl);

}

return imageUrls;

}

3.6 步骤5:MCP调用CSDN API发布博客

最后一步,将生成的Markdown内容发布到CSDN。我们需要一个封装了CSDN API的MCP服务器。

async function publishToCSDN(title: string, content: string, images: string[]): Promise<string> {

// 将图片嵌入内容

let finalContent = content;

images.forEach((url, index) => {

finalContent += `nn`;

});

// 调用CSDN MCP服务器发布

const result = await mcpClient.callTool('csdn', 'publish_article', {

title: title,

content: finalContent,

categories: ['AI', '自动化'],

tags: ['MCP', 'OpenClaw', '博客自动化'],

status: 'public' // 直接发布,不存草稿

});

return result.article_url; // 返回文章链接

}

3.7 主流程整合

将以上步骤整合为一个完整的OpenClaw Skill:

// skill/auto_blogger.ts

import { mcpClient } from '../mcp/client';

export default async function(params: any) {

try {

// 1. 调研主题

const topic = await researchTopic();

console.log('选定主题:', topic);

// 2. 生成大纲

const outline = await generateOutline(topic);

console.log('生成大纲完成');

// 可选:人工确认环节(通过飞书发送确认请求)

if (params.requireApproval) {

await sendApprovalRequest(outline);

// 等待人工确认或超时...

}

// 3. 生成正文

const content = await generateContent(outline);

// 4. 生成配图

const images = await generateImages(content);

// 5. 发布博客

const articleUrl = await publishToCSDN(

`深入浅出:${topic}的自动化实践`,

content,

images

);

// 6. 发布后验证

await verifyPublication(articleUrl);

// 7. 推送成功通知

await notifySuccess(articleUrl);

return { code: 0, data: { article_url: articleUrl } };

} catch (error) {

console.error('博客生成失败', error);

// 失败任务自动进入死信队列(见第4节)

throw error;

}

}

4. 可靠性保障

自动化流水线最怕中途失败。OpenClaw结合消息队列机制,为MCP调用提供了多重保障。

4.1 死信队列:失败自动重试

当MCP工具调用失败时(如网络超时、API限流),任务不会直接丢弃,而是进入**死信队列(DLQ)**等待重试。

是

否

是

延迟到期

否

任务执行

成功?

完成

重试次数<3?

延迟队列

指数退避

死信队列

人工介入/定时重放

OpenClaw的BullMQ配置示例:

// queue/mcp_worker.ts

const worker = new Worker('mcp-tasks', async job => {

return executeMCPTask(job.data);

}, {

connection: redisConnection,

attempts: 3, // 最多重试3次

backoff: {

type: 'exponential', // 指数退避

delay: 1000 // 第一次重试延迟1秒,第二次2秒,第三次4秒

}

});

// 监听失败事件

worker.on('failed', (job, err) => {

console.error(`任务 ${job.id} 最终失败,已进入死信队列`, err);

// 可发送告警

});

4.2 幂等操作:避免重复发布

网络超时可能导致重复调用。MCP工具调用需要支持幂等性——同一操作执行多次结果相同。

对于CSDN发布,我们通过请求唯一ID实现幂等:

async function publishToCSDN(title: string, content: string): Promise<string> {

const requestId = `csdn_${hash(title + content)}_${Date.now()}`;

// 先检查是否已存在(根据标题和内容哈希)

const existing = await checkExisting(requestId);

if (existing) {

return existing.url; // 已发布过,直接返回

}

// 否则执行发布

const result = await csdnAPI.publish({

title,

content,

client_request_id: requestId // CSDN API支持幂等token

});

return result.url;

}

4.3 发布后验证:curl检查状态码

发布成功不等于真正可访问。我们需要验证文章是否正常返回200状态码。

async function verifyPublication(url: string): Promise<boolean> {

// 使用MCP的fetch工具验证

try {

const response = await mcpClient.callTool('fetch', 'fetch', {

url: url,

method: 'HEAD',

timeout: 5000

});

if (response.status === 200) {

return true;

} else {

throw new Error(`返回异常状态码: ${response.status}`);

}

} catch (error) {

console.error('验证失败', error);

return false;

}

}

如果验证失败,任务将进入重试流程,直到成功或达到最大重试次数。

5. 面试考点:MCP协议的核心设计思想

作为AI领域的新兴标准,MCP正成为技术面试的高频考点。以下核心要点需掌握:

5.1 核心设计思想

Q:MCP解决了什么问题?

A:MCP解决的是AI模型与外部工具调用的标准化问题。在MCP之前,每个模型、每个框架都有自己的工具调用方式,导致严重碎片化。MCP通过定义统一的协议层,让模型与工具解耦,实现"一次适配,处处可用"。

Q:MCP的核心架构是怎样的?

A:MCP采用客户端-服务器架构:

- MCP Hosts:启动连接的LLM应用程序(如Claude Desktop、OpenClaw Gateway)

- MCP Clients:协议客户端,维护与服务器的连接

- MCP Servers:暴露特定功能的轻量级程序,可以是本地进程或远程服务

5.2 关键技术特性

Q:MCP如何保持多轮调用的上下文?

A:通过**上下文传递(Context Propagation)**机制。客户端在每次请求中携带完整上下文(用户ID、会话历史等),服务端可在响应中修改上下文,实现状态机。

{

"context": {

"user_id": "u123",

"session_id": "s456",

"history": [{"role": "user", "content": "查询北京天气"}]

},

"tool_name": "get_weather",

"parameters": {"city": "北京"}

}

Q:MCP如何处理流式响应?

A:MCP支持通过**Server-Sent Events(SSE)**流式返回结果,适合大结果分块传输或长时间运行的任务。

5.3 与OpenClaw的关系

Q:MCP和OpenClaw的插件系统是什么关系?

A:这是面试中的高阶问题。MCP是Pull模型:模型决定需要工具时主动发起调用;OpenClaw插件是Push模型:外部事件主动涌入,系统必须持续在线承接。

OpenClaw的选择是:将MCP客户端做成插件形态接入,而不是把整个系统建立在MCP之上。二者是互补关系,非替代关系。

Push模型

Pull模型

自主决定调用

通过MCP调用

OpenClaw

模型

MCP工具

Webhook

OpenClaw插件

消息队列

总结

MCP协议正在重塑AI与外部世界的连接方式。通过OpenClaw对MCP的深度集成,我们得以用统一的接口调用上百种工具,构建从数据抓取、内容生成到自动发布的完整自动化流水线。

本文的CSDN博客自动化案例只是一个开始——同样的模式可以扩展到社交媒体运营、数据分析报告、代码审查等多个场景。当AI拥有了MCP这把"万能钥匙",它能打开的,是整个数字世界的大门。

未来,随着MCP生态的进一步繁荣(已有超过1000个社区服务器),OpenClaw将继续作为MCP的"超级宿主",让每个开发者都能轻松打造属于自己的全场景AI自动化系统。

你在使用MCP过程中遇到过哪些有趣的应用场景?或者想接入哪些目前还没有的MCP服务器?欢迎在评论区留言交流!