集成Kafka 、 ELK实现高吞吐日志采集是Filebeat 还是Fluentbit?

看这篇文件前建议先看作者这篇文章:

Filebeat、Fluent Bit、Fluentd三者全方位对比

深度比较两种日志采集方案:

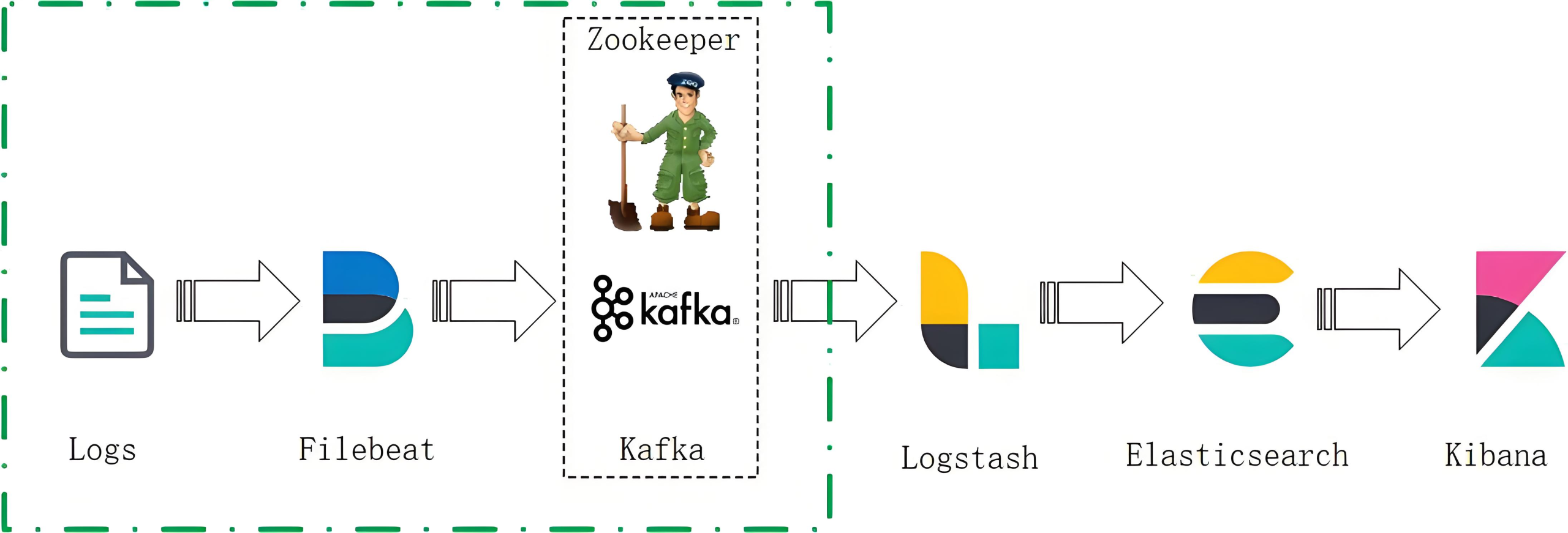

方案一:Filebeat + Kafka + ELK(高吞吐场景)

Filebeat → Kafka → Logstash → ES → Kibana

Filebeat 作为轻量级日志收集器,专为日志文件采集设计,具有低资源消耗和高效率的特点。它能够高效地从文件中读取日志数据,并将其发送到 Kafka 等消息队列中。Filebeat 的配置相对简单,易于部署和管理,特别适合处理结构化日志数据。当与 Kafka 结合使用时,Filebeat 可以作为日志的生产者,将日志数据发送到 Kafka 集群,从而实现日志的缓冲和解耦。这种组合在处理大量日志数据时表现出色,能够有效应对日志量激增的情况。

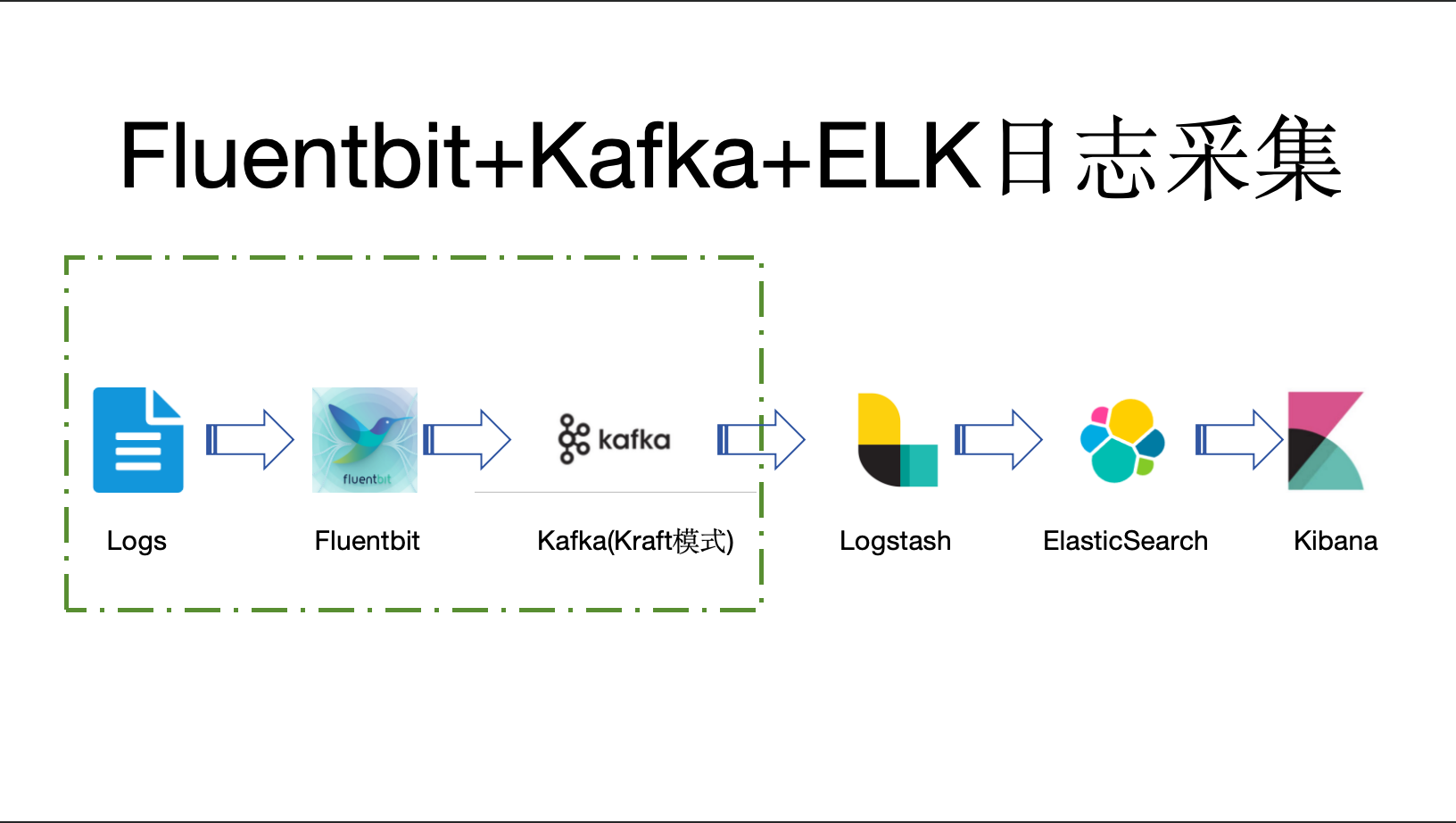

方案二:Fluentbit + Kafka + ELK(高吞吐场景)

Fluentbit → Kafka → Logstash → ES → Kibana

Fluent Bit 是一个高性能的日志收集器,其设计目标是提供低延迟和高吞吐量的日志处理能力。与 Filebeat 相比,Fluent Bit 在处理非结构化日志数据方面具有优势,能够更好地处理多种日志格式。Fluent Bit 支持多种输入和输出插件,可以灵活地集成不同的日志源和目的地。在与 Kafka 结合使用时,Fluent Bit 同样可以作为日志的生产者,将日志数据发送到 Kafka 集群。Fluent Bit 的优势在于其模块化设计和丰富的插件生态系统,使其能够适应各种复杂的日志采集场景。

方案对比分析

从性能角度来看,Fluent Bit 在处理高吞吐量日志数据时表现更优,而 Filebeat 则更适合处理结构化日志。在配置复杂度方面,Filebeat 的配置相对简单,而 Fluent Bit 提供了更多的自定义选项。在扩展性方面,两者都能很好地与 Kafka 集成,实现日志的缓冲和解耦。

选择哪种方案取决于具体的日志类型、处理需求和系统架构。如果主要处理结构化日志且对配置简单性有要求,Filebeat 是更好的选择;如果需要处理多种日志格式且对性能有较高要求,则应选择 Fluent Bit。

对比表格

| 比较维度 | Filebeat + Kafka + ELK | Fluent Bit + Kafka + ELK |

|---|---|---|

| 核心定位 | 专为日志文件采集设计 | 高性能通用日志收集器 |

| 资源消耗 |

低资源消耗,轻量级 内存占用约 30–50 MB,CPU 使用率低 相比 Fluent Bit,资源占用仍偏高 |

低资源消耗,高性能 内存最小可至 450KB,典型使用中低于 10 MB,CPU 利用更高效 |

| 日志处理能力 | 专注结构化日志文件 | 支持多种日志格式和源 |

| 配置复杂度 | 配置简单,易于部署 | 配置相对复杂,功能丰富 |

| 扩展性 | 适合文件日志场景 | 模块化设计,插件丰富 |

| 性能表现 | 适合中低吞吐量 | 高吞吐量,低延迟处理 |

| 适用场景 | 传统日志文件采集 | 多源异构日志采集 |

| 部署难度 | 简单易部署 | 需要更多配置调优 |

| 生态系统 | Elastic官方推荐 | CNCF项目,社区活跃 |

| 监控能力 | 基础监控 | 丰富的监控指标 |

方案对比说明

- Filebeat更适合传统日志文件采集场景,配置简单且资源占用少

- Fluent Bit在处理高吞吐量和多源日志时表现更优,功能更加丰富

- 两种方案都能与Kafka和ELK完美集成,实现完整的日志采集处理链路

- 选择建议:根据日志类型、吞吐量需求和部署复杂度要求来决定使用哪个方案

附件一:Fluentbit常见问题

Fluent Bit 在实际部署和使用过程中,可能会遇到多种常见问题。以下是几个典型问题及其解决方法:

1. 配置文件语法错误

问题描述: 配置文件中存在语法错误,如缩进不正确、参数拼写错误等,导致 Fluent Bit 启动失败或无法正常处理日志。

解决方法: 使用配置验证工具检查语法。确保配置文件中缩进为四个空格,参数拼写正确,插件名称大小写一致。可以使用命令 fluent-bit -c fluent-bit.conf --dry-run 进行语法检查。

2. 日志采集重复或丢失

问题描述: 由于未正确配置持久化机制,Fluent Bit 在重启后会从头开始读取日志文件,导致重复采集或部分日志丢失。

解决方法: 正确配置数据库文件(DB)以记录日志文件的读取偏移量。在输入插件中设置 DB 参数,例如 [INPUT] Name tail Path /var/log/app.log Db /var/log/flb_app.db。这样可以确保 Fluent Bit 在重启后能从上次停止的位置继续读取日志。

3. 性能问题(高 CPU 或内存占用)

问题描述: 在 Windows 环境下,Fluent Bit 可能出现 CPU 占用率过高的问题。

解决方法: 优化配置文件,延长刷新间隔,例如将默认的 1 秒刷新周期调整为 5 秒。关闭不必要的 HTTP 服务,启用文件系统缓冲并设置合理的内存限制。调整 flush 参数以减少 I/O 操作频率。

4. 日志解析失败

问题描述: 日志格式不匹配导致解析失败,如 JSON 格式解析失败或 Apache 日志字段缺失。

解决方法: 检查解析器配置是否正确。对于 JSON 日志,确保添加时间格式定义,如 Time_Format %Y-%m-%dT%H:%M:%S.%L。对于 Apache 日志,确认正则表达式是否准确匹配日志格式。

5. 网络连接问题

问题描述: Fluent Bit 无法连接到目标系统(如 Elasticsearch、Kafka),导致日志转发失败。

解决方法: 检查网络连通性,确认防火墙和 ACL 设置允许通信。使用 mtr 或 traceroute 诊断链路质量。检查输出插件的配置,确保主机地址、端口、认证信息正确。

6. 插件兼容性问题

问题描述: 使用的插件版本与 Fluent Bit 版本不兼容,导致功能异常或崩溃。

解决方法: 确保插件版本与 Fluent Bit 主版本兼容。定期更新插件和 Fluent Bit 到最新稳定版本。检查插件是否支持当前的 Fluent Bit 版本。

7. 安全漏洞

问题描述: Fluent Bit 存在已知的安全漏洞,可能被攻击者利用。

解决方法: 及时更新 Fluent Bit 到最新稳定版本,特别是修复了已知漏洞的版本。避免以 root 用户身份运行 Fluent Bit。订阅 Fluent Bit 的安全公告和 CVE 通知。

8. 资源限制问题

问题描述: Fluent Bit 在高并发场景下可能出现资源瓶颈,如内存不足或 CPU 使用率过高。

解决方法: 优化输入、过滤和输出插件配置。增加资源限制,如调整内存和 CPU 的资源配额。合理配置缓冲区大小,避免因缓冲区不足导致的性能问题。

9. 监控与调试困难

问题描述: 缺乏有效的监控手段,难以快速定位问题。

解决方法: 启用 HTTP 服务器以获取实时监控指标。通过访问 http://localhost:2020/api/v1/metrics 获取性能数据。查看 Fluent Bit 日志文件,如 /var/log/td-agent-bit.log,以获取详细错误信息。

通过以上方法,可以有效解决 Fluent Bit 使用中遇到的常见问题,确保日志采集系统的稳定运行。

附件二:Filebeat常见问题

Filebeat 作为 ELK 栈中轻量级日志采集的核心组件,在生产环境中广泛应用。然而,由于配置不当、环境差异或资源限制,常会出现一些典型问题。以下是基于实际运维经验梳理的 Filebeat 常见问题及系统性解决方案,帮助你快速定位并解决故障。

一、日志采集丢失或漏读

日志未被完整采集是 Filebeat 最常见的问题之一,主要原因包括:

-

日志轮转过快,扫描间隔不匹配

当日志文件频繁滚动(如 Docker 默认 50MB 滚动一次),而scan_frequency默认为 10s,可能导致新文件未被及时发现。

✅ 解决方案:减小扫描间隔,例如设置scan_frequency: 1s。 -

文件句柄未释放导致磁盘满

Filebeat 在日志未发送完成前会持续持有文件句柄,即使文件已被删除。若日志生产速度远大于传输速度,会导致 deleted 文件句柄堆积,占用磁盘空间 。

✅ 解决方案:- 启用

close_removed: true,允许删除后关闭句柄 - 设置

close_inactive: 5m,对不活跃文件主动关闭 - 优化日志滚动策略,增大单文件大小(如 500MB)

- 启用

-

inode 复用导致读取错位

操作系统复用旧文件的 inode 给新文件,Filebeat 可能误判起始位置,跳过新文件开头内容 。

✅ 解决方案:确保在 inode 被复用前完成读取,可通过降低轮转频率 + 缩短scan_frequency实现。

二、日志重复采集

Filebeat 为保证“至少一次”(at least once)传输,可能在未收到确认(ack)时重发数据,导致重复 。常见场景包括:

- 网络抖动或输出端阻塞:Kafka/ES 暂时不可用,触发重试机制

- 注册表(registry)损坏或未持久化:容器重启后 registry 丢失,从头读取文件

✅ 解决方案:

- 持久化 registry 文件:确保

/var/lib/filebeat/registry目录挂载到持久化存储,尤其在 Kubernetes 环境中 - 业务层去重:利用唯一字段(如日志时间戳 + traceId)在 Logstash 或 Elasticsearch 中去重

- 启用

ignore_older:避免重启后处理历史文件,如ignore_older: 24h

三、配置与权限问题

-

配置文件语法错误

YAML 缩进错误、Tab 与空格混用、路径未加引号等都会导致启动失败 。

✅ 解决方案:- 使用

filebeat test config -c /etc/filebeat/filebeat.yml验证语法 - 使用

yamllint工具检查格式

- 使用

-

权限不足

Filebeat 无法读取日志文件或写入 registry 目录,报 “permission denied” 。

✅ 解决方案:- 赋予读取权限:

sudo chmod 644 /var/log/app.log - 修改属主:

sudo chown filebeat:filebeat /var/log/app.log - 检查 SELinux 状态,必要时临时设为 permissive 模式测试

- 赋予读取权限:

四、性能与资源问题

-

CPU 使用率过高

可能由高频扫描、多行日志正则匹配复杂或 Go 运行时问题引起 。

✅ 解决方案:- 使用

--cpuprofile参数生成性能分析文件 - 通过

pprof工具定位热点代码(Filebeat 支持 Go 的 pprof) - 限制

max_procs: 1,避免多核竞争

- 使用

-

内存泄漏或占用过高

多行日志(multiline)配置不当、registry 膨胀或版本缺陷可能导致内存持续增长 4官网。

✅ 解决方案:- 避免过度复杂的

multiline.pattern - 设置

registry.flush: 60s定期写入磁盘 - 升级到最新稳定版本,避免已知内存问题

- 避免过度复杂的

五、网络与输出问题

-

连接超时或拒绝

无法连接到 Logstash、Elasticsearch 或 Kafka 。

✅ 解决方案:- 使用

telnet <host> <port>测试端口连通性 - 检查防火墙规则(如

firewall-cmd --list-all) - 验证 SSL 配置:

ssl.certificate_authorities和ssl.verification_mode

- 使用

-

输出背压导致采集滞后

当下游(如 ES)处理能力不足,Filebeat 会积压数据,registry 文件膨胀 。

✅ 解决方案:- 增大输出批量大小:

bulk_max_size: 2048 - 启用持久化队列:

queue.type: persisted - 监控

filebeat.events.not_published指标

- 增大输出批量大小:

六、其他注意事项

-

不建议采集网络存储日志

Elastic 官方明确不推荐从 NFS 等网络卷读取日志,因文件标识变化可能导致重复采集 。

✅ 最佳实践:在日志生成主机本地部署 Filebeat。 -

多行日志处理

Java 异常堆栈等多行日志需启用multiline配置,否则会被拆分为多条事件 。

✅ 示例:multiline.pattern: '^[[:space:]]+(at|\.{3})\b' multiline.match: after

附件三:Filebeat 故障排查清单

以下是 Filebeat 故障排查清单,结合常见问题场景与系统性排查路径,帮助你快速定位并解决问题。

一、服务状态检查

-

✅ 确认 Filebeat 是否正在运行

systemctl status filebeat若服务未启动或反复重启,查看失败原因。

-

✅ 重启服务并重置失败状态

systemctl reset-failed filebeat systemctl start filebeat -

✅ 前台运行以获取实时日志(调试用)

filebeat -e -c /etc/filebeat/filebeat.yml

二、日志分析(核心依据)

-

✅ 查看 Filebeat 自身日志

tail -f /var/log/filebeat/filebeat或使用 journalctl:

journalctl -u filebeat -f关注关键词:

connection refused、timeout、permission denied、config parse error。 -

✅ 启用 debug 日志级别(疑难问题)

在filebeat.yml中设置:logging.level: debug重启后观察详细流程,排查初始化、harvester 启动、事件发送等环节。

三、配置文件验证

-

✅ 检查 YAML 语法正确性

yamllint /etc/filebeat/filebeat.yml避免缩进错误、冒号后缺少空格等问题。

-

✅ 验证配置逻辑有效性

filebeat test config -c /etc/filebeat/filebeat.yml -

✅ 测试输出连通性

- 对接 Elasticsearch:

curl -X GET "http://<es-host>:9200/_cluster/health?pretty" - 对接 Logstash:

telnet <logstash-host> 5044

- 对接 Elasticsearch:

四、输入(Input)问题排查

-

✅ 确认日志路径存在且可读

检查filebeat.inputs.paths是否指向真实文件,通配符是否匹配成功。 -

✅ 检查文件权限

确保运行用户(通常是filebeat)对日志文件有读取权限:sudo chmod 644 /var/log/app.log sudo chown filebeat:filebeat /var/log/app.log -

✅ 避免日志轮转导致的漏读或句柄占用

合理配置以下参数:scan_frequency: 1s # 加快扫描频率 close_removed: true # 删除文件后关闭句柄 close_inactive: 5m # 不活跃文件关闭读取 ignore_older: 24h # 忽略超过24小时的历史文件 -

✅ 处理多行日志(如 Java 堆栈)

启用 multiline 配置,防止异常被拆分为多条事件:multiline.pattern: '^[[:space:]]+(at|\.{3})\b' multiline.match: after

五、输出(Output)问题排查

-

✅ 确认目标服务可达

- 网络连通性:

ping <host> - 端口开放:

telnet <host> 9200或nc -zv <host> 9200

- 网络连通性:

-

✅ 检查防火墙设置

CentOS 示例:firewall-cmd --add-port=9200/tcp --permanent firewall-cmd --reload -

✅ 验证认证与 SSL 配置

若启用安全认证,确保用户名、密码、CA 证书路径正确:output.elasticsearch: hosts: ["https://es-host:9200"] username: "filebeat_internal" password: "secret" ssl.certificate_authorities: ["/path/to/ca.crt"] -

✅ 监控写入性能与背压

查看指标:-

filebeat.events.done:成功发送事件数 -

libbeat.output.write.bytes:输出字节数 -

registry文件大小:过大可能表示积压

-

六、资源与性能检查

-

✅ 查看系统资源使用情况

top / htop # CPU、内存 df -h # 磁盘空间 iostat -x 1 # IO 性能 -

✅ 避免磁盘满导致采集停滞

Filebeat 在磁盘满时会暂停写入 registry 和日志缓存,需预留足够空间。 -

✅ 优化高吞吐场景下的性能

调整以下参数以提升吞吐、降低延迟:output.elasticsearch: bulk_max_size: 2048 worker: 4 queue.type: persisted queue.flush.timeout: 60s

七、注册表(Registry)管理

-

✅ 理解 registry 文件作用

记录每个日志文件的读取偏移量,避免重复采集。 -

✅ 避免 registry 膨胀或损坏

- 定期 flush:

registry.flush: 60s - 升级时备份 registry 文件

- 异常恢复时可手动删除(需承担重复风险)

- 定期 flush:

-

✅ 容器化部署注意事项

将/var/lib/filebeat挂载为持久卷,防止重启后 registry 丢失导致重复采集。

八、版本与兼容性

-

✅ 检查 Filebeat 版本

filebeat version确保与 Elasticsearch、Logstash 版本兼容(参考 Elastic 官方兼容矩阵)。

-

✅ 避免使用过旧版本

旧版本可能存在已知 bug(如内存泄漏、registry 错误),建议使用最新稳定版。