RabbitMQ 全链路解析:底层原理 + 高并发调优 + 百万级落地

目录

凌晨3点的告警

前言:新手必读——消息队列的本质

不用消息队列的世界是什么样的

有了消息队列

第一章:基础知识——5个必须搞懂的概念

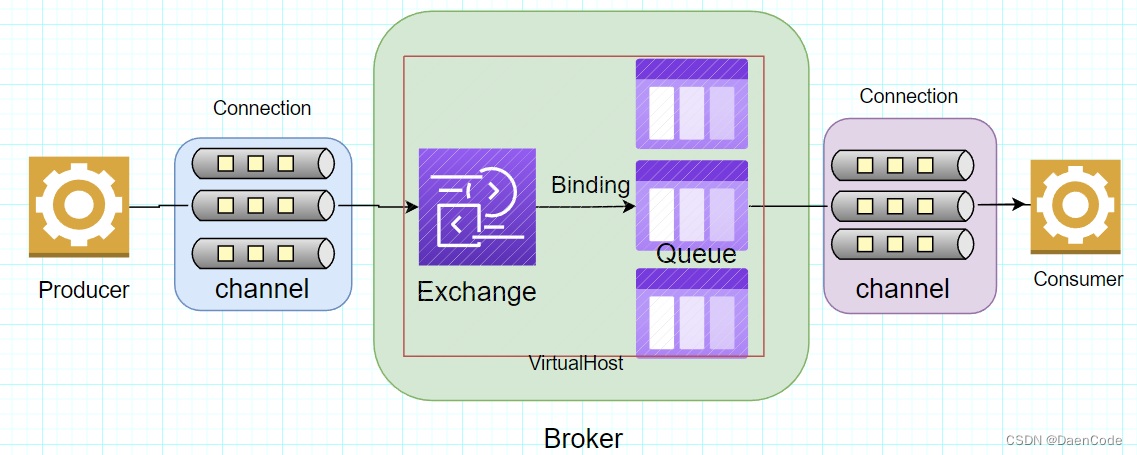

核心架构(一张图说清楚)

核心概念详解

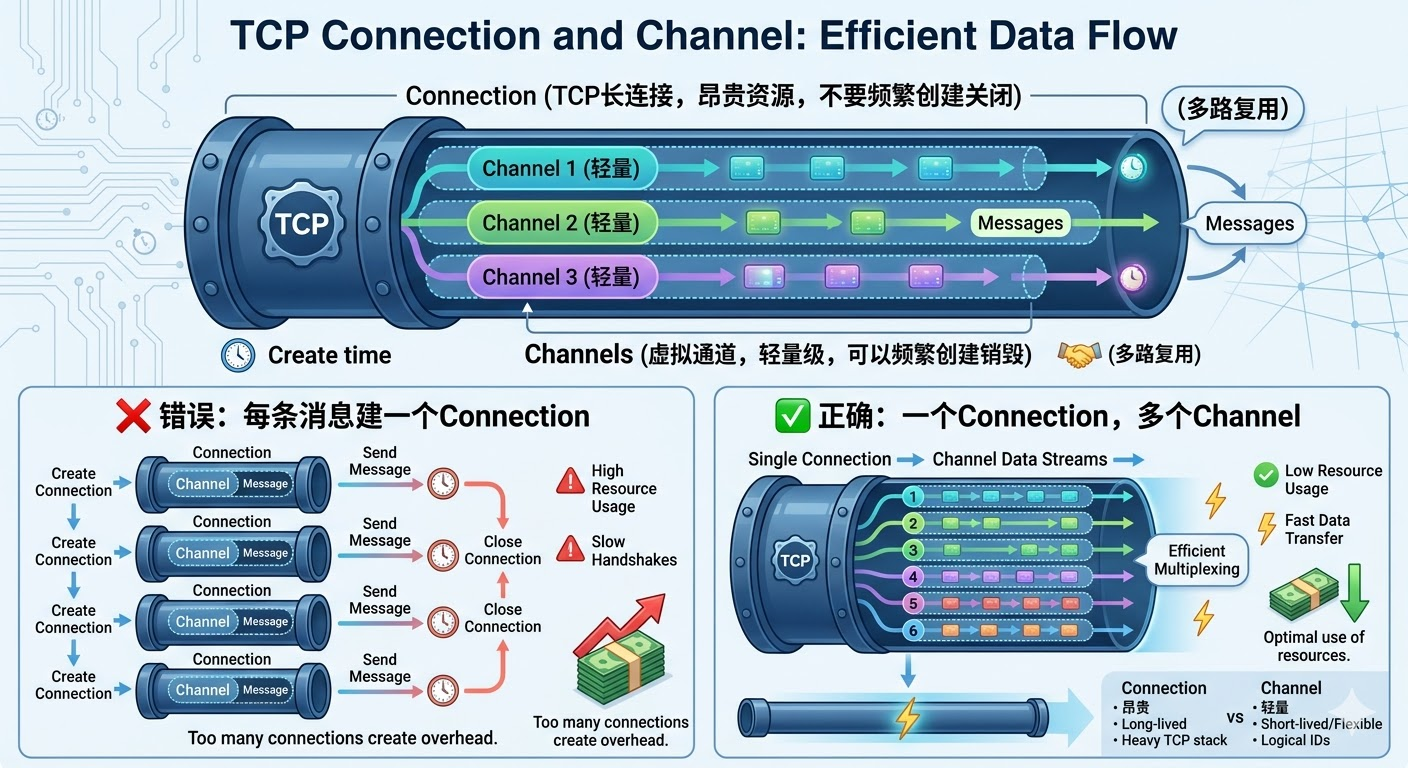

1️⃣ Connection(连接)与 Channel(通道)

2️⃣ Exchange(交换机)- 4种类型

3️⃣ Queue(队列)

4️⃣ Binding(绑定)与 Routing Key(路由键)

5️⃣ Virtual Host(虚拟主机)

第二章:可靠性保障——这是一切的基础

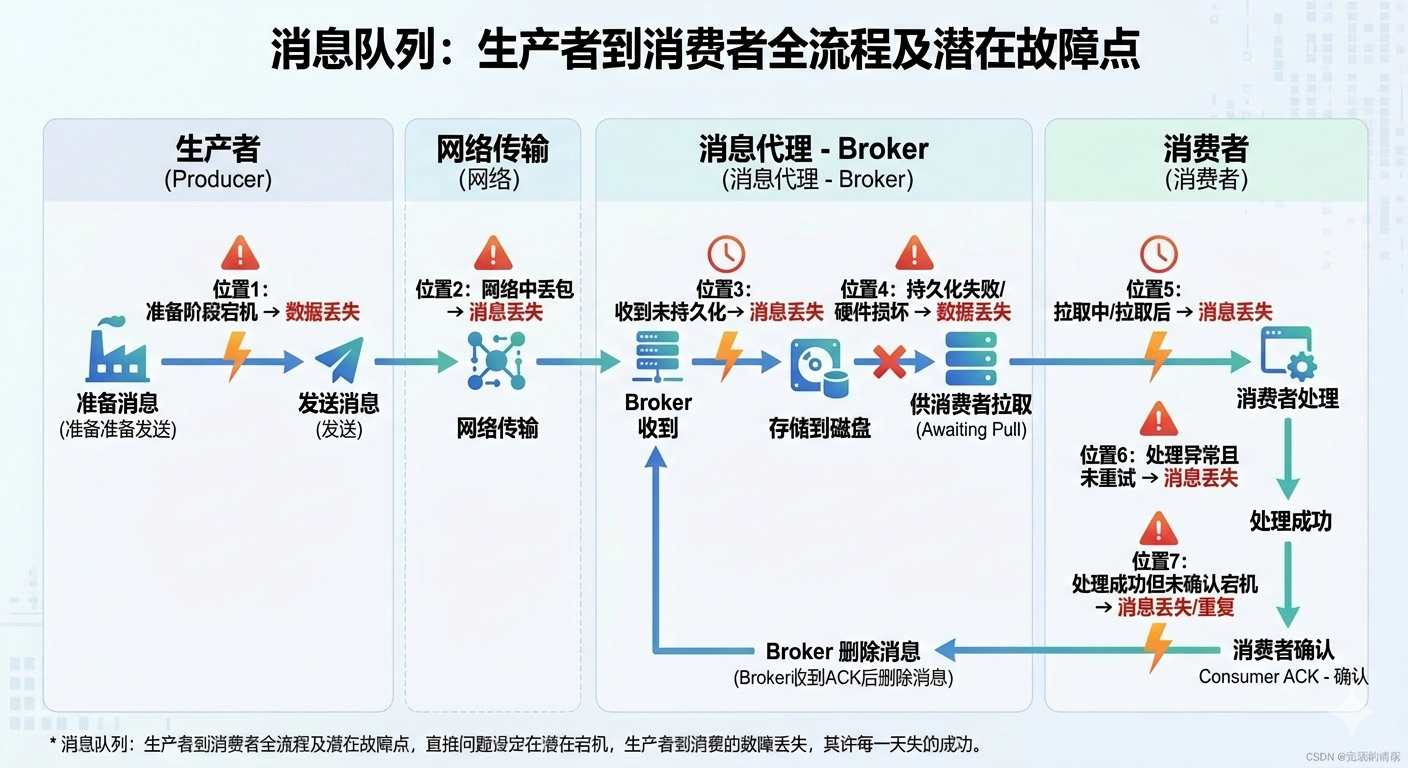

消息丢失的7个可能位置

第一道防线:生产者确认机制(Publisher Confirm)

为什么需要它?

完整实现

配合数据库持久化

生产者发送流程

第二道防线:Broker端持久化(三件套)

1️⃣ Exchange必须持久化

2️⃣ Queue必须持久化

3️⃣ 消息本身必须持久化

第三道防线:消费者手动确认(Manual ACK)

问题演示:autoAck=true的危害

解决方案:Manual ACK(完整实现)

消费者处理(完整代码)

第四道防线:死信队列(DLX)

完整配置

死信消息处理

第五道防线:定时补偿任务

第三章:高级特性与性能优化

Prefetch(QoS):消费者预取策略

延迟队列:实现"定时任务"

方案1:插件方式(推荐)

消息顺序:如何在高并发下保证顺序

问题:多消费者导致乱序

解决方案:分片(推荐)

第四章:Spring Boot完整集成示例

application.yml配置文件

第五章:故障排查与监控

常见问题

问题1:消息堆积

问题2:消息丢失

第六章:面试题与标准答案

题目1:如何保证消息100%不丢失?

题目2:RabbitMQ vs Kafka 如何选择?

选 RabbitMQ 的情况:

选 Kafka 的情况:

选 RocketMQ 的情况:

总结

题目3:如何防止重复消费?

第七章:总结与最佳实践

必须记住的三句话

落地实践检查清单

附录:SQL语句

最后的话

写给所有工程师:这不是一篇API文档速查表,而是我5年生产环境经验写下来的"RabbitMQ入门到精通指南"。代码部分全部经过实战验证,可以直接复制粘贴使用。无论你是刚接触消息队列的初学者,还是在凌晨3点被告警吵醒的值班工程师,都能在这篇文章里找到答案。

凌晨3点的告警

凌晨3点,Slack弹出告警:订单支付队列堆积300万消息,消费速率从原来的5000msg/s 跌到50msg/s。

值班工程师冲进war room,我们花了2小时才定位根因——不是消费者逻辑有问题,而是一个消费者实例因为内存溅出被K8s驱逐,其他实例在争抢消息时发生了锁竞争,导致吞吐量暴跌。

这个夜晚让我意识到:很多工程师知道RabbitMQ怎么用,但不知道它为什么设计成这样,更不知道当一切都出问题时该如何快速诊断。

这篇文章,就是那个凌晨3点之后写下来的。它会陪你从最基础的概念,一直走到能解决生产环境中最复杂的问题。

前言:新手必读——消息队列的本质

不用消息队列的世界是什么样的

想象你在餐厅点餐:

顾客 → 收银员(同步等待)

↓

厨房(可能很慢)

↓

等待中...被卡在这里...

↓

菜做好了,收银员把菜递给你

这叫同步调用。问题是:如果厨房很慢(菜单复杂、厨师少),收银员就得一直等,后面的顾客没法点餐,整个餐厅效率爆炸。

有了消息队列

顾客 → 收银员(接单很快)→ 订单队列 → 厨房在后台慢慢做

返回:"您的订单已接受,请稍候" → 顾客可以去其他地方

↓

菜做好了,通知顾客来取

这叫异步解耦。好处是:

- 解耦:收银员不用管厨房是否忙碌

- 异步:顾客可以去等区域等,不用卡在收银台

- 削峰:再多的顾客也不会让系统崩溃,队列会缓冲

RabbitMQ就是这个"订单队列"。

第一章:基础知识——5个必须搞懂的概念

核心架构(一张图说清楚)

核心概念详解

1️⃣ Connection(连接)与 Channel(通道)

Connection = TCP长连接(昂贵资源,不要频繁创建关闭)

Channel = 虚拟通道(轻量级,可以频繁创建销毁)

一个Connection可以有多个Channel(多路复用)

┌─────────────────────────────────────────┐

│ Connection (TCP长连接,建立一次) │

│ ┌─────────────────────────────────┐ │

│ │ Channel 1 (轻量) │ │

│ │ Channel 2 (轻量) │ │

│ │ Channel 3 (轻量) │ │

│ └─────────────────────────────────┘ │

└─────────────────────────────────────────┘

❌ 错误:每条消息建一个Connection

✅ 正确:一个Connection,多个Channel

2️⃣ Exchange(交换机)- 4种类型

Direct(点对点):精确匹配Routing Key

Exchange: order.exchange

Queue: inventory.queue ← 只看Routing Key="order.paid"

Queue: other.queue ← 看不到这条消息

使用场景:订单已支付,只有库存系统关心

Fanout(广播):忽略Routing Key,所有绑定的Queue都收

Exchange: order.fanout

Queue1: inventory.queue ← 收到!

Queue2: points.queue ← 收到!

Queue3: recommend.queue ← 收到!

使用场景:订单创建,所有相关系统都需要知道

Topic(主题):通配符匹配(常用)

order.paid → inventory.queue (库存)

order.created → points.queue + recommend.queue

order.shipped → logistics.queue (物流)

*.created → log.queue (所有创建事件都要记日志)

通配符:

* = 匹配单个单词

# = 匹配多个单词

Headers(属性):根据消息属性匹配(少用,性能差)

type=order, priority=high → priority.queue

3️⃣ Queue(队列)

Queue是实际存储消息的地方,FIFO(先进先出)。

重点:

- Queue只能绑定一个Exchange吗?不对,一个Queue可以绑定多个Exchange

- Queue中的消息是临时存储,消费后就删除

- 队列名通常代表消费者身份(order.queue = 订单服务的队列)

4️⃣ Binding(绑定)与 Routing Key(路由键)

Binding = 连接关系,告诉Exchange如何把消息转发给Queue

Exchange "order.exchange"

├─ Binding to "inventory.queue" with RoutingKey="order.paid"

├─ Binding to "points.queue" with RoutingKey="order.*"

└─ Binding to "log.queue" with RoutingKey="#"

5️⃣ Virtual Host(虚拟主机)

虚拟主机提供逻辑隔离(类似数据库的database):

RabbitMQ Server

├─ VirtualHost "/" (生产环境)

│ ├─ order.exchange

│ ├─ order.queue

│ └─ users/权限配置

│

├─ VirtualHost "/business" (测试环境)

│ ├─ order.exchange.test

│ └─ users/权限配置

│

└─ VirtualHost "/dev" (开发环境)

第二章:可靠性保障——这是一切的基础

如果只能掌握RabbitMQ的一个知识点,我建议你学消息不丢失的全链路保障。因为在生产环境,一条消息可能代表:一笔订单(钱)、一次库存扣减(数据一致性)、一条支付记录(审计追踪)。丢不得。

消息丢失的7个可能位置

生产者准备发送 → 网络传输 → Broker收到 → 存储到磁盘 → 消费者拉取

↓ ↓ ↓ ↓ ↓

位置1: 位置2: 位置3: 位置4: 位置5:

发送前 网络中 收到后 宕机 消费者宕机

宕机 丢失 宕机 丢失 丢失

→ 消费者处理 → 消费者确认 → Broker删除

↓ ↓ ↓

位置6: 位置7:

处理异常 来不及确认

丢失 丢失

解决方案:5道防线全覆盖

第一道防线:生产者确认机制(Publisher Confirm)

为什么需要它?

你发了一条消息,但你永远不知道:

- Broker是否拒绝了?(没有对应的Queue)

- 网络中是否丢了?

- Broker是否宕机了?

所以必须打开Publisher Confirm机制。

完整实现

@Configuration

public class RabbitMQConfig {

@Bean

public RabbitTemplate rabbitTemplate(ConnectionFactory connectionFactory) {

RabbitTemplate template = new RabbitTemplate(connectionFactory);

// ===== 关键1:Publisher Confirm回调 =====

// 当Broker确认接收消息时触发

template.setConfirmCallback((correlationData, ack, cause) -> {

if (ack) {

log.info("✅ 消息[{}]已被Broker确认", correlationData.getId());

} else {

log.error("❌ 消息[{}]被Broker拒绝,原因: {}",

correlationData.getId(), cause);

// 触发失败处理:重试、记DB、告警

handlePublishFailure(correlationData, cause);

}

});

// ===== 关键2:Publisher Return回调 =====

// 当消息无法路由到任何Queue时触发

// 必须配合 mandatory=true 使用

template.setReturnCallback((message, replyCode, replyText, exchange, routingKey) -> {

log.error("❌ 消息不可路由到队列,exchange: {}, routingKey: {}, replyCode: {}",

exchange, routingKey, replyCode);

// 消息已被Broker回弹,需要处理

handleReturnMessage(message, exchange, routingKey);

});

// 开启mandatory模式(不可路由消息会被返回给生产者)

template.setMandatory(true);

return template;

}

}

配合数据库持久化

@Entity

@Table(name = "order_message")

@Data

@NoArgsConstructor

public class OrderMessage {

@Id

private String id; // UUID,用于关联Confirm回调

@Column(nullable = false)

private Long orderId;

@Column(columnDefinition = "LONGTEXT")

private String content; // 消息内容JSON

@Column(nullable = false)

private String status; // INIT, SENT, FAILED, PROCESSED

@Column

private String errorMsg; // 失败原因

@Column(nullable = false)

private Integer retryCount = 0;

@Column(nullable = false)

private Integer maxRetry = 3;

@Column(nullable = false, updatable = false)

private LocalDateTime createTime;

@Column

private LocalDateTime lastRetryTime;

@PrePersist

protected void onCreate() {

createTime = LocalDateTime.now();

}

}

@Repository

public interface OrderMessageRepository extends JpaRepository<OrderMessage, String> {

@Query("SELECT m FROM OrderMessage m WHERE " +

"m.status = 'FAILED' AND " +

"m.createTime > ?1 AND " +

"m.retryCount < ?2")

List<OrderMessage> findFailedMessages(LocalDateTime since, int maxRetryCount);

@Query("SELECT m FROM OrderMessage m WHERE " +

"m.status = 'FAILED' AND " +

"m.retryCount >= ?1")

List<OrderMessage> findGiveupMessages(int maxRetryCount);

}

生产者发送流程

@Service

@Slf4j

public class OrderPublishService {

@Autowired

private OrderMessageRepository messageRepository;

@Autowired

private RabbitTemplate rabbitTemplate;

public void publishOrderCreated(Order order) {

// ===== 步骤1:记录消息到DB(消息状态=INIT)=====

OrderMessage msg = new OrderMessage();

msg.setId(UUID.randomUUID().toString());

msg.setOrderId(order.getId());

msg.setContent(JSON.toJSONString(order));

msg.setStatus("INIT"); // 消息未发送

messageRepository.save(msg);

// ===== 步骤2:创建CorrelationData(用来关联回调)=====

CorrelationData correlationData = new CorrelationData(msg.getId());

// ===== 步骤3:发送消息 =====

try {

rabbitTemplate.convertAndSend(

"order.exchange",

"order.create",

order,

correlationData

);

log.info("订单[{}]消息已发送,messageId: {}", order.getId(), msg.getId());

} catch (AmqpException e) {

// 本地异常(连接失败等)

msg.setStatus("FAILED");

msg.setErrorMsg(e.getMessage());

messageRepository.save(msg);

log.error("消息发送异常,已记录待补偿", e);

throw new BizException("消息发送失败");

}

// ===== 步骤4:Confirm回调会异步执行,更新消息状态 =====

// 在RabbitMQConfig中的setConfirmCallback处理

}

// Confirm回调成功时调用

public void handlePublishSuccess(String messageId) {

OrderMessage msg = messageRepository.findById(messageId).orElse(null);

if (msg != null) {

msg.setStatus("SENT");

messageRepository.save(msg);

log.info("消息[{}]发送成功,已更新状态为SENT", messageId);

}

}

// Confirm回调失败时调用

public void handlePublishFailure(String messageId, String cause) {

OrderMessage msg = messageRepository.findById(messageId).orElse(null);

if (msg != null) {

msg.setStatus("FAILED");

msg.setErrorMsg(cause);

msg.setRetryCount(0);

messageRepository.save(msg);

log.error("消息[{}]发送失败,已记录待补偿:{}", messageId, cause);

}

}

// Return回调(消息无法路由)时调用

public void handleReturnMessage(Message message, String exchange, String routingKey) {

String content = new String(message.getBody());

log.error("消息无法路由到任何队列,exchange: {}, routingKey: {}, 内容: {}",

exchange, routingKey, content);

// 检查Exchange/Binding配置是否正确

}

}

关键点:

- ✅ Confirm回调是异步的,不会阻塞发送

- ✅ 必须配合DB持久化,防止Broker宕机导致消息丢失

- ✅ 必须有定时补偿任务重试失败的消息

第二道防线:Broker端持久化(三件套)

即使生产者完美地发送了消息,如果Broker突然宕机,消息仍然会丢。所以必须持久化到磁盘。

三件套缺一不可:

1️⃣ Exchange必须持久化

@Bean

public DirectExchange orderExchange() {

return new DirectExchange(

"order.exchange",

true, // ← durable=true,重启后Exchange仍存在

false // autoDelete=false

);

}

2️⃣ Queue必须持久化

@Bean

public Queue orderQueue() {

return new Queue("order.queue", true); // ← durable=true

}

3️⃣ 消息本身必须持久化

// ❌ 错误:没有标记持久化

rabbitTemplate.convertAndSend("order.exchange", "order.create", order);

// ✅ 正确:显式标记消息持久化

Message message = MessageBuilder

.withBody(JSON.toJSONString(order).getBytes(StandardCharsets.UTF_8))

.setDeliveryMode(MessageDeliveryMode.PERSISTENT) // ← 关键!

.setContentType("application/json")

.setHeader("X-Business-ID", order.getId().toString())

.build();

rabbitTemplate.convertAndSend("order.exchange", "order.create", message);

为什么这么重要?

Broker会记得有这个Queue(因为Queue配置是持久的),但如果消息没有PERSISTENT标记:

- RabbitMQ把消息存到内存里(不是磁盘)

- Broker宕机重启时,内存清空,消息永远丢失

我们的血泪教训:

早期项目中,Queue配置了durable=true,但消息发送时没有标记PERSISTENT。结果Broker宕机重启后,所有消息都没了,支付数据不一致,花了3天才修复。

第三道防线:消费者手动确认(Manual ACK)

问题演示:autoAck=true的危害

// ❌ 危险的代码(使用默认配置 autoAck=true)

@RabbitListener(queues = "order.queue")

public void handleOrder(Order order) {

// RabbitMQ在收到消息的那一刻就自动确认了

// 即使下面的代码还没执行!

// 如果这里抛异常...

processOrder(order); // ← 业务处理(可能失败)

// RabbitMQ不知道业务处理失败了

// 消息已经被确认,永远不会重试

// 数据不一致!

}

时间线:

T1: 消费者收到消息

T2: RabbitMQ自动ACK ✓(消息被确认)

T3: 开始处理业务

T4: 数据库连接超时 ✗(业务失败)

T5: 消费者宕机

结果:消息已被确认,永远收不到,但业务没完成

解决方案:Manual ACK(完整实现)

@Configuration

public class RabbitListenerContainerConfig {

@Bean

public SimpleRabbitListenerContainerFactory rabbitListenerContainerFactory(

ConnectionFactory connectionFactory) {

SimpleRabbitListenerContainerFactory factory =

new SimpleRabbitListenerContainerFactory();

factory.setConnectionFactory(connectionFactory);

// 🔴 关键配置:改成手动确认

factory.setAcknowledgeMode(AcknowledgeMode.MANUAL);

// 并发配置

factory.setConcurrentConsumers(10);

factory.setMaxConcurrentConsumers(20);

// 预取配置(后面详细讲)

factory.setPrefetchCount(10);

return factory;

}

}

消费者处理(完整代码)

@RabbitListener(queues = "order.queue")

public void handleOrder(

Order order,

Channel channel,

@Header(AmqpHeaders.DELIVERY_TAG) long deliveryTag) {

try {

log.info("开始处理订单: {}", order.getId());

// ⏳ 处理业务(可能很耗时)

processOrder(order);

// ✅ 只有业务成功,才确认消息

channel.basicAck(deliveryTag, false);

log.info("订单[{}]处理成功,消息已确认", order.getId());

} catch (OrderProcessException e) {

// 业务异常:订单已存在、库存不足等

// 这种不应该重试,应该进死信队列

try {

log.warn("订单[{}]处理失败(业务异常),进死信队列", order.getId());

channel.basicNack(deliveryTag, false, false); // requeue=false

} catch (IOException ioe) {

log.error("ACK操作失败", ioe);

}

} catch (TimeoutException | ConnectException e) {

// 临时异常:网络超时、数据库连接失败

// 这种应该重试

try {

log.warn("订单[{}]处理失败(临时异常),重新入队", order.getId());

channel.basicNack(deliveryTag, false, true); // requeue=true

} catch (IOException ioe) {

log.error("ACK操作失败", ioe);

}

} catch (Exception e) {

// 未知异常

try {

log.error("订单[{}]处理异常,进死信队列", order.getId(), e);

channel.basicNack(deliveryTag, false, false); // requeue=false

} catch (IOException ioe) {

log.error("ACK操作失败", ioe);

}

}

}

三个ACK方法的对比:

// 1️⃣ basicAck:确认消息(消息被成功处理)

channel.basicAck(deliveryTag, false);

// false: 只确认这一条消息

// 2️⃣ basicNack:拒绝消息

channel.basicNack(deliveryTag, false, true); // requeue=true,重新进队列

channel.basicNack(deliveryTag, false, false); // requeue=false,进死信队列

// 3️⃣ basicReject:拒绝单条消息(不推荐,功能不如basicNack)

channel.basicReject(deliveryTag, true);

第四道防线:死信队列(DLX)

当消费者拒绝消息(requeue=false)时,消息会自动进入死信队列,供人工审核处理。

完整配置

@Configuration

public class RabbitMQDLXConfig {

// ==================== 原业务队列 ====================

public static final String ORDER_QUEUE = "order.queue";

public static final String ORDER_EXCHANGE = "order.exchange";

// ==================== 死信队列 ====================

public static final String ORDER_DLX_EXCHANGE = "order.dlx.exchange";

public static final String ORDER_DLX_QUEUE = "order.dlx.queue";

// ────── 原Exchange ──────

@Bean

public DirectExchange orderExchange() {

return new DirectExchange(ORDER_EXCHANGE, true, false);

}

// ────── 原Queue(配置DLX)──────

@Bean

public Queue orderQueue() {

return QueueBuilder.durable(ORDER_QUEUE)

// 🔴 关键:指定死信交换机

.withArgument("x-dead-letter-exchange", ORDER_DLX_EXCHANGE)

.withArgument("x-dead-letter-routing-key", "order.dlx")

// 可选:限制队列长度,超过则进DLX

.withArgument("x-max-length", 5000000) // 500万条

.withArgument("x-overflow", "reject-publish") // 超过时拒绝新消息

.build();

}

@Bean

public Binding orderBinding() {

return BindingBuilder.bind(orderQueue())

.to(orderExchange())

.with("order.*");

}

// ────── 死信Exchange和Queue ──────

@Bean

public DirectExchange orderDlxExchange() {

return new DirectExchange(ORDER_DLX_EXCHANGE, true, false);

}

@Bean

public Queue orderDlxQueue() {

return new Queue(ORDER_DLX_QUEUE, true);

}

@Bean

public Binding orderDlxBinding() {

return BindingBuilder.bind(orderDlxQueue())

.to(orderDlxExchange())

.with("order.dlx");

}

}

死信消息处理

@Entity

@Table(name = "dead_letter")

@Data

@NoArgsConstructor

public class DeadLetter {

@Id

@GeneratedValue(strategy = GenerationType.IDENTITY)

private Long id;

@Column(nullable = false, unique = true)

private String messageId;

@Column(columnDefinition = "LONGTEXT", nullable = false)

private String content;

@Column

private String errorReason;

@Column(nullable = false)

private String status; // PENDING_REVIEW, PROCESSED, IGNORED

@Column(nullable = false, updatable = false)

private LocalDateTime receiveTime;

@Column

private LocalDateTime reviewTime;

@Column

private Long reviewerId;

@PrePersist

protected void onCreate() {

receiveTime = LocalDateTime.now();

}

}

@Repository

public interface DeadLetterRepository extends JpaRepository<DeadLetter, Long> {

@Query("SELECT d FROM DeadLetter d WHERE d.status = 'PENDING_REVIEW' " +

"ORDER BY d.receiveTime ASC")

List<DeadLetter> findPendingReview();

}

@RabbitListener(queues = "order.dlx.queue")

public void handleDeadLetter(

Message message,

Channel channel,

@Header(AmqpHeaders.DELIVERY_TAG) long deliveryTag) throws IOException {

try {

String content = new String(message.getBody(), StandardCharsets.UTF_8);

String messageId = message.getMessageProperties()

.getHeader("X-Message-ID").toString();

log.error("⚠️ 接收到死信消息,messageId: {}, 内容: {}", messageId, content);

// ===== 记录到DB,供人工审核 =====

DeadLetter deadLetter = new DeadLetter();

deadLetter.setMessageId(messageId);

deadLetter.setContent(content);

deadLetter.setStatus("PENDING_REVIEW");

deadLetter.setErrorReason("消费失败,进入死信队列");

deadLetterRepository.save(deadLetter);

// ===== 发送告警(钉钉、企业微信等) =====

// alertService.notifyDeadLetter(messageId, content);

// ✅ 确认消息(已保存到DB,可以安全删除)

channel.basicAck(deliveryTag, false);

} catch (Exception e) {

log.error("处理死信消息异常", e);

// 即使处理失败,也要确认(否则会死循环)

channel.basicAck(deliveryTag, false);

}

}

第五道防线:定时补偿任务

即使有了上面4道防线,仍可能因为极端情况(Broker和消费者同时宕机)导致消息丢失。所以需要最后一道防线:定时检查并重试。

@Component

@Slf4j

public class MessageCompensationTask {

@Autowired

private OrderMessageRepository messageRepository;

@Autowired

private RabbitTemplate rabbitTemplate;

/**

* 每分钟检查一次,重试1小时内失败且重试次数<3的消息

*/

@Scheduled(fixedDelay = 60000) // 每60秒执行

public void retryFailedMessages() {

try {

LocalDateTime oneHourAgo = LocalDateTime.now().minusHours(1);

List<OrderMessage> failedMessages = messageRepository.findFailedMessages(

oneHourAgo,

3 // maxRetryCount

);

if (failedMessages.isEmpty()) {

return;

}

log.info("📋 补偿任务:发现{}条需要重试的消息", failedMessages.size());

for (OrderMessage msg : failedMessages) {

try {

// 重新发送消息

rabbitTemplate.convertAndSend(

"order.exchange",

"order.create",

msg.getContent(),

new CorrelationData(msg.getId())

);

// 更新重试次数和时间

msg.setRetryCount(msg.getRetryCount() + 1);

msg.setLastRetryTime(LocalDateTime.now());

messageRepository.save(msg);

log.info("✅ 消息[{}]第{}次重试成功", msg.getId(), msg.getRetryCount());

} catch (Exception e) {

log.error("❌ 消息[{}]重试失败", msg.getId(), e);

// 继续处理下一条,不要因为一条失败而停止

}

}

// 检查已放弃的消息(超过3次重试仍然失败)

List<OrderMessage> giveupMessages = messageRepository.findGiveupMessages(3);

if (!giveupMessages.isEmpty()) {

log.warn("⚠️ 发现{}条已放弃重试的消息,需要人工处理", giveupMessages.size());

// 可以发送告警给管理员

}

} catch (Exception e) {

log.error("补偿任务异常", e);

}

}

}

第三章:高级特性与性能优化

Prefetch(QoS):消费者预取策略

Prefetch控制消费者一次拉取多少条消息,直接影响吞吐量。

factory.setPrefetchCount(10); // 一次预取10条

性能对比:

prefetch=1: 消费速率 = 1条消息 / 500ms = 2 msg/s

prefetch=10: 消费速率 = 10条消息 / 500ms = 20 msg/s

prefetch=100: 消费速率 = 100条消息 / 500ms = 200 msg/s

吞吐量足足提升了100倍!

但prefetch也有风险:

如果prefetch=1000,消费者一次拉1000条消息

假设处理过程中消费者宕机

→ 这1000条消息已经离开Broker,不会被其他消费者处理

→ 消息可能丢失!

所以prefetch不能太大。经验法则:

业务处理时间 < 10ms → prefetch=100

业务处理时间 10-100ms → prefetch=20

业务处理时间 100-1s → prefetch=10

业务处理时间 > 1s → prefetch=1(甚至需要异步处理)

延迟队列:实现"定时任务"

场景:订单30分钟未支付自动取消

方案1:插件方式(推荐)

# 1. 下载并安装插件

wget https://github.com/rabbitmq/rabbitmq-delayed-message-exchange/releases/download/v3.11.1/rabbitmq_delayed_message_exchange-3.11.1.ez

cp rabbitmq_delayed_message_exchange-3.11.1.ez /usr/lib/rabbitmq/lib/rabbitmq_server-3.11.1/plugins/

rabbitmq-plugins enable rabbitmq_delayed_message_exchange

systemctl restart rabbitmq-server

@Configuration

public class DelayedMessageExchangeConfig {

public static final String DELAYED_EXCHANGE = "order.delayed.exchange";

public static final String DELAYED_QUEUE = "order.delayed.queue";

/**

* 声明延迟消息交换机(需要插件支持)

*/

@Bean

public CustomExchange delayedExchange() {

return new CustomExchange(

DELAYED_EXCHANGE,

"x-delayed-message", // ← 特殊类型

true,

false,

Collections.singletonMap("x-delayed-type", "direct")

);

}

@Bean

public Queue delayedQueue() {

return new Queue(DELAYED_QUEUE, true);

}

@Bean

public Binding delayedBinding() {

return BindingBuilder.bind(delayedQueue())

.to(delayedExchange())

.with("order.delayed.*");

}

}

// 发送延迟消息

@Service

public class OrderPaymentService {

@Autowired

private RabbitTemplate rabbitTemplate;

public void schedulePaymentTimeout(Order order) {

Message message = MessageBuilder

.withBody(JSON.toJSONString(order).getBytes())

.setDeliveryMode(MessageDeliveryMode.PERSISTENT)

.build();

rabbitTemplate.convertAndSend(

"order.delayed.exchange",

"order.payment.timeout",

message,

msg -> {

// 设置延迟:30分钟 = 1800000毫秒

msg.getMessageProperties()

.setHeader("x-delay", 30 * 60 * 1000L);

return msg;

}

);

log.info("订单[{}]支付超时消息已发送(30分钟后触发)", order.getId());

}

}

// 消费延迟消息

@RabbitListener(queues = "order.delayed.queue")

public void handlePaymentTimeout(

Order order,

Channel channel,

@Header(AmqpHeaders.DELIVERY_TAG) long deliveryTag) throws IOException {

try {

log.info("处理订单[{}]支付超时(30分钟未支付)", order.getId());

// 查询订单状态,如果仍未支付,则取消

Order existingOrder = orderService.getOrder(order.getId());

if (existingOrder != null &&

existingOrder.getStatus() == OrderStatus.PENDING_PAYMENT) {

orderService.cancelOrder(existingOrder);

log.info("✅ 订单[{}]已自动取消", order.getId());

}

channel.basicAck(deliveryTag, false);

} catch (Exception e) {

log.error("处理支付超时异常", e);

channel.basicNack(deliveryTag, false, true); // 重新入队重试

}

}

优点:精度高(毫秒级)、灵活(每条消息不同延迟)、简单

缺点:需要安装插件

消息顺序:如何在高并发下保证顺序

问题:多消费者导致乱序

Queue: [msg1][msg2][msg3][msg4][msg5]

消费者A拉msg1(处理500ms)

消费者B拉msg2(处理100ms)

T1: A处理msg1...

T2: B完成msg2✓ (在msg1之前!)

T3: A完成msg1✓

结果:顺序乱掉了

解决方案:分片(推荐)

关键思想:同一业务进同一个队列

@Configuration

public class OrderShardingConfig {

private static final int SHARD_COUNT = 10;

// 创建10个顺序队列

@Bean

public List<Queue> shardingQueues() {

List<Queue> queues = new ArrayList<>();

for (int i = 0; i < SHARD_COUNT; i++) {

queues.add(new Queue("order.queue.shard." + i, true));

}

return queues;

}

// Exchange和Binding

@Bean

public TopicExchange orderExchange() {

return new TopicExchange("order.exchange", true, false);

}

@Bean

public List<Binding> shardingBindings(

TopicExchange orderExchange,

List<Queue> shardingQueues) {

List<Binding> bindings = new ArrayList<>();

for (int i = 0; i < SHARD_COUNT; i++) {

bindings.add(

BindingBuilder.bind(shardingQueues.get(i))

.to(orderExchange)

.with("order.shard." + i + ".*")

);

}

return bindings;

}

}

// 发送消息时,根据订单ID选择分片

@Service

public class OrderEventPublisher {

@Autowired

private RabbitTemplate rabbitTemplate;

public void publishOrderEvent(Order order, String eventType) {

// 根据订单ID哈希,选择分片

// 同一订单的所有消息都进同一个分片队列

int shardIndex = Math.abs(order.getId().hashCode()) % 10;

String routingKey = String.format("order.shard.%d.%s", shardIndex, eventType);

rabbitTemplate.convertAndSend(

"order.exchange",

routingKey,

order

);

}

}

// 消费:每个分片有一个消费者(或线程池)

@Component

public class OrderEventConsumer {

@RabbitListener(queues = "order.queue.shard.0")

public void handleShard0(Order order) { processOrder(order); }

@RabbitListener(queues = "order.queue.shard.1")

public void handleShard1(Order order) { processOrder(order); }

// ... 类似地定义shard2到shard9

private void processOrder(Order order) {

log.info("处理订单[{}]", order.getId());

orderService.process(order);

}

}

优点:

- ✅ 同一订单保证顺序(同一分片)

- ✅ 不同订单可以并行(不同分片)

- ✅ 吞吐量提升10倍(10个分片)

- ✅ 易于扩展(增加分片数)

第四章:Spring Boot完整集成示例

application.yml配置文件

spring:

application:

name: rabbitmq-demo

rabbitmq:

# 连接配置

addresses: 192.168.1.10:5672,192.168.1.11:5672,192.168.1.12:5672

username: rabbitmq_user

password: password123

virtual-host: /

connection-timeout: 10000ms

# 发布者配置

publisher-confirm-type: correlated # 异步确认

publisher-returns: true

template:

mandatory: true

retry:

enabled: true

initial-interval: 1000ms

max-interval: 10000ms

multiplier: 2.0

# 监听器配置

listener:

simple:

acknowledge-mode: manual

prefetch: 10

concurrency: 10

max-concurrency: 20

type: simple

datasource:

url: jdbc:mysql://localhost:3306/rabbitmq_demo?useUnicode=true&characterEncoding=utf8

username: root

password: root

driver-class-name: com.mysql.cj.jdbc.Driver

jpa:

hibernate:

ddl-auto: update

show-sql: false

properties:

hibernate:

dialect: org.hibernate.dialect.MySQL8Dialect

logging:

level:

root: INFO

com.example: DEBUG

org.springframework.amqp: DEBUG

第五章:故障排查与监控

常见问题

问题1:消息堆积

症状:Queue中消息数不断增加

原因排查:

1. rabbitmqctl list_queues name messages consumers

2. 查消费速率是否下降

3. 检查消费者CPU、内存、GC日志

4. 查数据库慢查询

解决方案:

- 优化消费逻辑(批量、异步、缓存)

- 扩容消费者实例

- 临时方案:新建临时队列,快速启动临时消费者

问题2:消息丢失

验证步骤:

1. 检查RabbitMQConfig中是否配置了持久化

2. 检查AcknowledgeMode是否为MANUAL

3. 查看消费者日志,有没有异常

4. 对比DB中的消息记录与实际处理

常见原因:

- autoAck=true(改为MANUAL)

- Exchange/Queue/Message没有持久化

- Broker宕机未恢复

- 消费者异常没有捕捉

第六章:面试题与标准答案

题目1:如何保证消息100%不丢失?

标准答案:

从生产者、Broker、消费者三端保障:

生产者端:

- Publisher Confirm机制(confirmCallback + returnCallback)

- 消息发送前记录到数据库

- 失败消息重试 + 定时补偿任务

Broker端:

- Exchange、Queue、消息都设置durable=true/PERSISTENT

- 使用Quorum Queues(RabbitMQ 3.8+)

消费者端:

- Manual ACK(AcknowledgeMode.MANUAL)

- 业务成功才确认,失败进死信队列

- 定时检查未处理消息

代码示例:

// 生产者

OrderMessage msg = save(order); // 保存到DB

rabbitTemplate.convertAndSend(..., new CorrelationData(msg.getId()));

// Broker

Exchange durable=true, Queue durable=true, Message PERSISTENT=2

// 消费者

channel.basicAck(); // 成功

channel.basicNack(); // 失败进DLX

题目2:RabbitMQ vs Kafka 如何选择?

| 维度 | RabbitMQ | Kafka | RocketMQ |

|---|---|---|---|

| 定位 | 通用消息队列 | 分布式流式消息 | 高可用企业级消息 |

| 吞吐量 | 中等 | 极高 | 高 |

| 延迟 | 低 | 中 | 低 |

| 可靠性 | 高 | 中高 | 极高 |

| 事务消息 | 弱 | 不支持 | 原生支持 |

| 延时消息 | 麻烦、不精准 | 不支持 | 原生、好用 |

| 复杂度 | 低,易上手 | 较高 | 中等 |

| 语言 | Erlang | Java/Scala | Java |

| 适合场景 | 小 / 中业务、复杂路由、低延迟 | 日志、大数据、高吞吐 | 电商、金融、订单、支付 |

选 RabbitMQ 的情况:

- 业务规模小、需求简单,需要快速部署、低运维成本;

- 对消息路由灵活性要求高(如按路由键分发、死信队列);

- 场景以「低吞吐、低延迟」为主(如即时通知、小型系统的异步任务)。

选 Kafka 的情况:

- 核心需求是超高吞吐、海量数据传输(如日志采集、用户行为埋点);

- 需要对接大数据生态(Spark/Flink 实时计算);

- 允许牺牲少量可靠性换取性能,或能接受复杂的可靠性配置。

选 RocketMQ 的情况:

- 业务是电商 / 金融等「高可靠 + 高吞吐」场景(如订单、支付、库存);

- 需要分布式事务消息、延迟消息等企业级特性;

- 微服务架构,希望兼顾易用性和性能,且倾向国产适配友好的中间件。

总结

- 轻量通用选 RabbitMQ:中小系统、灵活路由、低运维成本优先;

- 大数据高吞吐选 Kafka:日志采集、流处理、海量数据传输优先;

- 企业级核心业务选 RocketMQ:电商 / 金融、事务消息、兼顾吞吐与可靠优先。

题目3:如何防止重复消费?

方案1:Redis + setnx

@RabbitListener(queues = "order.queue")

public void handle(Order order) {

String key = "processed:" + order.getId();

if (redisTemplate.opsForValue().setIfAbsent(key, "1")) {

orderService.process(order);

}

}

方案2:数据库唯一索引

CREATE UNIQUE INDEX idx_unique_order_id ON orders(order_id);

方案3:状态机(推荐)

if (order.status == PENDING) {

order.status = PROCESSING;

order.save(); // 原子操作

orderService.process(order);

order.status = COMPLETED;

order.save();

}

第七章:总结与最佳实践

必须记住的三句话

-

Producer 确认 + Broker 持久化 + 消费者手动 ACK + 死信队列补偿构成 RabbitMQ 完整消息可靠性保障体系。

-

预取数 Prefetch 与业务处理耗时正相关是消费吞吐量调优的核心依据。

-

同一业务数据进入同一队列是高并发场景下保证消息顺序的最简方案。

落地实践检查清单

- 生产者开启发布确认(Publisher Confirm)与 Return 回调机制

- 交换机、队列、消息均配置持久化(durable / PERSISTENT)

- 消费者使用手动确认机制(Manual ACK),避免消息丢失

- 已配置死信队列(DLX),支持异常消息兜底与人工审核

- 配备定时任务,对异常 / 丢失消息做定期补偿校验

- Prefetch 预取值根据业务处理耗时动态调整,避免堆积或空转

- 需保证消息顺序时,采用同业务分片入同一队列方案

- 已接入监控告警:消息堆积、消费延迟、异常消息量、服务健康度

- 编制应急方案:堆积处理、流量削峰、服务扩容、故障降级手册

附录:SQL语句

-- 消息表

CREATE TABLE order_message (

id VARCHAR(36) PRIMARY KEY,

order_id BIGINT NOT NULL,

content LONGTEXT NOT NULL,

status VARCHAR(20) NOT NULL, -- INIT, SENT, FAILED, PROCESSED

error_msg VARCHAR(500),

retry_count INT DEFAULT 0,

max_retry INT DEFAULT 3,

create_time DATETIME NOT NULL,

last_retry_time DATETIME,

processed_time DATETIME,

INDEX idx_status(status),

INDEX idx_create_time(create_time)

) COMMENT='RabbitMQ消息发送记录';

-- 死信表

CREATE TABLE dead_letter (

id BIGINT PRIMARY KEY AUTO_INCREMENT,

message_id VARCHAR(36) UNIQUE NOT NULL,

content LONGTEXT NOT NULL,

error_reason VARCHAR(500),

status VARCHAR(20) DEFAULT 'PENDING_REVIEW', -- PENDING_REVIEW, PROCESSED, IGNORED

receive_time DATETIME NOT NULL DEFAULT CURRENT_TIMESTAMP,

review_time DATETIME,

INDEX idx_message_id(message_id),

INDEX idx_status(status)

) COMMENT='消费失败的死信消息';

最后的话

其实 RabbitMQ 本身并不难,真正难的,是理解它为什么如此设计。

真正的功底,从不在纸面的架构图里。当你在凌晨三点,面对数百万消息积压时,你不会去背原理,而是会立刻思考:

我的预取参数是否合理?Broker 内存与流量是否健康?消费者是否阻塞、等待锁、无限重试?

能定位根源、快速止血,才是一名工程师真正的素养。

希望这篇内容,能让你在实际生产中少走弯路、少踩深坑、少熬无用的夜。

愿你的消息永不丢失,服务永远平稳,系统长久稳定运行。