Coze 工作原理与应用实例:从零打造 AI Agent

Coze 工作原理与应用实例:从零打造 AI Agent

摘要:Coze(中文名:扣子)是字节跳动推出的一站式 AI Bot 开发平台。不同于简单的对话框,Coze 允许开发者通过低代码/无代码的方式,将大语言模型(LLM)与插件(Plugins)、工作流(Workflows)、知识库(Knowledge)和数据库(Memory)深度结合。本文将深入剖析 Coze 的核心工作原理,并通过一个“智能行业研报分析助手”的实战案例,演示如何构建复杂的 AI Agent。

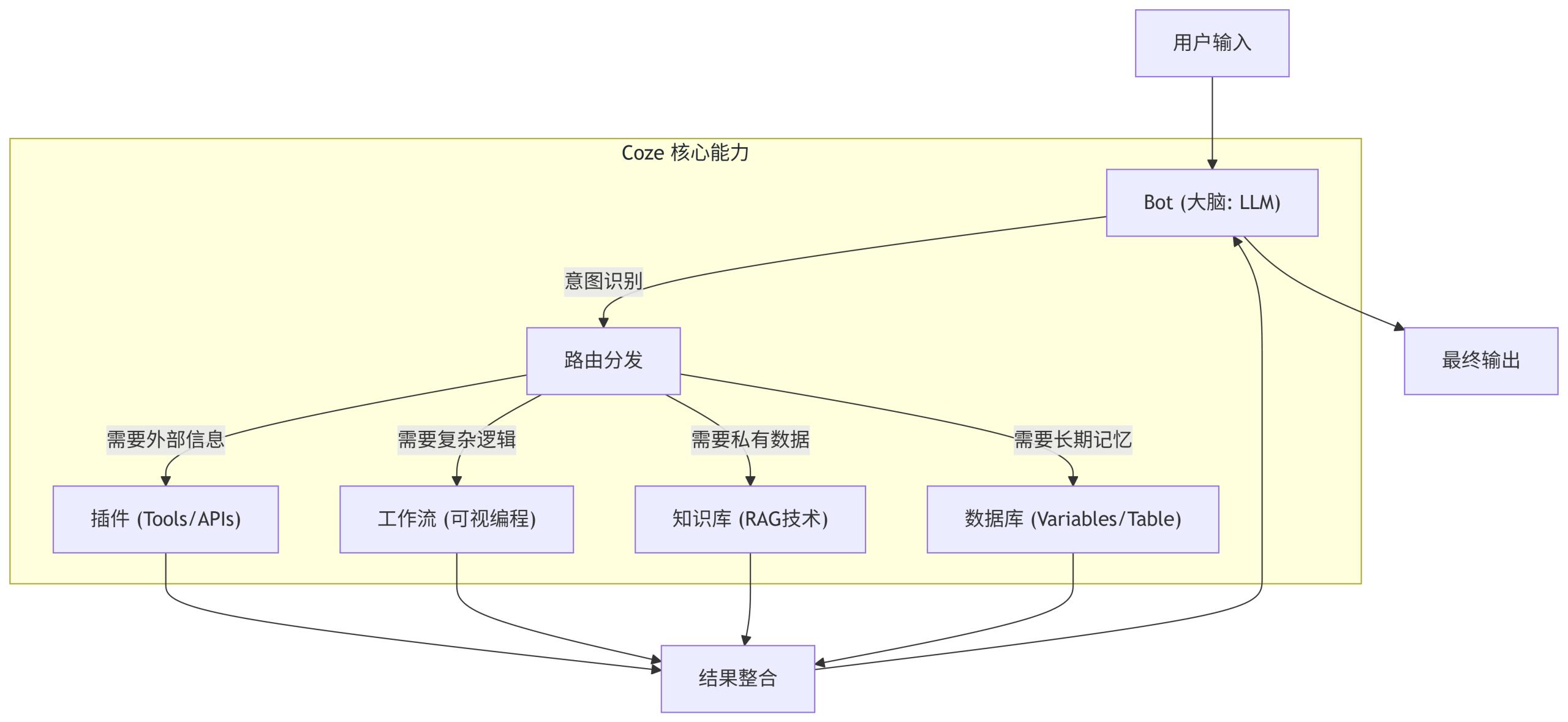

第一部分:Coze 核心工作原理

Coze 的本质是一个 Agent Orchestration Platform(智能体编排平台)。它解决了原生 LLM(如 GPT-4, Gemini, 云雀大模型)无法联网、无法记忆长周期数据、无法执行复杂逻辑痛点。

1.1 架构概览

我们可以将 Coze 构建的 Bot 想象成一个“数字员工”,其身体构造如下:

1.2 核心组件解析

A. 模型(Model – 大脑)

Bot 的核心驱动力。Coze 支持多种模型(CN版支持云雀、Moonshot等;国际版支持 GPT-4, GPT-3.5 等)。通过 Prompt Engineering(提示词工程),我们定义 Bot 的角色(人设)和边界。

B. 插件(Plugins – 手和眼)

这是 Coze 区别于普通 Chatbot 的关键。插件是对 API 的封装。

- 官方插件:Google 搜索、必应新闻、浏览网页、生成图片等。

- 自定义插件:开发者可以将自己的后端 API 接入 Coze,实现查库存、发邮件、写飞书文档等操作。

C. 工作流(Workflow – 逻辑思维)

当任务不能通过一步对话解决时,需要使用工作流。工作流是一个可视化拖拽界面(Flow-based programming)。

- 原理:输入 -> 节点处理(LLM/代码/选择器) -> 输出。

- 优势:由于 LLM 输出具有随机性,工作流通过固定的逻辑节点约束 LLM,保证业务流程的稳定性。

D. 知识库(Knowledge – 长期记忆)

利用 RAG (Retrieval-Augmented Generation) 技术。

- 用户上传文档(PDF/Word/URL)。

- Coze 将文档切片并向量化(Embedding)存入向量数据库。

- 用户提问时,系统先在库中检索相关片段,连同问题一起喂给 LLM,生成基于事实的回答。

第二部分:Coze 实战应用实例

项目名称:每日科技情报自动简报 Bot

场景痛点:作为一个科技从业者,每天需要从大量新闻中筛选高价值信息,并总结成简报发送到团队群。人工做耗时耗力。

解决方案:利用 Coze 搭建一个 Bot,自动搜索最新科技新闻 -> 筛选 -> 总结 -> 格式化输出。

2.1 准备工作

- 登录 Coze 官网 (国内版) 或 Coze.com (国际版)。

- 点击 Create Bot,命名为

TechBrief_Agent。

2.2 编排人设 (Prompt)

在 Persona & Prompt 区域输入:

# Role

你是一名资深的科技媒体主编,擅长从纷繁复杂的信息中提取核心价值。

# Goal

根据用户输入的关键词(如“AI大模型”、“新能源汽车”),搜索最新的一手资讯,并生成一份Markdown格式的早报。

# Constraints

- 必须引用真实的新闻来源。

- 语言风格简洁、专业。

- 每次输出不超过 5 条核心新闻。

# Skills

- 使用搜索工具获取最新信息。

- 使用工作流对信息进行清洗和总结。

2.3 核心:设计工作流 (Workflow)

这是本案例的精华。我们要创建一个名为 get_tech_news 的工作流。

步骤图解:

-

Start Node (开始节点):

- 定义输入变量:

keyword(String)。

- 定义输入变量:

-

Plugin Node (搜索节点):

- 添加插件:选择

Bing Web Search或Toutiao Search。 - 输入参数:引用 Start Node 的

keyword。 - 目的:获取原始的新闻列表数据(JSON格式)。

- 添加插件:选择

-

Code Node (数据清洗节点 – Python):

- LLM 直接处理大量搜索结果容易造成 Token 浪费或幻觉,我们需要用 Python 提取标题和链接。

- 代码示例:

async def main(args: Args) -> Output: params = args.params search_results = params['search_results'] # 来自上一个节点的输出 news_list = [] # 假设 search_results 是列表结构,遍历提取前5条 for item in search_results[:5]: news_list.append({ "title": item.get('name'), "url": item.get('url'), "snippet": item.get('snippet') }) return {"filtered_news": news_list} -

LLM Node (大模型总结节点):

- 模型选择:选择长文本处理能力强的模型(如 GPT-4 Turbo 或 云雀-长文本)。

- Prompt 设置:

请根据以下原始新闻数据:{{filtered_news}} 为每一条新闻写一段 50 字以内的摘要。 最后,将它们整合成一篇 Markdown 格式的简报,包含标题、摘要和原文链接。 -

End Node (结束节点):

- 输出变量:

final_report(String),引用 LLM Node 的输出。

- 输出变量:

应用工作流:

回到 Bot 编排页面,在 Workflow 栏添加刚才创建的 get_tech_news,并告诉 Bot:“当用户询问新闻时,请调用此工作流。”

2.4 添加触发器 (Trigger) – 可选

如果希望它每天早上 8 点自动发送到群里,可以使用 Coze 的 Triggers 功能。

- 设置定时任务:

Every day at 08:00。 - 设置默认输入:

keyword = "人工智能"。

2.5 调试与发布 (Debug & Publish)

- 调试:在右侧预览窗口输入“帮我看看今天的人工智能新闻”。

- 观察日志:查看 Bot 是否正确调用了工作流,Python 代码是否报错,最终输出格式是否美观。

-

发布:点击 Publish。

- 发布渠道:你可以一键发布到 飞书 (Lark)、微信公众号、Discord 或生成 API 供自己的 App 调用。

第三部分:进阶技巧——多代理模式 (Multi-Agent)

在处理更复杂的任务时(例如:先写代码,再运行代码,然后画图,最后写报告),单体 Bot 往往力不从心。Coze 支持 Multi-Agent 模式。

工作原理

- Commander (指挥官):负责理解用户意图,将任务拆解。

-

Specialist Agents (专家):

- Coder Agent:专门负责写 Python 代码。

- Writer Agent:专门负责文案润色。

- Search Agent:专门负责查资料。

应用场景:编写一个复杂的贪吃蛇游戏。Commander 分析需求,让 Coder 写代码,让 Writer 写游戏说明书,最后由 Commander 整合交付。

第四部分:总结与展望

Coze 通过 “LLM + Workflow + Plugins” 的范式,将 AI 应用开发的门槛降到了极低。

- 对于开发者:Coze 像是一个 Serverless 的后端,省去了维护服务器和对接 LLM API 的繁琐,通过 Python 代码节点提供了足够的灵活性。

- 对于非技术人员:可视化的逻辑编排让业务专家也能把自己的一套方法论(SOP)转化为 AI 智能体。

未来趋势:

随着模型能力的提升,未来的 Coze Bot 将具备更强的自主规划能力(Autonomous),不仅是执行工作流,还能自动创建工作流来解决未知问题。

![[源力觉醒 创作者计划]_文心大模型4.5开源:从技术突破到生态共建的国产AI解读与本地部署指南](https://os.v.madlive.cn/idcmadlive/2026/04/a55e59010fba48cb9997679089a605f5.png)