27_Spring AI 干货笔记之 OpenAI SDK 聊天功能(官方支持)

一、OpenAI SDK

Spring AI 通过 OpenAI Java SDK 提供对 OpenAI 语言模型的支持,为 OpenAI 服务(包括 Microsoft Foundry 和 GitHub Models)提供了稳健且官方维护的集成方案。

此实现使用来自 OpenAI 的官方 Java SDK。如需了解 Spring AI 的替代实现,请参阅 OpenAI 聊天。

OpenAI SDK 模块会根据您提供的基础 URL 自动检测服务提供商(OpenAI、Microsoft Foundry 或 GitHub Models)。

二、认证

认证通过基础 URL 和 API 密钥完成。该实现通过 Spring Boot 属性或环境变量提供了灵活的配置选项。

2.1 使用 OpenAI

如果您直接使用 OpenAI,请在 OpenAI 注册页面 创建账户,并在 API 密钥页面 生成 API 密钥。

基础 URL 无需设置,因为它默认指向 api.openai.com/v1:

spring.ai.openai-sdk.api-key=<your-openai-api-key>

# base-url 是可选的,默认为 https://api.openai.com/v1

或使用环境变量:

export OPENAI_API_KEY=<your-openai-api-key>

# OPENAI_BASE_URL 是可选的,默认为 https://api.openai.com/v1

2.2 使用 Microsoft Foundry

当使用 Microsoft Foundry 的 URL 时,系统会自动检测到它。您可以使用属性进行配置:

spring.ai.openai-sdk.base-url=https://<your-deployment-url>.openai.azure.com

spring.ai.openai-sdk.api-key=<your-api-key>

spring.ai.openai-sdk.microsoft-deployment-name=<your-deployment-name>

或使用环境变量:

export OPENAI_BASE_URL=https://<your-deployment-url>.openai.azure.com

export OPENAI_API_KEY=<your-api-key>

无密码认证(Azure 推荐):

Microsoft Foundry 支持不提供 API 密钥的无密码认证,这在 Azure 上运行时更加安全。

要启用无密码认证,请添加 com.azure:azure-identity 依赖项:

<dependency>

<groupId>com.azure</groupId>

<artifactId>azure-identity</artifactId>

</dependency>

然后,无需 API 密钥即可配置:

spring.ai.openai-sdk.base-url=https://<your-deployment-url>.openai.azure.com

spring.ai.openai-sdk.microsoft-deployment-name=<your-deployment-name>

# 无需 api-key - 将使用环境中的 Azure 凭据

2.3 使用 GitHub Models

当使用 GitHub Models 的基础 URL 时,系统会自动检测到它。您需要创建一个具有 models:read 范围的 GitHub 个人访问令牌(PAT)。

spring.ai.openai-sdk.base-url=https://models.inference.ai.azure.com

spring.ai.openai-sdk.api-key=github_pat_XXXXXXXXXXX

或使用环境变量:

export OPENAI_BASE_URL=https://models.inference.ai.azure.com

export OPENAI_API_KEY=github_pat_XXXXXXXXXXX

为了在处理敏感信息(如 API 密钥)时增强安全性,您可以在属性中使用 Spring 表达式语言(SpEL):

spring.ai.openai-sdk.api-key=${

OPENAI_API_KEY}

2.4 添加仓库和 BOM

Spring AI 工件发布在 Maven Central 和 Spring Snapshot 仓库中。请参阅 工件仓库 部分,将这些仓库添加到您的构建系统中。

为了帮助管理依赖项,Spring AI 提供了一个 BOM(物料清单)来确保在整个项目中使用一致的 Spring AI 版本。请参阅 依赖管理 部分,将 Spring AI BOM 添加到您的构建系统中。

三、自动配置

Spring AI 为 OpenAI SDK 聊天客户端提供了 Spring Boot 自动配置。要启用它,请将以下依赖项添加到项目的 Maven pom.xml 或 Gradle build.gradle 构建文件中:

Maven

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-starter-model-openai-sdk</artifactId>

</dependency>

Gradle

dependencies {

implementation 'org.springframework.ai:spring-ai-starter-model-openai-sdk'

}

请参阅 依赖管理 部分,将 Spring AI BOM 添加到您的构建文件中。

3.1 配置属性

3.1.1 连接属性

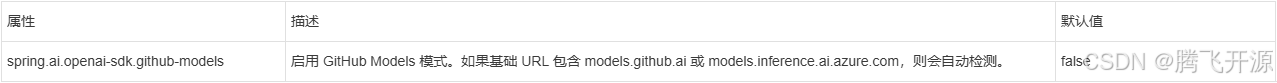

前缀 spring.ai.openai-sdk 用作属性前缀,用于配置 OpenAI SDK 客户端。

3.1.2 Microsoft Foundry (Azure OpenAI) 属性

OpenAI SDK 实现提供了对 Microsoft Foundry(Azure OpenAI)的原生支持,并支持自动配置:

Microsoft Foundry 支持无密码认证。添加 com.azure:azure-identity 依赖项,当不提供 API 密钥时,实现将自动尝试使用环境中的 Azure 凭据。

3.1.3 GitHub Models 属性

提供对 GitHub Models 的原生支持:

GitHub Models 需要一个具有 models:read 范围的个人访问令牌。通过 OPENAI_API_KEY 环境变量或 spring.ai.openai-sdk.api-key 属性进行设置。

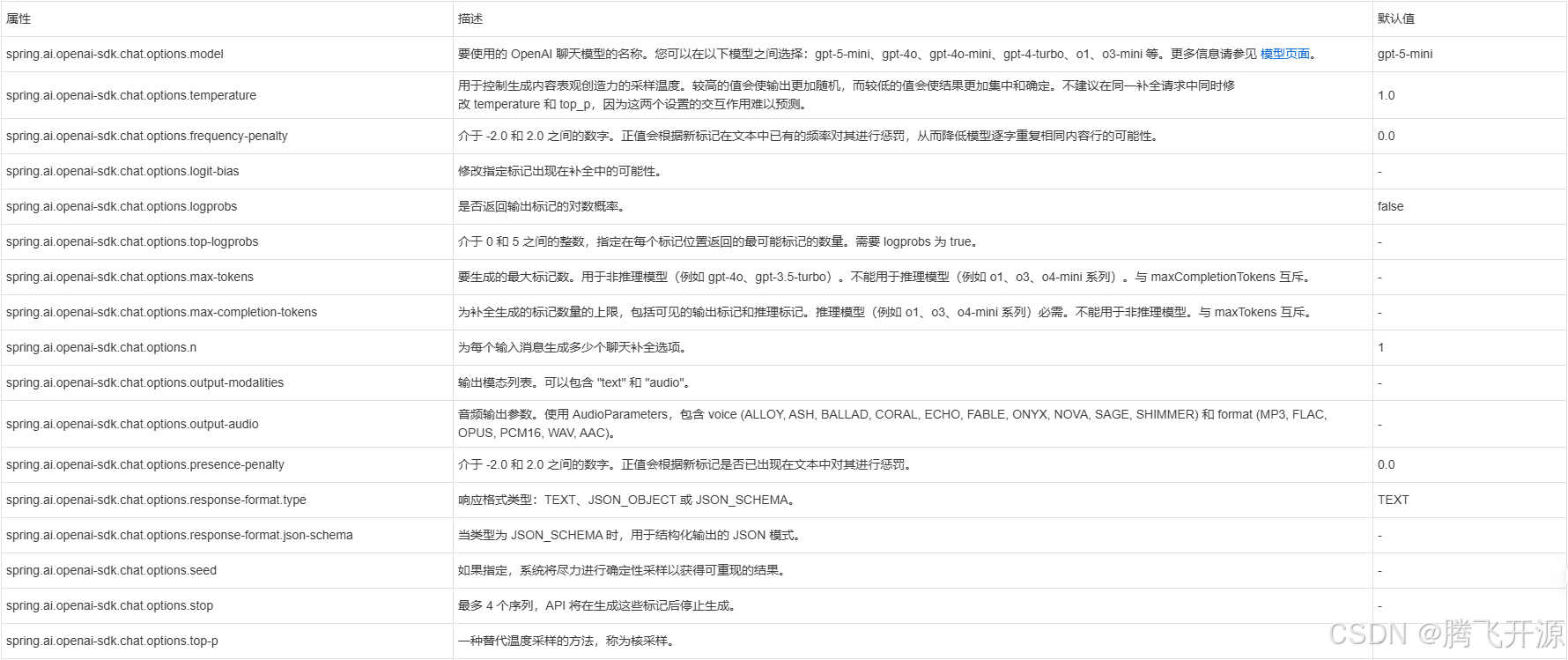

3.1.4 聊天模型属性

前缀 spring.ai.openai-sdk.chat 是用于配置聊天模型实现的属性前缀:

当使用 GPT-5 模型(如 gpt-5、gpt-5-mini 和 gpt-5-nano)时,不支持 temperature 参数。这些模型为推理进行了优化,不使用温度。指定温度值将导致错误。相比之下,对话模型如 gpt-5-chat 支持 temperature 参数。

所有以 spring.ai.openai-sdk.chat.options 为前缀的属性都可以在运行时通过向 Prompt 调用添加请求特定的 运行时选项 来覆盖。

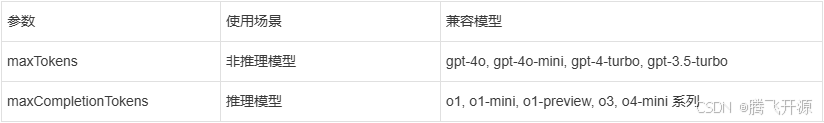

3.2 标记限制参数:特定于模型的用法

OpenAI 提供了两个互斥的参数来控制标记生成限制:

这些参数是互斥的。同时设置两者将导致来自 OpenAI 的 API 错误。

3.2.1 使用示例

对于非推理模型(gpt-4o、gpt-3.5-turbo):

ChatResponse response = chatModel.call(

new Prompt(

"用简单的术语解释量子计算。",

OpenAiSdkChatOptions.builder()

.model("gpt-4o")

.maxTokens(150) // 对于非推理模型使用 maxTokens

.build()

));

对于推理模型(o1、o3 系列):