计算机毕业设计:python多算法融合的新闻摘要情感分析平台 Django框架 Scrapy爬虫 NLP 朴素贝叶斯 TextRank算法 数据分析(建议收藏)✅

博主介绍:✌全网粉丝10W+,前互联网大厂软件研发、集结硕博英豪成立工作室。专注于计算机相关专业项目实战6年之久,选择我们就是选择放心、选择安心毕业✌

> 🍅想要获取完整文章或者源码,或者代做,拉到文章底部即可与我联系了。🍅点击查看作者主页,了解更多项目!

🍅感兴趣的可以先收藏起来,点赞、关注不迷路,大家在毕设选题,项目以及论文编写等相关问题都可以给我留言咨询,希望帮助同学们顺利毕业 。🍅

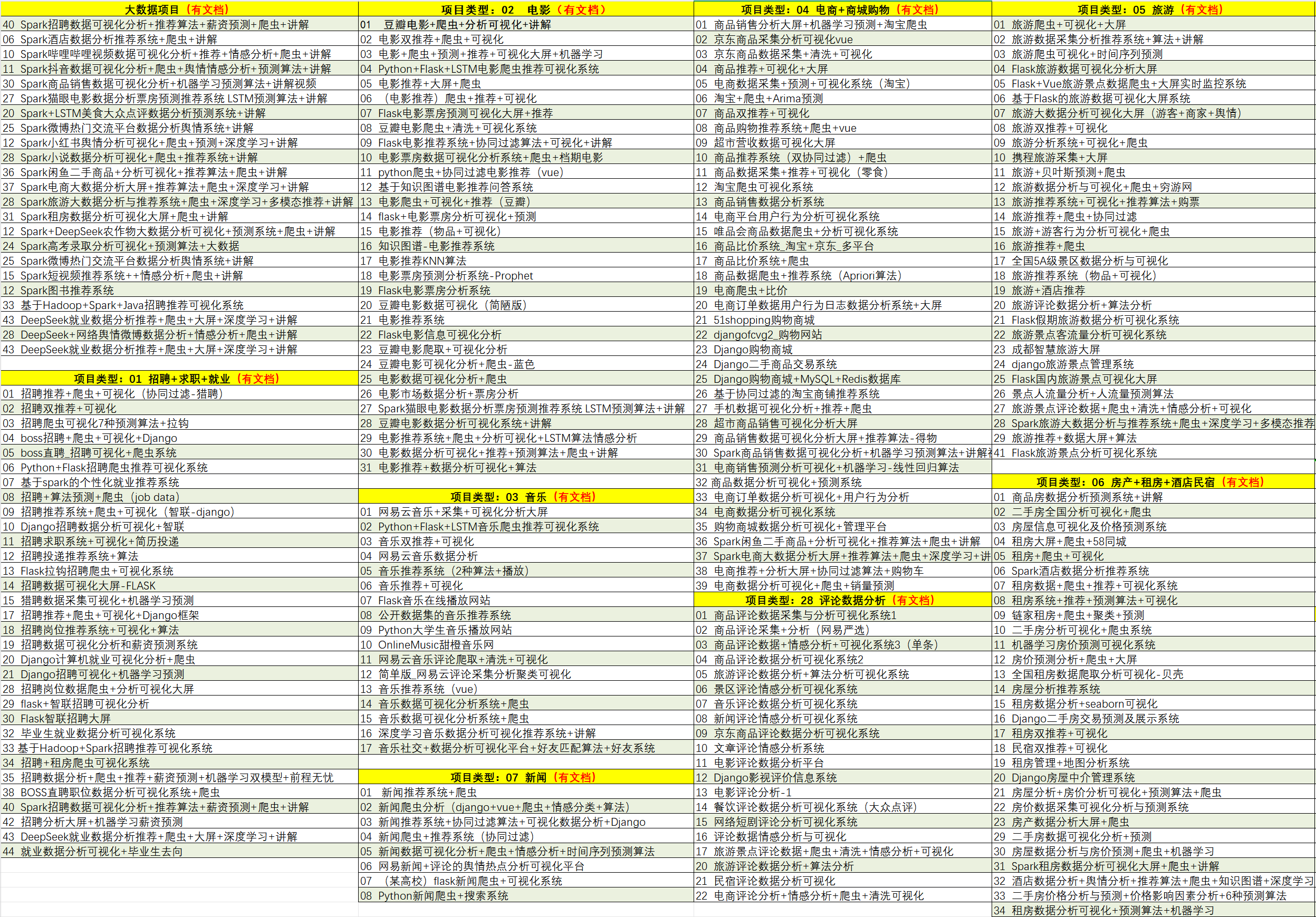

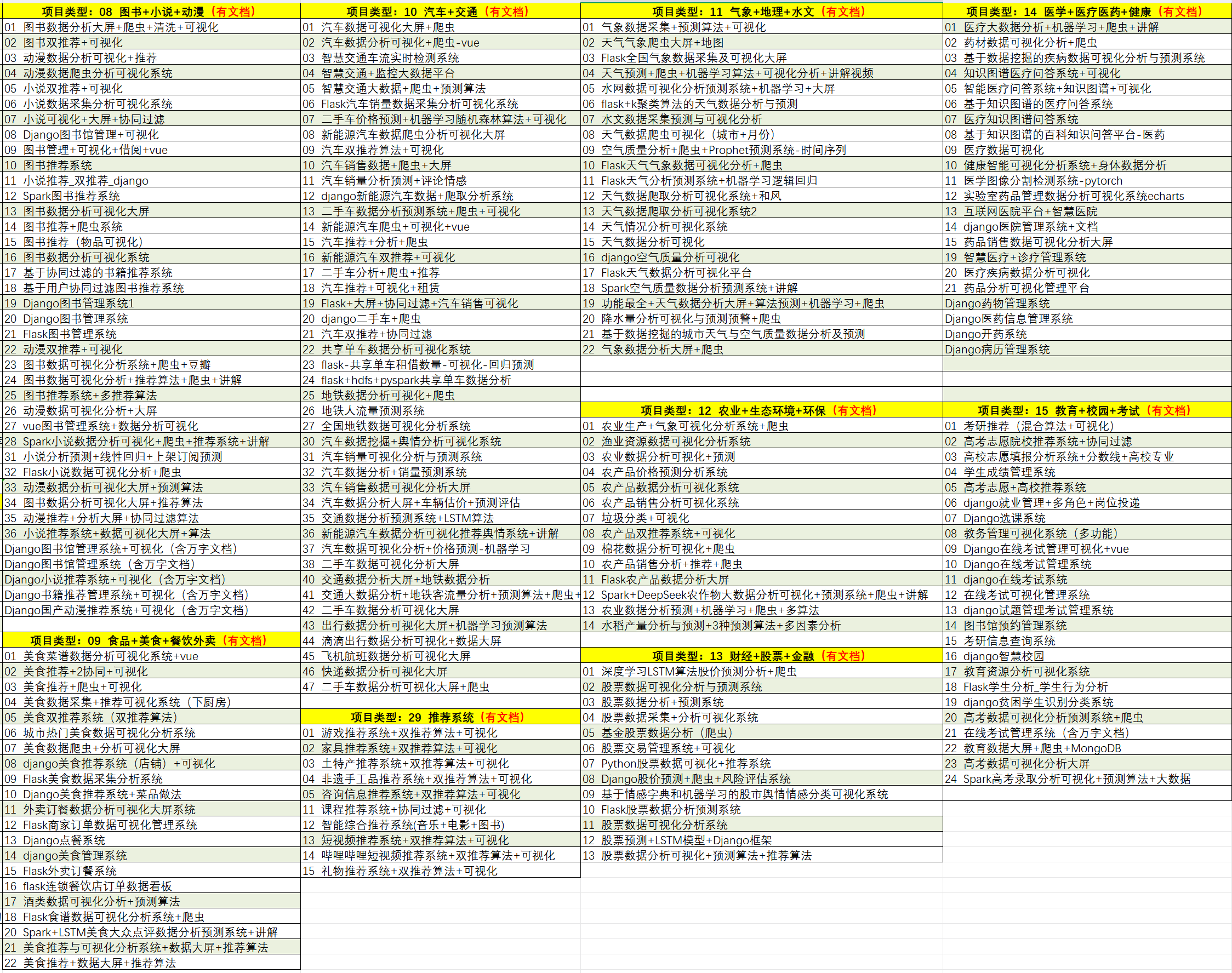

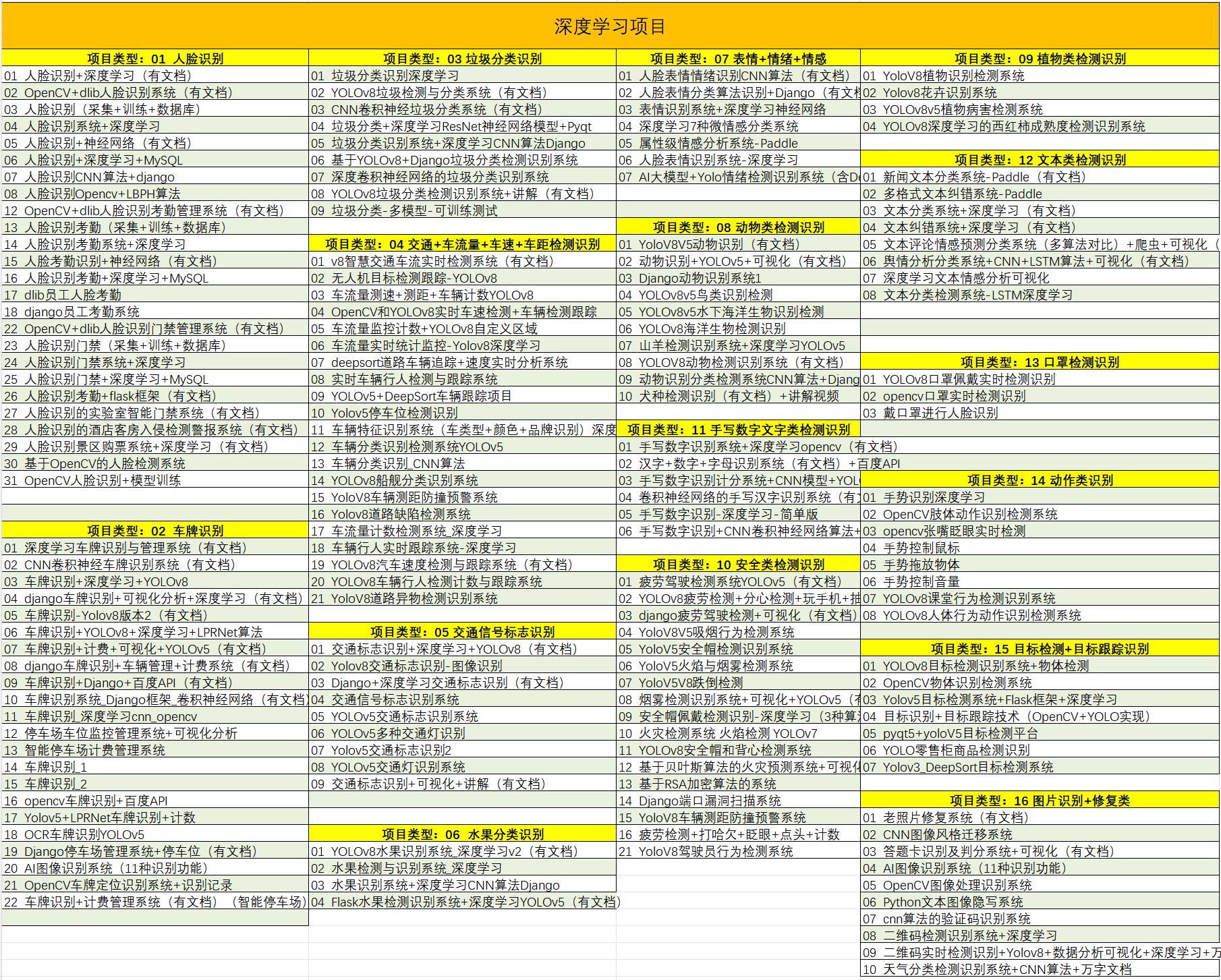

1、毕业设计:2025年计算机专业毕业设计选题汇总(建议收藏)✅

2、最全计算机专业毕业设计选题大全(建议收藏)✅

1、项目介绍

技术栈

Python语言、Django框架、Vue框架、Scrapy爬虫框架、jieba分词库、NLP算法、朴素贝叶斯算法、TextRank算法、情感分析技术

功能模块

· 新闻数据浏览

· 新闻详情页

· 新闻数据分析

· 新闻词性分析

· 后台管理

项目介绍

该新闻数据爬取情感分析系统是一个融合网络爬虫与自然语言处理技术的智能新闻分析平台。系统基于Python语言开发,整合Django后端框架、Vue前端框架与Scrapy爬虫框架,实现新闻数据的自动化采集与存储。平台为用户提供新闻列表展示、分类浏览、关键词搜索及详情查看等基础功能,同时依托NLP与机器学习技术实现深度文本分析,包括基于TextRank算法的新闻摘要抽取、基于jieba分词的关键词提取与词性标注,以及基于朴素贝叶斯算法的情感倾向判断。后台管理端支持新闻数据维护与用户权限管控,系统通过可视化页面呈现词云分析、词性分布等结果,为新闻信息的获取与内容挖掘提供了完整的智能化解决方案。

2、项目界面

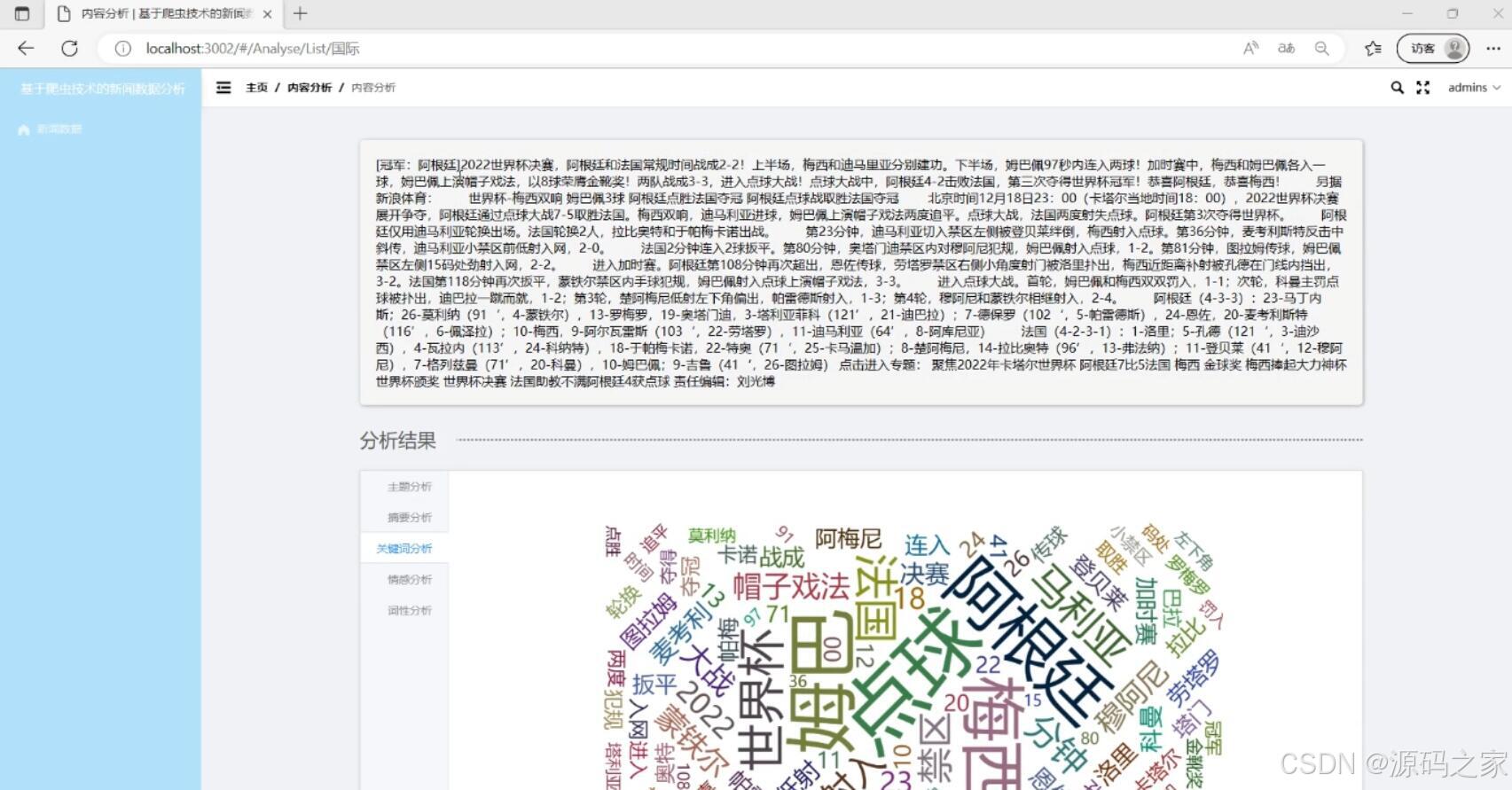

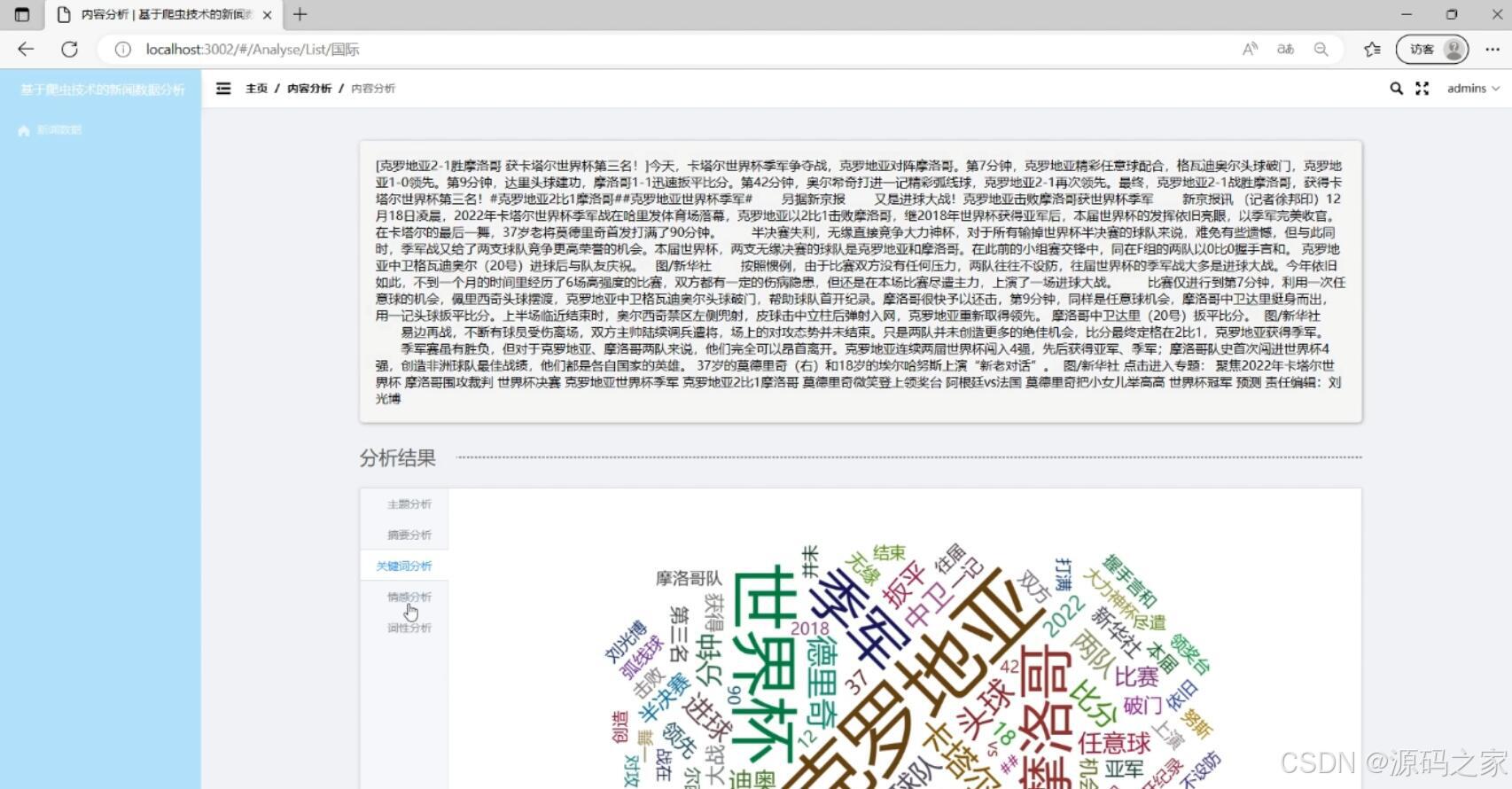

(1)新闻数据分析

该页面为基于爬虫技术的新闻数据分析模块,展示新闻原文内容,提供主题分析、摘要分析、关键词分析、情感分析、词性分析等功能,当前通过词云图呈现新闻关键词分析结果,实现新闻文本的多维度数据挖掘与可视化展示。

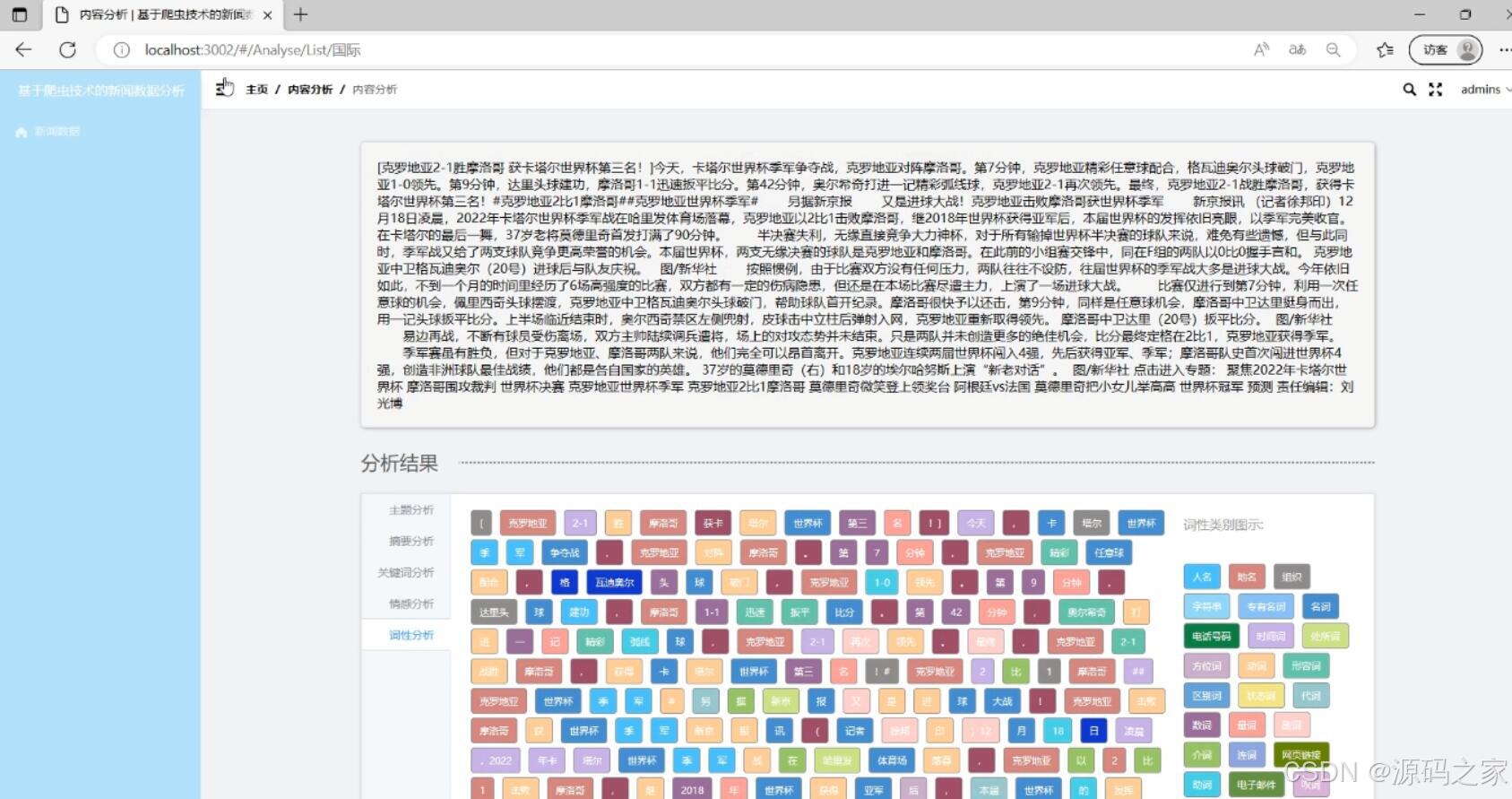

该页面为基于爬虫技术的新闻数据分析模块,展示新闻原文内容,提供主题分析、摘要分析、关键词分析、情感分析、词性分析等功能,当前通过色块矩阵与词性类别图示呈现新闻词性分析结果,实现新闻文本的多维度数据挖掘与可视化展示。

(2)新闻详情页

该页面为基于爬虫技术的新闻数据分析系统的新闻详情模块,展示新闻标题、来源、发布时间、阅读量、正文及配图内容,提供内容分析按钮,实现新闻完整信息的展示与跳转至数据分析的功能。

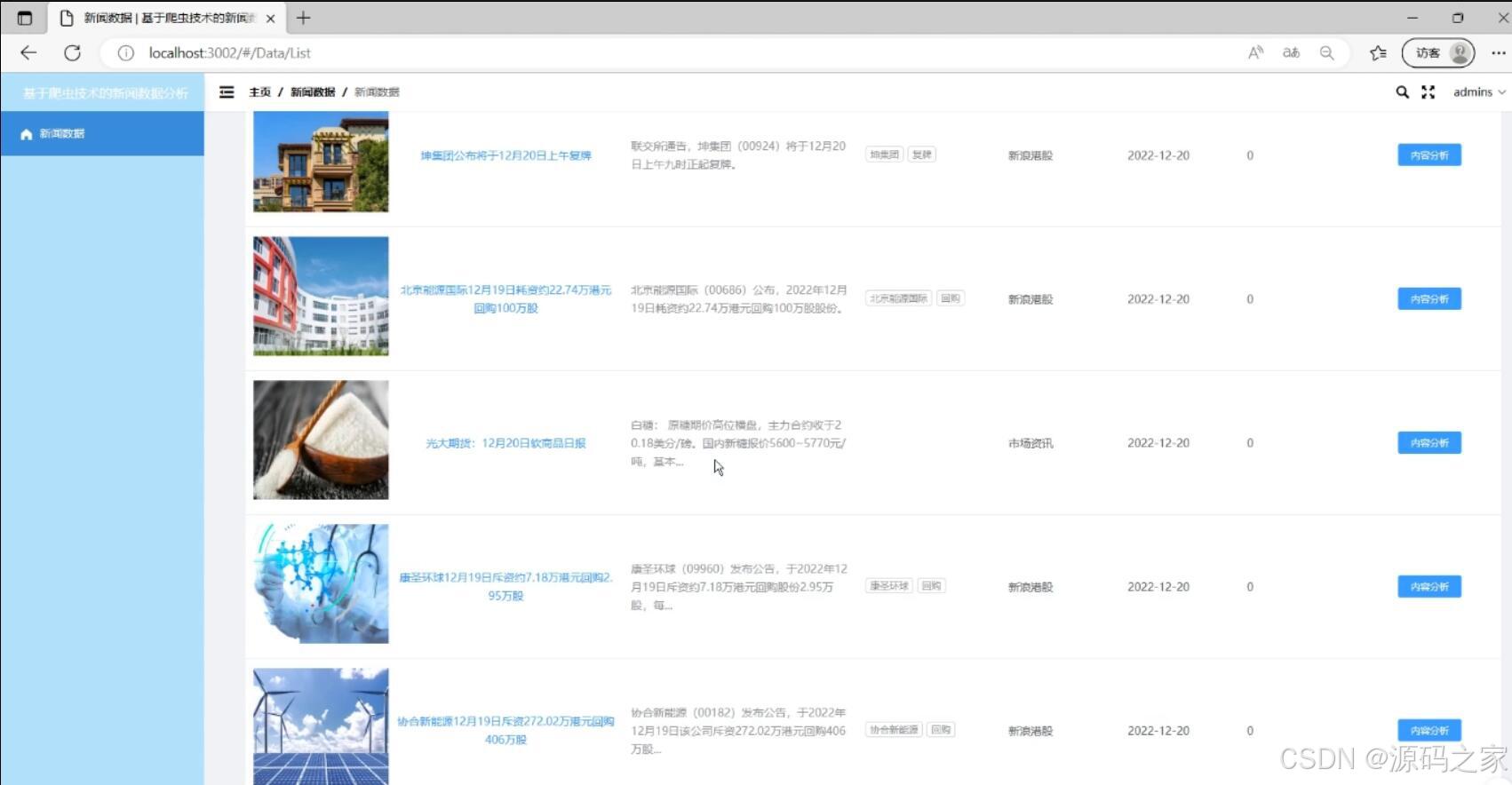

(3)新闻数据浏览

该页面为基于爬虫技术的新闻数据分析系统的新闻数据模块,以列表形式展示新闻的标题、配图、来源、发布时间等信息,每条新闻均设有内容分析按钮,实现新闻数据的浏览与跳转至内容分析的功能。

(4)新闻词性分析

该页面为基于爬虫技术的新闻数据分析模块,展示新闻原文内容,提供主题分析、摘要分析、关键词分析、情感分析、词性分析等功能,当前通过词云图呈现新闻关键词分析结果,实现新闻文本的多维度数据挖掘与可视化展示。

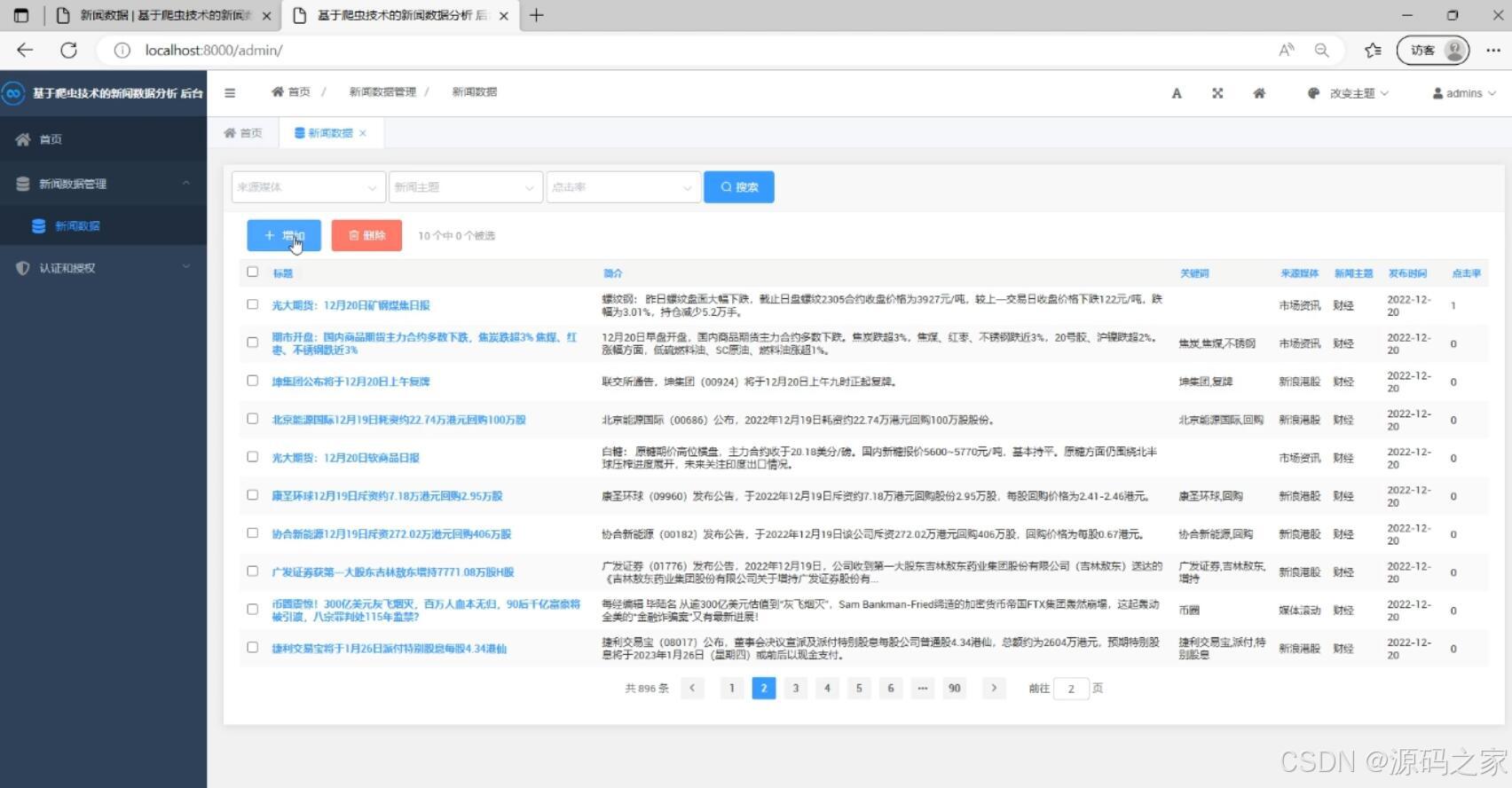

(5)后台管理

该页面为基于爬虫技术的新闻数据分析系统后台的新闻数据管理模块,提供来源媒体、新闻主题等筛选条件与搜索功能,以表格形式展示新闻标题、简介、关键词等信息,支持新闻数据的增加、删除操作,同时具备分页功能,实现新闻数据的高效管理与维护。

3、项目说明

一、技术栈简要说明

本系统采用前后端分离架构,后端基于Python语言与Django框架构建,提供稳定的业务逻辑处理能力;前端使用Vue框架开发,实现动态交互与数据渲染。数据采集层集成Scrapy爬虫框架,支持高效的分布式新闻抓取与数据持久化存储。文本处理方面运用jieba分词库进行中文分词与词性标注,结合TextRank算法实现新闻摘要自动抽取。机器学习层面采用朴素贝叶斯算法完成新闻分类与情感倾向判断,整体融合多种NLP技术构建完整的文本分析链路。

二、功能模块详细介绍

· 新闻数据浏览

该页面为系统的新闻列表展示模块,采用卡片式布局呈现新闻的标题、配图、来源及发布时间等核心信息。每条新闻条目右侧均设有内容分析按钮,用户点击后可快速跳转至该新闻的深度分析页面。列表支持分页加载,方便用户高效浏览已采集的新闻数据,实现对新闻资源的快速检索与访问入口的统一管理。

· 新闻详情页

该页面为新闻内容的完整展示模块,顶部展示新闻标题、来源媒体、发布时间及阅读量等元信息,主体区域呈现新闻正文与配图内容。页面底部设有内容分析按钮,为用户提供从基础阅读向深度分析过渡的操作入口。该模块实现了新闻原始信息的完整呈现,是用户了解新闻事件的基础阅读界面。

· 新闻数据分析

该页面为系统的核心文本挖掘模块,采用双栏布局设计。左侧展示新闻原文内容,方便用户对照参考;右侧提供主题分析、摘要分析、关键词分析、情感分析、词性分析等多个分析标签页。当前以词云图形式可视化呈现新闻关键词分析结果,词频越高对应词云字号越大,直观展示新闻的核心概念与热点词汇,实现新闻文本的多维度数据挖掘与可视化解读。

· 新闻词性分析

该页面为文本语言特征分析模块,同样采用双栏布局。左侧展示新闻原文内容,右侧默认激活词性分析功能,通过色块矩阵与词性类别图示呈现新闻文本的词性分布结果。页面将不同词性(如名词、动词、形容词等)以差异化颜色区块进行可视化编码,帮助用户快速把握文本的语法构成与语言特征,为新闻写作风格研究提供量化依据。

· 后台管理

该页面为系统的数据管理控制台,面向管理员角色开放。页面顶部提供来源媒体、新闻主题等筛选条件以及关键词搜索框,方便快速定位目标新闻。下方以表格形式展示新闻标题、内容简介、关键词等信息,每条数据支持增加与删除操作,表格具备分页功能。该模块实现了新闻数据的增删改查与批量维护,保障系统数据的有序管理与持续更新。

三、项目总结

本系统是一个融合网络爬虫技术与自然语言处理能力的智能新闻分析平台。后端基于Django框架构建稳定服务,前端采用Vue实现流畅交互,通过Scrapy爬虫框架实现新闻数据的自动化采集与存储。平台在提供新闻浏览、分类搜索、详情查看等基础功能之上,深度集成多种文本分析算法:利用jieba分词进行关键词提取与词性标注,基于TextRank算法自动生成新闻摘要,采用朴素贝叶斯模型完成情感倾向判断与新闻分类。系统通过词云图、色块矩阵等可视化形式直观呈现分析结果,后台管理模块保障数据的高效维护。整体实现了从新闻采集、文本挖掘到可视化展示的全流程智能化,为用户快速把握新闻核心内容与情感基调提供了有效的分析工具。

4、核心代码

# -*- coding: utf-8 -*-

from __future__ import unicode_literals

from ..sim.bm25 import BM25

class TextRank(object):

def __init__(self, docs):

self.docs = docs

self.bm25 = BM25(docs)

self.D = len(docs)

self.d = 0.85

self.weight = []

self.weight_sum = []

self.vertex = []

self.max_iter = 200

self.min_diff = 0.001

self.top = []

def solve(self):

for cnt, doc in enumerate(self.docs):

scores = self.bm25.simall(doc)

self.weight.append(scores)

self.weight_sum.append(sum(scores)-scores[cnt])

self.vertex.append(1.0)

for _ in range(self.max_iter):

m = []

max_diff = 0

for i in range(self.D):

m.append(1-self.d)

for j in range(self.D):

if j == i or self.weight_sum[j] == 0:

continue

m[-1] += (self.d*self.weight[j][i]

/ self.weight_sum[j]*self.vertex[j])

if abs(m[-1] - self.vertex[i]) > max_diff:

max_diff = abs(m[-1] - self.vertex[i])

self.vertex = m

if max_diff <= self.min_diff:

break

self.top = list(enumerate(self.vertex))

self.top = sorted(self.top, key=lambda x: x[1], reverse=True)

def top_index(self, limit):

return list(map(lambda x: x[0], self.top))[:limit]

def top(self, limit):

return list(map(lambda x: self.docs[x[0]], self.top))

class KeywordTextRank(object):

def __init__(self, docs):

self.docs = docs

self.words = {}

self.vertex = {}

self.d = 0.85

self.max_iter = 200

self.min_diff = 0.001

self.top = []

def solve(self):

for doc in self.docs:

que = []

for word in doc:

if word not in self.words:

self.words[word] = set()

self.vertex[word] = 1.0

que.append(word)

if len(que) > 5:

que.pop(0)

for w1 in que:

for w2 in que:

if w1 == w2:

continue

self.words[w1].add(w2)

self.words[w2].add(w1)

for _ in range(self.max_iter):

m = {}

max_diff = 0

tmp = filter(lambda x: len(self.words[x[0]]) > 0,

self.vertex.items())

tmp = sorted(tmp, key=lambda x: x[1] / len(self.words[x[0]]))

for k, v in tmp:

for j in self.words[k]:

if k == j:

continue

if j not in m:

m[j] = 1 - self.d

m[j] += (self.d / len(self.words[k]) * self.vertex[k])

for k in self.vertex:

if k in m and k in self.vertex:

if abs(m[k] - self.vertex[k]) > max_diff:

max_diff = abs(m[k] - self.vertex[k])

self.vertex = m

if max_diff <= self.min_diff:

break

self.top = list(self.vertex.items())

self.top = sorted(self.top, key=lambda x: x[1], reverse=True)

def top_index(self, limit):

return list(map(lambda x: x[0], self.top))[:limit]

def top(self, limit):

return list(map(lambda x: self.docs[x[0]], self.top))

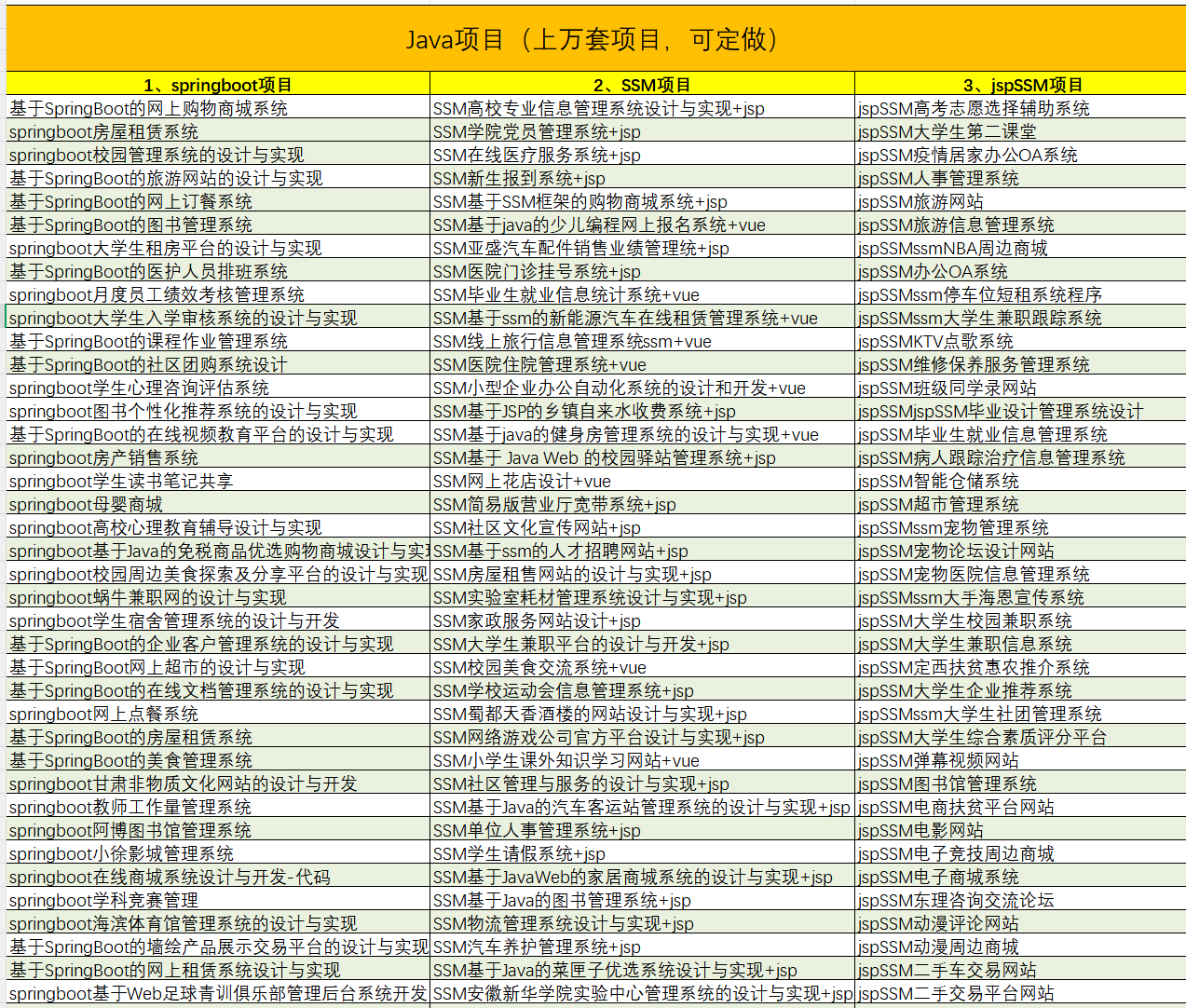

5、项目列表

6、项目获取

🍅由于篇幅限制,获取完整文章或源码、代做项目的,查看我的【用户名】、【专栏名称】、【顶部选题链接】就可以找到我啦🍅

感兴趣的可以先收藏起来,点赞、关注不迷路,下方查看👇🏻获取联系方式👇🏻