Kafka Producer 与 Consumer 深度解析:消息生产与消费的完整旅程

Kafka Producer 与 Consumer 深度解析:消息生产与消费的完整旅程

-

- 一、Producer 与 Consumer 概述

-

- 1.1 核心角色定义

- 1.2 解耦的通信模式

- 二、Producer:消息的创造者

-

- 2.1 Producer 的核心职责

- 2.2 消息的创建与序列化

- 2.3 分区器的选择艺术

- 2.4 批处理与吞吐量优化

- 2.5 消息确认与可靠性

- 三、Consumer:消息的消费者

-

- 3.1 Consumer 的核心职责

- 3.2 消费者组与分区分配

- 3.3 消费者与 Broker 的完整交互流程

-

- 3.3.1 加入消费者组

- 3.3.2 拉取消息与偏移量管理

- 3.4 偏移量管理:消费者的"书签"

- 3.5 重平衡:双刃剑

- 四、Producer 与 Consumer 配置速查表

-

- 4.1 核心配置对比

- 4.2 生产环境推荐配置

- 五、总结

-

- 5.1 Producer 与 Consumer 核心职责回顾

- 5.2 消息生产与消费完整流程图

- 5.3 一句话总结

|

🌺The Begin🌺点点关注,收藏不迷路🌺

|

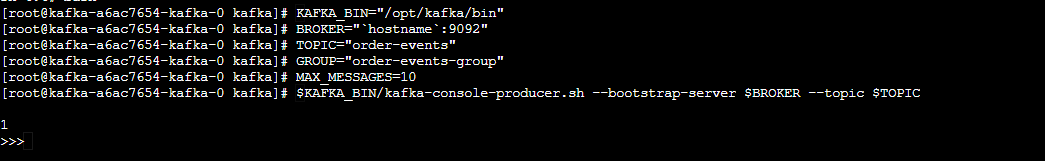

摘要:在 Kafka 的生态系统中,Producer(生产者)和 Consumer(消费者)是数据流的起点和终点,它们与 Broker 共同构成了 Kafka 的核心三角。Producer 负责将数据可靠地发送到 Kafka 集群,Consumer 则从集群中拉取数据进行处理。本文将深入剖析这两个关键角色的工作原理、内部机制和最佳实践,通过流程图和源码级的分析,帮助读者全面掌握 Kafka 消息的生产与消费过程。

一、Producer 与 Consumer 概述

1.1 核心角色定义

在 Kafka 架构中,Producer 和 Consumer 承担着截然不同但相辅相成的职责:

| 角色 | 定义 | 主要职责 |

|---|---|---|

| Producer(生产者) | 向 Kafka 主题发布消息的应用程序 | 创建消息、序列化、选择分区、发送到 Broker |

| Consumer(消费者) | 从 Kafka 主题订阅并处理消息的应用程序 | 订阅主题、拉取消息、处理数据、提交偏移量 |

1.2 解耦的通信模式

Kafka 采用完全异步和解耦的通信模式:生产者不需要知道谁在消费数据,消费者也不需要知道数据来自哪里。这种设计使得应用程序可以独立扩展、独立演进,并在故障时互不影响。

消费者层

Kafka 集群

生产者层

Producer 1

Producer 2

Topic/Partitions

Consumer 1

Consumer 2

Consumer Group

二、Producer:消息的创造者

2.1 Producer 的核心职责

Producer 负责将应用程序产生的数据转换为 Kafka 消息并发送到指定的 Topic。这个过程涉及多个关键步骤:

应用程序创建

ProducerRecord

序列化

Serializer

分区器

Partitioner

累加器

Record Accumulator

Sender线程

批量发送

Broker响应

acks处理

2.2 消息的创建与序列化

Producer 创建的消息是一个 ProducerRecord 对象,它包含以下核心字段:

- Topic:消息要发送到的主题(必需)

- Partition:指定的分区号(可选,不指定则由分区器决定)

- Key:消息键(可选,用于分区路由)

- Value:消息值(实际数据)

- Headers:消息头(可选元数据)

- Timestamp:时间戳

由于网络传输的是字节流,Producer 必须使用序列化器将 Java 对象转换为字节数组。Kafka 提供了多种内置序列化器:

-

StringSerializer:字符串序列化 -

ByteArraySerializer:字节数组序列化 -

IntegerSerializer:整数序列化

// Producer 配置示例

Properties props = new Properties();

props.put("bootstrap.servers", "localhost:9092");

props.put("key.serializer", "org.apache.kafka.common.serialization.StringSerializer");

props.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");

props.put("acks", "all"); // 消息确认机制

props.put("enable.idempotence", "true"); // 启用幂等性

KafkaProducer<String, String> producer = new KafkaProducer<>(props);

// 发送消息

ProducerRecord<String, String> record =

new ProducerRecord<>("orders", "key123", "order data");

producer.send(record, (metadata, exception) -> {

if (exception != null) {

// 处理发送失败

} else {

// 发送成功,获取元数据

System.out.println("分区: " + metadata.partition() +

", 偏移量: " + metadata.offset());

}

});

2.3 分区器的选择艺术

分区器决定了消息应该发送到 Topic 的哪个 Partition。Kafka 提供了灵活的分区策略:

// 分区器内部逻辑

public int partition(String topic, Object key, byte[] keyBytes,

Object value, byte[] valueBytes, Cluster cluster) {

List<PartitionInfo> partitions = cluster.partitionsForTopic(topic);

int numPartitions = partitions.size();

if (keyBytes == null) {

// 无键:使用粘性分区策略(Kafka 2.4+)

return stickyPartitionCache.partition(topic);

} else {

// 有键:对键哈希取模,保证相同键进入同一分区

return Utils.toPositive(Utils.murmur2(keyBytes)) % numPartitions;

}

}

分区策略对比:

| 策略 | 触发条件 | 特点 | 适用场景 |

|---|---|---|---|

| 指定分区 | 消息中指定 partition | 精确控制 | 需要严格顺序的场景 |

| 键哈希 | 消息有 key | 相同 key 进入同一分区 | 保证同一键的顺序 |

| 粘性分区 | 无 key(默认) | 批量填充同一分区,提高吞吐量 | 大多数通用场景 |

2.4 批处理与吞吐量优化

Producer 不会立即发送每条消息,而是将它们收集在内存缓冲区中,批量发送以提升吞吐量。关键配置参数包括:

| 参数 | 说明 | 默认值 | 优化建议 |

|---|---|---|---|

batch.size |

批次最大字节数 | 16 KB | 32-64 KB(提高吞吐量) |

linger.ms |

发送前等待时间 | 0 ms | 5-10 ms(增加批次大小) |

compression.type |

压缩类型 | none | gzip/snappy/lz4/zstd |

// 批处理优化配置

props.put("batch.size", 32768); // 32 KB 批次

props.put("linger.ms", 10); // 等待10ms

props.put("compression.type", "lz4"); // LZ4 压缩

2.5 消息确认与可靠性

acks 参数决定了 Producer 如何确认消息发送成功,直接影响消息的可靠性:

acks=all(精确一次基础)

发送消息

同步

ACK

所有ISR确认

Producer

Leader

Follower

acks=1(至少一次)

发送消息

写入本地后确认

Producer

Leader

acks=0(最多一次)

发送消息

不确认

Producer

Broker

| acks 值 | 含义 | 可靠性 | 吞吐量 | 适用场景 |

|---|---|---|---|---|

| 0 | Producer 不等待确认 | 最低(可能丢数据) | 最高 | 日志、监控等可丢失数据场景 |

| 1 | 等待 Leader 确认 | 中(Leader 故障可能丢数据) | 高 | 一般业务场景 |

| all/-1 | 等待所有 ISR 确认 | 最高(不丢数据) | 较低 | 金融交易、订单等关键数据 |

幂等性生产者:从 Kafka 3.0+ 开始,幂等性默认启用(enable.idempotence=true),它自动要求 acks=all,确保消息即使重试也不会重复写入。

三、Consumer:消息的消费者

3.1 Consumer 的核心职责

Consumer 负责从 Kafka 主题中拉取消息并进行处理。它采用拉取模式,主动向 Broker 请求数据,这使得消费者可以根据自身处理能力控制消费速度。

// 创建消费者

Properties props = new Properties();

props.put("bootstrap.servers", "localhost:9092");

props.put("group.id", "order-processing-group");

props.put("key.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

props.put("value.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

props.put("enable.auto.commit", "false"); // 手动提交偏移量

KafkaConsumer<String, String> consumer = new KafkaConsumer<>(props);

consumer.subscribe(Arrays.asList("orders"));

// 消费循环

while (true) {

ConsumerRecords<String, String> records = consumer.poll(Duration.ofMillis(100));

for (ConsumerRecord<String, String> record : records) {

// 处理消息

processOrder(record.value());

}

// 处理完成后提交偏移量

consumer.commitSync();

}

3.2 消费者组与分区分配

消费者组(Consumer Group) 是 Kafka 实现可扩展消费的核心机制。具有相同 group.id 的消费者实例组成一个消费组。

消费者组 G2(1个消费者)

消费者组 G1(3个消费者)

Topic(4个分区)

Partition 0

Partition 1

Partition 2

Partition 3

Consumer 1

Consumer 2

Consumer 3

Consumer 4

核心规则:

- 同一组内:每个分区只能被一个消费者消费,实现负载均衡

- 不同组之间:每个组都能消费全量消息,实现发布订阅

- 消费者数量:不应超过分区总数,多余的消费者会被闲置

3.3 消费者与 Broker 的完整交互流程

消费者与 Broker 的交互远比表面复杂,涉及多个阶段:

3.3.1 加入消费者组

GroupCoordinator

Consumer

GroupCoordinator

Consumer

触发 Rebalance,等待其他成员

alt

[如果是 leader]

[如果是 follower]

1. FindCoordinator 请求

2. 返回 GroupCoordinator 地址

3. JoinGroup 请求(无 memberId)

4. 返回 MEMBER_ID_REQUIRED + 新 memberId

5. 再次 JoinGroup(带 memberId)

6. 返回 group leader 信息和成员列表

7. SyncGroup(带分配方案)

7. SyncGroup(等待分配)

8. 返回分区分配结果

3.3.2 拉取消息与偏移量管理

Partition Leader

GroupCoordinator

Consumer

Partition Leader

GroupCoordinator

Consumer

alt

[如果无提交记录]

处理消息

1. OffsetFetch(查询已提交偏移量)

2. 返回已提交偏移量

3. ListOffset(根据 auto.offset.reset)

4. 返回起始偏移量

5. Fetch 拉取消息

6. 返回消息批次

7. OffsetCommit 提交偏移量

8. 提交确认

3.4 偏移量管理:消费者的"书签"

偏移量(Offset)是消费者在分区中的位置标记,类似于书签,记录已经处理到的位置。

偏移量提交方式:

| 提交方式 | 配置 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|---|

| 自动提交 | enable.auto.commit=true |

简单,无需编码 | 可能重复处理 | 允许重复消费的场景 |

| 手动同步提交 | commitSync() |

精确控制 | 阻塞当前线程 | 大多数生产场景 |

| 手动异步提交 | commitAsync() |

非阻塞 | 可能丢失提交 | 对性能要求高的场景 |

// 手动提交的最佳实践

try {

while (true) {

ConsumerRecords<String, String> records = consumer.poll(Duration.ofMillis(100));

for (ConsumerRecord<String, String> record : records) {

// 业务处理

process(record);

}

// 批量处理完成后,同步提交

consumer.commitSync();

}

} catch (Exception e) {

// 异常处理

} finally {

consumer.close(); // 优雅关闭,触发重平衡

}

3.5 重平衡:双刃剑

重平衡(Rebalance) 是指分区的所有权从一个消费者转移到另一个消费者的过程。它发生在以下场景:

- 新消费者加入组

- 消费者离开组(关闭或故障)

- 主题分区数变化

Stable:正常消费

Stable

Rebalancing:消费者加入/离开

Paused

Paused:万物静止,无法消费

Stable:分配完成

重平衡的影响:

- 万物静止:期间整个消费者组暂停消费

- 状态丢失:可能丢失处理状态,需要重新缓存

- 频繁发生:会严重影响性能

优化建议:

- 使用 合作式重平衡(

CooperativeStickyAssignor),它允许消费者在重平衡期间继续处理部分分区 - 配置合理的会话超时(

session.timeout.ms) - 避免频繁重启消费者

四、Producer 与 Consumer 配置速查表

4.1 核心配置对比

| 配置项 | Producer | Consumer | 说明 |

|---|---|---|---|

bootstrap.servers |

✅ | ✅ | Kafka 集群地址 |

key.serializer/deserializer |

✅ 序列化 | ✅ 反序列化 | 键的序列化/反序列化类 |

value.serializer/deserializer |

✅ 序列化 | ✅ 反序列化 | 值的序列化/反序列化类 |

group.id |

❌ | ✅ | 消费者组 ID |

acks |

✅ | ❌ | 消息确认机制 |

enable.idempotence |

✅ | ❌ | 幂等性 |

enable.auto.commit |

❌ | ✅ | 是否自动提交偏移量 |

auto.offset.reset |

❌ | ✅ | 无提交记录时的消费位置 |

4.2 生产环境推荐配置

// Producer 生产配置

props.put("acks", "all");

props.put("enable.idempotence", "true");

props.put("compression.type", "lz4");

props.put("batch.size", 32768);

props.put("linger.ms", 10);

props.put("retries", 5);

// Consumer 生产配置

props.put("enable.auto.commit", "false");

props.put("max.poll.records", 500);

props.put("partition.assignment.strategy",

"org.apache.kafka.clients.consumer.CooperativeStickyAssignor");

props.put("session.timeout.ms", 45000);

五、总结

5.1 Producer 与 Consumer 核心职责回顾

| 维度 | Producer | Consumer |

|---|---|---|

| 核心任务 | 发布消息到 Topic | 从 Topic 订阅消息 |

| 关键机制 | 分区器、批处理、重试 | 消费者组、偏移量、重平衡 |

| 可靠性保证 | acks 参数、幂等性 | 偏移量提交、Exactly-Once |

| 吞吐量优化 | 批量发送、压缩 | 批量拉取、并发处理 |

| 状态维护 | 无状态 | 维护偏移量 |

5.2 消息生产与消费完整流程图

消费者端

Kafka 集群

生产者端

业务数据

ProducerRecord

序列化

分区器

累加器

Sender线程

Leader Partition

Follower Partition

消费者组

拉取消息

反序列化

业务处理

提交偏移量

5.3 一句话总结

Kafka 的 Producer 和 Consumer 通过精妙的设计实现了生产与消费的完全解耦:Producer 负责将数据可靠地投递到 Kafka,通过分区策略和批处理优化吞吐量;Consumer 通过消费者组实现横向伸缩,用偏移量记录消费进度,两者共同构建了现代数据流处理的基础设施。

|

🌺The End🌺点点关注,收藏不迷路🌺

|