深度解读大数据领域数据中台的数据湖建设

数据湖不是“数据水库”:大数据中台下的数据湖建设全解析

关键词

数据中台 | 数据湖 | 湖仓一体 | 数据治理 | 元数据管理 | 数据分层 | 实时数据处理

摘要

在企业数字化转型的浪潮中,数据中台已成为连接数据与业务的核心枢纽,而数据湖则是数据中台的“底层基石”——它像一个“数字仓库”,存储着企业所有结构化、半结构化、非结构化数据,但又绝非简单的“数据堆砌”。本文将从背景逻辑、核心概念、技术实现、实际应用和未来趋势五个维度,深度解读数据中台视角下的数据湖建设:

- 为什么说“数据湖不是数据水库”?

- 数据湖如何与数据中台的“数据服务”“数据治理”协同?

- 湖仓一体架构如何解决传统数据湖的“数据沼泽”问题?

- 企业如何从0到1构建可治理、高价值的数据湖?

通过生活化比喻、代码示例和真实案例,本文将为大数据从业者、数据产品经理和企业CIO提供一份“可落地的 data lake 建设指南”。

一、背景介绍:为什么数据中台需要数据湖?

1.1 数据中台的“痛点”:从“数据孤岛”到“数据赋能”

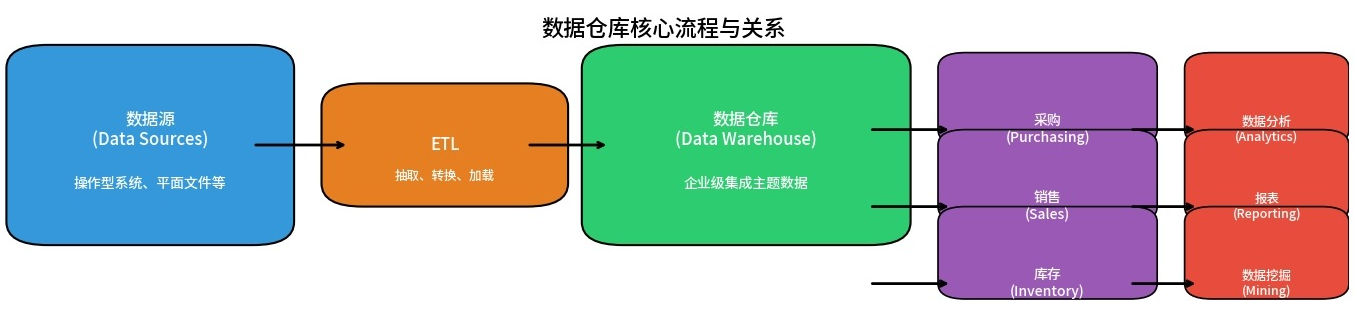

随着企业业务的扩张,数据往往分散在CRM、ERP、APP日志、物联网设备等多个系统中,形成“数据孤岛”。传统数据仓库(Data Warehouse)虽然能整合结构化数据,但无法处理半结构化(如JSON日志)、非结构化数据(如图片、视频),且迭代周期长,难以支撑实时分析需求。

数据中台的出现,就是为了打破这种局面:它通过“统一数据模型”“统一数据服务”,将分散的数据转化为“可复用的资产”,支撑营销、推荐、风控等业务场景。而数据湖,正是数据中台的“数据存储底座”——它需要容纳企业所有数据,并支持“按需提取、快速分析”。

1.2 数据湖的“使命”:从“存储”到“激活”

很多人对数据湖的理解停留在“大规模存储数据的地方”,这是对数据湖的误解。数据湖的核心价值不是“存”,而是“活”:

- 它要能“接住”所有类型的数据(结构化/半结构化/非结构化);

- 它要能“管好”数据(元数据、质量、安全),避免成为“数据沼泽”;

- 它要能“赋能”业务(支持实时/批量分析、机器学习、数据服务)。

没有数据湖的 data 中台,就像没有“备货区”的超市——无法快速响应顾客(业务)的需求。

1.3 目标读者与核心挑战

目标读者:大数据工程师、数据产品经理、企业CIO、数据治理专家。

核心挑战:

- 如何平衡“数据多样性”与“数据治理”?(既要存所有数据,又不能乱)

- 如何解决数据湖的“实时性”问题?(传统数据湖适合批量处理,无法支撑实时推荐)

- 如何让数据湖与数据仓库、数据服务协同?(避免“数据重复存储”)

二、核心概念解析:数据湖是“数字仓库”,不是“数据水库”

2.1 用“超市模型”理解数据中台与数据湖的关系

为了让概念更直观,我们用“超市”类比数据中台:

- 数据湖:超市的“备货区”(Backroom),存储着所有商品(数据),包括生鲜(非结构化数据)、零食(半结构化数据)、日用品(结构化数据);

- 数据治理:备货区的“分类管理系统”(货架标签、库存台账),确保商品(数据)能快速找到;

- 数据仓库:超市的“精加工区”(Kitchen),将生鲜(原始数据)加工成熟食(结构化报表);

- 数据服务:超市的“收银台”(Checkout),将商品(数据资产)转化为顾客(业务)需要的服务(API、报表)。

结论:数据湖是数据中台的“基础存储层”,数据治理是“管理工具”,数据仓库是“加工层”,数据服务是“价值输出层”。

2.2 数据湖 vs 数据仓库:“原材料”与“精加工食品”的区别

很多人混淆数据湖与数据仓库,其实二者的核心差异在于数据处理的时机和数据类型:

| 维度 | 数据湖 | 数据仓库 |

|---|---|---|

| 数据类型 | 结构化、半结构化、非结构化 | 主要是结构化数据 |

| 处理时机 | Schema on Read(读时schema) | Schema on Write(写时schema) |

| 用途 | 探索性分析、机器学习 | 报表、BI分析 |

| 成本 | 低(用对象存储,如S3、OSS) | 高(用数据仓库引擎,如Redshift) |

举个例子:如果企业要分析用户的“APP行为日志”(JSON格式,半结构化),数据湖会直接存储原始日志,当需要分析时再定义schema(比如提取“用户ID”“点击时间”“页面路径”);而数据仓库则需要先将日志转化为结构化的表(比如“user_behavior”表),再进行分析。

总结:数据湖适合“未知需求的探索”(比如“用户为什么流失?”),数据仓库适合“已知需求的报表”(比如“月度销售额”)。

2.3 数据湖的“核心要素”:不是“大”,而是“治”

很多企业建设数据湖的误区是“追求规模”——存越多数据越好,但结果往往变成“数据沼泽”(Data Swamp):数据找不到、质量差、无法用。

数据湖的核心要素是“治理”,包括以下四个部分:

- 元数据管理:像“图书馆的索引”,记录数据的“来源、结构、owner、血缘”(比如“user_behavior”表来自APP日志,由数据工程师张三维护,依赖“user_info”表);

- 数据质量:像“商品的保质期”,确保数据“完整、准确、一致”(比如“用户ID”不能缺失,“订单金额”不能为负数);

- 数据安全:像“超市的监控系统”,控制数据的“访问权限”(比如“用户隐私数据”只能由合规团队访问);

- 数据分层:像“超市的货架分类”,将数据分为“原始层、清洁层、聚合层、应用层”,让数据“按需取用”。

三、技术原理与实现:如何构建可治理的数据湖?

3.1 数据湖的“分层架构”:从“原始数据”到“业务价值”

数据湖的分层设计是“治理”的核心,常见的分层模型是ODS-DWD-DWS-ADS(参考阿里的数据中台架构):

数据源:APP日志、ERP、IoT设备

ODS层:原始数据层

DWD层:数据仓库明细层

DWS层:数据仓库汇总层

ADS层:应用数据层

数据服务:API、报表、机器学习

3.1.1 ODS层(操作数据存储):“原材料仓库”

作用:存储原始数据,保持数据的“原始性”和“可追溯性”。

存储格式:通常用Parquet或ORC(列存格式,压缩率高,适合分析),或JSON(保留原始结构)。

示例:用Spark读取APP日志(JSON格式),写入ODS层:

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName("ODS_Ingestion").getOrCreate()

# 读取原始JSON日志

raw_logs = spark.read.json("s3://my-data-lake/raw/app-logs/2024-05-01/")

# 写入ODS层(Parquet格式,按日期分区)

raw_logs.write.mode("append").parquet("s3://my-data-lake/ods/app-logs/date=2024-05-01/")

3.1.2 DWD层(数据仓库明细层):“清洗后的原材料”

作用:对ODS层数据进行“清洗”和“结构化”,解决“数据质量问题”。

操作:去除重复数据、填充缺失值、纠正错误数据、关联维度表(比如将“用户ID”关联到“用户信息表”)。

示例:清洗ODS层的用户行为日志,提取关键字段:

from pyspark.sql.functions import col, from_unixtime

# 读取ODS层数据

ods_logs = spark.read.parquet("s3://my-data-lake/ods/app-logs/date=2024-05-01/")

# 清洗:去除重复数据、填充缺失的“user_id”

dwd_logs = ods_logs.dropDuplicates() \

.fillna({"user_id": "unknown"}) \

.withColumn("click_time", from_unixtime(col("click_timestamp"), "yyyy-MM-dd HH:mm:ss")) \

.select("user_id", "page_path", "click_time", "device_type")

# 写入DWD层

dwd_logs.write.mode("overwrite").parquet("s3://my-data-lake/dwd/user-behavior/date=2024-05-01/")

3.1.3 DWS层(数据仓库汇总层):“半成品”

作用:对DWD层数据进行“汇总”,生成“主题化”的数据(比如“用户每日点击量”“商品周销量”)。

操作:按主题分组(比如“用户”“商品”“订单”),计算聚合指标(count、sum、avg)。

示例:计算用户每日点击量(DWS层):

from pyspark.sql.functions import countDistinct, date_format

# 读取DWD层数据

dwd_logs = spark.read.parquet("s3://my-data-lake/dwd/user-behavior/date=2024-05-01/")

# 汇总:用户每日点击量

dws_user_click = dwd_logs.groupBy("user_id", date_format("click_time", "yyyy-MM-dd").alias("date")) \

.agg(countDistinct("page_path").alias("daily_click_count"))

# 写入DWS层

dws_user_click.write.mode("overwrite").parquet("s3://my-data-lake/dws/user-daily-click/date=2024-05-01/")

3.1.4 ADS层(应用数据层):“成品”

作用:为业务场景提供“直接可用”的数据(比如推荐系统的“用户兴趣标签”、BI报表的“月度销售额”)。

操作:将DWS层数据转化为“业务友好”的格式(比如CSV、JSON),或直接写入业务数据库(比如MySQL)。

示例:将用户每日点击量写入MySQL(ADS层):

# 读取DWS层数据

dws_user_click = spark.read.parquet("s3://my-data-lake/dws/user-daily-click/date=2024-05-01/")

# 写入MySQL(ADS层)

dws_user_click.write \

.format("jdbc") \

.option("url", "jdbc:mysql://localhost:3306/business_db") \

.option("dbtable", "user_daily_click") \

.option("user", "root") \

.option("password", "123456") \

.mode("append") \

.save()

3.2 元数据管理:数据湖的“索引系统”

元数据(Metadata)是“数据的数据”,比如“数据的来源、结构、owner、血缘”。没有元数据的 data 湖,就像没有“图书索引”的图书馆——你知道里面有书,但找不到想要的。

常见的元数据管理工具:Apache Atlas(开源)、AWS Glue(云服务)、Alibaba DataWorks(阿里云)。

示例:用Apache Atlas标记数据湖中的“user_behavior”表:

{

"entity": {

"typeName": "hive_table",

"attributes": {

"name": "user_behavior",

"description": "用户APP行为日志(清洗后)",

"owner": "data_engineer_zhang",

"qualifiedName": "s3://my-data-lake/dwd/user-behavior/",

"dataSource": "APP日志系统",

"bloodline": [

{

"source": "s3://my-data-lake/ods/app-logs/",

"operation": "清洗(去重、填充缺失值)"

}

]

}

}

}

3.3 湖仓一体:解决数据湖的“实时性”与“一致性”问题

传统数据湖的痛点是“实时性差”(适合批量处理)和“一致性弱”(多任务写入可能导致数据冲突)。**湖仓一体(Lakehouse)**架构的出现,就是为了解决这些问题。

湖仓一体的核心是在数据湖上添加“事务层”(比如Apache Hudi、Delta Lake、Apache Iceberg),让数据湖支持:

- ACID事务(原子性、一致性、隔离性、持久性):多任务写入时不会冲突;

- 实时数据处理(Streaming Ingestion):支持Flink、Spark Streaming实时写入数据;

- Schema演化(Schema Evolution):允许数据结构变化(比如添加字段),不会导致分析失败。

示例:用Delta Lake实现实时数据入湖(Flink):

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.table.api.bridge.java.StreamTableEnvironment;

public class DeltaLakeStreamingIngestion {

public static void main(String[] args) throws Exception {

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

StreamTableEnvironment tEnv = StreamTableEnvironment.create(env);

// 读取Kafka实时日志(用户行为)

tEnv.executeSql("CREATE TABLE kafka_user_behavior (" +

"user_id STRING," +

"page_path STRING," +

"click_timestamp BIGINT," +

"device_type STRING" +

") WITH (" +

"'connector' = 'kafka'," +

"'topic' = 'user_behavior_topic'," +

"'properties.bootstrap.servers' = 'kafka:9092'," +

"'properties.group.id' = 'flink_consumer_group'," +

"'format' = 'json'" +

")");

// 写入Delta Lake(DWD层)

tEnv.executeSql("CREATE TABLE delta_user_behavior (" +

"user_id STRING," +

"page_path STRING," +

"click_time TIMESTAMP," +

"device_type STRING" +

") WITH (" +

"'connector' = 'delta'," +

"'path' = 's3://my-data-lake/dwd/user-behavior-delta/'," +

"'table-type' = 'iceberg'" + // 兼容Iceberg

"'sink.parallelism' = '4'" +

")");

// 实时转换( timestamp -> datetime)并写入

tEnv.executeSql("INSERT INTO delta_user_behavior " +

"SELECT user_id, page_path, TO_TIMESTAMP(click_timestamp / 1000) AS click_time, device_type " +

"FROM kafka_user_behavior");

env.execute("Delta Lake Streaming Ingestion");

}

}

3.4 数据质量评估:用“数学模型”量化数据好坏

数据质量是数据湖的“生命线”,我们需要用量化指标评估数据质量,常见的指标包括:

-

完整性(Completeness):数据缺失的比例,公式为:

Completeness=1−缺失值数量总数据量 Completeness = 1 – \frac{缺失值数量}{总数据量} Completeness=1−总数据量缺失值数量

例如,“user_id”字段的缺失值数量为100,总数据量为10000,则完整性为99%。 -

准确性(Accuracy):数据与真实值的偏差,公式为:

Accuracy=1−错误值数量总数据量 Accuracy = 1 – \frac{错误值数量}{总数据量} Accuracy=1−总数据量错误值数量

例如,“订单金额”字段的错误值(如负数)数量为50,总数据量为10000,则准确性为99.5%。 -

一致性(Consistency):数据在不同系统中的一致性,公式为:

Consistency=1−不一致值数量总数据量 Consistency = 1 – \frac{不一致值数量}{总数据量} Consistency=1−总数据量不一致值数量

例如,“用户性别”在CRM系统中为“男”,在APP日志中为“女”,则不一致值数量为20,总数据量为10000,一致性为99.8%。

示例:用Spark计算“user_behavior”表的完整性:

from pyspark.sql.functions import count, col, when

# 读取DWD层数据

dwd_logs = spark.read.parquet("s3://my-data-lake/dwd/user-behavior/date=2024-05-01/")

# 计算“user_id”字段的完整性

completeness = dwd_logs.select(

count("*").alias("total"),

count(when(col("user_id").isNull(), 1)).alias("missing")

).withColumn("completeness", (col("total") - col("missing")) / col("total"))

completeness.show()

输出:

+-----+-------+-------------+

|total|missing|completeness|

+-----+-------+-------------+

|10000| 100| 0.99|

+-----+-------+-------------+

四、实际应用:电商企业数据湖建设案例

4.1 案例背景:某电商企业的“数据痛点”

某电商企业成立5年,业务涵盖APP、小程序、线下门店,数据分散在:

- APP日志系统(用户行为数据,JSON格式);

- 订单系统(MySQL,结构化数据);

- 门店POS系统(Excel,半结构化数据);

- 商品图片系统(OSS,非结构化数据)。

痛点:

- 数据分散,无法整合分析(比如“用户线上点击行为”与“线下购买行为”无法关联);

- 实时性差,推荐系统依赖T+1的批量数据,无法实时推荐;

- 数据质量差,“用户ID”缺失率达5%,导致分析结果不准确。

4.2 数据湖建设目标

- 统一存储:将所有数据存入数据湖(阿里云OSS),支持结构化、半结构化、非结构化数据;

- 实时处理:支持Flink实时写入数据,让推荐系统能获取实时用户行为;

- 数据治理:通过元数据管理和数据质量监控,解决“数据找不到、质量差”的问题;

- 业务赋能:为推荐系统、BI报表、用户画像提供数据服务。

4.3 数据湖建设步骤

4.3.1 步骤1:数据源接入

- APP日志:用Flink读取Kafka中的实时日志,写入数据湖的ODS层(Delta Lake格式);

- 订单系统:用DataX(阿里开源工具)批量同步MySQL数据到ODS层(Parquet格式);

- 门店POS数据:用Apache Nifi将Excel文件同步到ODS层(CSV格式);

-

商品图片:直接存储到OSS的ODS层(路径:

s3://my-data-lake/ods/product-images/)。

4.3.2 步骤2:数据分层处理

- ODS层:存储原始数据,保持数据的“原始性”(比如APP日志的JSON格式、订单的MySQL表结构);

- DWD层:清洗数据(去重、填充缺失值、关联维度表),比如将“用户ID”关联到“用户信息表”(来自CRM系统),生成“user_behavior_dwd”表(Delta Lake格式);

-

DWS层:汇总数据,生成“用户每日行为汇总表”(

user_daily_behavior_dws)、“商品周销量汇总表”(product_weekly_sales_dws); - ADS层:将DWS层数据写入MySQL,为BI报表(比如“月度用户增长报表”)和推荐系统(比如“实时用户兴趣标签”)提供数据。

4.3.3 步骤3:数据治理

- 元数据管理:用Alibaba DataWorks管理元数据,标记每个表的“来源、owner、血缘”,比如“user_behavior_dwd”表来自“APP日志系统”,由数据工程师李四维护,依赖“user_info”表;

- 数据质量监控:用DataWorks的“数据质量”模块,设置“user_id”字段的缺失率阈值(≤1%),当缺失率超过阈值时,自动发送报警邮件给数据工程师;

- 数据安全:用阿里云RAM(资源访问管理)控制数据访问权限,比如“商品图片”只能由产品团队访问,“用户隐私数据”(如手机号)只能由合规团队访问。

4.3.4 步骤4:业务赋能

- 推荐系统:从ADS层读取“实时用户行为数据”(比如用户最近点击的商品),用机器学习模型生成“用户兴趣标签”,推荐相关商品;

- BI报表:从ADS层读取“月度用户增长数据”,生成“用户增长趋势图”,帮助管理层决策;

- 用户画像:从DWS层读取“用户每日行为数据”,生成“用户画像”(比如“年轻女性,喜欢美妆”),支持精准营销。

4.4 案例效果

- 数据整合效率:从“需要3天整合数据”提升到“实时整合”;

- 数据质量:“user_id”缺失率从5%降到0.5%;

- 业务价值:推荐系统的点击率提升了20%,月度销售额增长了15%。

4.5 常见问题及解决方案

| 问题 | 解决方案 |

|---|---|

| 数据湖变成“数据沼泽” | 实施数据分层(ODS-DWD-DWS-ADS),用元数据管理工具标记数据 |

| 实时性差 | 使用湖仓一体架构(Delta Lake、Hudi),支持Flink实时写入 |

| 数据质量差 | 设置数据质量阈值,用工具(如DataWorks)自动监控和报警 |

| 数据安全问题 | 用RAM、Apache Ranger等工具控制访问权限,加密敏感数据(如AES加密) |

五、未来展望:数据湖的“进化方向”

5.1 趋势1:湖仓一体的“深化”

未来,湖仓一体将成为数据湖的“标准架构”,更多的工具(如Apache Iceberg、Delta Lake)将支持:

- 多引擎兼容:支持Spark、Flink、Presto等多种计算引擎;

- 跨云部署:支持阿里云、AWS、Azure等多个云平台;

- AI原生:支持机器学习框架(如TensorFlow、PyTorch)直接读取数据湖中的数据。

5.2 趋势2:AI赋能的数据治理

传统数据治理依赖“人工规则”,未来将通过机器学习实现“自动治理”:

- 自动元数据标记:用NLP模型自动提取数据的“描述、owner、血缘”;

- 自动数据质量监控:用异常检测模型(如孤立森林)自动识别数据质量问题;

- 自动数据清洗:用生成式AI(如GPT-4)自动填充缺失值、纠正错误数据。

5.3 趋势3:多模态数据支持

随着物联网、AI的发展,企业数据将越来越多的是多模态数据(文本、图像、视频、音频)。未来数据湖需要支持:

- 多模态数据存储:比如用OSS存储图像、视频,用Elasticsearch存储文本;

- 多模态数据处理:比如用Spark处理文本数据,用TensorFlow处理图像数据;

- 多模态数据融合:比如将“用户评论文本”与“商品图片”融合,生成更精准的用户画像。

5.4 挑战与机遇

- 挑战:数据安全与隐私(如GDPR要求的数据溯源)、多模态数据处理的复杂性;

- 机遇:企业数字化转型带来的“数据资产化”需求,AI技术带来的“数据治理自动化”机会。

六、结尾:数据湖的“本质”是“数据资产的载体”

6.1 总结要点

- 数据湖是数据中台的“底层基石”,核心价值是“激活数据”,不是“存储数据”;

- 数据湖的关键是“治理”,包括元数据管理、数据质量、数据安全、数据分层;

- 湖仓一体是解决数据湖“实时性”与“一致性”问题的关键架构;

- 数据湖的未来趋势是“湖仓深化”“AI赋能”“多模态支持”。

6.2 思考问题

- 你的企业数据湖建设中遇到的最大挑战是什么?

- 如何平衡“数据多样性”与“数据治理”?

- 湖仓一体架构对你的企业有什么价值?

6.3 参考资源

- 书籍:《数据中台实战:从0到1构建数据中台》(作者:付登坡)、《Lakehouse:The Definitive Guide》(作者:Bill Inmon);

- 论文:《Delta Lake: A Unified Data Management System for Lakehouse Architecture》(ACM SIGMOD 2021);

- 工具文档:Apache Hudi官方文档(https://hudi.apache.org/)、Delta Lake官方文档(https://delta.io/);

- 课程:阿里云大数据认证(ACP)——数据湖方向。

结语:数据湖不是“数据水库”,而是“数据资产的载体”。只有通过“治理”让数据“活”起来,才能支撑数据中台的“数据赋能”价值。希望本文能为你的数据湖建设提供一些启发,让数据真正成为企业的“核心资产”。

(全文完)