cv_resnet101_face-detection_cvpr22papermogface部署教程:WSL2环境下CUDA驱动配置要点

cv_resnet101_face-detection_cvpr22papermogface部署教程:WSL2环境下CUDA驱动配置要点

1. 引言

想在Windows系统里用上Linux的开发环境,同时还能调用NVIDIA显卡来跑深度学习模型?WSL2(Windows Subsystem for Linux 2)加上CUDA的组合,现在就能实现这个愿望。特别是对于需要部署像MogFace这样基于ResNet101的高性能人脸检测模型时,一个稳定、高效的GPU环境至关重要。

本教程将手把手带你完成在WSL2中配置CUDA驱动的全过程,确保你的cv_resnet101_face-detection_cvpr22papermogface项目能够顺利调用GPU进行加速推理。我们会从最基础的WSL2安装讲起,一步步解决CUDA驱动安装、环境验证以及可能遇到的常见问题。无论你是刚接触WSL2的新手,还是之前配置遇到过挫折,这篇指南都旨在提供一个清晰、可靠的路径。

2. 环境准备:安装与启用WSL2

在配置CUDA之前,我们首先需要一个可用的WSL2环境。以下是详细的步骤。

2.1 系统要求检查

确保你的Windows系统满足以下最低要求:

- Windows版本:Windows 10 版本 2004(内部版本 19041)或更高,或者 Windows 11。

- 虚拟化支持:你的电脑CPU需要支持并已在BIOS/UEFI中启用虚拟化技术(如Intel VT-x或AMD-V)。你可以在任务管理器的“性能”选项卡中查看“虚拟化”是否已启用。

2.2 安装WSL2

我们可以通过一条简单的命令来完成WSL2及其默认Linux发行版(通常是Ubuntu)的安装。以管理员身份打开 Windows PowerShell 或 命令提示符,输入以下命令:

wsl --install

这条命令会执行以下操作:

- 启用“适用于Linux的Windows子系统”和“虚拟机平台”这两个必需的Windows功能。

- 下载并安装最新的Linux内核更新包。

- 将WSL2设置为默认版本。

- 下载并安装默认的Ubuntu发行版。

安装完成后,系统会提示你重启电脑。重启后,Ubuntu的终端窗口会自动弹出,要求你设置一个新的UNIX用户名和密码。这个账户是Linux子系统内的管理员账户,请务必记住你设置的密码。

2.3 验证WSL2安装

重启并设置好Linux用户后,我们验证一下安装是否成功。在Windows PowerShell中运行:

wsl --list --verbose

或者简写为:

wsl -l -v

如果安装成功,你会看到类似下面的输出,其中 VERSION 列显示为 2:

NAME STATE VERSION

* Ubuntu Running 2

这表示你的Ubuntu发行版正在以WSL2模式运行。

3. 核心步骤:在WSL2中配置CUDA驱动

这是最关键的一步。与在纯Linux系统中需要单独安装NVIDIA驱动不同,WSL2的CUDA支持依赖于Windows主机上安装的特定NVIDIA驱动。

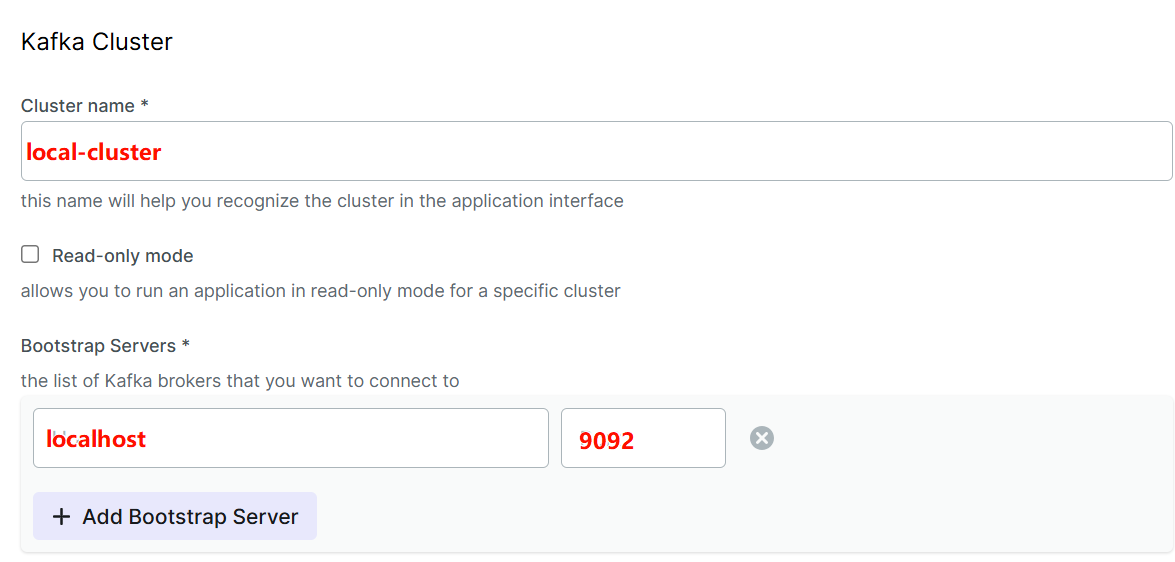

3.1 在Windows主机安装NVIDIA驱动

- 访问NVIDIA官网:打开浏览器,访问 NVIDIA驱动程序下载页面。

-

选择产品类型:

- 产品类型:

GeForce(如果你使用的是消费级显卡如RTX系列)或NVIDIA RTX / Quadro(专业卡)。 - 产品系列:选择与你显卡匹配的系列(例如 GeForce RTX 40 Series)。

- 产品家族:选择具体的显卡型号(例如 RTX 4060)。

- 操作系统:选择

Windows 11或Windows 10(根据你的实际情况)。 -

下载类型:这里非常关键,务必选择

GRD (Game Ready Driver)。 - 语言:选择简体中文。

- 产品类型:

- 点击“搜索”并下载:找到匹配的驱动程序后,点击“下载”。

- 安装驱动:运行下载的安装程序,选择“自定义安装”,并勾选“执行清洁安装”以确保安装干净。按照提示完成安装并重启Windows系统。

重要提示:WSL2对CUDA的支持要求Windows端的NVIDIA驱动版本必须足够新(通常需要高于某一特定版本,如470系列以上)。安装最新的Game Ready Driver通常能满足要求。

3.2 在WSL2(Ubuntu)中安装CUDA Toolkit

Windows端的驱动提供了内核级的GPU支持,而在WSL2的Linux环境中,我们还需要安装用户态的CUDA Toolkit来使用nvcc编译器、库文件等。

-

打开WSL2终端:在开始菜单找到你安装的Ubuntu应用并打开,或者在任何地方输入

wsl命令进入。 -

更新系统包列表:

sudo apt update -

安装CUDA Toolkit:NVIDIA为WSL2提供了专门的CUDA仓库。我们通过以下命令安装:

# 首先,获取CUDA仓库的密钥 wget https://developer.download.nvidia.com/compute/cuda/repos/wsl-ubuntu/x86_64/cuda-keyring_1.1-1_all.deb # 安装密钥包 sudo dpkg -i cuda-keyring_1.1-1_all.deb # 更新包列表以识别新仓库 sudo apt update # 安装CUDA Toolkit(这里安装的是CUDA 12.4,你可以根据需要调整版本号) sudo apt install -y cuda-toolkit-12-4安装过程可能需要一些时间,请耐心等待。

3.3 配置环境变量

为了让系统能够找到CUDA的编译器和库,我们需要将CUDA的路径添加到环境变量中。

- 编辑用户主目录下的

.bashrc文件:nano ~/.bashrc - 在文件的末尾添加以下几行:

export PATH=/usr/local/cuda-12.4/bin${PATH:+:${PATH}} export LD_LIBRARY_PATH=/usr/local/cuda-12.4/lib64${LD_LIBRARY_PATH:+:${LD_LIBRARY_PATH}}注意:如果安装的不是CUDA 12.4,请将路径中的

12.4替换为你实际安装的版本号。 - 保存并退出编辑器(在nano中,按

Ctrl+X,然后按Y,最后按Enter)。 - 让配置立即生效:

source ~/.bashrc

4. 验证与测试

环境配置好后,必须进行验证,确保CUDA和GPU可以被正确识别和访问。

4.1 基础验证命令

在WSL2终端中,依次运行以下命令:

-

检查NVIDIA驱动(来自Windows主机):

nvidia-smi如果配置成功,你会看到一个表格,显示你的GPU型号、驱动版本、CUDA版本以及GPU的进程、内存使用情况等信息。这是最重要的成功标志。

-

检查CUDA编译器:

nvcc --version这会输出你安装的CUDA Toolkit的版本信息。

4.2 运行一个简单的CUDA测试程序

我们可以编译并运行一个NVIDIA官方提供的简单CUDA样例来进一步测试。

-

进入CUDA样例目录(如果已安装):

cd /usr/local/cuda-12.4/extras/demo_suite/(同样,请根据你的CUDA版本调整路径)

-

运行

deviceQuery程序:./deviceQuery如果一切正常,程序会输出大量关于你GPU设备的信息,并在最后显示

Result = PASS。 -

运行

bandwidthTest程序:./bandwidthTest这个程序测试主机与设备之间的内存带宽,同样应该以

Result = PASS结束。

看到这两个“PASS”,就证明你的WSL2 CUDA环境已经完全配置成功,可以正常进行CUDA计算了。

5. 部署MogFace人脸检测工具

CUDA环境就绪后,部署 cv_resnet101_face-detection_cvpr22papermogface 项目就水到渠成了。

5.1 准备项目环境

在你的WSL2家目录或工作目录中,克隆或准备好项目代码。然后安装必要的Python依赖:

# 假设你已安装Python3和pip

pip install modelscope opencv-python torch streamlit Pillow numpy

5.2 准备模型权重

根据项目要求,你需要将下载好的MogFace模型权重文件,放置到指定的绝对路径: /root/ai-models/iic/cv_resnet101_face-detection_cvpr22papermogface

你可以使用 cp 或 mv 命令在WSL2内部移动文件,或者直接从Windows资源管理器将文件拖入WSL2的Linux文件系统中(路径通常为 \\wsl$\Ubuntu\home\<你的用户名>\...)。

5.3 启动Streamlit应用

在项目根目录(包含 app.py 的目录)下,运行:

streamlit run app.py

Streamlit会自动在WSL2中启动一个本地服务器。注意:WSL2的网络与Windows是桥接的。你需要在弹出的终端信息中,找到类似 Network URL: http://localhost:8501 的地址。

关键步骤:你不能直接在WSL2的终端里点击这个链接。你需要打开 Windows系统上的浏览器(如Chrome, Edge),然后在地址栏中输入 http://localhost:8501 来访问这个应用界面。

5.4 验证GPU加速

应用启动时,@st.cache_resource 装饰器会加载模型。你可以通过以下方式验证GPU是否在工作:

- 在运行

streamlit run的命令行输出中,查看是否有关于CUDA或GPU的日志信息(例如Using CUDA device)。 - 在另一个WSL2终端窗口运行

nvidia-smi,查看是否有Python进程正在占用GPU显存。 - 在Streamlit应用界面上传图片并点击检测,感受推理速度。如果GPU加速生效,即使是基于ResNet101的模型,检测速度也应该是“秒级”或更快的。

6. 常见问题与解决方案

在配置过程中,你可能会遇到以下问题:

-

问题:运行

nvidia-smi提示“command not found”。- 解决:这几乎总是因为Windows主机上的NVIDIA驱动未正确安装或版本太旧。请返回 3.1节,确保安装了最新的Game Ready Driver,并重启Windows。

-

问题:

nvidia-smi能运行,但nvcc --version提示“command not found”。-

解决:CUDA Toolkit未正确安装或环境变量未配置。请检查 3.2节 的安装命令是否成功执行,并确认 3.3节 的环境变量路径是否正确,是否执行了

source ~/.bashrc。

-

解决:CUDA Toolkit未正确安装或环境变量未配置。请检查 3.2节 的安装命令是否成功执行,并确认 3.3节 的环境变量路径是否正确,是否执行了

-

问题:Streamlit应用启动后,在Windows浏览器中访问

localhost:8501连接被拒绝。-

解决:确保Streamlit服务是在WSL2中成功启动的(检查终端有无报错)。WSL2的

localhost与Windows是互通的,此问题较少见,可尝试重启WSL2 (wsl --shutdown然后在PowerShell中重启),或检查防火墙设置。

-

解决:确保Streamlit服务是在WSL2中成功启动的(检查终端有无报错)。WSL2的

-

问题:运行应用时出现CUDA out of memory错误。

- 解决:ResNet101模型需要一定的显存。尝试处理分辨率更小的图片,或者确保没有其他程序占用大量显存。你可以在检测前,通过Streamlit侧边栏的“清理显存/重置”按钮来释放资源。

-

问题:WSL2内文件操作慢。

-

解决:将项目文件放在WSL2的Linux根文件系统内(如

/home/yourname/projects),而不是挂载的Windows盘符(如/mnt/c/...)下,能获得更好的I/O性能。

-

解决:将项目文件放在WSL2的Linux根文件系统内(如

7. 总结

通过以上步骤,我们完成了从零开始在WSL2中搭建CUDA驱动环境,并成功部署运行了基于ResNet101的MogFace人脸检测工具。整个过程的核心在于理解WSL2的架构:GPU驱动由Windows主机提供,而CUDA Toolkit和用户程序运行在WSL2的Linux环境中。

关键要点回顾:

- 系统是基础:确保Windows版本和硬件虚拟化支持符合要求。

- 驱动是关键:在Windows端安装最新的NVIDIA Game Ready Driver是第一步,也是最重要的一步。

- 环境要配好:在WSL2中通过官方仓库安装CUDA Toolkit,并正确设置环境变量。

-

验证不可少:务必使用

nvidia-smi和CUDA样例程序来双重验证环境配置成功。 - 部署即应用:在验证成功的环境中安装Python依赖、放置模型权重,即可顺利启动GPU加速的AI应用。

这个配置不仅适用于MogFace项目,也为你在WSL2环境下进行任何其他的PyTorch、TensorFlow等深度学习开发奠定了坚实的基础。现在,你可以尽情享受在Windows系统上,利用Linux环境和NVIDIA GPU进行高效AI模型开发和推理的便利了。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。