国产最强开源模型 GLM-5.1 来了!Ollama 一键部署,开启 8 小时自主 AI 工作

引言

GLM-5.1的开源,确实是近期AI圈的一则重磅消息。为了让内容更充实,我将上一版的介绍与GLM-5的详细对比融合在了一起,这样能更清晰地看到它的进化。

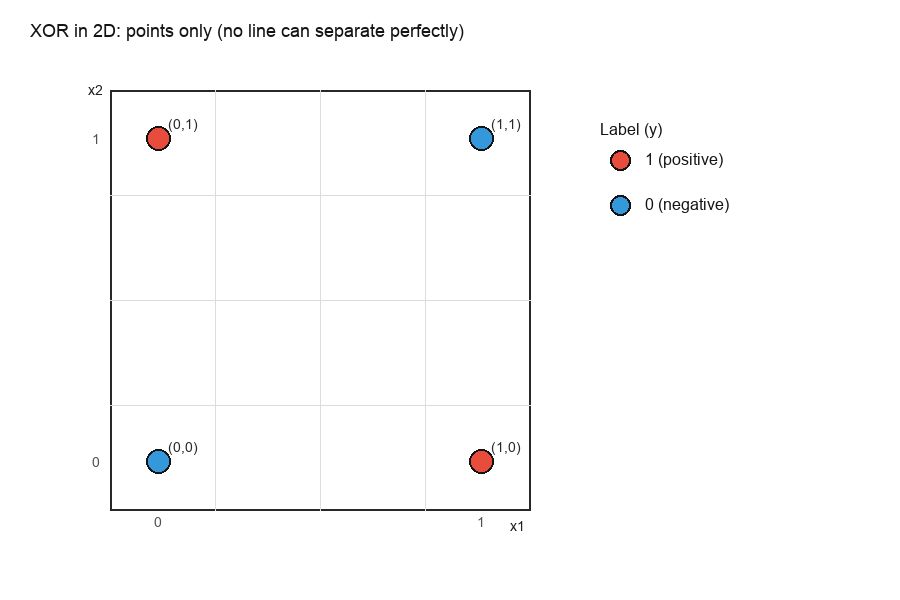

一图看懂:GLM-5 vs. GLM-5.1

为了让你直观感受GLM-5.1的进化幅度,先看这张对比表格:

| 对比维度 | GLM-5 | GLM-5.1 | 升级变化 |

|---|---|---|---|

| 总参数规模 | 744B(MoE稀疏架构) | 744B(MoE稀疏架构) | 架构一致 |

| 激活参数 | 约40B | 约40B | 推理效率相当 |

| 上下文窗口 | 200K | 200K | 保持一致 |

| 最大输出Tokens | 128K | 128K | 保持一致 |

| 训练数据量 | 28.5T tokens | 28.5T tokens | 基础数据一致 |

| 训练硬件 | 华为昇腾910B芯片 | 华为昇腾910B芯片(约10万张) | 全栈国产化 |

| 开源协议 | MIT | MIT | 商业友好 |

| 核心架构创新 | DSA稀疏注意力、Slime异步RL | DSA深度优化、Slime框架升级 | 工程优化 |

| 推理效率 | DSA降低计算成本1.5-2倍 | 推理成本再降20%+,Token效率提升15% | 成本效率双升 |

| 长程任务能力 | 分钟级交互,长程易偏离目标 | 8小时级持续工作,自主闭环 | 质变 |

| 编程能力(官方基准) | 35.4分 | 45.3分 | +28% |

| SWE-Bench Pro(真实开发) | — | 58.4分(超Opus 4.6) | 开源新标杆 |

| 向量数据库优化 | 早早就见顶 | 600+轮迭代,QPS从3.5k到21.5k(6倍) | 持续进化能力 |

| GPU内核优化 | 早早就见顶 | 1000+轮迭代,3.6倍加速(vs torch.compile 1.49倍) | 质的飞跃 |

| 独立交付能力 | 需人工干预 | 1200+步自主完成4.8MB Linux桌面系统 | 工程化交付 |

一句话总结:GLM-5.1在架构参数基本不变的前提下,通过后训练工程的深度优化,实现了从“会写代码”到“能独立工作8小时”的能力质变。

① 8小时级长程任务:从“分钟级”到“工程级”的质变

这是GLM-5.1最核心、最颠覆性的突破。以往的模型(包括GLM-5)有一个通病:开局猛如虎,跑着跑着就没招了,到了瓶颈就开始原地踏步[reference:0]。GLM-5.1最大的突破在于:运行时间越长,结果越好[reference:1]。

智谱用三个真实场景展示了这种质变:

场景一:向量数据库优化——600+轮自主迭代

在VectorDBBench任务中,GLM-5.1不限制迭代轮次,让模型自主决定何时提交新版本。经过600多次迭代、6000多次工具调用,最终查询吞吐量从3,547 QPS飙升至21,500 QPS,是此前的6倍[reference:2]。更关键的是,优化过程呈现6次阶梯式跃升,每次都是模型分析自己的性能日志后主动发起的架构级改进[reference:3]。作为对比,GLM-5在这个任务上早早就见顶了,而GLM-5.1到后期还在持续进步[reference:4]。

场景二:GPU内核优化——1000+轮持续加速

在KernelBench Level 3任务中,GLM-5.1将PyTorch参考实现优化成了更快的GPU kernel,最终达到3.6倍加速比,远超torch.compile默认设置的1.15倍和max-autotune的1.49倍[reference:5]。虽然Claude Opus 4.6的4.2倍稍高,但GLM-5.1相比GLM-5的进化是质的飞跃——后者早早就停滞不前了[reference:6]。

场景三:8小时构建Linux桌面——1200+步自主交付

这是一个最夸张的案例:给模型一个提示词“用网页技术构建一个Linux风格桌面环境”,没有模板代码,没有设计稿,没有中间指导[reference:7]。GLM-5.1套了一个外循环:每轮执行完后审视自己的输出,找出可以改进的地方——缺少的功能、粗糙的样式、有bug的交互——然后继续。这个循环跑了8个小时,历经1200多步,最终产出了一套功能完善的Linux桌面系统,包含完整的桌面、窗口管理器、状态栏、应用程序、VPN管理器、中文字体支持和游戏库等,4.8MB配套文件相当于一个4人团队一周的开发量[reference:8]。

对比意义:大多数模型——包括早期版本的GLM——很快就放弃了,搞个静态任务栏加一两个占位窗口就宣布完成了。GLM-5.1做到了真正的自主闭环:实验 → 分析 → 优化[reference:9]。

② 智能体与推理:从“写代码”到“做工程”

GLM-5.1在智能体工程(Agentic Engineering) 方向的提升同样显著。在长程任务中保持稳定输出,模型面对的不仅是更大代码量,而是一连串复杂的工程决策点:主动跑benchmark、定位瓶颈、修改方案、再跑测试[reference:10]。

GLM-5.1实现了从“需求分析-框架搭建-代码编写-漏洞调试-优化迭代”的全流程工程化开发[reference:11]。在异步强化学习框架Slime上的深度优化,让模型能从多步骤任务中持续迭代,解决了上代模型长任务容易偏离目标的问题[reference:12]。

在推理效率上,GLM-5.1对DeepSeek稀疏注意力机制做了专属优化,在保持200K长上下文效果无损的前提下,推理成本降低20%以上,Token效率提升15%,普通服务器也能高效运行[reference:13]。

而这一切的算力支撑,完全来自国产芯片——GLM-5/5.1训练于约10万张华为昇腾910B芯片,没有使用任何NVIDIA GPU[reference:14]。

③ 多维度评测:国产模型首次超越Opus 4.6

GLM-5.1是唯一达到8小时级持续工作的开源模型,也是全球范围内除Claude Opus 4.6外少数具备这一能力的模型[reference:15]。

在最接近真实软件开发的SWE-Bench Pro基准测试中,GLM-5.1以58.4分刷新全球最佳成绩,超越了GPT-5.4(57.7)和Claude Opus 4.6(57.3),成为开源模型新标杆[reference:16]。SWE-Bench Pro要求模型在真实GitHub仓库中定位并修复高难度工程Bug,是衡量模型能否胜任专业软件开发的最硬指标[reference:17]。

此外,在衡量专业软件开发、操作命令行解决问题、从零构建完整代码仓库等三个代表性代码评测基准的平均结果中,GLM-5.1取得全球模型第三、国产模型第一、开源模型第一[reference:18]。

④ 编程能力飞跃:28%的巨大提升

编程能力是GLM-5.1最直观的升级。官方编程评测数据显示,GLM-5.1的编程基准分数从GLM-5的35.4分直接飙升至45.3分,提升幅度达28%[reference:19][reference:20]。

这意味着什么?45.3分已达到Claude Opus 4.6编程性能的94.6%,距离全球最强编程模型仅差2.6分,直接超越了多款国际主流闭源模型[reference:21][reference:22]。

在推理与知识方面,GLM-5.1在AIME 2025数学竞赛中取得92.7%,优于DeepSeek、Gemini和Llama等主流模型;在GPQA Diamond上达到86.0%,在MMLU上达到88-92%,均展现出扎实的基础能力[reference:23]。

结语

GLM-5.1不是一次架构革新,而是一次后训练工程的深度胜利[reference:24]。它在GLM-5的基石上,通过多任务SFT、推理强化学习、智能体强化学习等渐进对齐技术[reference:25],在不到两个月的时间里,将编程能力提升了近三成,让长程自主任务从“概念”变成了“现实”。

MIT协议 + Ollama一键部署 + 国产芯片全栈适配的组合,意味着开发者不需要昂贵的GPU集群,在自己的电脑上就能拥有一个能“工作8小时”的AI工程师。

现在,去终端里敲下 ollama pull glm-5.1,亲自感受一下国产最强开源模型的生产力吧。