Hadoop NameNode与DataNode通信机制深度解析

Hadoop NameNode与DataNode通信机制深度解析

-

- 一、通信架构概览

-

- 1.1 通信模式

- 1.2 通信协议栈

- 二、核心通信机制详解

-

- 2.1 心跳通信机制

- 2.2 注册机制

- 2.3 块报告机制

- 三、通信协议详解

-

- 3.1 RPC协议实现

- 3.2 通信超时机制

- 四、通信流程图解

-

- 4.1 完整通信生命周期

- 4.2 故障处理流程图

- 五、通信优化策略

-

- 5.1 批量处理与压缩

- 5.2 通信优先级队列

- 六、监控和调试

-

- 6.1 关键监控指标

- 6.2 通信日志分析

- 6.3 性能调优参数

- 七、常见问题与解决方案

-

- 7.1 通信故障排查表

- 7.2 紧急恢复脚本

- 八、总结:通信机制设计哲学

|

🌺The Begin🌺点点关注,收藏不迷路🌺

|

在HDFS的分布式架构中,NameNode和DataNode之间的通信是维系整个系统正常运转的神经网络。这种通信机制的设计直接影响着系统的可用性、可靠性和性能。本文将深入剖析两者之间的通信协议、消息类型、心跳机制以及故障处理流程。

一、通信架构概览

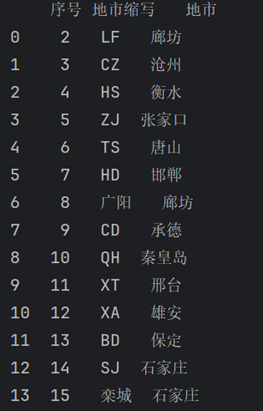

1.1 通信模式

通信架构

块报告

启动时/定期

指令下发

心跳响应携带

心跳通信

每隔3秒

心跳请求

心跳请求

心跳请求

心跳响应

心跳响应

心跳响应

块报告

块报告

块报告

NameNode

主节点

DataNode 1

DataNode 2

DataNode 3

1.2 通信协议栈

// HDFS RPC通信协议接口

@ProtocolInfo(

protocolName = "org.apache.hadoop.hdfs.protocol.ClientProtocol",

protocolVersion = 1

)

public interface ClientProtocol {

// NameNode与DataNode的通信定义在DatanodeProtocol中

}

/**

* DataNode与NameNode之间的通信协议

* DataNode通过该协议与NameNode进行交互

*/

@ProtocolInfo(

protocolName = "org.apache.hadoop.hdfs.protocol.DatanodeProtocol",

protocolVersion = 1

)

public interface DatanodeProtocol {

// DataNode注册

DatanodeRegistration registerDatanode(DatanodeRegistration registration)

throws IOException;

// 心跳方法 - DataNode定期调用

HeartbeatResponse sendHeartbeat(DatanodeRegistration registration,

StorageReport[] reports,

long xmitsInProgress,

int xceiverCount,

int failedVolumes,

VolumeFailureSummary volumeFailureSummary)

throws IOException;

// 块报告 - DataNode汇报其存储的所有块

DatanodeCommand[] blockReport(DatanodeRegistration registration,

String poolId,

StorageBlockReport[] reports)

throws IOException;

// 增量块报告 - 汇报新增/删除的块

DatanodeCommand[] incrementalBlockReport(DatanodeRegistration registration,

String poolId,

ReceivedDeletedBlockInfo[] blocks)

throws IOException;

// 缓存报告

DatanodeCommand[] cacheReport(DatanodeRegistration registration,

String poolId,

List<Long> blockIds)

throws IOException;

}

二、核心通信机制详解

2.1 心跳通信机制

心跳是DataNode向NameNode发送的定期存活信号,是两者间最基础的通信形式。

指令队列

NameNode

DataNode

指令队列

NameNode

DataNode

alt

[有指令需要执行]

[无指令]

loop

[每3秒]

如果NameNode连续10次未收到心跳

(默认10分钟),则判定DataNode死亡

收集节点状态

(存储容量、负载、磁盘状况)

发送心跳请求

更新DataNode状态

(标记存活时间戳)

检查待处理指令

返回待执行指令

心跳响应(携带指令)

执行指令

(块删除、块复制等)

下次心跳汇报执行结果

等待下次心跳

心跳数据包内容:

// 心跳请求中包含的关键信息

public class HeartbeatRequest {

private DatanodeRegistration registration; // DataNode注册信息

private StorageReport[] storageReports; // 存储状态报告

private long xmitsInProgress; // 正在进行的传输数

private int xceiverCount; // 活跃线程数

private int failedVolumes; // 故障磁盘数量

private VolumeFailureSummary volumeFailureSummary; // 磁盘故障详情

// 示例数据

// storageReports:

// - 总容量: 10TB

// - 已使用: 3TB

// - 剩余: 7TB

// - 磁盘状态: HEALTHY

// xceiverCount: 12 (当前处理12个读写请求)

}

心跳响应指令类型:

public abstract class DatanodeCommand {

// 指令类型

public static final int DNA_UNKNOWN = 0; // 未知指令

public static final int DNA_TRANSFER = 1; // 传输块到其他节点

public static final int DNA_INVALIDATE = 2; // 使本地块失效

public static final int DNA_SHUTDOWN = 3; // 关闭DataNode

public static final int DNA_REGISTER = 4; // 重新注册

public static final int DNA_FINALIZE = 5; // 完成升级

public static final int DNA_RECOVERBLOCK = 6; // 恢复块

public static final int DNA_ACCESSKEYUPDATE = 7; // 更新访问密钥

public static final int DNA_BALANCERBANDWIDTHUPDATE = 8; // 更新balance带宽

}

// 具体指令示例:删除块指令

public class InvalidatedBlocksCommand extends DatanodeCommand {

private final String poolId;

private final Block[] blocks; // 需要删除的块列表

public InvalidatedBlocksCommand(Block[] blocks, String poolId) {

super(DatanodeProtocol.DNA_INVALIDATE);

this.blocks = blocks;

this.poolId = poolId;

}

}

2.2 注册机制

DataNode启动时的首次连接流程:

成功

通过

不通过

失败

DataNode启动

初始化存储目录

加载块信息到内存

连接NameNode

发送注册请求

获取命名空间信息

版本兼容性检查

完成握手

DataNode关闭

发送全量块报告

进入正常心跳循环

重试机制

注册过程代码实现:

// DataNode注册核心逻辑

public class DataNode {

private void connectToNameNode() throws IOException {

// 1. 创建RPC代理

DatanodeProtocol namenode = DNConf.createNamenode(this);

// 2. 构造注册信息

DatanodeRegistration registration = new DatanodeRegistration(

getMachineName(), // 主机名

getDataNodeID(), // DataNodeID

getSoftwareVersion(), // 软件版本

getLayoutVersion() // 布局版本

);

// 3. 发送注册请求

int retryCount = 0;

while (retryCount < maxRetries) {

try {

registration = namenode.registerDatanode(registration);

break; // 注册成功

} catch (IOException e) {

retryCount++;

Thread.sleep(retryInterval * retryCount);

}

}

// 4. 注册成功后发送块报告

if (registration != null) {

StorageReport[] reports = getStorageReports();

namenode.blockReport(registration,

getBlockPoolId(),

reports);

}

}

}

2.3 块报告机制

DataNode定期向NameNode报告其存储的所有块信息。

块报告类型

全量块报告

启动时/定期

增量块报告

实时变化

扫描所有磁盘块

构建块列表

压缩传输

使用轻量级压缩

NameNode验证

更新块映射

记录块变更

创建/删除/复制

缓存变更事件

心跳时上报

NameNode增量更新

块报告数据结构:

// 全量块报告

public class BlockReport {

private String blockPoolId; // 块池ID

private StorageBlockReport[] reports; // 每个存储的报告

// 每个存储的报告

class StorageBlockReport {

private StorageUuid storageUuid; // 存储UUID

private BlockListAsLongs blocks; // 块列表(压缩存储)

private long[] blockIds; // 块ID数组

private long[] blockSizes; // 块大小数组

private long[] blockGenStamps; // 块世代戳

// 压缩存储示例

// 未压缩: [Block(1,128M,1001), Block(2,64M,1002)...]

// 压缩后: [1,134217728,1001,2,67108864,1002...]

}

}

增量块报告优化:

// 增量块报告,避免全量传输

public class IncrementalBlockReport {

private ReceivedDeletedBlockInfo[] blocks;

// 块变更类型

enum BlockStatus {

RECEIVED, // 新接收的块

DELETED, // 已删除的块

RECEIVING, // 正在接收的块

DELETED_BY_CLIENT // 客户端请求删除

}

// 批量处理变更

public void addBlockChange(Block block,

BlockStatus status,

String source) {

// 缓存变更,定时上报

pendingChanges.add(new ReceivedDeletedBlockInfo(

block, status, source));

}

}

三、通信协议详解

3.1 RPC协议实现

// Hadoop RPC核心实现

public class NameNodeRpcServer implements DatanodeProtocol {

private final NameNode nameNode;

private final NamenodeProtocol nnProtocol;

@Override

public HeartbeatResponse sendHeartbeat(DatanodeRegistration registration,

StorageReport[] reports,

long xmitsInProgress,

int xceiverCount,

int failedVolumes,

VolumeFailureSummary volumeFailureSummary)

throws IOException {

// 1. 验证DataNode注册信息

checkRegistration(registration);

// 2. 更新NameNode中的DataNode状态

nameNode.getNamesystem().handleHeartbeat(

registration, reports, xceiverCount, xmitsInProgress);

// 3. 检查是否需要返回指令

List<DatanodeCommand> cmds = new ArrayList<>();

// 检查块复制/删除指令

DatanodeCommand cmd = nameNode.getNamesystem()

.getPendingCommands(registration);

if (cmd != null) {

cmds.add(cmd);

}

// 4. 检查Balance相关指令

cmd = nameNode.getBalancerBandwidthCommand(registration);

if (cmd != null) {

cmds.add(cmd);

}

// 5. 构造响应

return new HeartbeatResponse(cmds.toArray(new DatanodeCommand[0]),

new RollingUpgradeStatus());

}

}

3.2 通信超时机制

// 超时配置和检测

public class HeartbeatManager {

// 心跳超时配置

private static final long HEARTBEAT_INTERVAL_MS = 3000; // 3秒

private static final int HEARTBEAT_EXPIRY_SCANS = 5; // 扫描周期数

private static final long HEARTBEAT_EXPIRY_INTERVAL_MS =

20000; // 20秒(保守估计)

// 实际超时判断

public boolean isDatanodeDead(DatanodeDescriptor node) {

long lastUpdate = node.getLastUpdateMonotonic();

long currentTime = monotonicNow();

// 默认超时 = 心跳间隔 × 心跳超时扫描数

// 3秒 × 5 = 15秒,但会考虑网络波动

long expiryTime = lastUpdate +

HEARTBEAT_EXPIRY_INTERVAL_MS;

return currentTime > expiryTime;

}

// 如果10次心跳未收到(30秒),认为节点死亡

// 但实际上NameNode会在10.5分钟后才标记为dead

// 避免网络瞬断导致误判

public void heartbeatCheck() {

long expiryTime = monotonicNow() -

10 * 60 * 1000; // 10分钟

for (DatanodeDescriptor node : datanodes) {

if (node.getLastUpdate() < expiryTime) {

markDatanodeDead(node);

}

}

}

}

四、通信流程图解

4.1 完整通信生命周期

故障阶段

变更阶段

运行阶段

启动阶段

有指令

无指令

DataNode启动

RPC连接

注册

块报告

心跳通信

NameNode响应

执行指令

等待

汇报结果

块变更

增量报告

NameNode更新

网络分区

超时检测

标记死亡

副本复制

4.2 故障处理流程图

客户端

NameNode

DataNode 2

DataNode 1

客户端

NameNode

DataNode 2

DataNode 1

正常心跳

DataNode 1宕机

loop

[心跳检测]

10分钟后

标记DataNode 1死亡

发现块副本数不足

客户端无感知

系统自动恢复

心跳 (t=0s)

心跳 (t=0s)

心跳丢失 (t=3s)

检查最后心跳时间

检查块副本数

指令:复制块A

从其他节点复制

读取文件X

返回DataNode 2位置

读取数据

返回数据

五、通信优化策略

5.1 批量处理与压缩

// 批量心跳处理

public class BatchedHeartbeatHandler {

// 合并多个DataNode的心跳响应

private class HeartbeatBatch {

List<DatanodeRegistration> nodes = new ArrayList<>();

List<HeartbeatResponse> responses = new ArrayList<>();

void add(DatanodeRegistration reg, HeartbeatResponse resp) {

nodes.add(reg);

responses.add(resp);

}

void flush() {

// 批量发送响应

for (int i = 0; i < nodes.size(); i++) {

sendResponse(nodes.get(i), responses.get(i));

}

nodes.clear();

responses.clear();

}

}

// 使用压缩传输块报告

public byte[] compressBlockReport(BlockListAsLongs blocks) {

// 使用Snappy压缩

SnappyCompressor compressor = new SnappyCompressor();

byte[] uncompressed = blocks.toBytes();

byte[] compressed = new byte[compressor.maxCompressedLength(uncompressed.length)];

int compressedSize = compressor.compress(uncompressed,

0,

uncompressed.length,

compressed);

// 压缩率通常可达70-80%

logger.info("块报告压缩率: {}%",

(compressedSize * 100) / uncompressed.length);

return Arrays.copyOf(compressed, compressedSize);

}

}

5.2 通信优先级队列

// 为不同类型的通信设置优先级

public class PriorityCommunicationManager {

private static final int PRIORITY_CRITICAL = 1; // 注册、心跳

private static final int PRIORITY_HIGH = 2; // 块报告

private static final int PRIORITY_NORMAL = 3; // 普通RPC

private static final int PRIORITY_LOW = 4; // 监控信息

private PriorityBlockingQueue<CommunicationTask> queue =

new PriorityBlockingQueue<>();

class CommunicationTask implements Comparable<CommunicationTask> {

int priority;

Runnable task;

@Override

public int compareTo(CommunicationTask other) {

return Integer.compare(this.priority, other.priority);

}

}

public void submitTask(Runnable task, int priority) {

CommunicationTask ct = new CommunicationTask();

ct.priority = priority;

ct.task = task;

queue.offer(ct);

}

}

六、监控和调试

6.1 关键监控指标

# 查看DataNode状态

hdfs dfsadmin -report

# 输出示例

# NameNode: localhost:9000

# -------------------------------------------------

# Live datanodes (3):

#

# Name: 192.168.1.101:50010 (datanode1)

# Hostname: datanode1

# Last contact: 0s ago # 最近心跳时间

# Last block report: 5s ago # 最近块报告

# Blocks: 1250

# Capacity: 10 TB

# Used: 3 TB (30.0%)

# Remaining: 7 TB

#

# Name: 192.168.1.102:50010 (datanode2)

# Last contact: 2s ago

# Blocks: 1248

6.2 通信日志分析

// 开启通信调试日志

// 在log4j.properties中添加

log4j.logger.org.apache.hadoop.hdfs.server.datanode.DataNode=DEBUG

log4j.logger.org.apache.hadoop.hdfs.server.namenode.NameNode=DEBUG

log4j.logger.org.apache.hadoop.ipc.Server=DEBUG

// 分析关键日志

public class CommunicationAnalyzer {

public void analyzeLogs() {

// 心跳延迟检测

// 2024-01-15 10:30:25,123 DEBUG DataNode: Sending heartbeat to /192.168.1.100

// 2024-01-15 10:30:25,245 DEBUG DataNode: Received heartbeat response

// 计算延迟: 122ms

// 块报告延迟

// 2024-01-15 10:31:00,456 DEBUG DataNode: Sending block report with 1250 blocks

// 2024-01-15 10:31:00,789 DEBUG DataNode: Block report acked

// 计算处理时间: 333ms

}

}

6.3 性能调优参数

<!-- hdfs-site.xml 通信相关配置 -->

<configuration>

<!-- 心跳间隔 -->

<property>

<name>dfs.heartbeat.interval</name>

<value>3</value>

<description>心跳间隔秒数</description>

</property>

<!-- 块报告间隔 -->

<property>

<name>dfs.blockreport.intervalMsec</name>

<value>21600000</value>

<description>块报告间隔(6小时)</description>

</property>

<!-- 增量块报告间隔 -->

<property>

<name>dfs.blockreport.incremental.intervalMsec</name>

<value>1000</value>

<description>增量块报告间隔</description>

</property>

<!-- RPC超时设置 -->

<property>

<name>dfs.namenode.rpc-address</name>

<value>0.0.0.0:8020</value>

</property>

<!-- 通信线程数 -->

<property>

<name>dfs.namenode.handler.count</name>

<value>100</value>

<description>NameNode处理RPC的线程数</description>

</property>

<property>

<name>dfs.datanode.handler.count</name>

<value>20</value>

<description>DataNode处理RPC的线程数</description>

</property>

<!-- 数据流超时 -->

<property>

<name>dfs.datanode.socket.write.timeout</name>

<value>480000</value>

<description>套接字写入超时(8分钟)</description>

</property>

</configuration>

七、常见问题与解决方案

7.1 通信故障排查表

| 现象 | 可能原因 | 诊断命令 | 解决方案 |

|---|---|---|---|

| DataNode无法注册 | 版本不兼容 | hdfs --version |

统一Hadoop版本 |

| 心跳超时 | 网络延迟 |

ping datanodenetstat -an | grep 8020

|

检查网络,调整超时 |

| 块报告过大 | 块数量过多 | hdfs fsck / -blocks |

增大块大小,清理无用数据 |

| NameNode负载高 | 频繁心跳 | jstat -gcutil NameNodePID |

调整handler.count |

| DataNode频繁宕机 | 内存不足 | free -m |

增加内存,减少线程数 |

7.2 紧急恢复脚本

#!/bin/bash

# 通信故障紧急恢复脚本

# 1. 检查NameNode状态

hdfs haadmin -getServiceState nn1

# 2. 如果NameNode僵死,强制刷新

hdfs debug recoverLease -path / -retries 10

# 3. 重启DataNode通信服务

for host in $(cat /etc/hadoop/slaves); do

ssh $host "systemctl restart hadoop-datanode"

done

# 4. 重新建立块报告

hdfs dfsadmin -refreshNodes

# 5. 监控恢复状态

watch -n 5 'hdfs dfsadmin -report | grep "Last contact"'

八、总结:通信机制设计哲学

Hadoop NameNode与DataNode的通信机制体现了几个核心设计原则:

- 简约而不简单:通过心跳机制实现复杂的分布式协调

- 失败常态化:设计时假设网络可能随时中断,通过超时和重试保证系统稳定

- 批量优化:合并指令、压缩数据,最大化利用网络带宽

- 状态分离:NameNode只维护元数据,DataNode负责实际数据,通信中只传递必要信息

- 推拉结合:心跳是DataNode主动推送,指令是NameNode被动响应,形成高效的协作模式

核心启示:

NameNode和DataNode之间的通信看似简单(只是心跳),实则承载了整个分布式文件系统的协调工作。这种"轻量级、高频次"的通信设计,既保证了系统的实时性,又避免了过多的网络开销,是分布式系统设计的经典范例。

理解这种通信机制,不仅有助于Hadoop的运维调优,对其他分布式系统的学习和设计也有重要参考价值。

|

🌺The End🌺点点关注,收藏不迷路🌺

|